系统设计面试

在线阅读

《系统设计面试:内幕指南(中文翻译)》

原名:《System Design Interview: An Insider’s Guide》

作者:Alex Xu

译者:精灵王 @Admol

目录

- 第 1 章:从零到数百万用户的规模

- 第 2 章:粗略估算

- 第 3 章:系统设计面试框架

- 第 4 章:设计一个分布式限流器

- 第 5 章:一致性哈希设计

- 第 6 章:设计一个 key-value 存储系统

- 第 7 章:设计一个分布式系统唯一ID生成器

- 第 8 章:设计一个短网址系统

- 第 9 章:设计一个网络爬虫系统

- 第 10章:设计一个通知系统

- 第 11章:设计一个新闻提要系统

- 第 12章:设计一个聊天系统

- 第 13章:设计一个搜索自动完成系统

- 第 14章:设计 YouTube

- 第 15章:设计 Google Drive

《系统设计面试:内幕指南(第二卷)》

原名:《System Design Interview An Insider's Guide Volume 2》

作者:Alex Xu &Sahn Lam

译者:精灵王 @Admol

目录

- 第1章 邻近服务

- 第2章 附近的好友

- 第3章 谷歌地图

- 第4章 分布式消息队列

- 第5章 指标监控与告警系统

- 第6章 广告点击事件聚合

- 第7章 酒店预订系统

- 第8章 分布式邮件服务

- 第9章 类S3对象存储

- 第10章:实时游戏排行榜

- 第11章 支付系统

- 第12章 数字钱包

- 第13章 股票交易所

声明

译者纯粹出于 学习目的 与 个人兴趣 翻译本书,不追求任何经济利益。

译者保留对此版本译文的署名权,其他权利以原作者和出版社的主张为准。

本译文只供学习研究参考之用,不得公开传播发行或用于商业用途。

有能力阅读英文书籍者请至亚马逊购买正版支持。

第01章:从0到百万用户

设计一个支持数百万用户的系统具有挑战性,是一个需要持续完善和不断改进的过程。在这一章中,我们构建一个支持单个用户的系统,并逐渐扩展以服务数百万用户。阅读完这一章后,你将掌握一些技巧,有助于你解决系统设计面试问题。

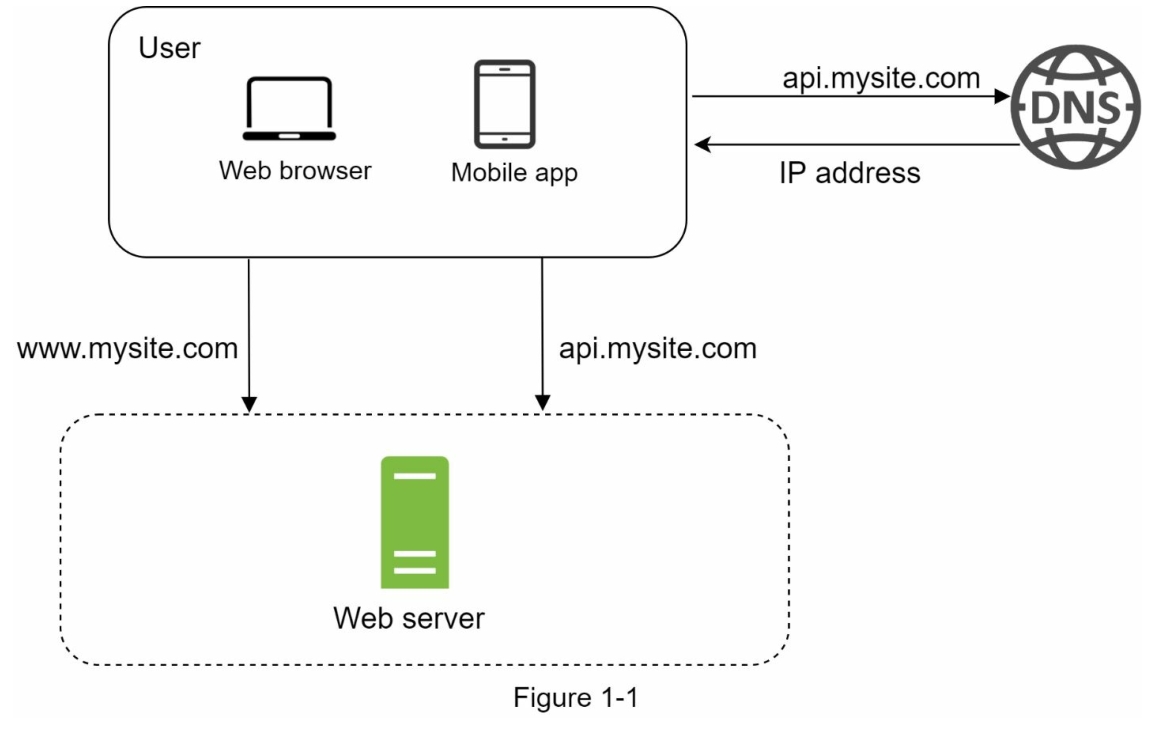

单服务器设置

千里之行始于足下,构建一个复杂的系统亦是如此。为了从简单的地方开始,我们把所有东西都运行在一个单独的服务器上。图1-1展示了单服务器设置的示意图,其中所有内容都在一个服务器上运行:Web应用程序、数据库、缓存等。

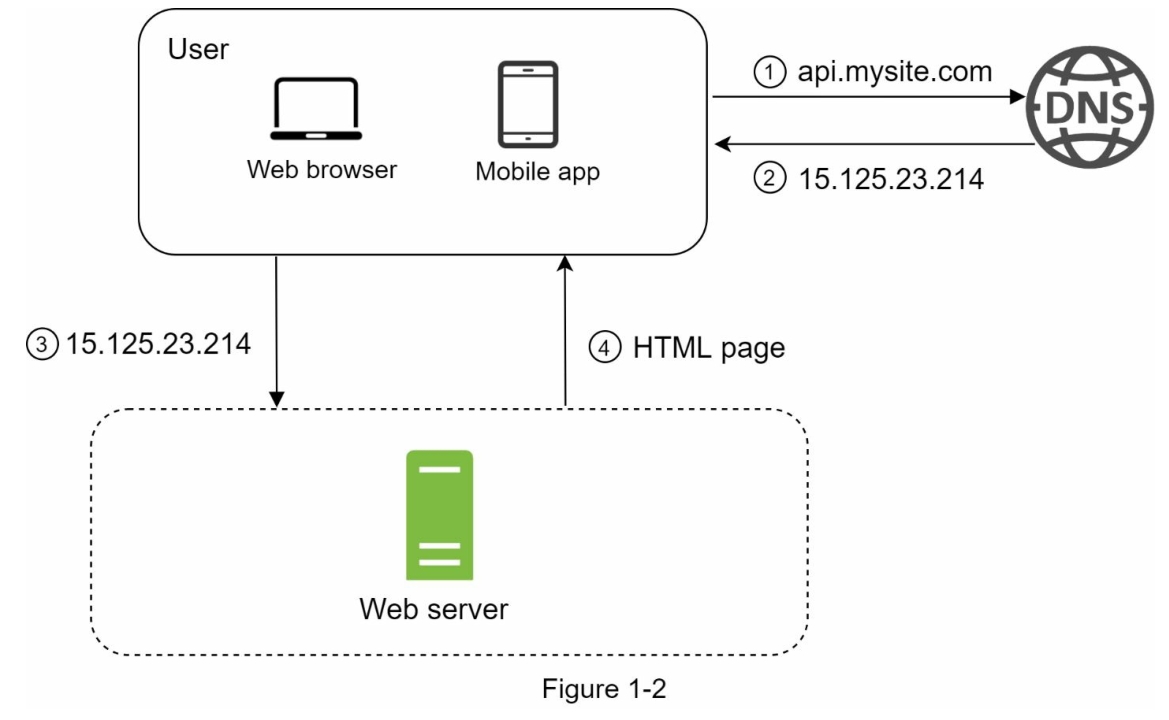

为了理解这个设置,调查请求流程和流量来源是有帮助的。首先,让我们看一下请求流程(图1-2)。

- 用户通过域名访问网站,例如api.mysite.com。通常,域名系统(DNS)是由第三方提供的付费服务,而不是由我们的服务器托管。

- Internet Protocol(IP)地址被返回给浏览器或移动应用程序。在这个例子中,返回的IP地址是15.125.23.214。

- 一旦获得了IP地址,就会直接向您的Web服务器发送超文本传输协议(HTTP)[1]请求。

- Web服务器返回用于渲染的HTML页面或JSON响应。

接下来,让我们检查流量来源。对你的Web服务器的流量来自两个来源:Web应用程序和移动应用程序。

-

Web应用程序:它使用一组服务器端语言(Java、Python等)来处理业务逻辑、存储等,以及客户端语言(HTML和JavaScript)进行呈现。

-

移动应用程序:HTTP协议是移动应用程序和Web服务器之间的通信协议。由于其简单性,JavaScript Object Notation(JSON)是常用的API响应格式用于数据传输。以下是JSON格式的API响应示例:

``` GET /users/12 – Retrieve user object for id = 12 { "id": 12, "firstName": "John", "lastName": "Smith", "address": { "streetAddress": "21 2nd Street", "city": "New York", "state": "NY", "postalCode":10021 }, "phoneNumbers": [ "212 555-1234", "646 555-4567" ] } ```

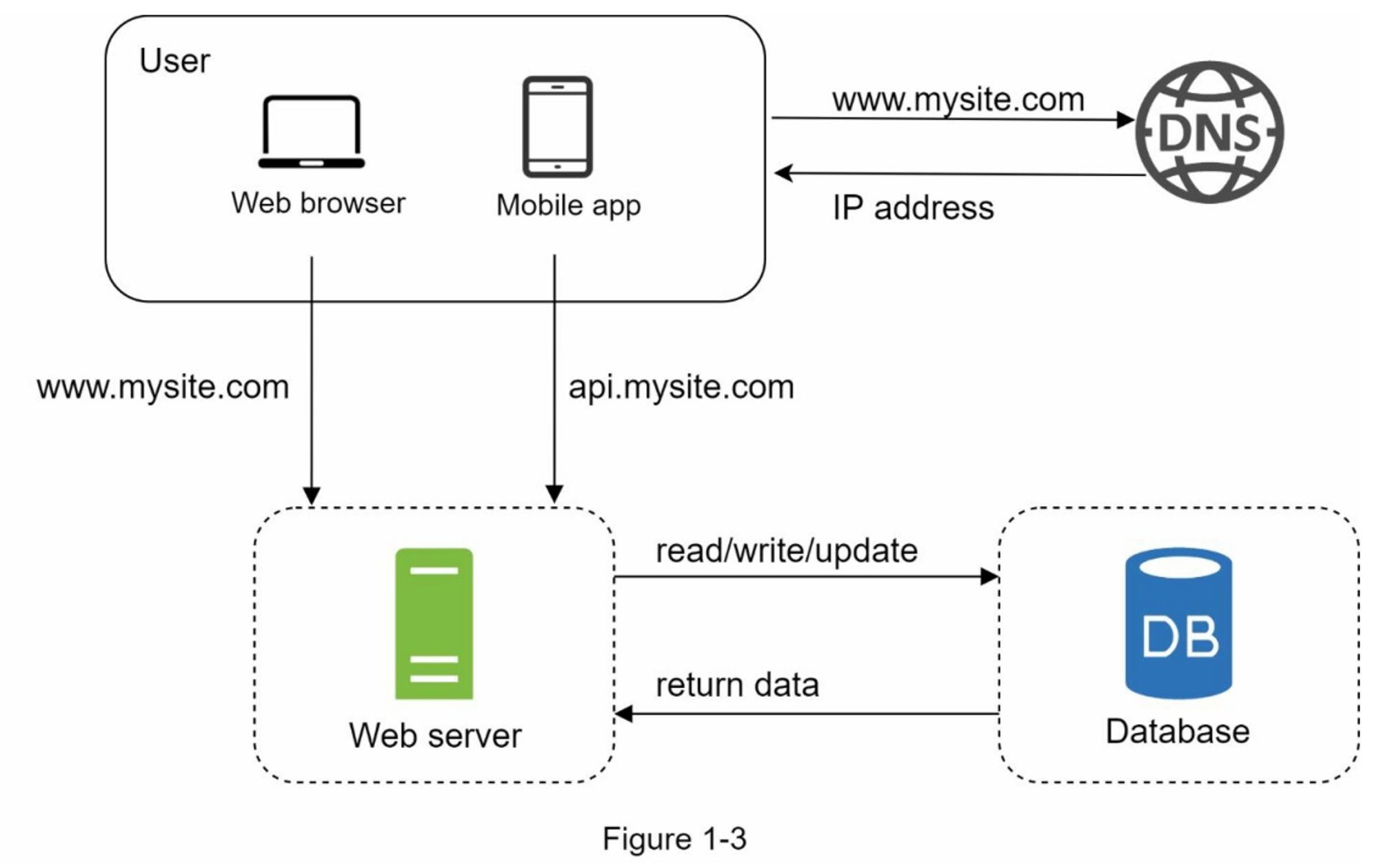

数据库

随着用户基数的增长,单个服务器已经不够,我们需要多个服务器:一个用于处理Web/移动流量,另一个用于数据库(图1-3)。将Web/移动流量(Web层)和数据库(数据层)服务器分开允许它们独立扩展。

-

使用什么数据库?

你可以在传统关系型数据库和非关系型数据库之间进行选择。让我们来看看它们的区别。

关系型数据库也称为关系数据库管理系统(RDBMS)或SQL数据库。其中最流行的包括MySQL、Oracle数据库、PostgreSQL等。关系型数据库使用表格和行来表示和存储数据。你可以使用SQL在不同的数据库表之间执行连接操作。

非关系型数据库也称为NoSQL数据库。其中一些流行的包括CouchDB、Neo4j、Cassandra、HBase、Amazon DynamoDB等[2]。这些数据库分为四类:键值存储、图存储、列存储和文档存储。非关系型数据库通常不支持连接操作。

对于大多数开发者来说,关系型数据库是最佳选择,因为它们已经存在了40多年,历史上一直表现良好。然而,如果关系型数据库不适用于你特定的用例,那么探索超越关系型数据库是至关重要的。

在以下情况,非关系型数据库可能是正确的选择:

- 你的应用程序需要超低延迟

- 你的数据是非结构化的,或者你没有任何关系型数据。

- 你只需要序列化和反序列化数据(JSON、XML、YAML等)。

- 你需要存储大量的数据

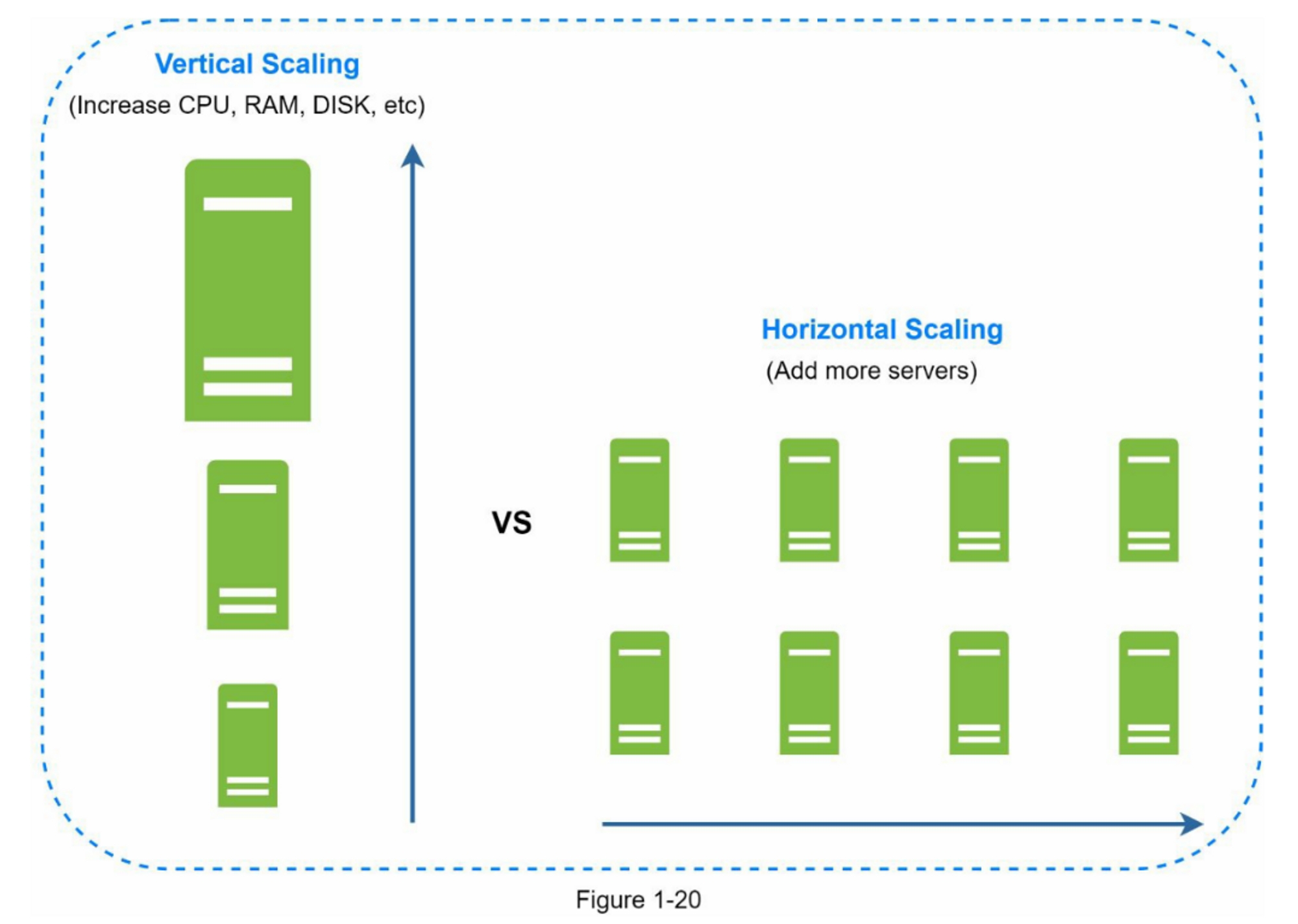

垂直扩展vs水平扩展

垂直扩展,又称为“纵向扩展”,指的是通过增加单个服务器的计算能力(CPU、RAM等)来提升其性能。

水平扩展,又称为“横向扩展”,允许通过向资源池中添加更多服务器来进行扩展。

当流量较低时,垂直扩展是一个很好的选择,而垂直扩展的主要优势在于其简单性。不幸的是,它也带有一些严重的限制。

- 垂直扩展有一个硬性限制,不可能为单个服务器无限制的添加CPU和内存

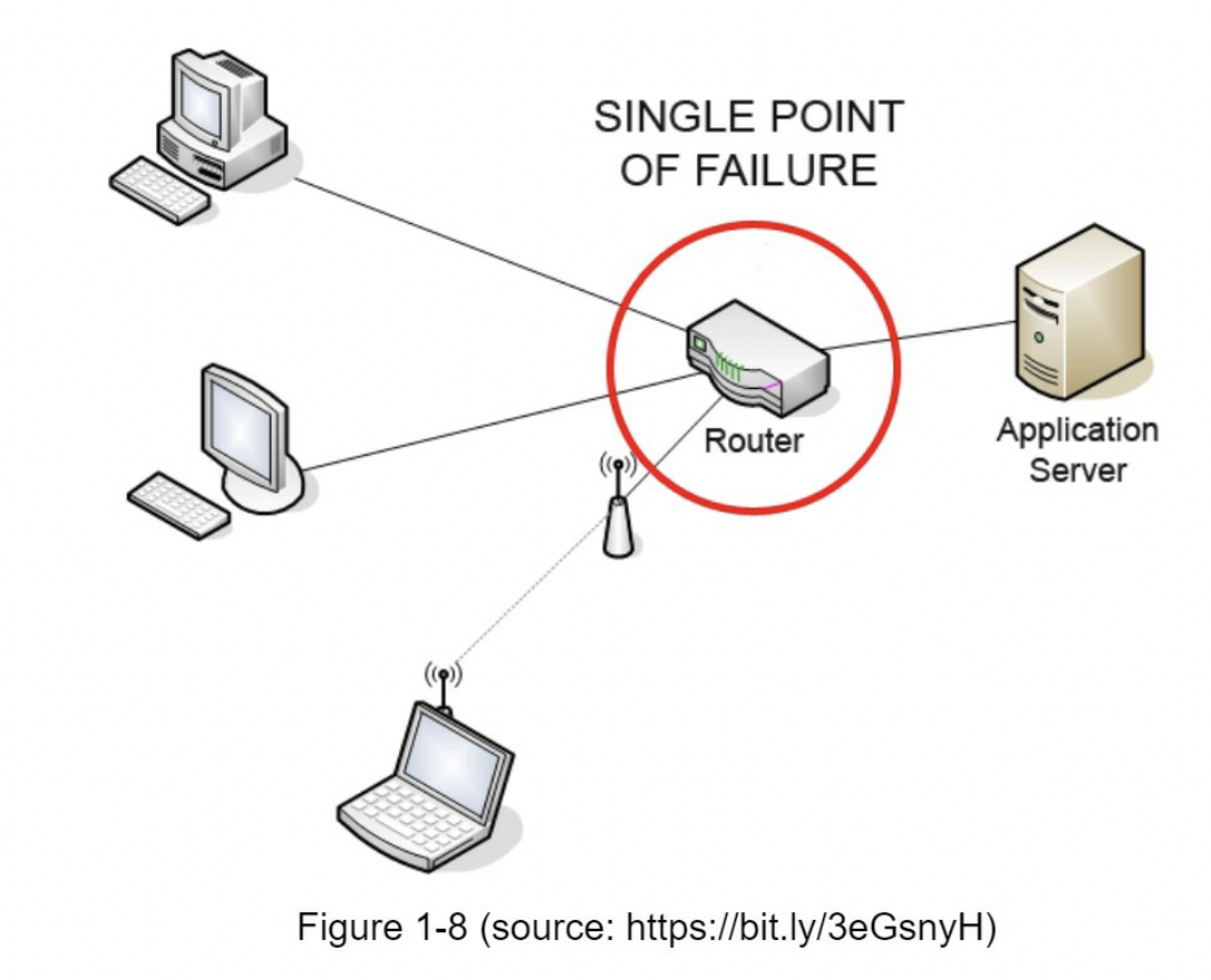

- 垂直扩展没有故障转移和冗余,如果一台服务出现宕机,网站和应用程序都会彻底宕机。

由于垂直扩展的局限性,对于大规模应用程序来说,水平扩展更为理想。

在以前的设计中,用户直接连接到web服务器,如果服务器下线,用户将不能访问网站。在另一种情况下,如果许多用户同时访问web服务器,并且它达到了web服务器的限制,则用户通常会遇到响应较慢或者无法连接到服务器的情况。

负载均衡是解决这些问题的最佳技术方案。

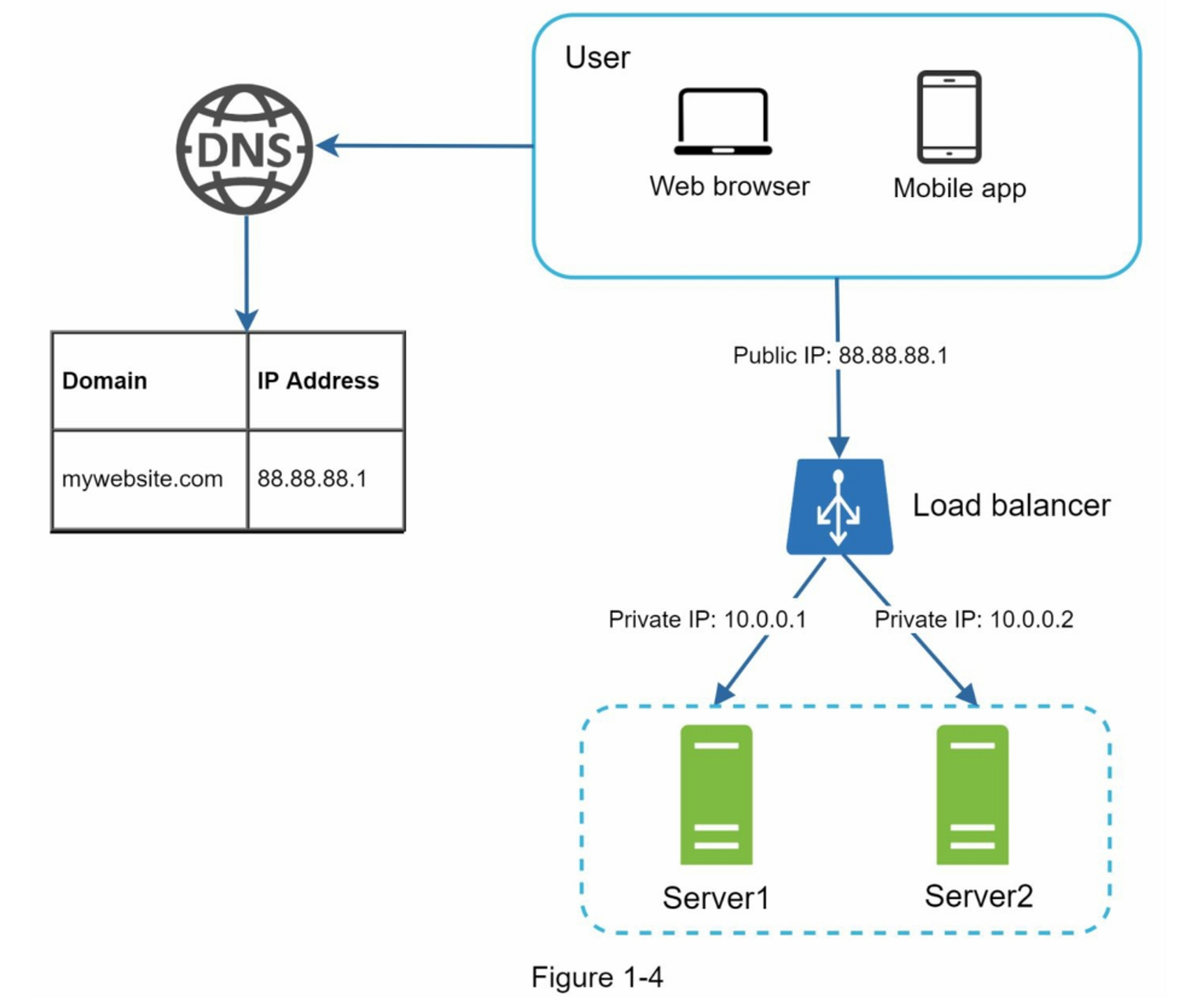

负载均衡

负载均衡器均匀地分配传入的流量到在负载均衡集中定义的Web服务器,图1-4展示了负载均衡器的工作原理。

如图1-4显示,用户直接连接负载均衡的公网IP。通过此配置,客户端不再直接访问web服务器,为了提高安全性,服务器之间的通信使用私有IP。私有IP是仅在同一网络中的服务器之间可达的IP地址。然而,它在互联网上是不可访问的。负载均衡器通过私有IP与Web服务器通信。

在图1-4中,在添加了一个负载均衡和第二个web服务器后,我们成功解决了故障切换问题,并提高了Web层的可用性。

详细解释如下:

- 如果服务器1下线,所有流量将被路由到服务器2。这可以防止网站离线,我们还将在服务器池中添加一个新的健康Web服务器来平衡负载。

- 如果网站流量迅速增长,并且两台服务器不足以处理流量,那么负载均衡可以很好的处理这个问题,你只需要向web服务器池中添加更多的服务器,负载均衡会自动发送请求给他们。

现在Web层看起来很好,那数据层呢?当前设计只有一个数据库,因此不支持故障切换和冗余。数据库复制是解决这些问题的常见技术,让我们来看看吧。

数据库复制

引用自维基百科:“数据库复制可适用于许多数据库管理系统,通常在原始数据库(master)与副本数据库(slaves)之间建立主/从关系”。

主数据库通常仅支持写的操作。从数据库从主数据库中复制数据并且仅支持读操作。所有修改数据的命令,如:insert,delete,update 都必须发送到主数据库。

大多数应用程序对读写比的要求较高,因此,系统中从库的数量通常大于主库的数量。

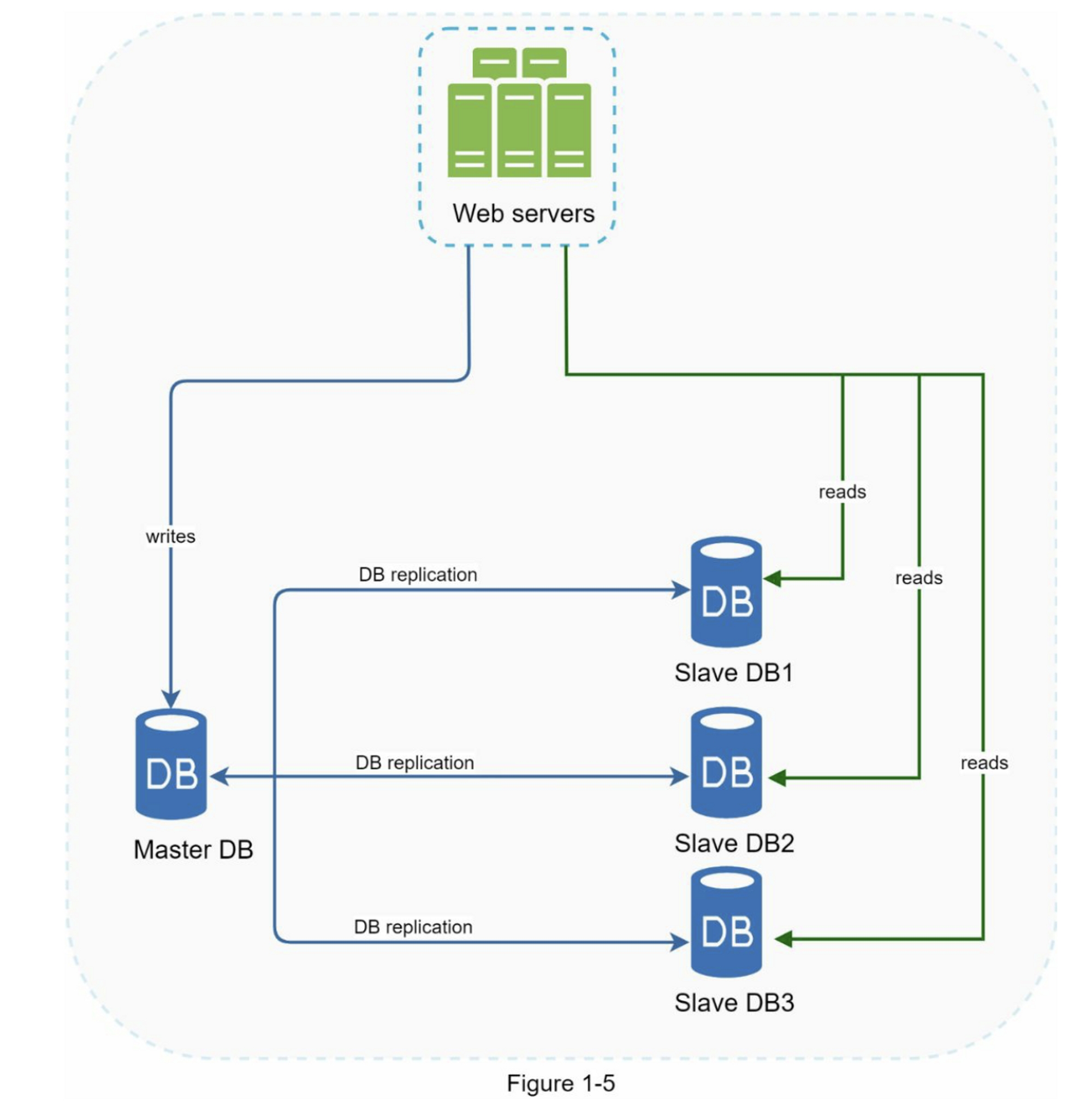

图1-5展示了一个主数据库和多个从数据库的情况。

数据库复制的优势包括:

- 更好的性能:在这个主/从模型中,所有的写入和更新都发生在主节点,而所有的读操作分布在从节点。这种模型提高了性能,因为它允许并行处理更多的查询。

- 可靠性:如果你的其中一台数据库被台风、地震等自然灾害破坏,数据仍然会被保留。你无需担心数据丢失,因为数据被复制到多个位置。

- 高可用性:通过在不同位置复制数据,即使一台数据库离线,你的网站仍然可以运行,因为你可以访问存储在另一个数据库服务器中的数据。

在前面的部分,我们讨论了负载均衡器如何帮助提高系统的可用性。在这里我们提出相同的问题:如果其中一个数据库离线怎么办?图1-5中讨论的架构设计可以处理这种情况:

- 如果只有一个从数据库可用且它离线,读操作将临时指向主数据库。一旦发现问题,一个新的从库将会替换掉旧的从库,如果有多个从数据库是可用的,读操作会被转发到其他健康的从数据库,

- 如果主数据库离线,一个从库会被提升为新的主库,所有的数据库操作都会临时在新的主库上执行。一个新的从库将会立即替换旧的从库进行数据复制。在生产系统中,提升一个新的主数据库更为复杂,因为从库中的数据可能不是最新的,丢失的数据需要通过运行数据恢复脚本来更新。尽管一些其他的复制方法,如多主复制和循环复制,可能有所帮助,但他们的配置更加复杂;这些讨论将超出本书的讨论范围,有兴趣的读者可以参考列出的参考资料[4][5]。

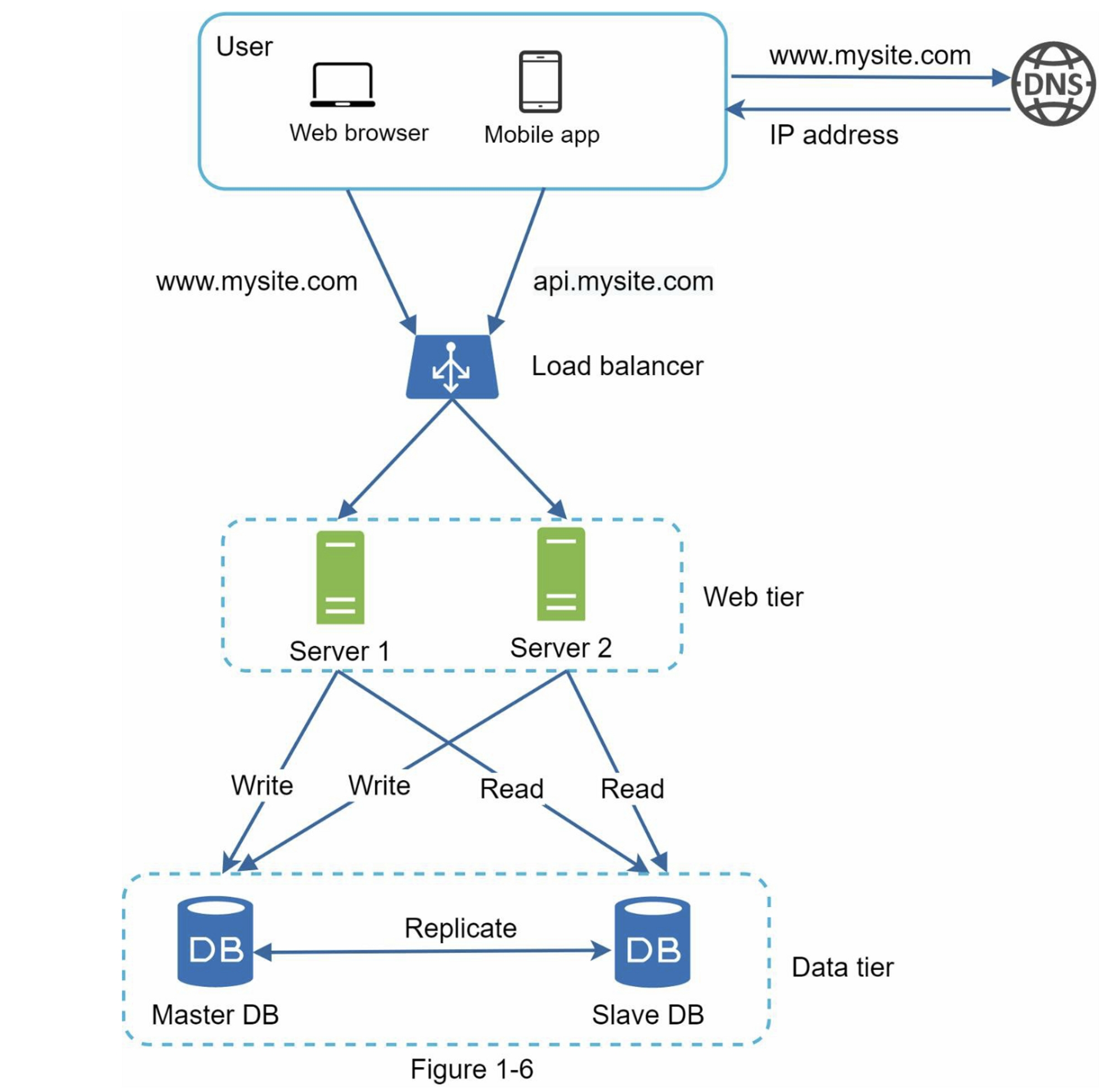

图1-6展示了在添加负载均衡器和数据库复制后的系统设计。

让我们来看一下这个设计:

- 用户从DNS获取负载均衡器的IP地址

- 用户使用这个IP地址连接到负载均衡器

- HTTP请求被路由到Server 1或Server 2。

- Web服务器从从数据库读取用户数据

- Web服务器将任何修改数据的操作路由到主数据库,这包括写入,更新和删除操作。

现在,你已经对web层和数据库层已经有了一个深刻的理解,是时候提升负载/响应时间了。这可以通过添加缓存层并将静态内容(JavaScript/CSS/图像/视频文件)移至内容分发网络(CDN)来完成。

缓存

缓存是一个临时存储区域,用于将昂贵的响应结果或频繁的访问数据存储在内存中,以便之后的请求能被更快的处理。如图1-6所示,每当加载新的网页时,会执行一个或多个数据库调用来获取数据。通过重复调用数据库,应用程序的性能会受到很大影响。缓存可以缓解这个问题。

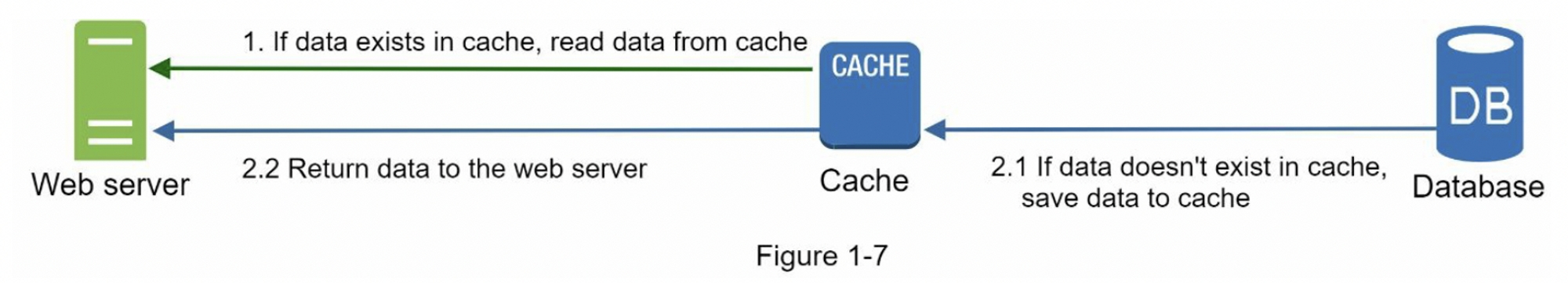

缓存层

缓存层是一个临时的数据存储层,比数据库更快。拥有独立的缓存层的好处包括更好的系统性能、减轻数据库负载的能力以及能够独立扩展缓存层。图1-7展示了一个可能的缓存服务器设置:

在接收到请求后,Web服务器首先检查缓存是否有可用的响应。如果有,它将数据发送回客户端。如果没有,它会查询数据库,保存响应结果到缓存中,并将其发送回客户端。这种缓存策略称为读取穿透缓存。根据数据类型、大小和访问模式,还有其他可用的缓存策略。之前的一项研究解释了不同缓存策略的工作原理[6]。

与缓存服务器的交互很简单,因为大多数缓存服务器提供了常见编程语言的API。以下代码显示了典型的Memcached API:

使用缓存的注意事项

这里有一些使用缓存系统的注意事项:

-

决定何时使用缓存:当数据频繁读取但不经常修改时,请考虑使用缓存。由于缓存数据存储在易失的内存中,所以缓存服务器不适合持久化数据。例如,如果缓存服务器重启了,内存中所有的数据都会丢失,因此,重要的数据应该保存在持久数据存储中。

-

过期策略:实施过期策略是个好习惯,一旦缓存数据过期,它就会从缓存中删除。当没有过期策略时,缓存数据将被永久的保存在内存中。建议不要将过期时间设置的太短,因为这会导致系统过于频繁地从数据库重新加载数据。于此同时,建议不要将过期时间设置的太长,因为数据可能会过时。

-

一致性:这涉及保持数据存储和缓存同步。一致性问题可能会发生,因为对数据存储和缓存的修改操作不在一个事务中。在跨多个区域扩展时,保持数据存储和缓存之间的一致性具有挑战性。有关更多信息,请参阅Facebook发布的“Scaling Memcache at Facebook”论文[7]。

-

减少故障:单个缓存服务器代表了潜在的单点故障(SPOF),在维基百科中定义如下:“单点故障(SPOF)是系统的一部分,如果它发生故障,将使整个系统停止工作。”[8]。因此,建议在不同数据中心使用多个缓存服务器,以避免单点故障(SPOF)。另一种推荐的方法是通过配置比所需的大小还多一定百分比的内存。这在内存使用量上升的时候起到一个缓冲的效果。

-

驱逐策略:一旦缓存满了,任何尝试向缓存中添加内容的请求都可能导致现有项被移除,这称为缓存驱逐。最近最少使用(LRU)是最流行的缓存驱逐策略。可以使用其他逐出策略,例如:最不常用(LFU)或先进先出(FIFO),以满足不同的使用场景。

CDN

CDN(内容分发网络)是一个由地理上分散的服务器组成的网络,用于提供静态内容。CDN服务器缓存静态内容,如:图片、视频、CSS、JavaScript文件等。

动态内容缓存是一个相对较新的概念,超出了本书的范围。它支持缓存基于请求路径、查询字符串、Cookie和请求头缓存HTML页面。有关更多信息,请参阅参考资料[9]中提到的文章,本书重点介绍如何使用CDN缓存静态内容。

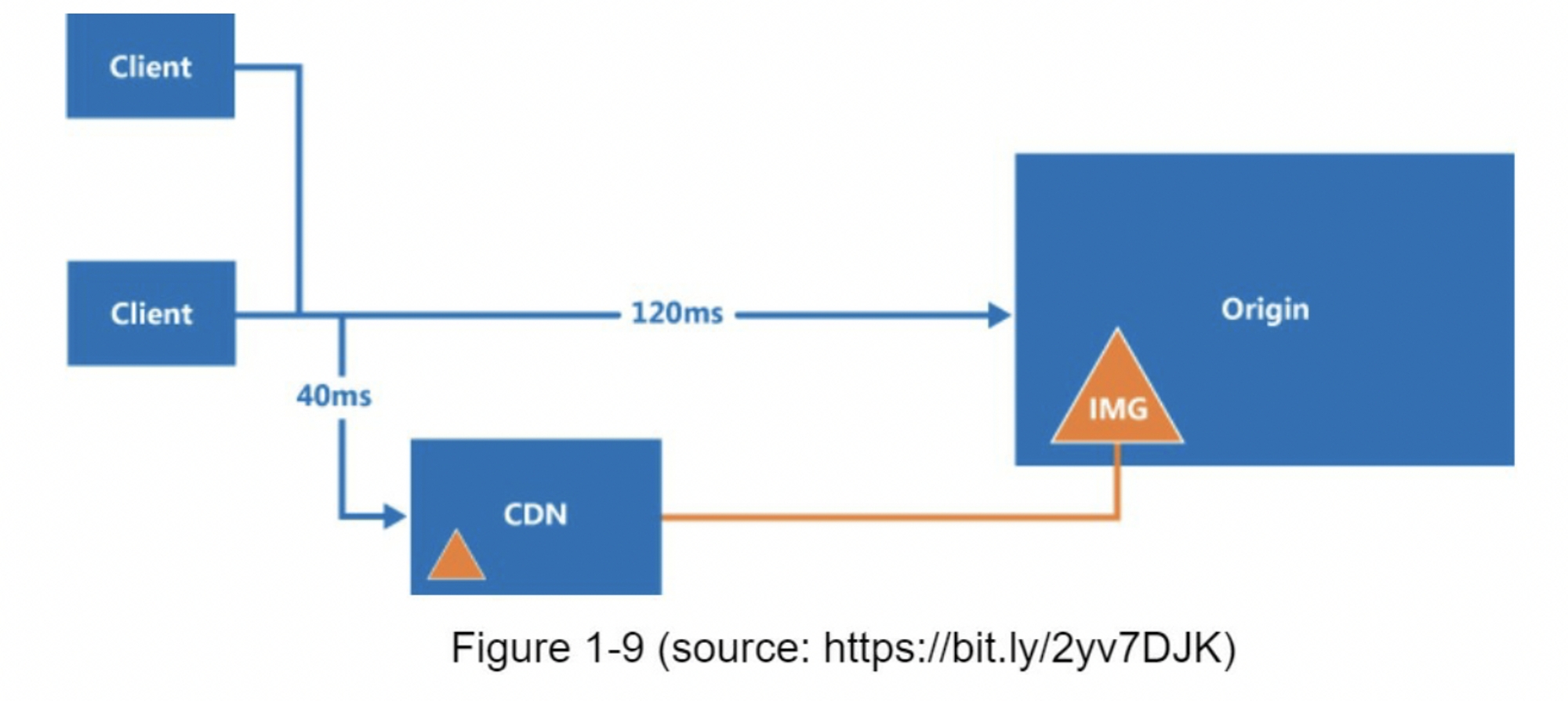

在高层次上,CDN的工作原理如下:当用户访问一个网站时,距离用户最近的CDN服务器将提供静态内容。直观的说,用户距离CDN服务器越远,网站加载速度就越慢。例如,如果CDN服务器位于旧金山,那么洛杉矶的用户将比欧洲的用户更快的获取内容。图1-9是一个很好的例子,展示了CDN如何缩减加载时间。

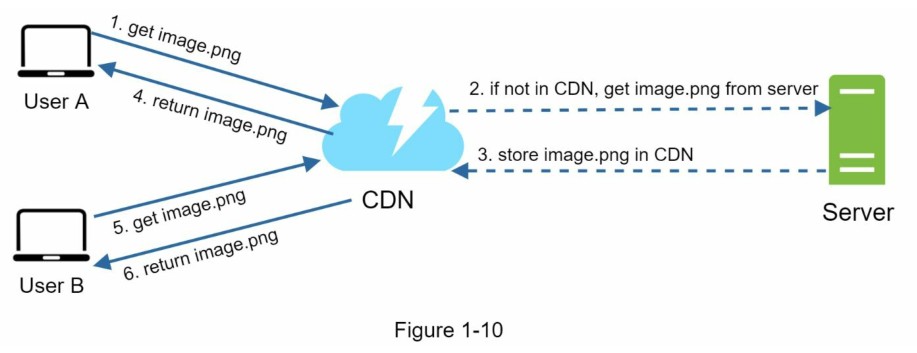

图1-10演示了CDN工作流程

- 用户A尝试通过图片URL获取image.png。这个URL的域名是由CDN提供商提供,以下两个图像URL是用于演示URL在Amazon和Akamai CDN上的示例:

- https://mysite.cloudfront.net/logo.jpg

- https://mysite.akamai.com/image-manager/img/logo.jpg

- 如果CDN服务器缓存中没有这个图片image.png,CDN服务器会从源(可以是Web服务器或在线存储,如Amazon S3)请求文件。

- 源返回image.png给CDN服务器,并包含可选的HTTP头部Time-to-Live(TTL),它表示图像被缓存的时间有多长。

- CDN缓存图像并将其返回给用户A。在TTL过期之前,图像一直被缓存在CDN中。

- 用户B发送一个请求获取相同的图片

- 只要TTL尚未过期,图像就会从缓存中返回。

使用CDN时需要考虑的因素

- 成本:CDN由第三方提供商运行,你需要为进出CDN的数据传输付费,对于很少使用的缓存资源,提供不了显著的好处,因此您应该考虑将它们移出CDN。

- 设置适当的缓存过期时间:对于时间敏感的内容,设置缓存过期时间是很重要的,缓存过期时间既不应该太长,也不应该太短。如果时间太长,内容可能不再新鲜,如果时间太短,可能导致反复从源服务器重新加载内容到CDN。

- CDN回源:你应该考虑你的网站/应用程序如何处理CDN故障,如果出现临时CDN中断,客户端应该能够检测问题并从源请求资源。

- 使文件无效:在缓存过期之前,您可以通过执行以下操作之一从CDN中删除文件:

- 通过CDN服务商提供的API使CDN对象失效

- 使用对象版本控制来提供不同版本的对象。对对象进行版本控制,可以向URL中添加参数例如版本号,例如:在查询字符串中添加版本号2:image.png?v=2。

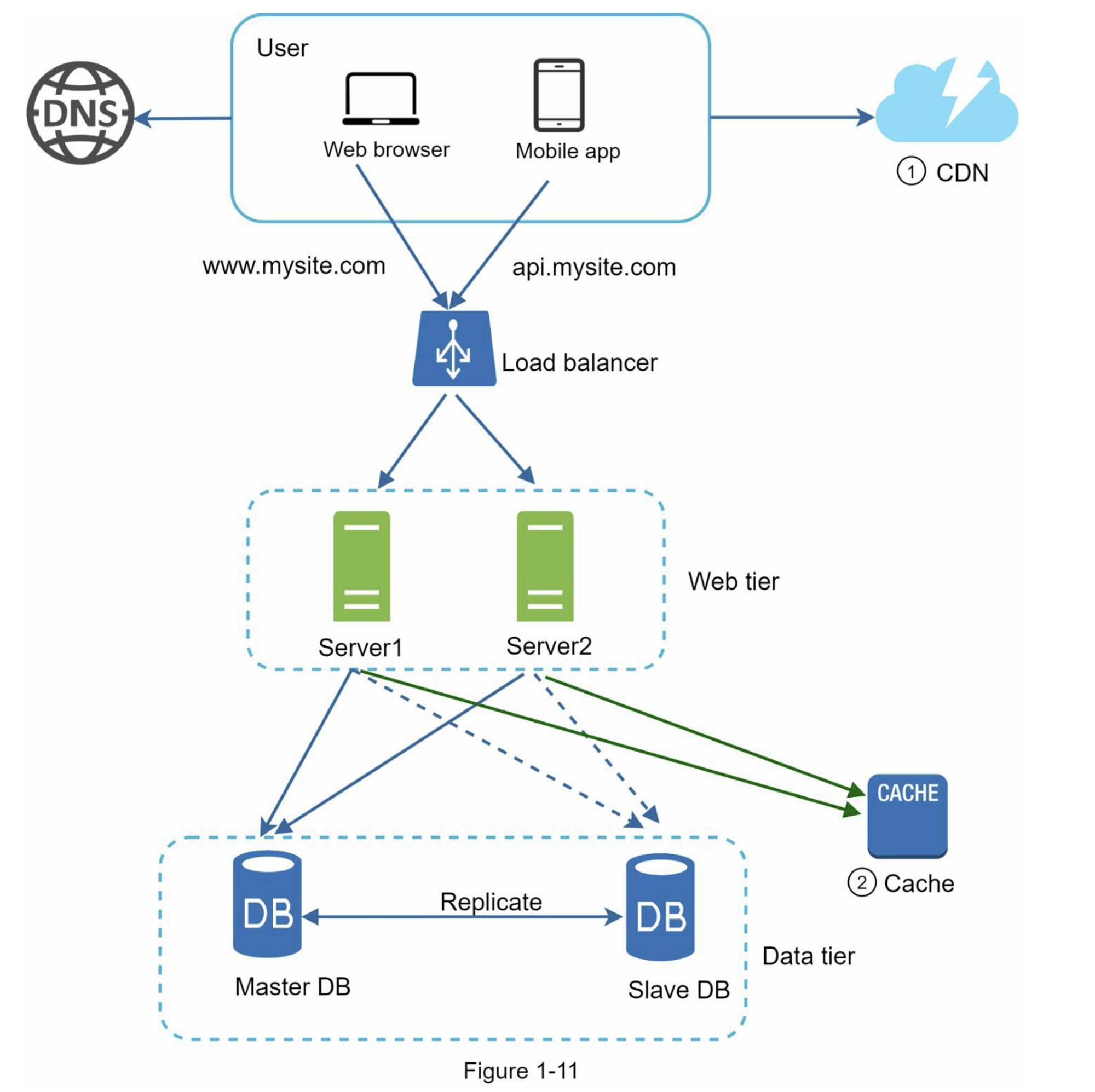

添加CDN和缓存后的设计如图1-11 所示

- Web服务器不再提供静态资产(JS、CSS、图像等),它们从CDN获取以获得更好的性能。

- 通过缓存数据,减轻了数据库的负载。

无状态的Web层

现在是时候考虑水平扩展Web层了,为此,我们需要将状态(例如用户会话数据)移出Web层。一个好的做法是将会话数据存储在持久性存储中,比如关系型数据库或NoSQL。集群中的每个Web服务器都可以从数据库中访问状态数据,这被称为无状态的Web层。

有状态架构

有状态服务和无状态服务有一些关键区别。有状态服务器会在一个请求到下一个请求时记住客户端数据(状态)。无状态服务不会保留任何状态信息。

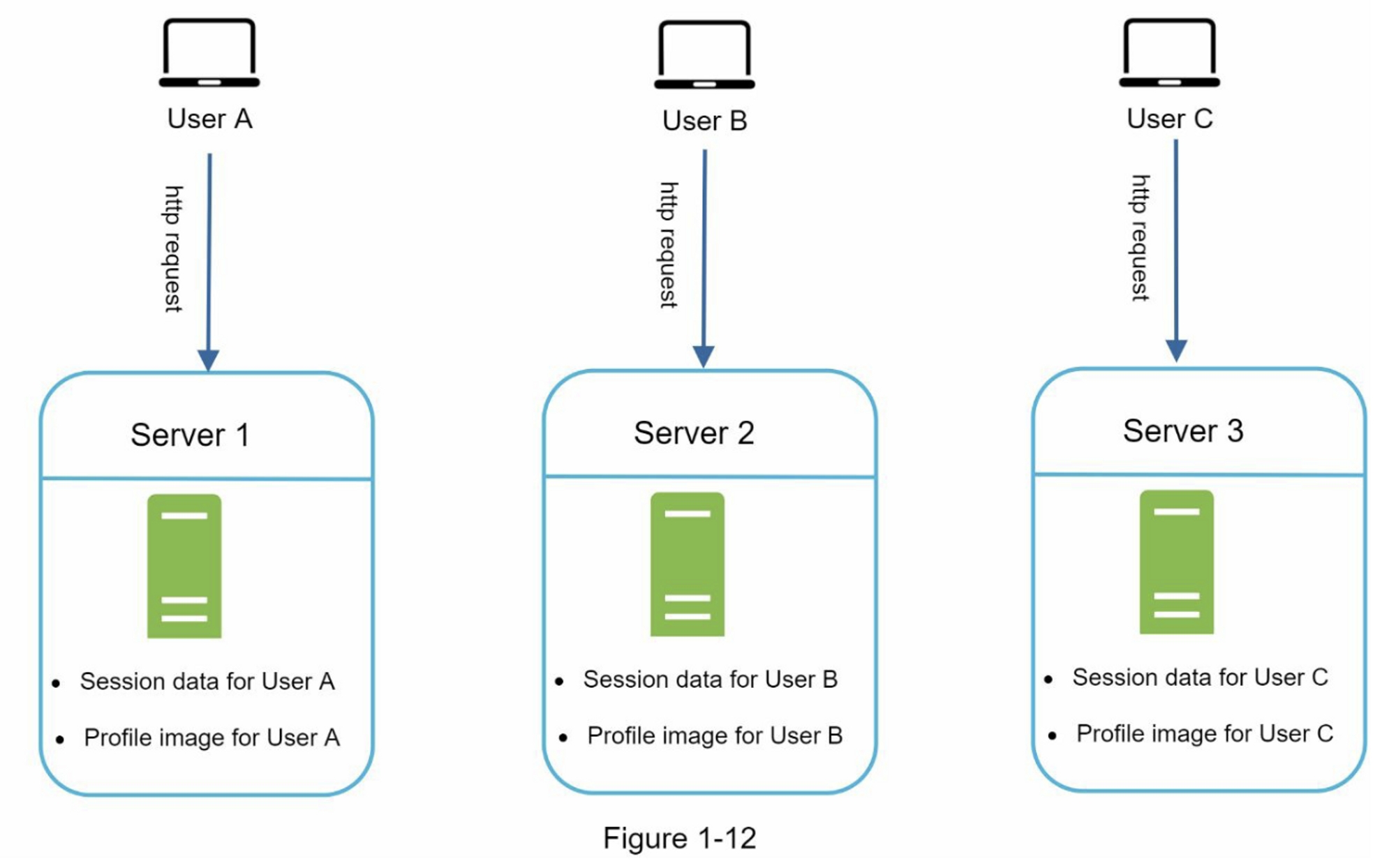

图1-12展示了一个有状态架构的示例。

在图1-12 中,用户A的会话数据和头像数据存储在Server 1中,要对用户A进行身份验证,必须将HTTP请求路由到Server 1,如果将请求发送到其他服务器,比如Server 2,身份验证将失败,因为Server 2不包含用户A的会话数据。同样,用户B的所有Http请求都必须路由到Server 2,所有来自用户C的请求必须发送到Server 3。

问题在于,来自同一客户端的每个请求必须路由到同一台服务器。在大多数负载均衡器中,可以使用粘性会话(sticky sessions)来实现这一点[10];然而,这会增加开销,使用这种方法更难添加或删除服务器,处理服务器故障也是一个挑战。

无状态的架构

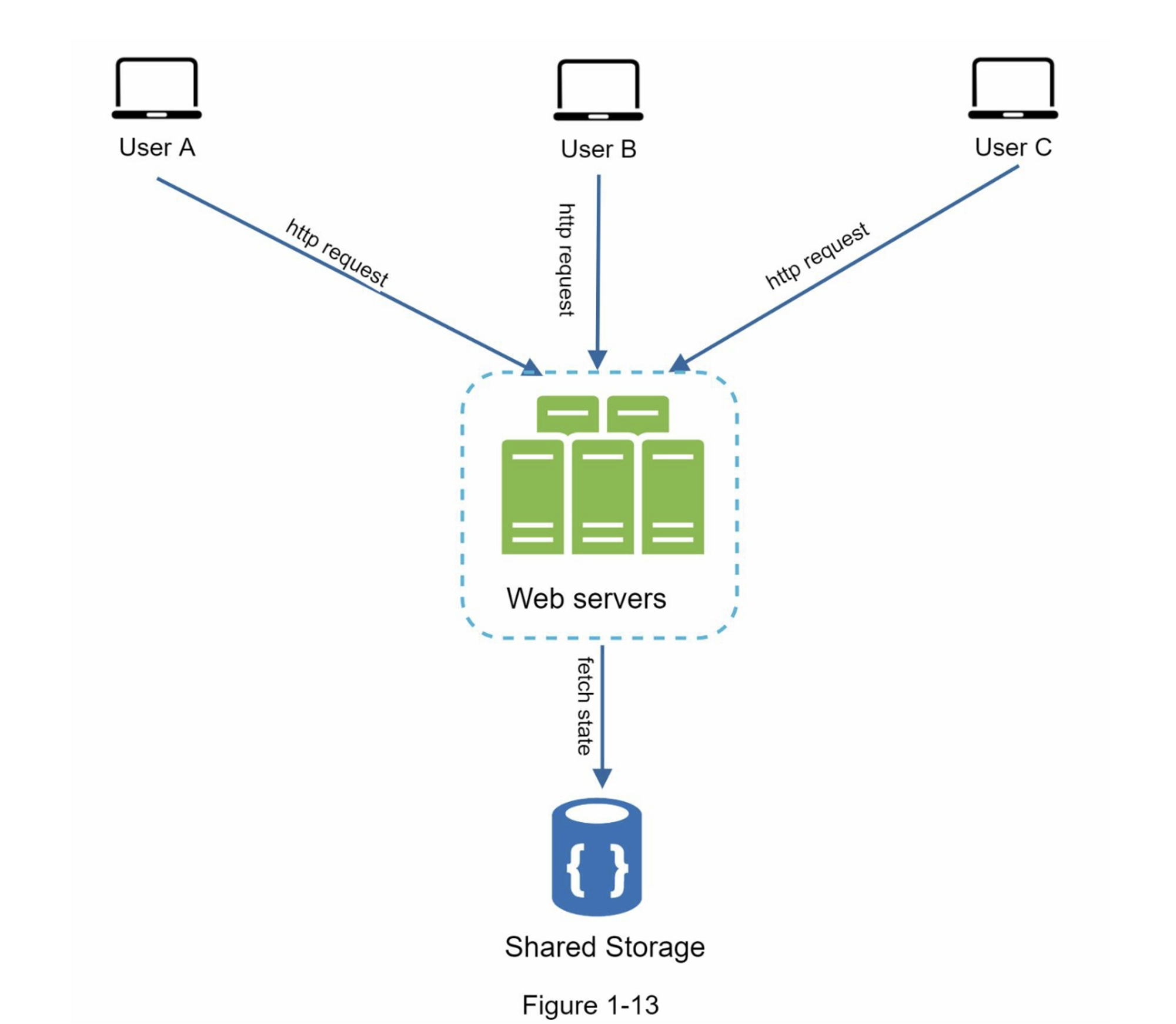

无状态架构如图1-13所示

在这个无状态架构中,来自用户的HTTP请求可以被发送到任何Web服务器,并从共享的数据存储中获取状态数据。状态数据存储在共享的数据存储中,并且不存储在Web服务器中,一个无状态的系统更简单、更健壮且可扩展。

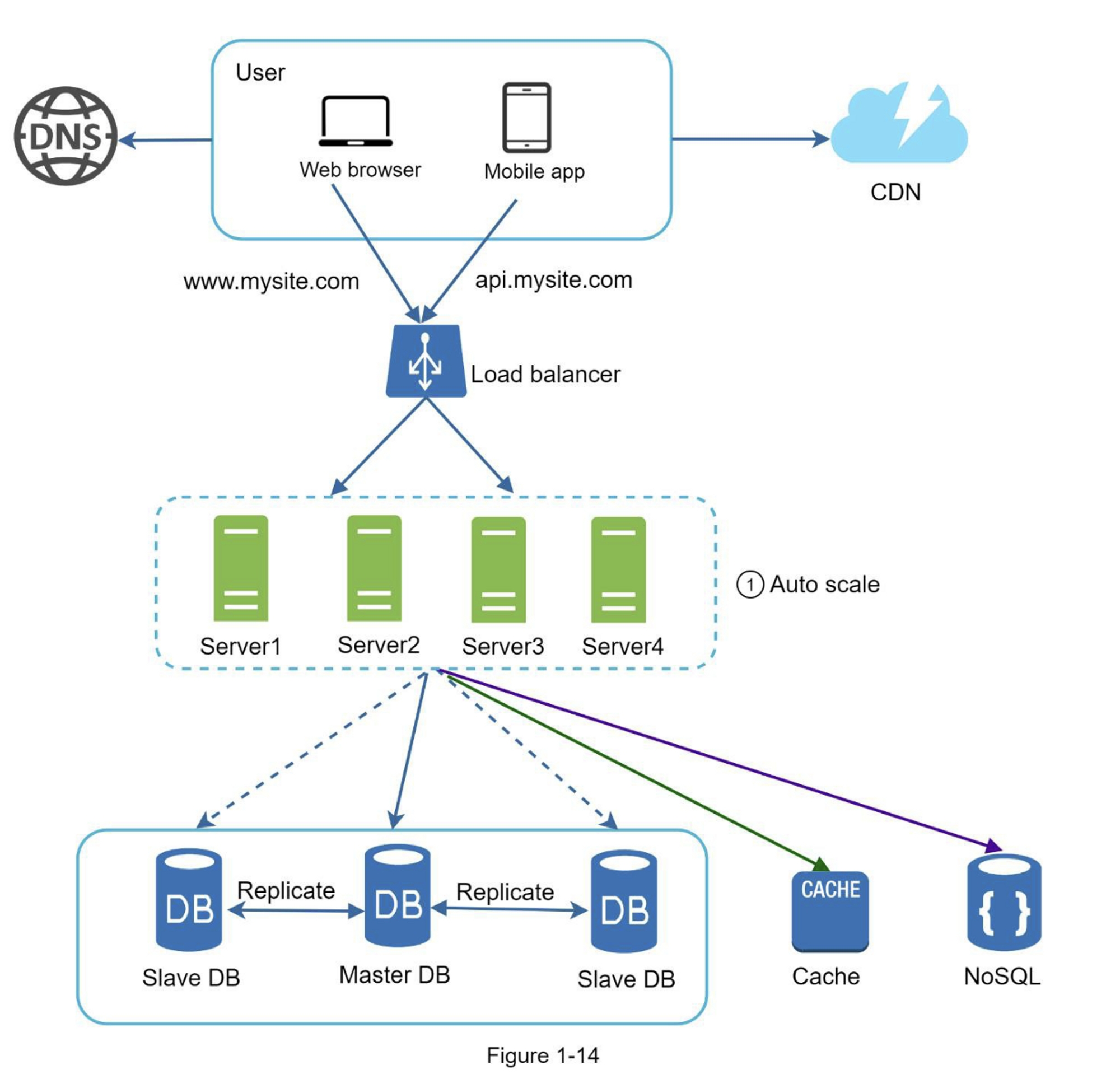

图1-14展示了带有无状态Web层的更新设计

在图1-14中,我们将会话数据从Web层移出,并将其存储在持久数据存储中。共享的数据存储可以是关系型数据库,Memcached/Redis, NoSQL等。选择NoSQL数据存储是因为它易于扩展。自动扩展意味着根据流量负载自动添加或删除Web服务器。在将状态数据移出Web服务器后,可以根据流量负载添加或删除服务器,从而轻松实现Web层的自动扩展。

你的网站发展迅速,并吸引了大量国际用户,为了提高可用性并在更广泛的地理区域提供更好的用户体验,支持多个数据中心至关重要。

数据中心

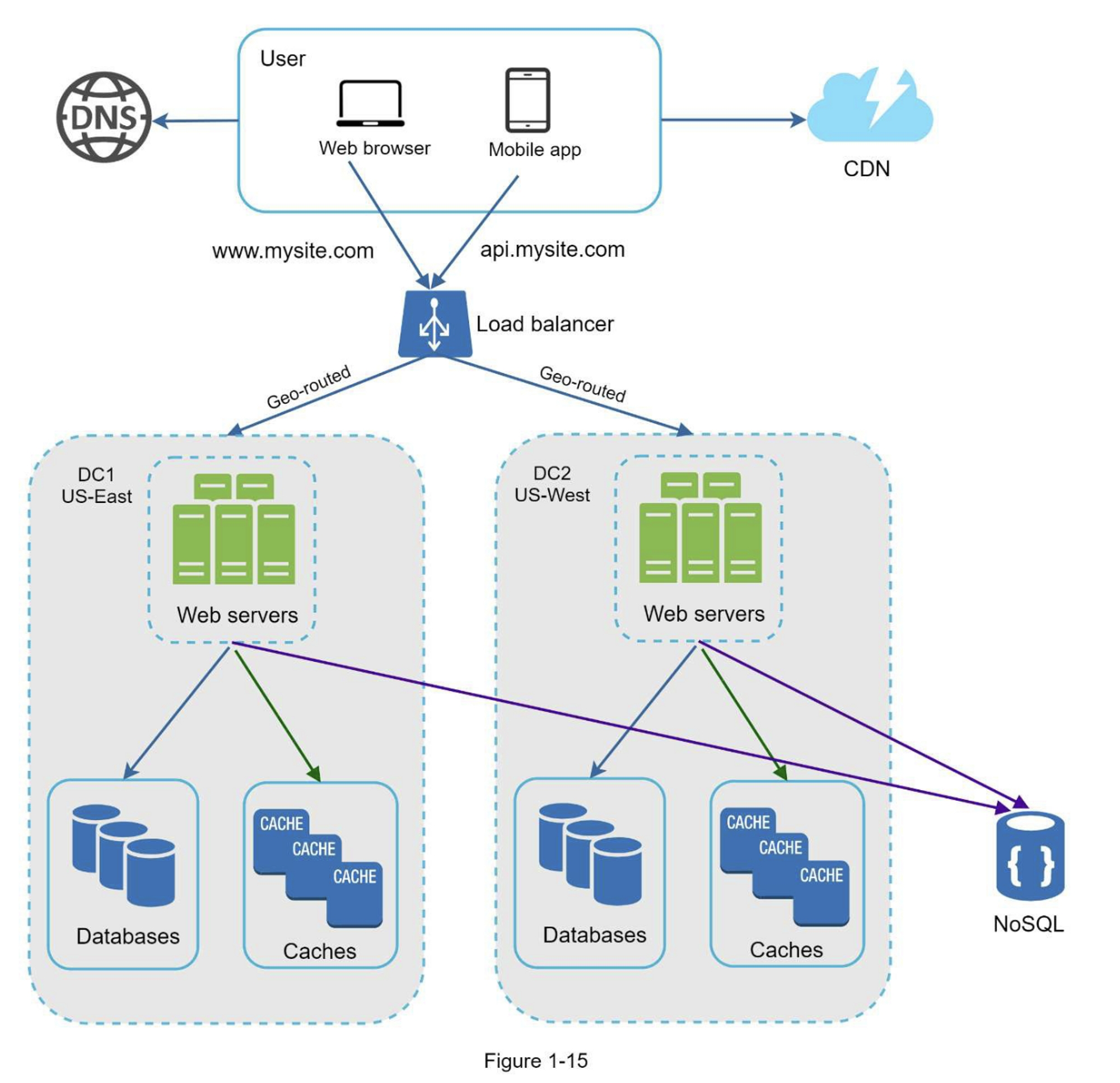

图1-15显示了具有两个数据中心的示例设置。在正常运行时,用户通过geoDNS路由(也称为地理路由)到最近的数据中心,美国东部的流量为x%,美国西部的流量为(100-x)%。geoDNS是一种DNS服务,允许根据用户的位置将域名解析为IP地址。

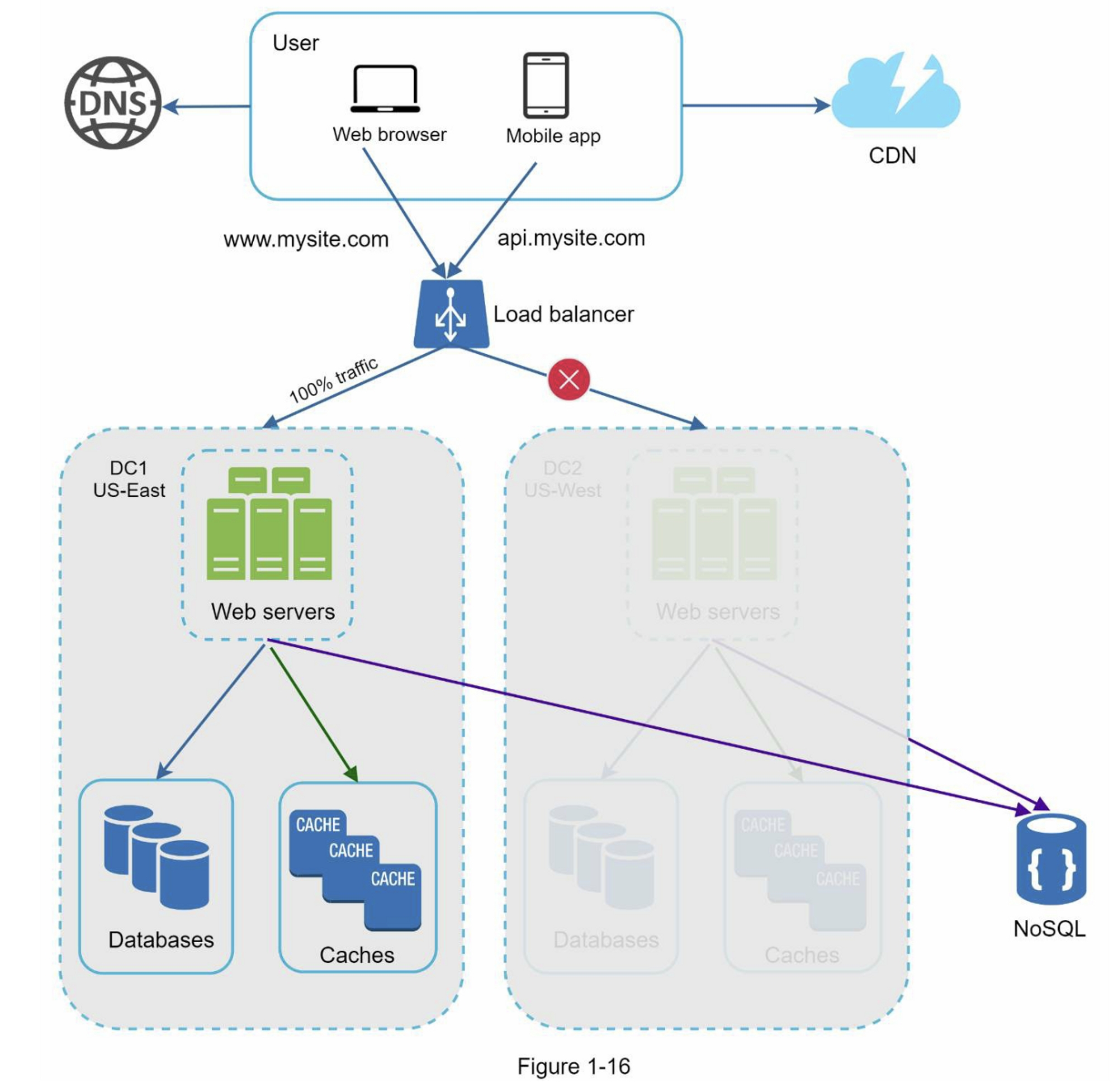

在发生任何重大数据中心中断的情况下,我们将所有流量引导到一个健康的数据中心。图1-16中,数据中心2(美西)处于离线状态,100%的流量路由到数据中心1(美东)

要实现多数据中心配置,必须要解决几个技术难题:

- 流量重定向:需要有效的工具将流量重定向到正确的数据中心。geoDNS可以根据用户位置将流量引导至用户最近的数据中心。

- 数据同步:来自不同地区的用户可以使用不同的本地数据库或缓存,在故障转移的情况下,流量可能被路由到不可用的数据中心。一种常见的策略是跨多个数据中心复制数据。之前的研究展示了Netflix如何实现异步多数据中心复制[11]

- 测试和部署:对于多数据中心设置,在不同位置测试网站/应用程序非常重要,自动化部署工具对于保持所有数据中心的服务一致性至关重要 [11]。

为了更进一步扩展我们的系统,我们需要解耦系统的不同组件,使它们可以独立扩展。消息队列是许多实际分布式系统采用的关键策略,用于解决这个问题。

消息队列

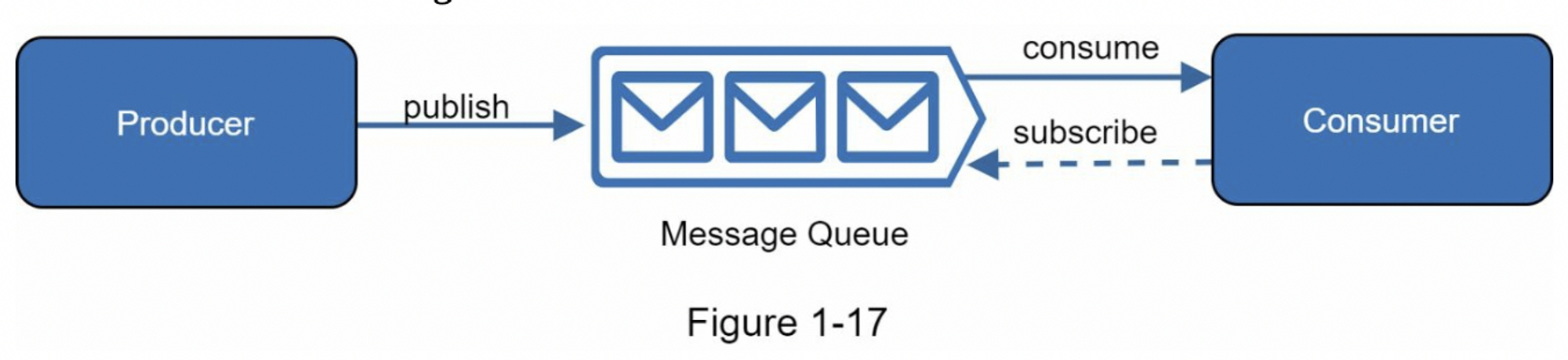

消息队列是一个持久性组件,存储在内存中,支持异步通信,它充当缓冲区并分发异步请求。消息队列的基础架构非常简单,输入服务,被称为生产者/发布者,创建消息,并将它们发送到消息队列中。其他服务或服务器,称为消费者/订阅者,连接到队列,并执行消息定义的动作。

模型如图1-17所示

解耦使消息队列成为构建可伸缩且可靠的应用程序的首选架构。使用消息队列,生产者可以在消费者无法处理消息时将消息发布到队列中。即使生产者不可用,消费者也可以从队列中获取数据。

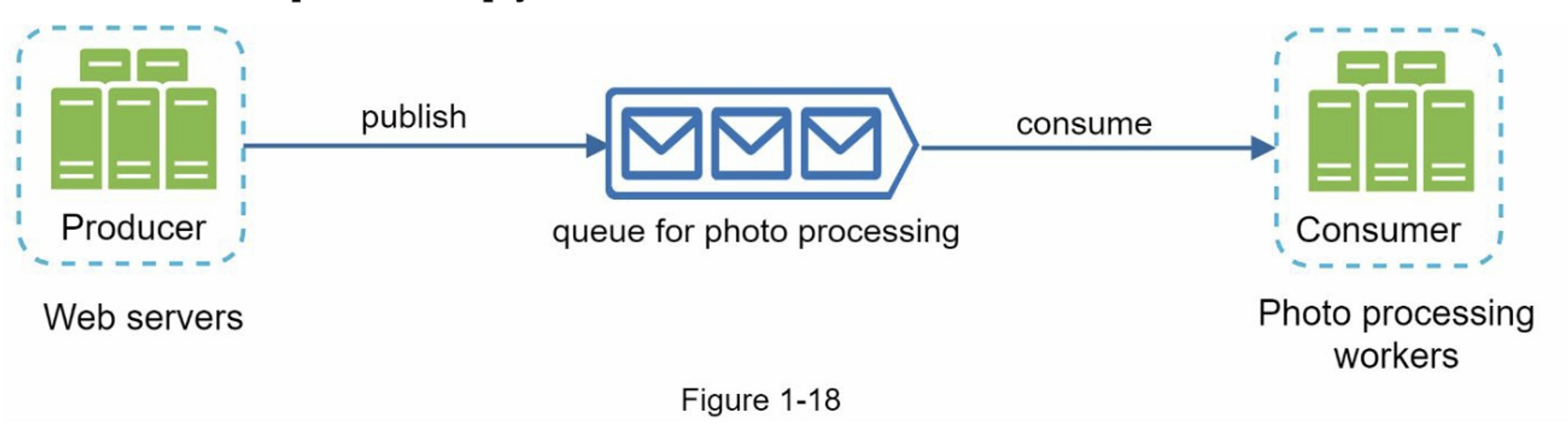

考虑下面的用例:你的应用程序支持照片自定义,包括剪裁、锐化、模糊等。这些定制任务需要一些时间才能完成。在图1-18中,Web服务器将照片处理作业发布到消息队列。照片处理工作者从消息队列中获取作业并异步执行照片定制任务。生产者和消费者可以独立扩展,当队列的大小变得很大时,添加更多的工作者以减少处理时间。但是,如果队列大部分时间为空,则可以减少工作者的数量。

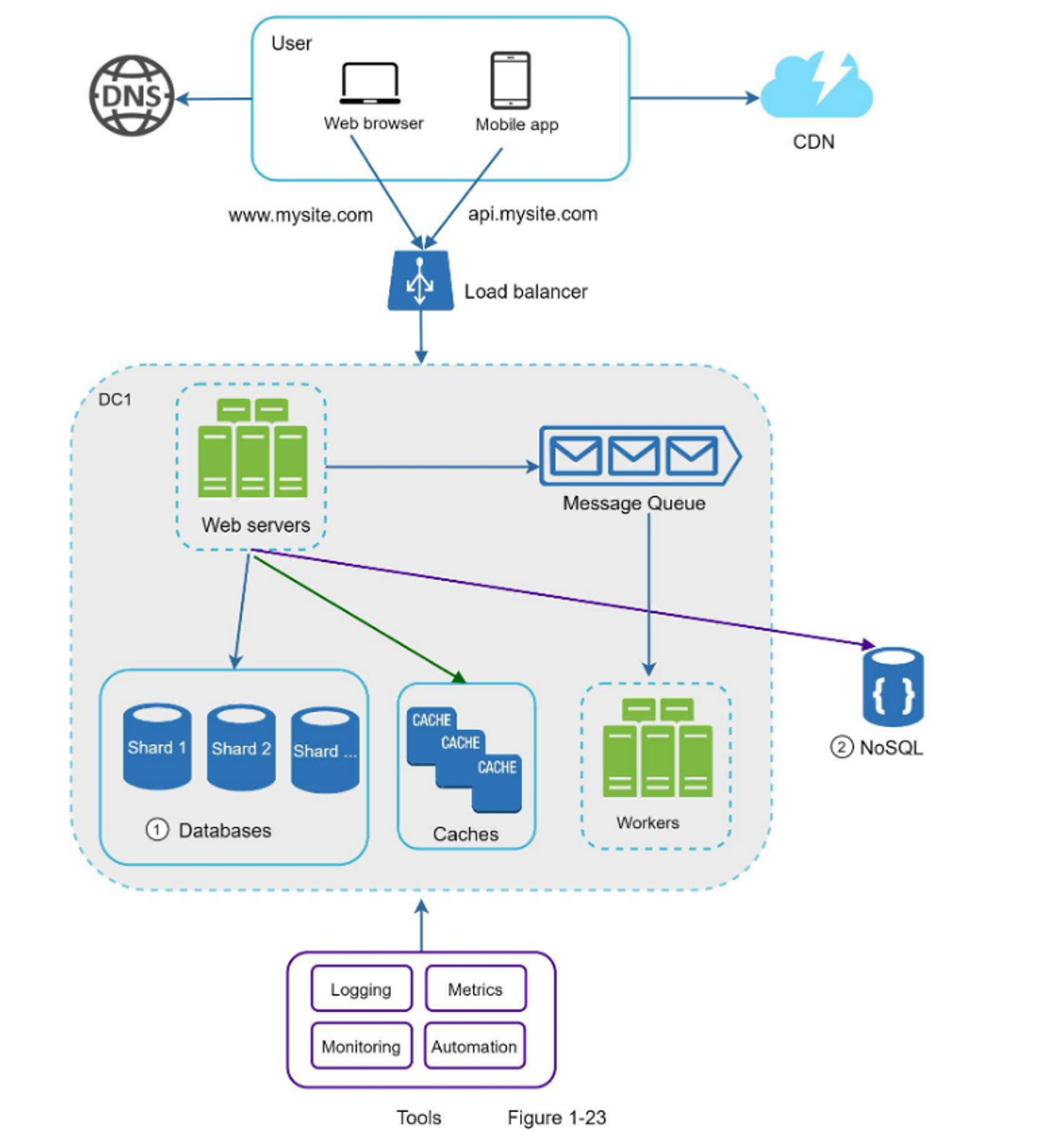

日志记录、指标、自动化

当处理运行在少量服务器上的小型网站时,日志记录、指标、和自动化支持是很好的选择,但并不是必须的。但是,现在你的网站已经发展成为一个大型业务,那么投资这些工具是必不可少的。

日志记录:监控错误日志是重要的,因为它有助于识别系统中的错误和问题。您可以在每个服务器级别监视错误日志,或使用工具将它们汇总到一个集中的服务中,以便于搜索和查看。

指标:收集不同类型的指标有助于我们获得业务洞察能力和了解系统的健康状态。以下一些指标是有用的:

- 主机级别的指标:CPU、内存、磁盘I/O等

- 聚合级别的指标:例如,整个数据库层、缓存层的性能

- 关键业务指标:每日活跃用户、留存数、收入等

自动化:当系统变得庞大而复杂时,我们需要构建或利用自动化工具来提高生产力。持续集成是一种很好的做法,其中每次代码提交都通过自动化进行验证,使团队能够及时发现问题。此外,将你的构建、测试、部署过程等自动化,可以显著提高开发人员的生产力。

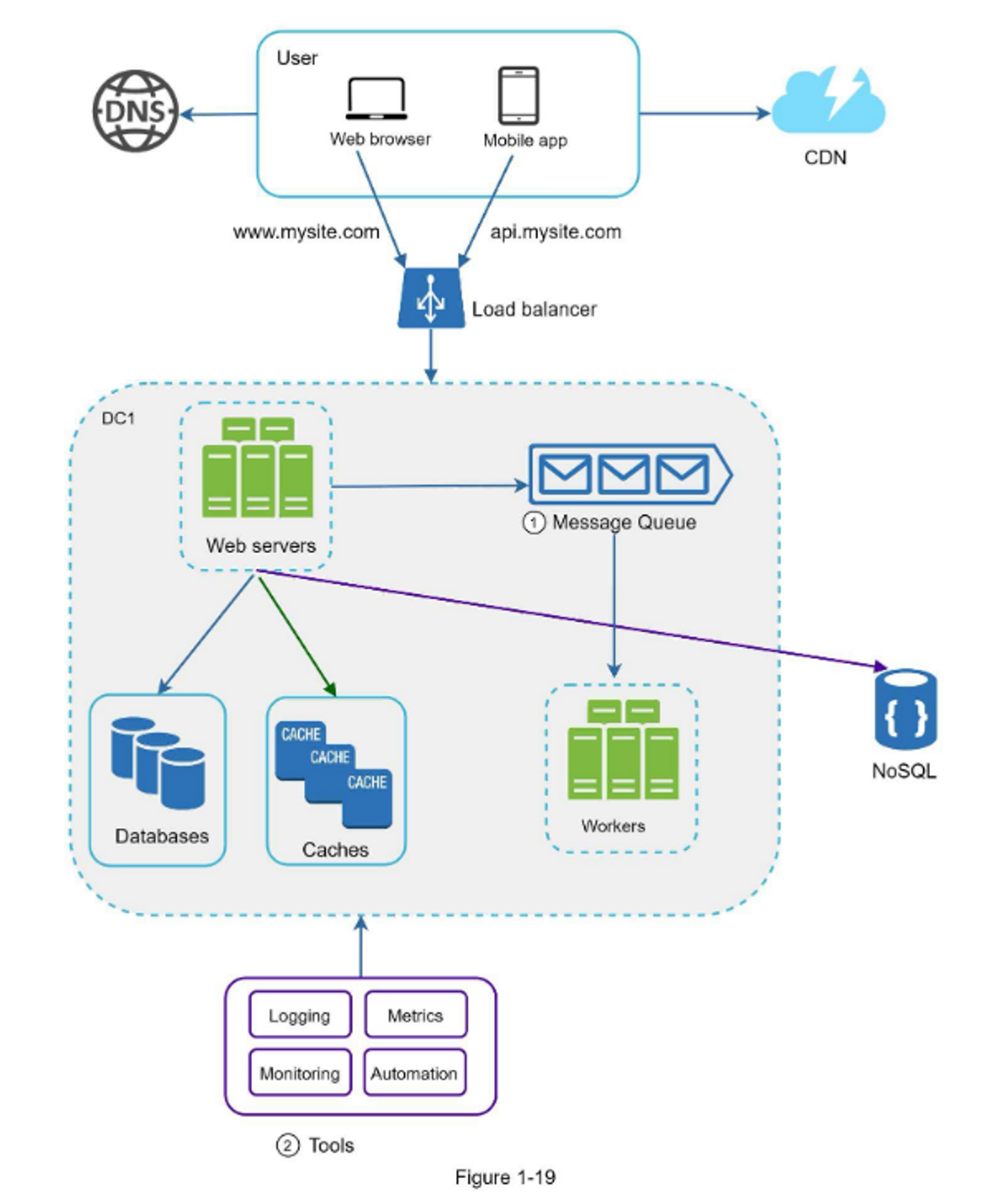

添加消息队列和不同的工具

图1-19展示了更新后的设计,限于篇幅有限,图中仅显示了一个数据中心。

- 该设计包含一个消息队列,有助于使系统更松耦合和故障恢复能力。

- 日志记录、监控、指标、自动化工具也包括其中。

随着数据每天的增长,你的数据库负载越来越重,是时候扩展数据层了。

数据库扩展

这里有两种广泛的数据库扩展方法:垂直扩展和水平扩展

垂直扩展

垂直扩展,也被称为向上扩展,是通过向现有机器添加更多资源(如CPU、内存、磁盘等)来进行扩展的。

有一些强大的数据库服务器。根据亚马逊关系数据库服务(RDS)[12],你可以得到一个 24TB 内存的数据库服务器。这种强大的数据库服务器可以存储和处理大量的数据。例如,stackoverflow.com在2013年有超过1000万的每月独立访客,但它只有1个主数据库[13]。

然而,垂直扩展也有一些严重的缺点:

- 你可以向你的服务器中添加更多的CPU、内存等,但是是有硬件限制的。如果你有一个庞大的用户群,一台服务是不够的。

- 单点故障的风险更大

- 垂直扩展的总体成本更高,强大的服务器要贵得多。

水平扩展

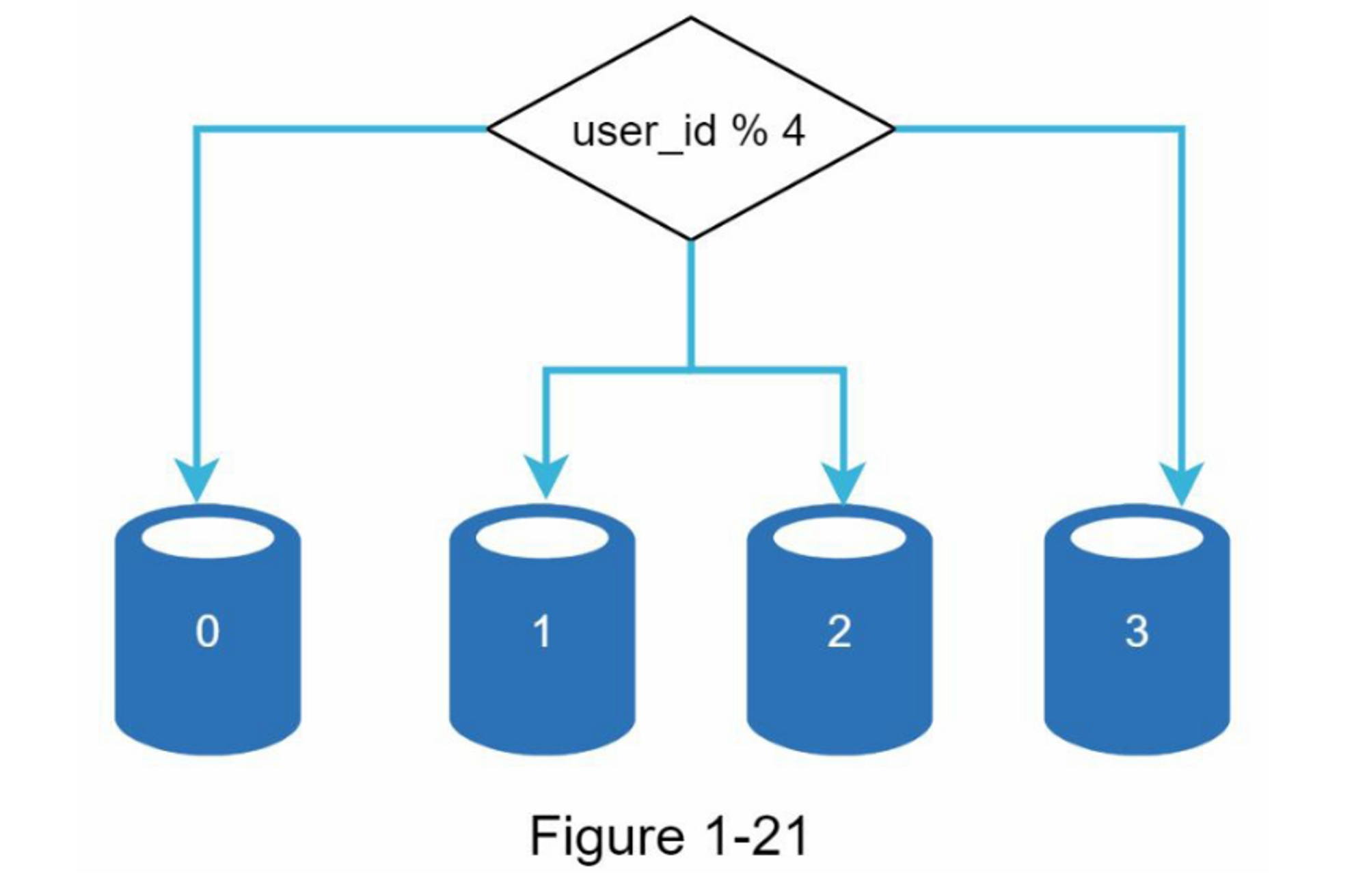

水平扩展,也称为分片,是添加更多服务器的做法。图1-20比较了垂直扩展和水平扩展。

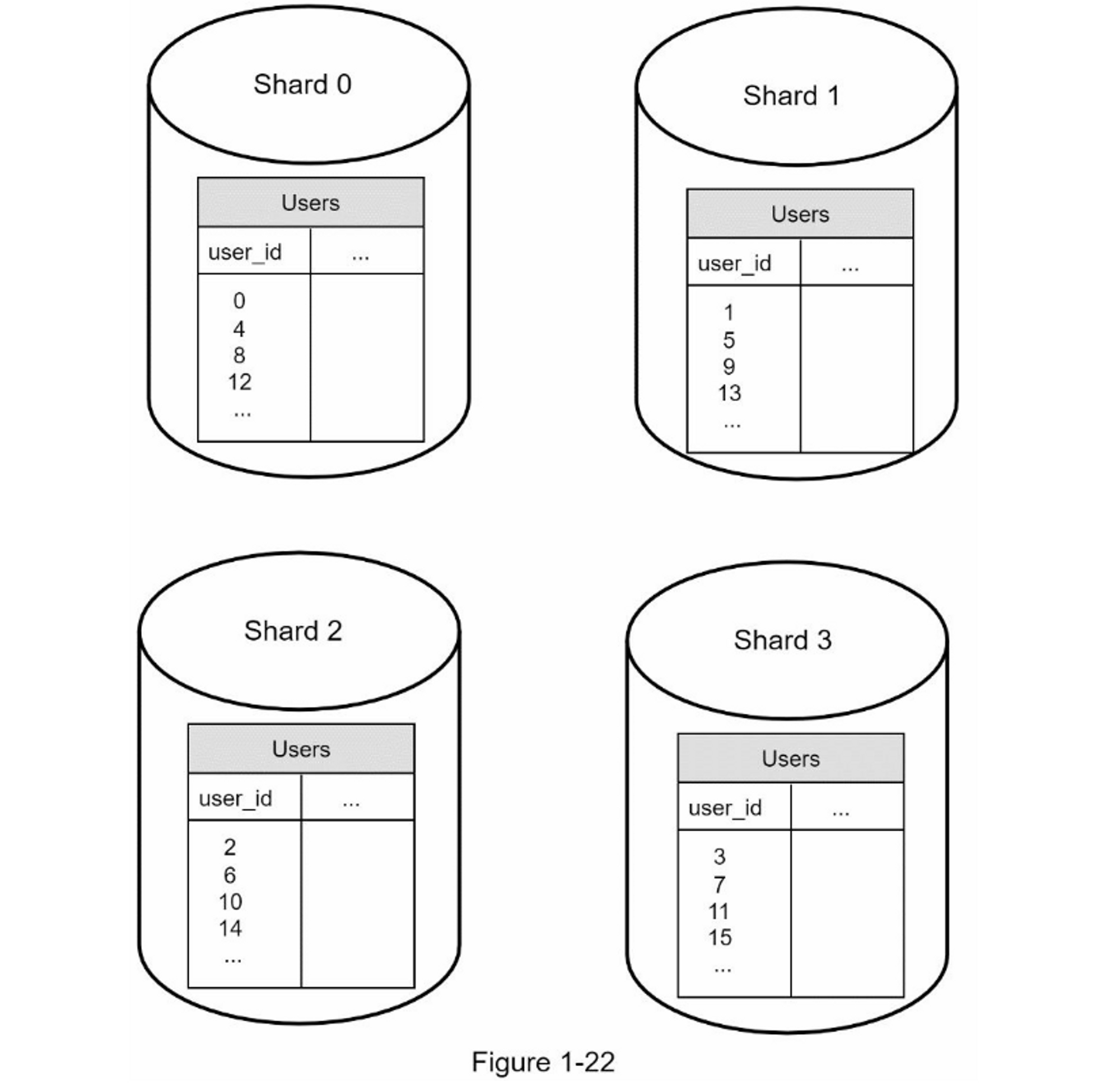

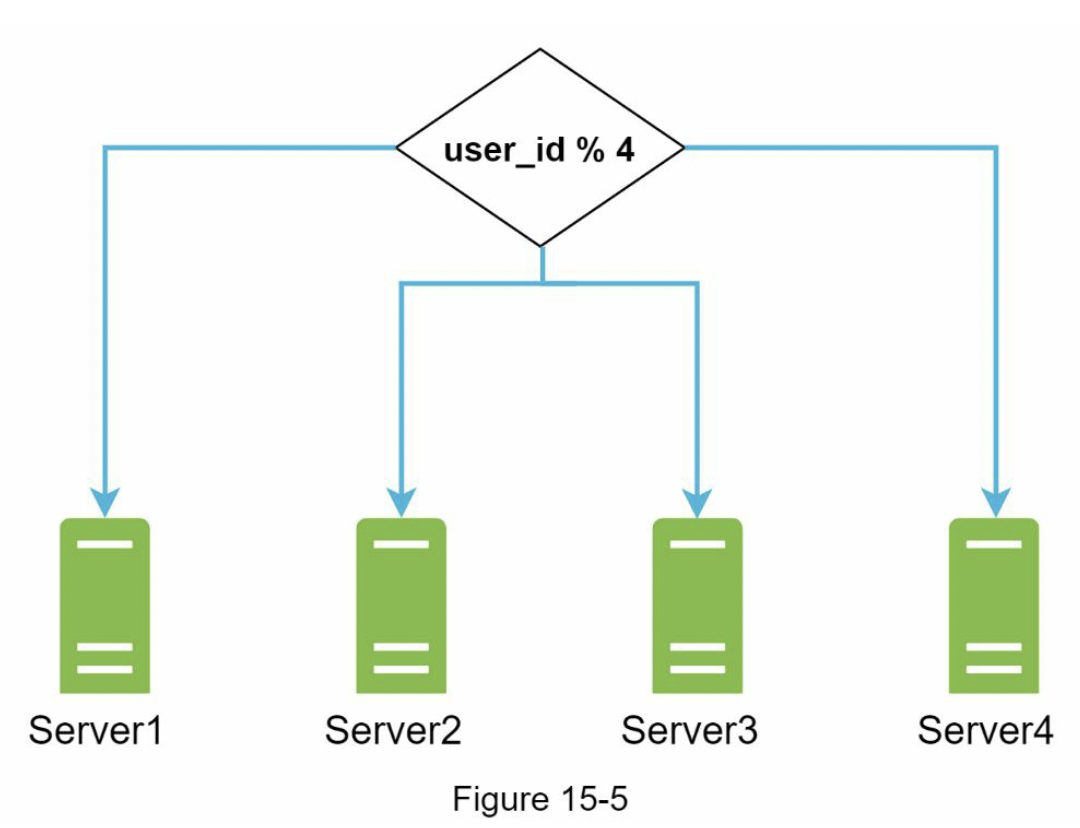

分片将大型数据库分成更小、更易于管理的部分,称为分片。每个分片共享相同的模式,尽管每个分片上的实际数据对该分片来说是独一无二的。

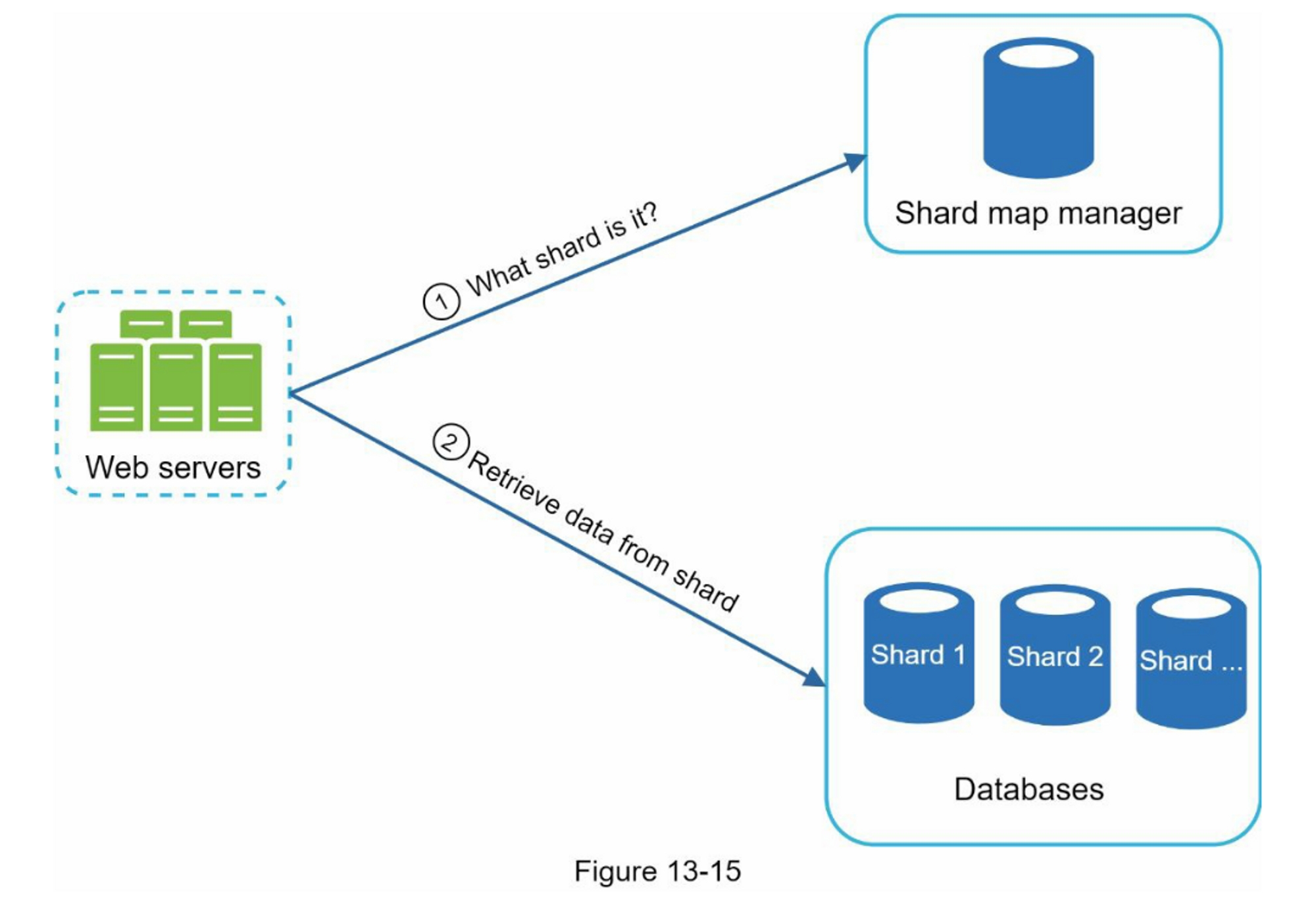

图1-21展示了一个分片数据库的示例。用户数据根据用户ID分配到数据库服务器。每次访问数据时,都会使用哈希函数来找到相应的分片。在我们的示例中,user_id % 4 被用作hash函数。如果结果为0,则使用分片0来存储和提取数据。如果结果为1,则使用分片1。其他分片采用相同的逻辑。

图1-22 显示了在分片数据库中的用户表

分片键的选择是实施分片策略时要考虑的重要因素。分片键(也称为分区键)由一个或多个列组成,决定数据的分布方式。如图1-22所示,“user_id”是分片键,分片键允许你将数据库查询路由到正确的数据库来高效地检索和修改数据。在选择分片键时,最重要的一个指标是选择一个可以均匀分布数据的键。

分片是扩展数据库的一项伟大技术,但它远不是一个完美的解决方案。它为系统引入了复杂性和新的挑战:

- 重新分片数据:在以下情况,需要从新分片数据。

- 由于快速增长,单个分片无法再容纳更多数据

- 由于数据分布不均匀,某些分片可能比其他分片更快被耗尽,当分片耗尽时,需要更新分片功能并移动数据。一致性哈希,将在第5章中讨论,是解决此问题的常用技术。

- 名人问题:这也被称为热点键问题。对一个特定分片的过度访问可能会导致服务器过载。想象一下 Katy Perry、Justin Bieber 和 Lady Gaga 的数据最终都在同一个分片上,对于社交应用来说,这个分片将会被读操作淹没。为了解决这个问题,我们可能需要为每一个名人分配一个分片,每个分片甚至可能需要进一步分区。

- 连接和去范式化:一旦数据库跨多个服务分片,就很难跨数据库分片执行连接操作。常见的解决方法是对数据库进行去范式化,以便可以在单个表中执行查询。

在图1-23中,我们对数据库进行分片,以支持快速增长的数据流量。同时,一些非关系型功能被移动到NoSQL数据存储中,以减轻数据库负载。这里有一篇文章介绍了很多NoSQL的使用案例[14]。

百万用户及以上

扩展系统是一个持续迭代的过程。重复我们在本章中学到的知识可以使我们走的更远。为了超越百万用户,需要更多的微调和新的策略。例如,你可能需要优化你的系统,将系统解耦为更小的服务。本章所学的知识为应对新的挑战提供了一个良好的应对基础。在本章最后,我们提供了一个关于我们如何扩展我们系统以支持数百万用户的总结:

- 保持Web层无状态

- 在每一层建立冗余

- 尽可能缓存数据

- 支持多个数据中心

- 在CDN中托管静态数据

- 通过分片扩展数据层

- 将层拆分为单独的服务

- 监控你的系统并使用自动化工具

祝贺您走到这一步!现在给自己一个鼓励,干得漂亮!

参考资料

[1] Hypertext Transfer Protocol: https://en.wikipedia.org/wiki/Hypertext_Transfer_Protocol

[2] Should you go Beyond Relational Databases?: https://blog.teamtreehouse.com/should-you-go-beyond-relational-databases

[3] Replication: https://en.wikipedia.org/wiki/Replication_(computing)

[4] Multi-master replication: https://en.wikipedia.org/wiki/Multi-master_replication

[5] NDB Cluster Replication: Multi-Master and Circular Replication: https://dev.mysql.com/doc/refman/5.7/en/mysql-cluster-replication-multi-master.html

[6] Caching Strategies and How to Choose the Right One: https://codeahoy.com/2017/08/11/caching-strategies-and-how-to-choose-the-right-one/

[7] R. Nishtala, "Facebook, Scaling Memcache at," 10th USENIX Symposium on Networked Systems Design and Implementation (NSDI ’13).

[8] Single point of failure: https://en.wikipedia.org/wiki/Single_point_of_failure

[9] Amazon CloudFront Dynamic Content Delivery: https://aws.amazon.com/cloudfront/dynamic-content/

[10] Configure Sticky Sessions for Your Classic Load Balancer: https://docs.aws.amazon.com/elasticloadbalancing/latest/classic/elb-sticky-sessions.html

[11] Active-Active for Multi-Regional Resiliency: https://netflixtechblog.com/active-active-for-multi-regional-resiliency-c47719f6685b

[12] Amazon EC2 High Memory Instances: https://aws.amazon.com/ec2/instance-types/high-memory/

[13] What it takes to run Stack Overflow: http://nickcraver.com/blog/2013/11/22/what-it-takes-to-run-stack-overflow

[14] What The Heck Are You Actually Using NoSQL For: http://highscalability.com/blog/2010/12/6/what-the-heck-are-you-actually-using-nosql-for

第02章:粗略估算

在系统设计面试中,有时会要求你使用粗略估算来估计系统的容量或性能需求。根据谷歌高级研究员杰夫·迪恩(Jeff Dean)的说法,“粗略估算是使用一系列思维实验和常见性能数据的组合进行估算,以便对哪种设计能够满足你的要求有一个良好的了解” [1]。

要有效地进行粗略估算,你需要对可扩展性基础知识有很好的了解。以下概念应该被深入理解:二的幂 [2]、每个程序员都应该知道的延迟数字和可用性数字。

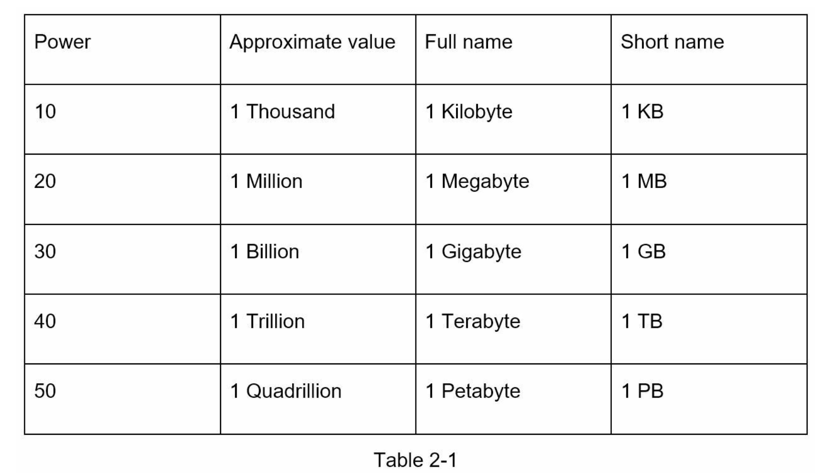

2的幂次方

尽管在处理分布式系统时数据量可能变得非常庞大,但所有计算归结为基础知识。为了获得正确的计算结果,了解使用二的幂的数据量单位至关重要。一个字节是8个位的序列。一个 ASCII 字符使用一个字节的内存(8位)。下面是解释数据量单位的表格(表2-1)。

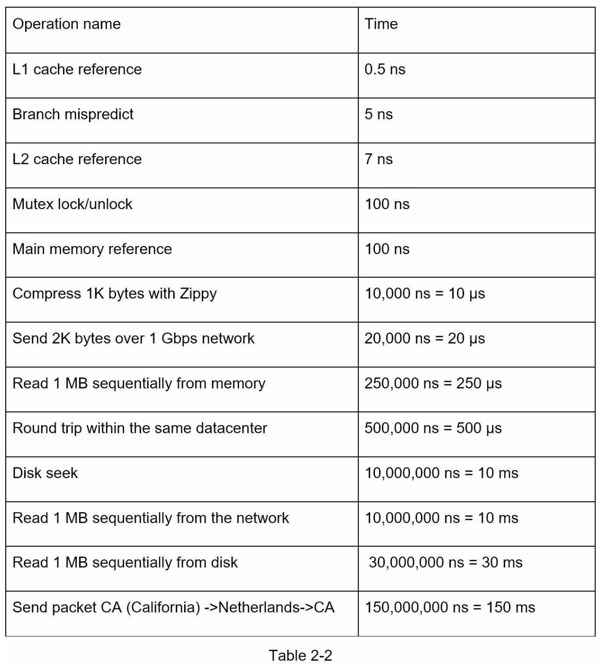

每个程序员都应该了解的延迟数据

Google的Dean博士在2010年透露了典型计算机操作的时间[1]。 随着计算机变得更快更强大,一些数字已经过时。然而,这些数字仍然应该能够让我们了解不同计算机操作的速度和慢速。

注意事项

ns = 纳秒, μs = 微秒, ms = 毫秒

$$1 \space ns = 10^{-9} \space 秒$$

$$1 \space \mu s= 10^{-6} \space 秒 = 1,000 \space ns$$

$$1 \space ms = 10^{-3} \space 秒 = 1,000 \space \mu s = 1,000,000 \space ns$$

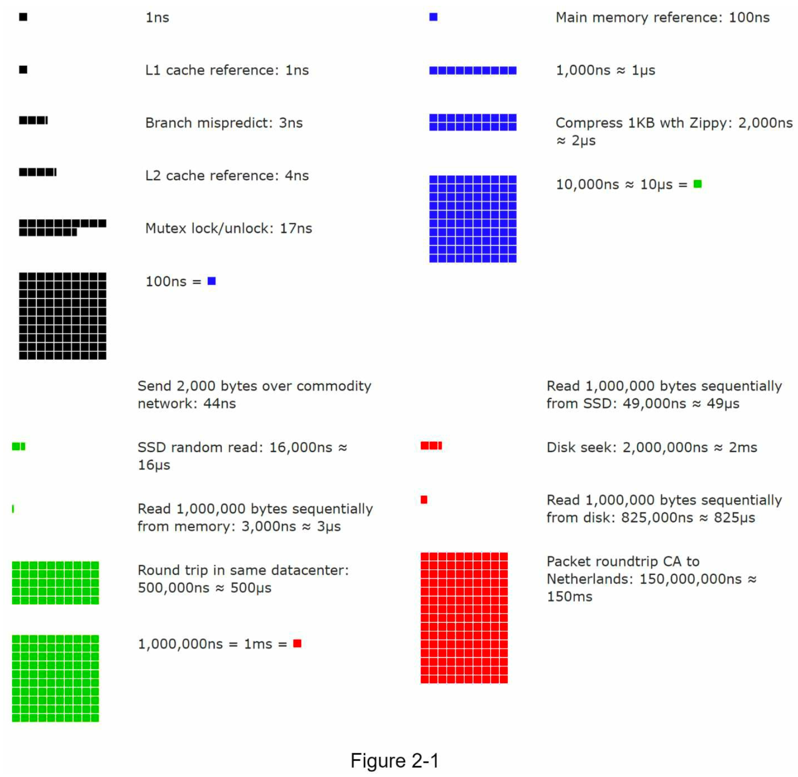

一位谷歌软件工程师构建了一个工具来可视化Dean博士的数据。该工具还考虑了时间因素。 图2-1显示了截至2020年的可视化延迟数字(图源:参考资料[3])。

通过分析图2-1中的数字,我们得出以下结论:

- 内存速度快,但磁盘速度慢。

- 如果可能的话,应避免磁盘寻道。

- 简单的压缩算法速度快。

- 在发送数据到互联网之前,尽可能对数据进行压缩。

- 数据中心通常位于不同的区域,发送数据之间需要一定的时间。

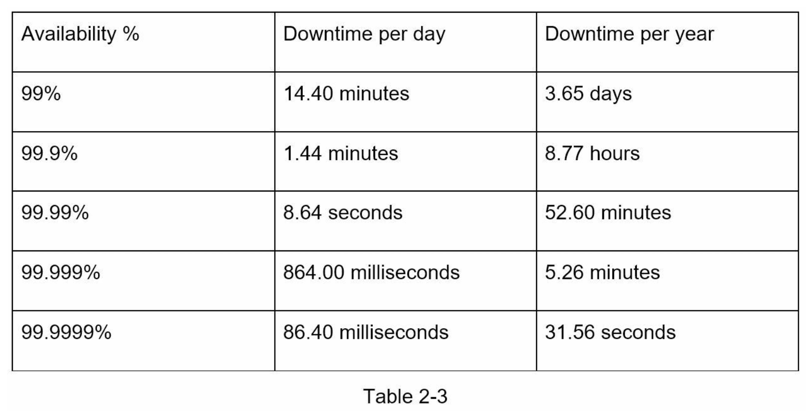

可用性数据

高可用性是系统持续运行的能力,期望能够长时间保持操作。 高可用性通常以百分比表示,100%意味着服务没有任何停机时间。大多数服务的可用性介于99%到100%之间。

服务水平协议(SLA)是服务提供商常用的术语。这是你(服务提供商)与你的客户之间的协议,该协议正式定义了你的服务将提供的运行时间水平。 云服务提供商Amazon、Google和Microsoft将它们的SLA设置在99.9%或更高。系统的运行时间传统上以数字的形式进行测量。 数字越多,表示系统的运行时间越长。 如表2-3所示,数字数量与预期系统停机时间相关。

示例:估算Twitter的查询量和存储需求

请注意,以下数字仅用于本练习,不是 Twitter 的真实数据。

假设:

- 每月活跃用户为3亿。

- 50%的用户每天使用 Twitter。

- 用户平均每天发布2条推文。

- 10%的推文包含媒体。

- 数据存储时间为5年。

估算: 查询每秒次数(QPS)估计:

- 每日活跃用户(DAU)= 3亿 * 50% = 1.5亿

- 推文 QPS = 1.5亿 * 2推文 / 24小时 / 3600秒 = 约 3500

- 峰值QPS = 2 * QPS = 约 7000

(译者注:这里更准确地说应该估算的 TPS,而不是QPS。仅个人观点,原文翻译还是保持原作者意思为 QPS。)

我们这里只会估算媒体存储。

- 平均推文大小:

- 推文ID 64 bytes(字节)

- 文本 140 bytes(字节)

- 媒体 1MB

- 媒体存储:1.5亿 * 2 * 10% * 1MB = 每天30TB

- 5年媒体存储:30TB * 365 * 5 = 约 55PB

小贴士

粗略估计更注重过程而非结果。 解决问题比得到准确结果更为重要。 面试官可能会测试你的解决问题的能力。 以下是一些建议:

- 四舍五入和近似值。在面试中进行复杂的数学运算是困难的。例如,“99987 / 9.1”的结果是多少?没有必要花费宝贵的时间来解决复杂的数学问题。精确度并不是必需的。使用整数和近似值来简化问题。例如,“100,000 / 10”。

- 记下你的假设。写下你的假设是个好主意,以便以后参考。

- 标记你的单位。当你写下“5”时,它是指5 KB还是5 MB?这可能会让你感到困惑。写下单位,因为“5 MB”有助于消除歧义。

- 常见的粗略估计问题包括:QPS、峰值QPS、存储、缓存、服务器数量等。在准备面试时,你可以练习这些计算。熟能生巧。

祝贺你已经走到这一步!现在,给自己一个鼓励。干得漂亮!

参考资料

[1] J. Dean. Google专业提示:使用粗略估计来选择最佳设计: http://highscalability.com/blog/2011/1/26/google-pro-tip-use-back-of-the-envelope-calculations-to-choo.html

[2] 系统设计入门指南:https://github.com/donnemartin/system-design-primer

[3] 每个程序员都应该知道的延迟数据:https://colin-scott.github.io/personal_website/research/interactive_latency.html

[4] 亚马逊计算服务等级协议:https://aws.amazon.com/compute/sla/

[5] 计算引擎服务等级协议(SLA):https://cloud.google.com/compute/sla

[6] Azure服务的SLA摘要:https://azure.microsoft.com/en-us/support/legal/sla/summary/

第03章:系统设计面试框架

你刚刚获得了梦寐以求的现场面试机会。招聘协调员给你发送了当天的日程安排。看完整个日程安排后,你觉得一切都挺好,直到你看到了这个面试环节 - 系统设计面试。

系统设计面试往往令人生畏,它可能像“设计一个知名的产品X?”那样的模糊不清。这些问题模棱两可,似乎过于宽泛。 你的担心是可以理解的。 毕竟,在一个小时内设计一个已经由数百甚至数千名工程师构建的流行产品,这似乎是不可能的?

好消息是,没有人期望你这样做。现实世界的系统设计是非常复杂的。例如,谷歌搜索看起来简单;然而,支持这种简单性背后的技术数量真的令人惊讶。 如果没有人期望你在一小时内设计出一个真实世界的系统,那么系统设计面试的好处是什么?

系统设计面试模拟了现实生活中的问题解决过程,两个同事合作解决一个模糊的问题,并提出一个符合他们目标的解决方案。这个问题是开放式的,没有完美的答案。 与你在设计过程中付出的努力相比,最终的设计并不那么重要。这使你能够展示你的设计技能,捍卫你的设计选择,并以有建设性的方式回应反馈。

让我们换个角度思考,考虑一下当面试官走进会议室与你见面时,她的脑子里在想什么。面试官的首要目标是准确评估你的能力。 她最不希望的是,因为会议进行得不顺利,没有足够的信息,而给出一个没有结果的评价。面试官想通过系统设计面试获得什么?

许多人认为,系统设计面试只涉及一个人的技术设计能力。事实并非如此。 有效的系统设计面试更多地体现了一个人的合作能力、在压力下工作的能力以及以建设性方式解决模糊问题的能力。提出好问题的能力也是一项重要的技能,许多面试官特别看重这项技能。

一个好的面试官也会寻找危险信号,过度设计是许多工程师的真正问题,因为他们喜欢设计的纯粹性而忽视了权衡。他们往往没有意识到过度设计系统的复合成本,许多公司为这种无知付出了高昂的代价。 你当然不希望在系统设计面试中表现出这种倾向。其他危险信号包括狭隘的思想,固执,等等。

在本章中,我们将介绍一些有用的技巧,并介绍一个简单而有效的框架来解决系统设计面试问题。

有效系统设计面试的 4 步流程

每个系统设计面试都是不同的。 出色的系统设计面试是开放式的,没有万能的解决方案。 然而,在每个系统设计面试中都有一些步骤和共同点需要涵盖。

第1步 :了解问题并确定设计范围

"老虎为什么咆哮?"

班级后面有一只手拍了起来。

"是的,吉米?",老师回答。

"因为他很饿"。

"非常好,吉米"。

在整个童年时期,吉米一直是班上第一个回答问题的人。每当老师提出问题时,教室里总有一个孩子喜欢回答这个问题,不管他是否知道答案。这就是吉米。

吉米是个优等生,他以很快就知道所有答案而自豪。在考试中,他通常是第一个完成问题的人。在任何学术竞赛中,他都是教师的首选。

别像吉米那样。

在系统设计面试中,不加思索地迅速给出答案不会给你加分。在没有彻底理解需求的情况下回答问题是一个危险的信号,因为面试不是一个小游戏比赛。这往往没有正确的答案。

作为一名工程师,我们喜欢解决棘手的问题,并投身于最终设计;然而,这种方法很可能会导致你设计出错误的系统。 作为一名工程师,最重要的技能之一是提出正确的问题,做出适当的假设,并收集建立一个系统所需的所有信息。因此,不要害怕问问题。

当你提出问题时,面试官要么直接回答你的问题,要么要求你做出你的假设。如果是后者,请在白板或纸上写下你的假设。你以后可能会用到它们。

要问什么问题?提出问题以了解确切的要求。 以下是一个问题清单,以帮助你开始工作:

- 我们要开发哪些特定功能?

- 这个产品有多少用户?

- 公司预计扩大规模的速度如何?3个月、6个月和1年后的预期规模是多少?

- 公司的技术栈是?可以利用哪些现有的服务来简化设计?

例子

如果你被要求设计一个新闻订阅系统,你希望问一些问题来帮助理解需求。你和面试官之间的对话可能是这样的:

候选人:这是一个移动应用吗?还是一个网页应用?还是两者兼有?

面试官:两者都有。

候选人:对于产品来说,最重要的功能是什么??

面试官:能够发布帖子并查看朋友的新闻动态。

候选人:新闻动态是按照时间顺序排列,还是按照特定顺序? 所谓的特定顺序意味着每篇帖子都有不同的权重。 例如,来自亲密朋友的帖子比来自一个群组的帖子更重要。

面试官:为了简单起见,我们假设动态是按照时间顺序排列的。

候选人:一个用户最多可以有多少个朋友?

面试官:5000个。

候选人:流量有多大?

面试官:每日活跃用户数为1000万(DAU)。

候选人:动态可以包含图像、视频,还是只有文字?

面试官:它可以包含媒体文件,包括图像和视频。

以上是一些你可以问面试官的示例问题。 理解需求并澄清不明确的地方是很重要的。

第2步:提出高层次的设计方案并获得认同

在这一步中,我们的目标是制定一个高层次的设计,并与面试官就设计达成一致。在这个过程中,与面试官合作是个好主意。

- 想出一个初步的设计蓝图。征求反馈意见。把你的面试官当作队友,一起工作。许多优秀的面试官喜欢交谈和参与。

- 在白板或纸上画出关键组件的框图。这可能包括客户端(移动/网络)、API、网络服务器、数据存储、缓存、CDN、消息队列,等等。

- 做一些粗略计算,以评估你的蓝图是否符合规模限制。边想边说。在深入研究之前,如果进行粗略计算是必要的,请与你的面试官进行沟通交流。

如果可能的话,通过一些具体的用例。这将帮助你确定高层设计的框架。用例也有可能帮助你发现你还没有考虑到的边缘情况。

我们应该在这里包括API端点和数据库架构吗?这取决于当前问题。对于像“设计Google搜索引擎”这样的大型设计问题,这有点过于底层。 对于像为一个多人扑克游戏设计后端这样的问题,这是合理的。

与你的面试官沟通。

例子

让我们以“设计一个新闻订阅系统”为例,来演示如何进行高层设计。这里不要求你了解系统的实际工作情况。所有的细节将在第11章解释。

在高层次上,设计分为两个流程:订阅发布和新闻订阅构建。

- 订阅发布:当用户发布帖子时,相应的数据会被写入缓存/数据库,并且该帖子将出现在好友的新闻订阅中。

- 新闻订阅构建:新闻订阅通过按时间倒序聚合好友的帖子来构建。

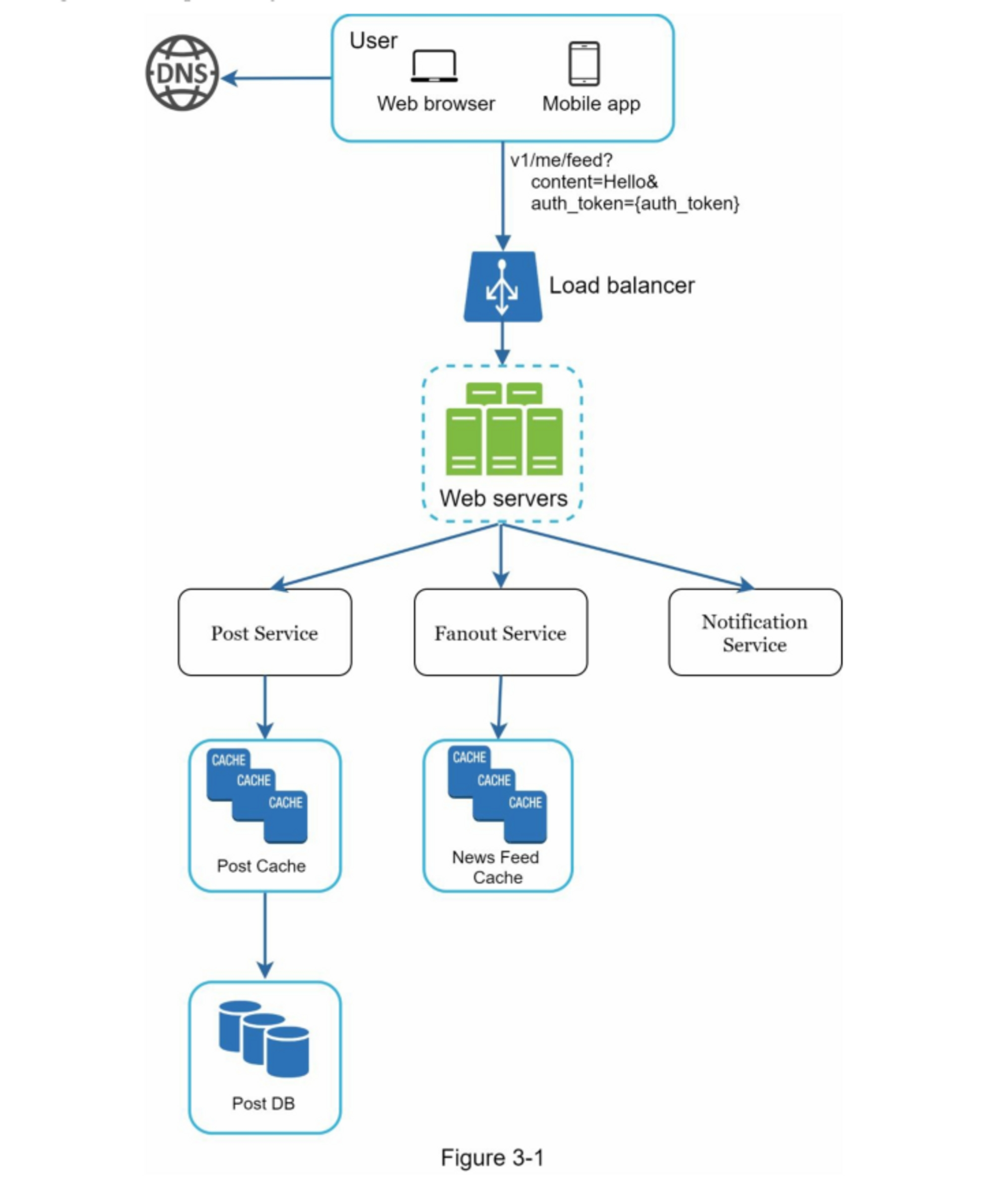

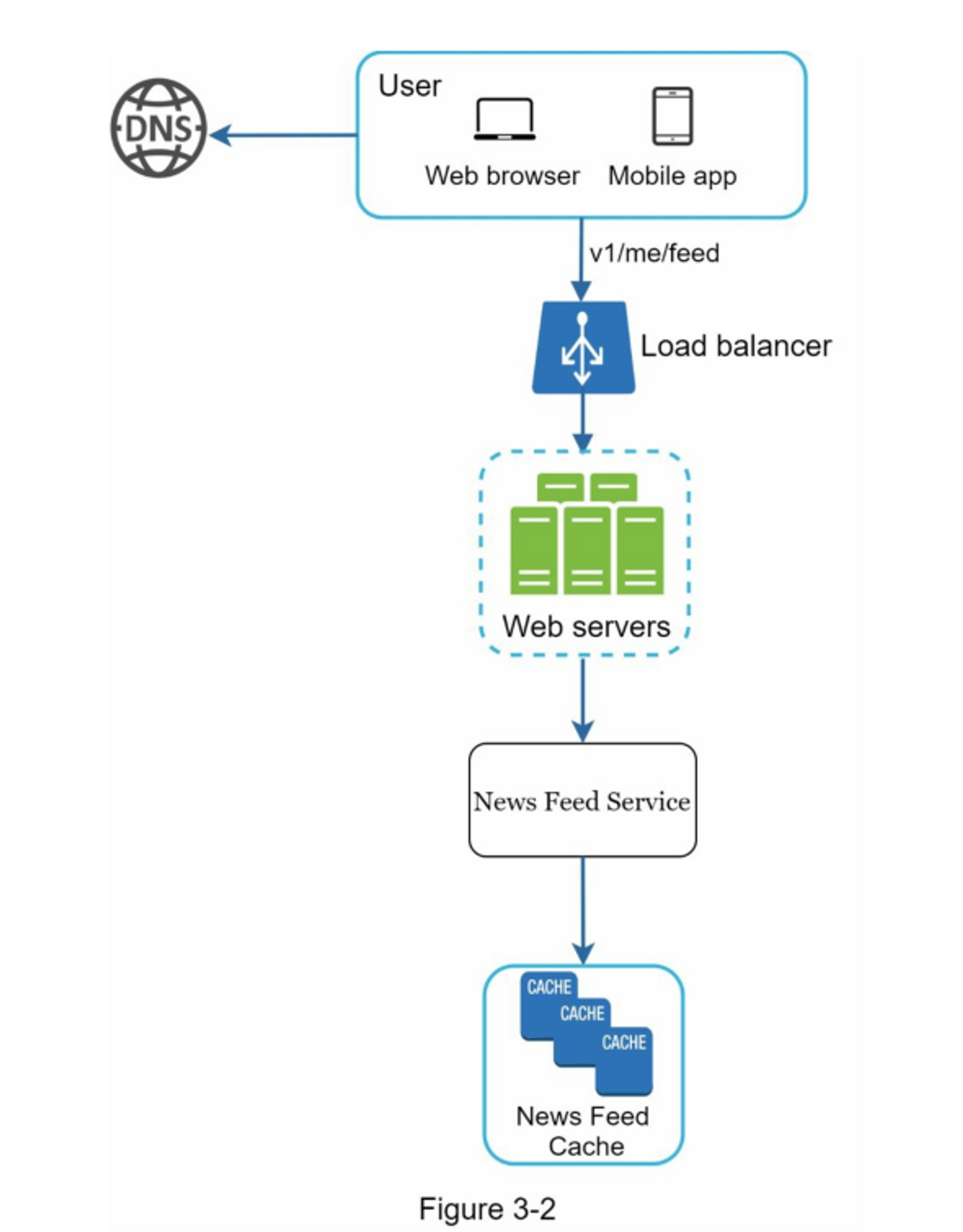

图3-1和图3-2分别展示了订阅发布和新闻订阅构建流程的高层设计。

第3步:深入设计

在这一步,你和你的面试官应该已经实现了以下目标:

- 就总体目标和功能范围达成一致

- 为整体设计草拟了一个高层次的蓝图

- 从面试官那里获得了对高层设计的反馈

- 根据她的反馈,对深入设计的重点区域有了一些初步想法

你应该与面试官合作,确定并优先考虑架构中的组件。值得强调的是,每次面试都是不同的。有时,面试官可能会暗示她喜欢专注于高层设计。 有时,对于资深候选人的面试,讨论可能会涉及系统性能特性,主要关注瓶颈和资源估算。在大多数情况下,面试官可能希望你深入了解某些系统组件的细节。 对于 URL 缩短器,深入探讨将长 URL 转换为短 URL 的哈希函数设计是一个有趣的话题。对于一个聊天系统来说,如何减少延迟以及如何支持在线/离线状态是两个有趣的话题。

时间管理是至关重要的,因为你很容易被一些细枝末节所迷惑,而这些细节并不能体现你的能力。你必须准备好一些信号来展示给面试官。尽量不要陷入不必要的细节中。 例如,在系统设计面试中,详细谈论Facebook feed排名的EdgeRank算法并不理想,因为这需要很多宝贵的时间,而且并不能证明你在设计可扩展系统方面的能力。

例子

在这一点上,我们已经讨论了新闻订阅系统的高级设计,面试官对您的提议感到满意。接下来,我们将调查两个最重要的使用案例:

- 新闻订阅发布

- 新闻订阅检索

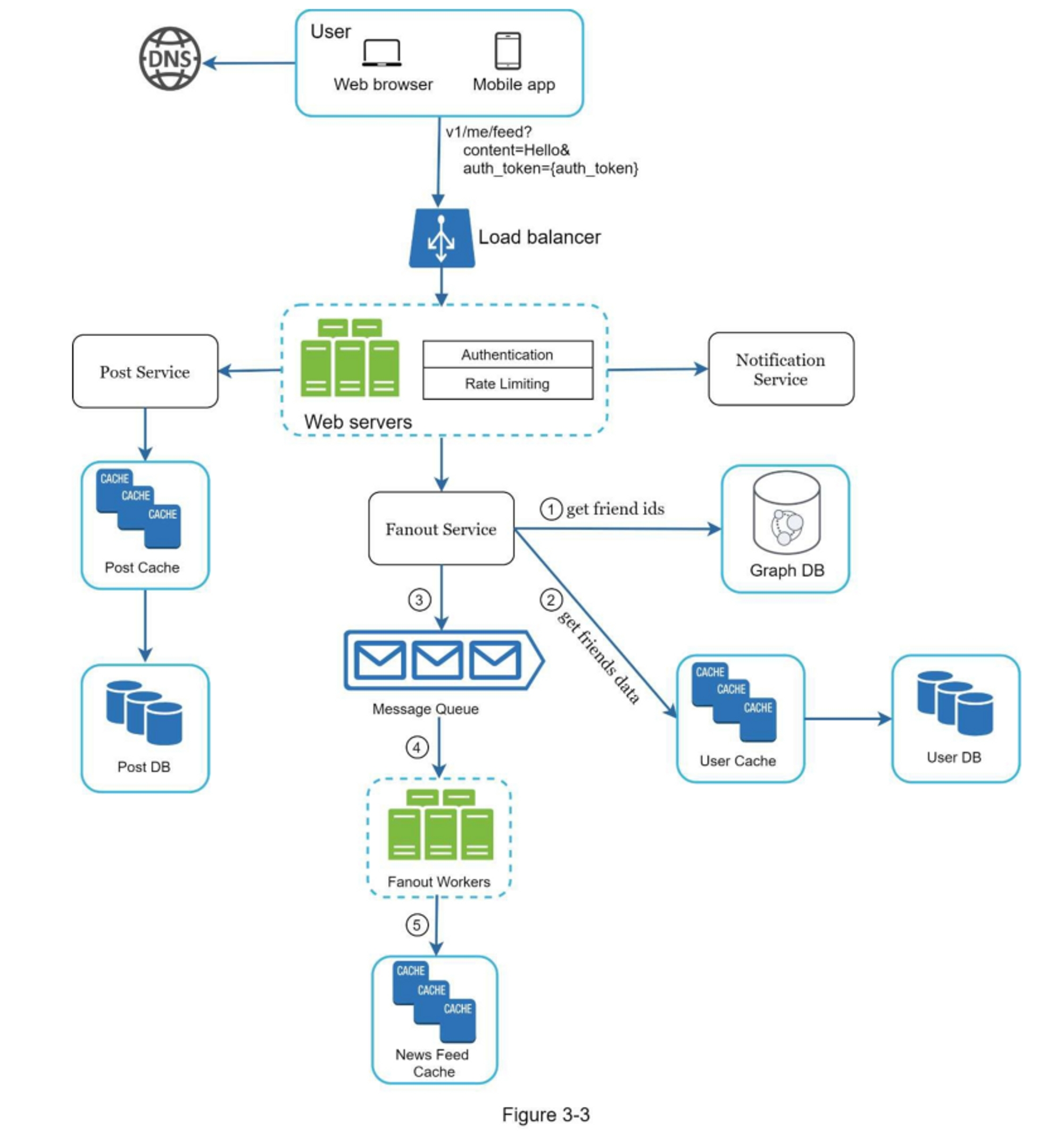

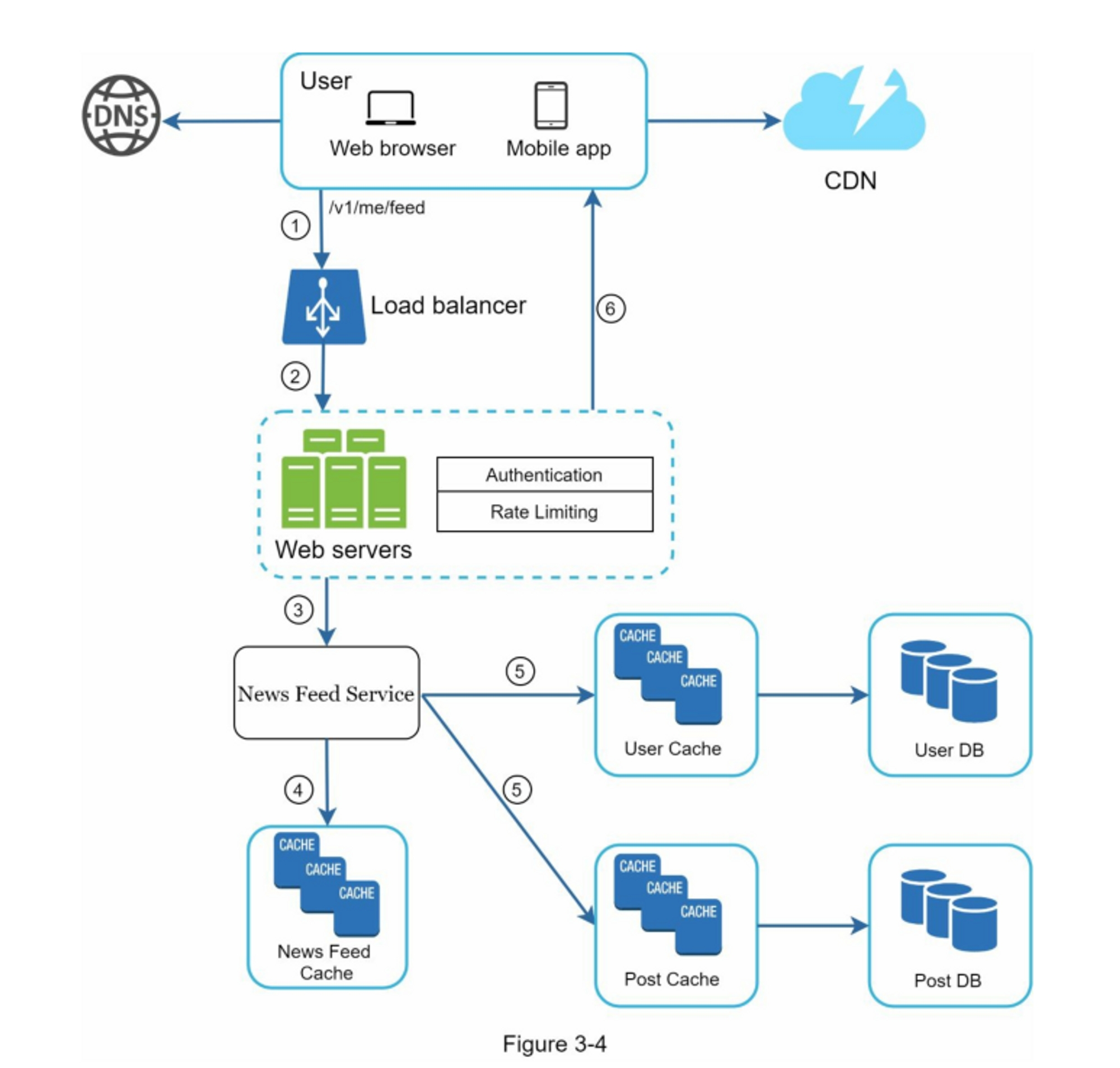

图3-3和图3-4显示了两个用例的详细设计,这将在第11章中详细说明

第4步:总结

在这最后一步,面试官可能会问你一些后续问题,或者让你自由讨论其他的附加要点。 以下是一些跟进方向:

- 面试官可能希望你找出系统的瓶颈,并讨论潜在的改进。千万不要说你的设计是完美的,没有什么可以改进的。总有一些东西是可以改进的。这是一个展示你的批判性思维的好机会,并留下一个好的最终印象。

- 给面试官回顾一下你的设计可能是有用的。如果你提出了几种解决方案,这一点就特别重要。在长时间的会话后,提醒面试官可能会有所帮助。

- 错误情况(服务器故障、网络丢失等)值得讨论。

- 运营问题也值得一提。如何监控指标和错误日志?系统如何推广?

- 如何处理下一个规模曲线也是一个有趣的话题。例如,如果你目前的设计支持100万用户,你需要做什么改变来支持1000万用户?

- 如果你有更多的时间,可以提出其他改进建议。

最后,我们总结了一份 "该做" 和 "不该做" 的清单。

-

该做

- 要问清楚。不要认为你的假设是正确的。

- 了解问题的要求。

- 既没有正确的答案,也没有最好的答案。为解决年轻创业公司的问题而设计的解决方案与拥有数百万用户的老牌公司的解决方案不同。确保你理解了要求。

- 让面试官知道你在想什么。与你的面试官沟通。

- 如果可能的话,提出多种方法。

- 一旦你与你的面试官就蓝图达成一致,就对每个组件进行详细说明。先设计最关键的部分。

- 向面试官反映想法。一个好的面试官会把你当作一个团队伙伴和你一起合作。

- 永不言弃。

-

不该做

- 不要对典型的面试问题没有任何准备。

- 在没有弄清需求和假设的情况下,不要贸然提出解决方案。

- 在开始的时候,不要对一个单一的组件进行太多细节的研究。首先给出高层次的设计,然后再深入探讨。

- 如果你被卡住了,不要犹豫,请求提示。

- 再次强调,要进行沟通。不要默默思考。

- 不要认为一旦你给出设计方案,你的面试就结束了。直到你的面试官说你完成了,你才算完成。尽早并经常要求反馈。

-

每个步骤的时间分配

系统设计的面试问题通常非常广泛,45分钟或一个小时不足以涵盖整个设计。时间管理至关重要。在每个步骤上应该花费多少时间? 以下是一个非常粗略的指南,指导你在45分钟的面试会议中的时间分配。请记住,这只是一个粗略的估计,实际时间分配取决于问题的范围和面试官的要求。

- 第1步 理解问题并确定设计范围:3-10分钟

- 第2步 提出高层次的设计并获得认同:10-15分钟

- 第3步 深入设计:10-25分钟

- 第4步 总结:3-5分钟

第04章:设计一个限流器

在网络系统中,限流器被用于控制客户端或服务端发送流量的速率。在HTTP世界中,限流器限制在指定时间内允许发送客户端请求数。 如果API请求次数超过了限流器设置的阈值,则所有超出的调用都会被阻止。 以下是一些示例:

- 单个用户每秒最多可以发布2个帖子

- 每天同一IP地址最多可以创建10个帐户。

- 同一设备每周最多可以领取5次奖励。

在本章中,您需要设计一个限流器。在开始设计之前,我们先看看使用 API 限流器的好处:

- 防止拒绝服务 (DoS) 攻击造成的资源匮乏 [1]。 几乎大型科技公司发布的所有 API 都强制执行某种形式的速率限制。 例如,Twitter将每3小时的推文数量限制为300条[2]。 Google docs APIs有如下默认限制:每个用户每60秒读取请求为300次[3]。 限流器通过阻止多余的调用来防止DoS攻击,无论是有意还是无意的。

- 降低成本。限制过多的请求意味着减少服务器数量,将更多资源分配给高优先级的API。 速率限制对于使用付费第三方API的公司来说极为重要。 例如,你对以下外部API的调用是按次数收费的:检查信用、付款、检索健康记录等。限制调用次数对减少成本至关重要。

- 防止服务器过载。为了减少服务器的负荷,使用限流器来过滤由机器人或用户的不当行为造成的过量请求。

第1步:了解问题并确定设计范围

速率限制可以通过不同的算法来实现,每一种算法都有其优点和缺点。 面试官和候选人之间的互动有助于阐明我们试图建立的限流器的类型。

候选人:我们要设计什么样的限流器?是客户端的限流器还是服务器端的API限流器?

面试官:好问题,我们专注于服务器端的API限流器。

候选人:限流器是否根据IP、用户ID或其他属性来限制API请求?

面试官:限流器应该足够灵活,能够支持不同的限流规则集。

候选人:该系统的规模是多少?它是为初创企业还是拥有庞大用户群的大公司建立的?

面试官:该系统必须能够处理大量的请求。

候选人:系统会在分布式环境下工作吗?

面试官:是的。

候选人:限流器是一个单独的服务还是应该在应用程序代码中实现?

面试官:这是一个由你决定的设计问题。

候选人:是否需要通知被限流的用户?

面试官:是的。

要求

以下是对系统要求的概述

- 准确地限制过多的请求

- 低延迟:限流器不能降低Http响应时间。

- 尽可能的占用更少的内存。

- 分布式速率限制,要求可以在多个服务器或进程之间共享。

- 异常处理,当用户的请求受到限制时,向用户显示明确的异常信息。

- 高容错性。如果限流器出现任何问题(例如,一个缓存服务器离线),它不会影响整个系统。

第2步:提出高层次的设计方案并获得认同

让我们保持简单,并使用基本的客户端和服务器模型进行通信。

限流器放在哪里

直觉上,你可以在客户端或服务器端实现限流器。

-

客户端实现。 一般来说,客户端是执行速率限制的不可靠场所,因为客户端请求很容易被恶意用户伪造。 此外,我们可能无法控制客户端的实现。

-

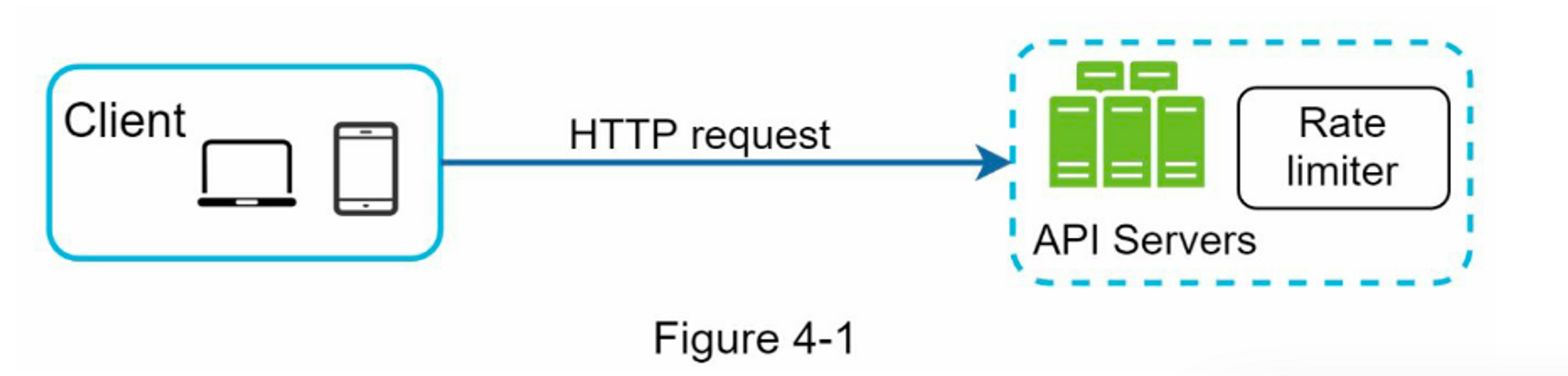

服务端实现。图4-1显示了一个放在服务器端的限流器。

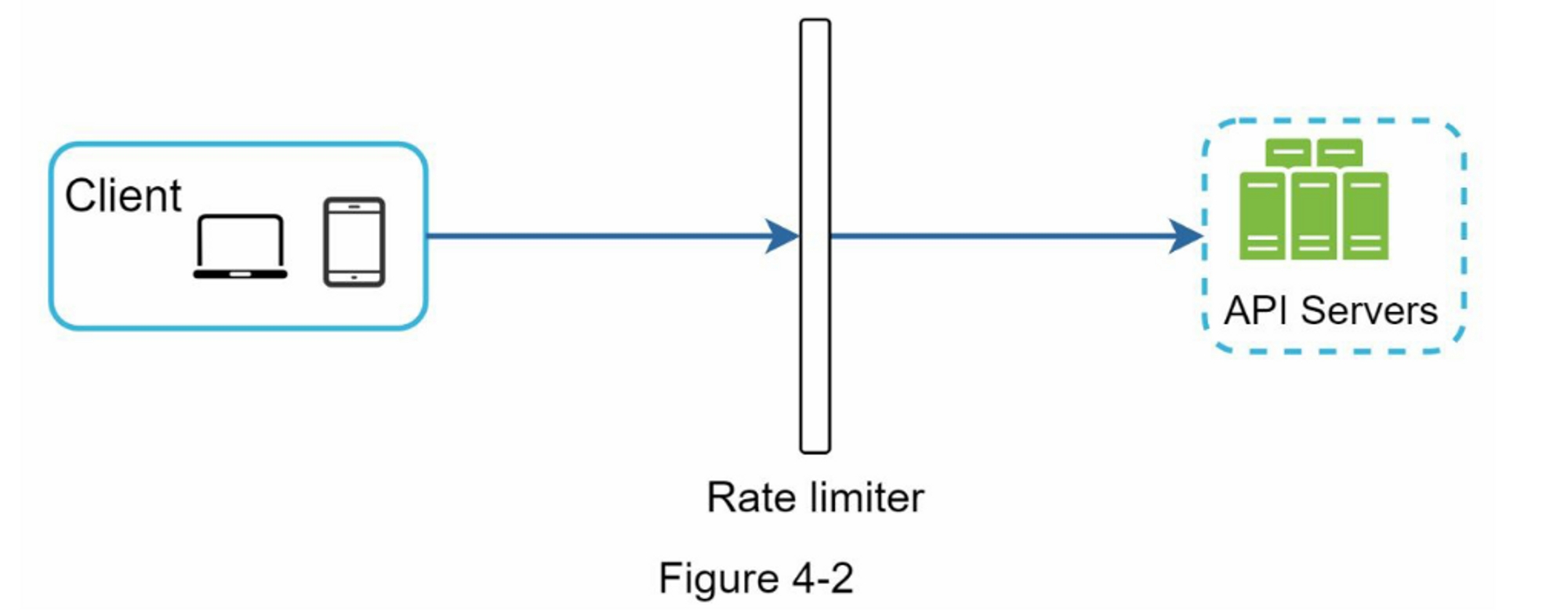

除了客户端和服务器端的实现方式之外,还有另一种方法。 我们可以不将限流器放在API服务器上,而是创建一个限流器中间件,用于对API的请求进行限制,如图 4-2 所示:

除了客户端和服务器端的实现方式之外,还有另一种方法。 我们可以不将限流器放在API服务器上,而是创建一个限流器中间件,用于对API的请求进行限制,如图 4-2 所示:

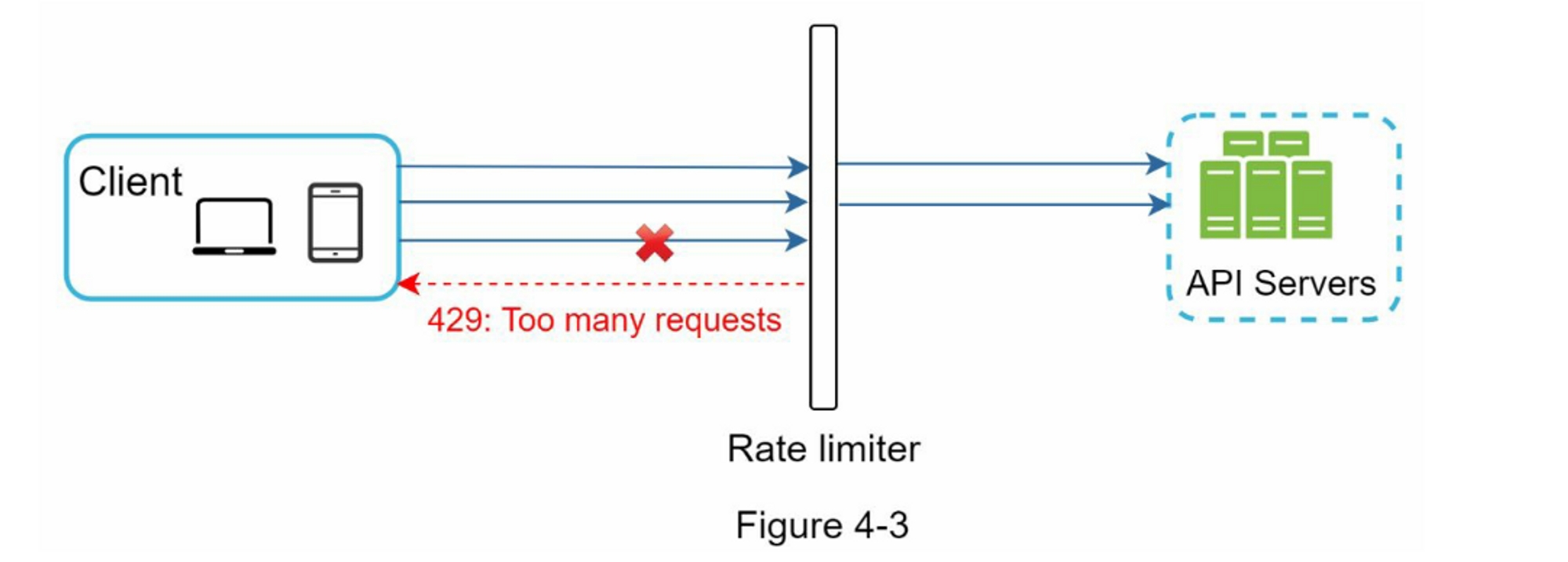

让我们使用图 4-3 中的示例来说明这种设计中的限流器是如何工作的。 假设我们的 API 允许每秒 2 个请求,而客户端在一秒内发送了3个请求到服务器。 前两个请求被路由到 API 服务器。 但是,限流器中间件会限制第三个,请求并返回 HTTP 状态代码 429。 HTTP 429 响应状态代码表示用户发送了过多的请求。

云微服务[4]已经变得非常流行,限流通常在一个叫做API网关的组件中实现。API网关是一个完全托管的服务,支持限速、SSL、认证、IP白名单、服务静态内容等。现在,我们只需要知道API网关是一个支持限流的中间件。

在设计限流器时,要问自己的一个重要问题是:限流器应该在哪里实现,在服务器端还是在网关中?这没有绝对的答案。这取决于你公司目前的技术栈、工程资源、优先级、目标等。这里有一些通用的指南:

- 评估你目前的技术栈,如编程语言、缓存服务等。确保你目前的编程语言能够有效地在服务器端实现速率限制。

- 确定适合你业务需求的速率限制算法。当你在服务器端实施一切时,你可以完全控制算法。然而,如果你使用第三方网关,你的选择可能是有限的。

- 如果你已经使用了微服务架构,并在设计中包含了一个API网关来执行认证、IP白名单等,你可以在API网关上添加一个限流器。

- 建立你自己的速率限制服务需要时间。如果你没有足够的工程资源来实现限流器,商业API网关是一个更好的选择。

限流算法

限流可以使用不同的算法来实现,每种算法都有其独特的优缺点。尽管本章并不关注算法,但在高层次上了解它们有助于选择正确的算法或算法组合来适应我们的使用情况。

下面是一个流行算法的列表:

- 令牌桶(Token bucket)

- 漏桶算法(Leaking bucket)

- 固定窗口计数器(Fixed window counter)

- 滑动窗口日志(Sliding window log)

- 滑动窗口计数器(Sliding window counter)

令牌桶算法

令牌桶(Token bucket)算法广泛用于速率限制。 它简单易懂,常被互联网公司采用。 Amazon [5] 和 Stripe [6] 都使用这个算法来限制他们的 API 请求。

令牌桶算法的工作原理如下:

-

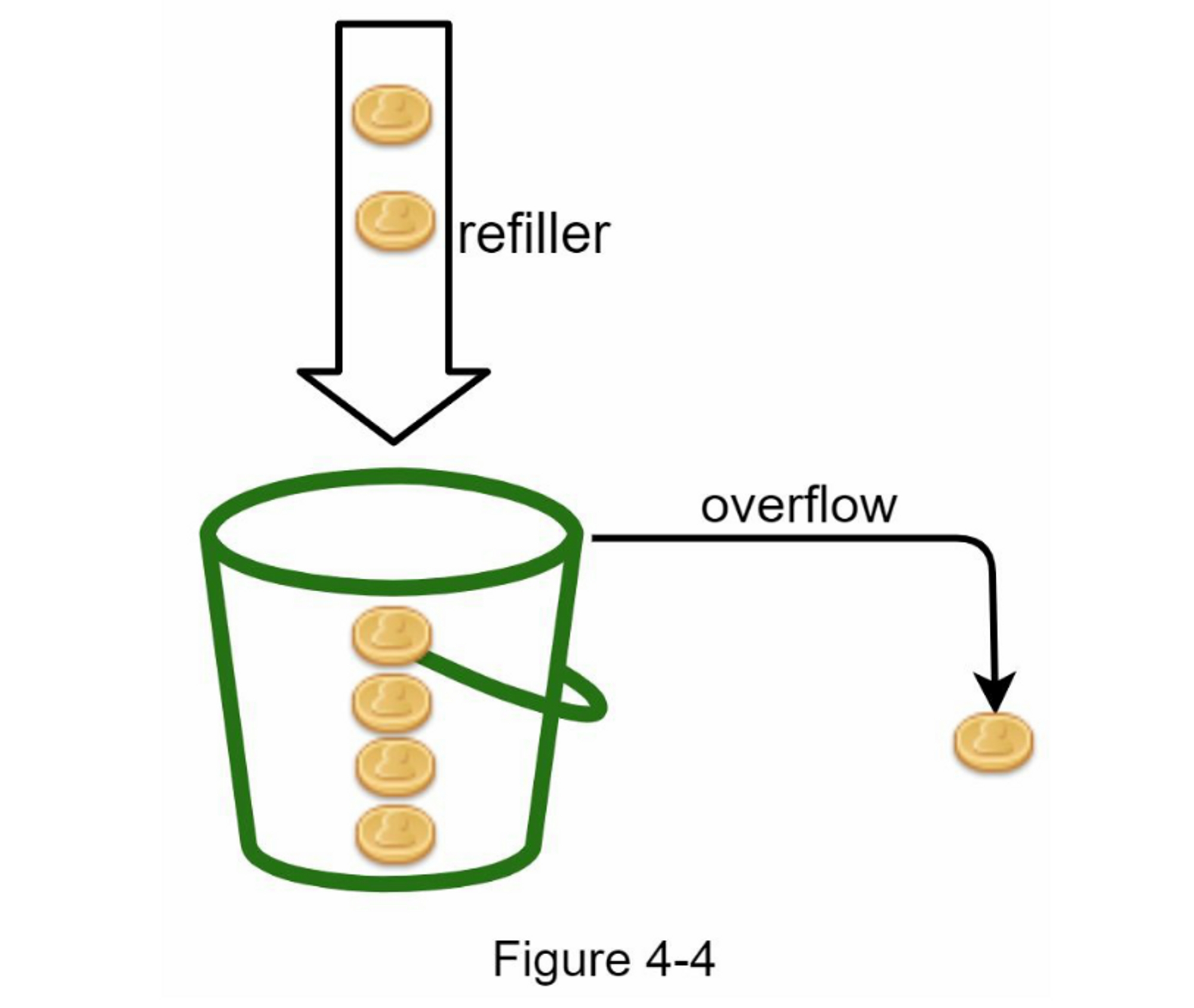

令牌桶是一个具有预定义容量的容器。 令牌会以预定的速率定期放入桶中, 一旦桶满了,就不再添加令牌。 如图4-4所示,令牌桶容量为4,注入装置每秒向桶中放入2个令牌,一旦桶满了,多余的令牌就会溢出。

-

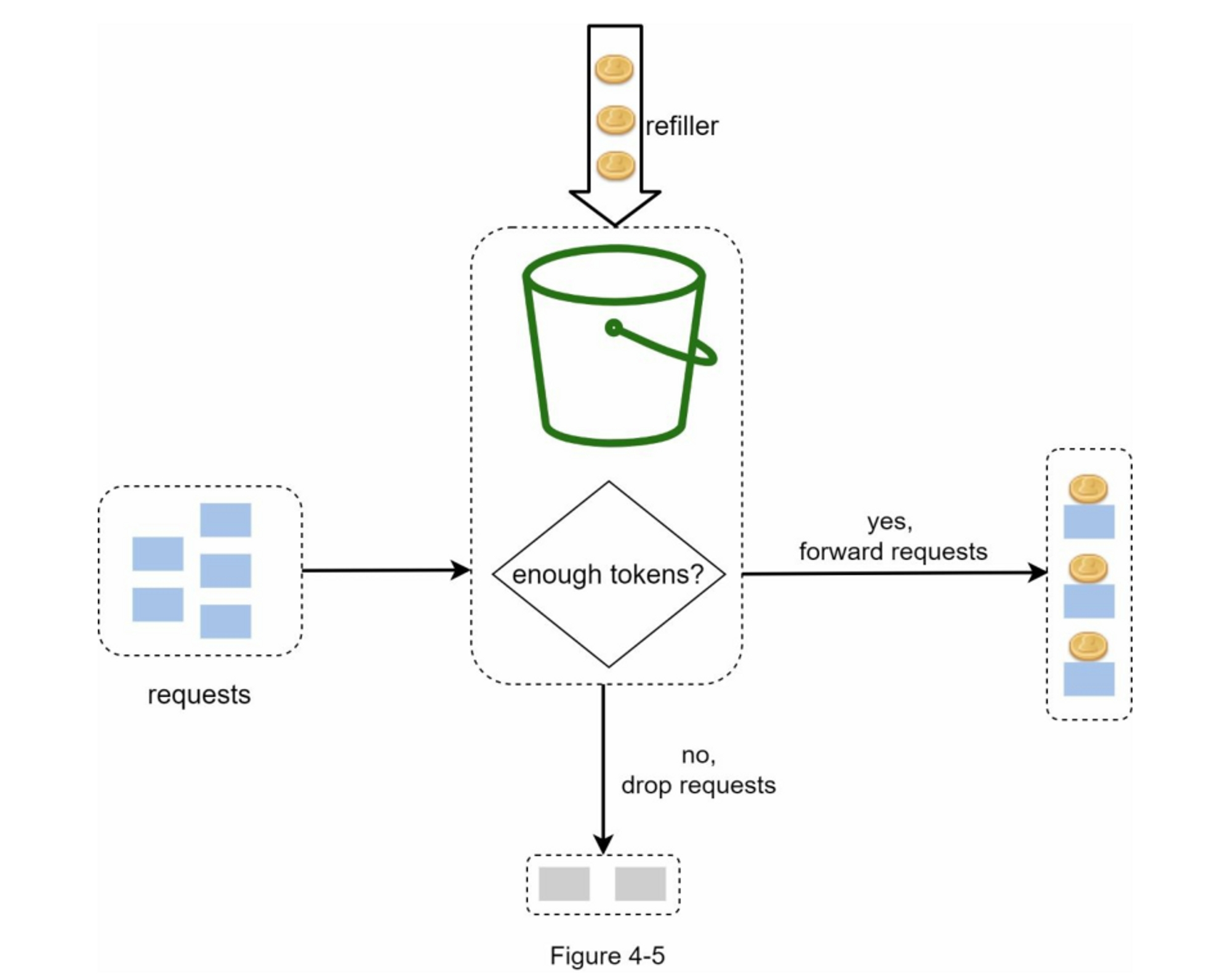

每个请求都会消耗一个令牌。当一个请求到达时,我们检查桶中是否有足够的令牌。图4-5解释了它是如何工作的。

- 如果有足够的令牌,我们会为每个请求取出一个令牌,然后请求通过。

- 如果没有足够的令牌,则该请求被丢弃。

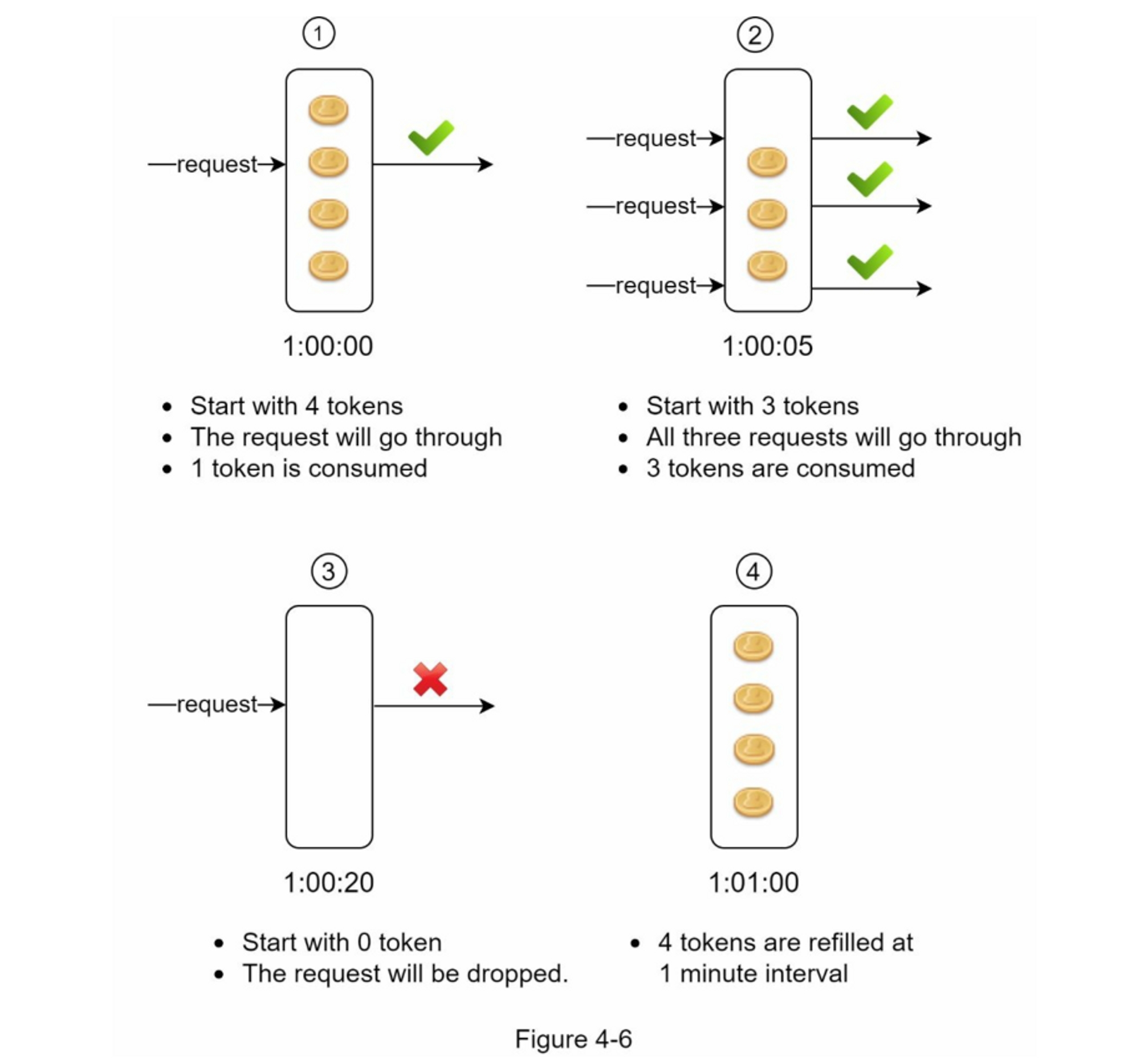

图 4-6 说明了令牌消耗、重新填充和速率限制逻辑的工作原理。 在此示例中,令牌桶大小为 4,重新填充速率为每 1 分钟 4 个。

令牌桶算法需要两个参数:

- 桶大小:桶内允许的最大令牌数。

- 填充速率:每秒放入到桶内的令牌数量。

我们需要多少个桶?这取决于限流规则,并且会有所不同。 以下是几个例子。

- 通常需要为不同的API端点使用不同的桶。例如,如果一个用户被允许每秒发1个帖子,每天添加150个好友,并且每秒钟点赞5个帖子,则每个用户需要3个桶。

- 如果我们需要根据IP地址对请求进行限流,每个IP地址都需要一个桶。

- 如果系统允许每秒最多10,000个请求,则有一个全局桶供所有请求共享是有意义的。

优点

- 算法容易实现

- 占用内存少

- 令牌桶允许在短时间内进行突发流量。只要有剩余的令牌,请求就可以通过。

缺点

- 算法中有两个参数,即桶的大小和令牌的补充速率。然而,正确调整它们可能具有挑战性。

漏桶算法

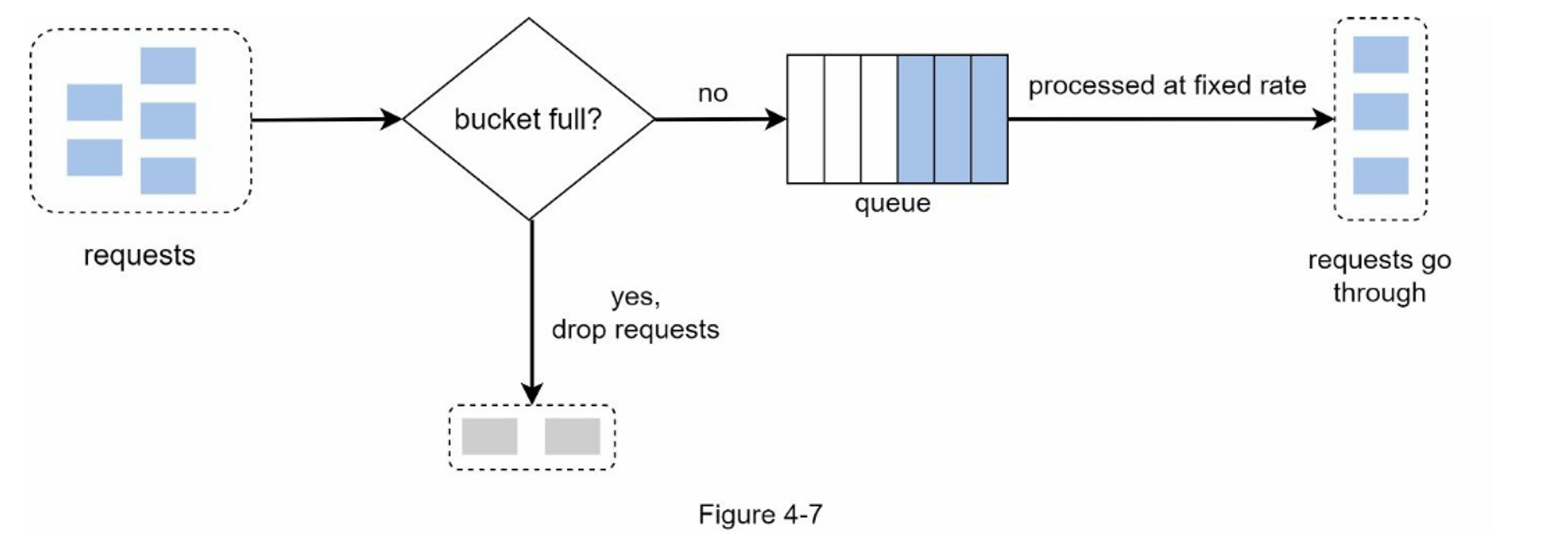

漏桶(Leaking bucket)算法与令牌桶类似,不同之处在于请求是以固定速率处理的。它通常用先入先出(FIFO)队列来实现。

该算法的工作原理如下:

- 当请求到达时,系统会检查队列是否已满。如果队列未满,则将请求添加到队列中。

- 否则,将丢弃该请求。

- 请求会在固定的时间间隔内从队列中取出并进行处理。

图4-7解释了该算法的工作原理:

漏桶算法需要以下两个参数

- 桶的大小:它等于队列的大小。队列容纳了要以固定速度处理的请求。

- 流出率:定义了在固定速率下可以处理多少请求,通常以秒为单位。

Shopify,一家电子商务公司,使用泄漏桶来限制速度[7]。

优点:

- 鉴于队列大小有限,内存效率高。

- 请求以固定的速率处理,因此它适用于需要稳定流出速率的用例。

缺点:

- 突发的流量使队列中充满了旧的请求,如果这些请求没有得到及时处理,最近的请求将受到速率限制。

- 算法中有两个参数,要适当地调整它们可能并不容易。

固定窗口计数器算法

固定窗口计数器(Fixed window counter)算法工作原理如下:

- 该算法将时间轴划分为固定大小的时间窗口,并为每个窗口分配一个计数器。

- 每个请求将计数器增加一。

- 一旦计数器达到预定的阈值,新的请求就会被放弃,直到新的时间窗口开始。

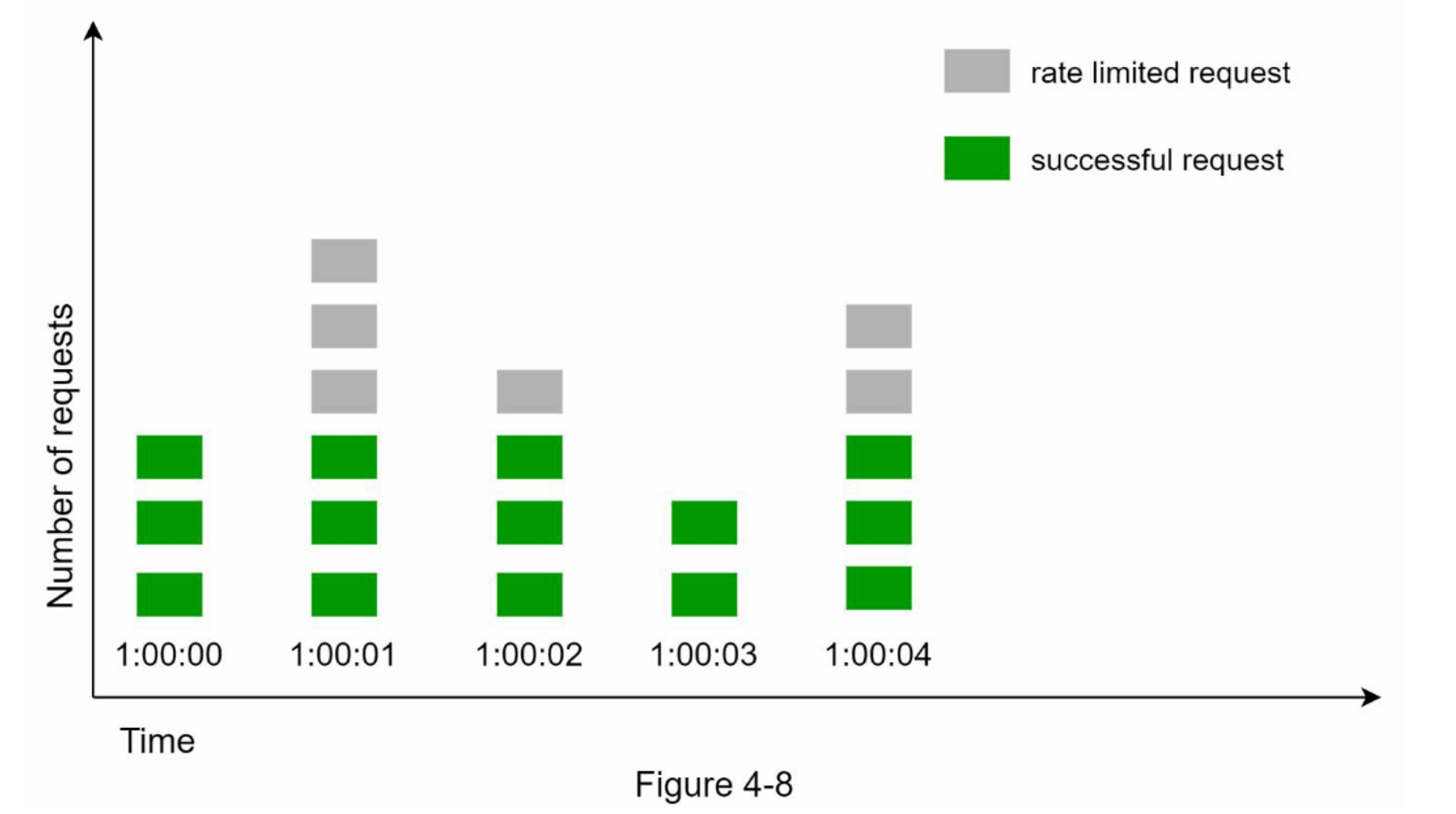

让我们用一个具体的例子来看看它是如何工作的。在图4-8中,时间单位是1秒,系统允许每秒钟最多有3个请求。在每个秒窗口中,如果收到的请求超过3个,额外的请求就会被放弃,如图4-8所示:

该算法的一个主要问题是,在时间窗口边缘的突发流量可能会导致超过允许配额的请求。考虑以下情况:

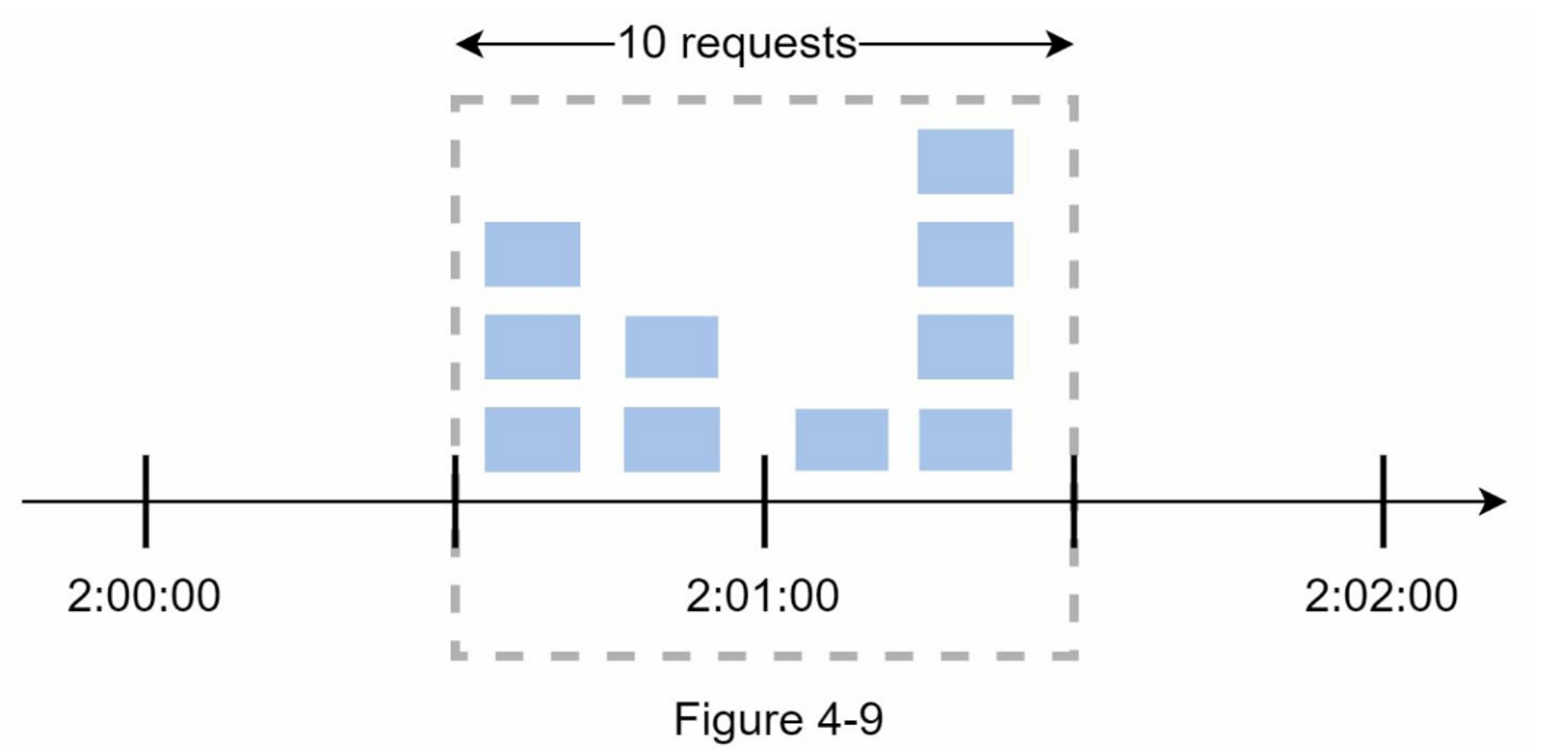

在图4-9中,系统允许每分钟最多有5个请求,可用的配额在整点分钟时重置。如图所示,在 2:00:00 和 2:01:00 之间有5个请求,在 2:01:00 和 2:02:00 之间又有五个请求。 在 2:00:30 和 2:01:30 之间的1分钟窗口,有10个请求通过了。这是允许请求数量的两倍。

优点:

- 内存高效

- 容易理解

- 在单位时间窗口结束时重新设置可用配额,适合某些使用情况

缺点:

- 窗口边缘的流量激增可能导致超过允许配额的请求被通过(有突刺)

滑动窗口日志算法

如前所述,固定窗口计数(Fixed window log)算法有一个主要问题:它允许更多的请求在窗口的边缘通过。滑动窗口日志算法解决了这个问题。 它的工作原理如下:

- 该算法对请求的时间戳进行跟踪。时间戳数据通常保存在缓存中,如Redis的sorted[8] 。

- 当一个新的请求进来时,删除所有过期的时间戳。过时的时间戳被定义为比当前时间窗口的开始时间更早的时间戳。

- 将新请求的时间戳添加到日志中

- 如果日志大小与允许的计数相同或更低,则接受请求。否则,它将被拒绝

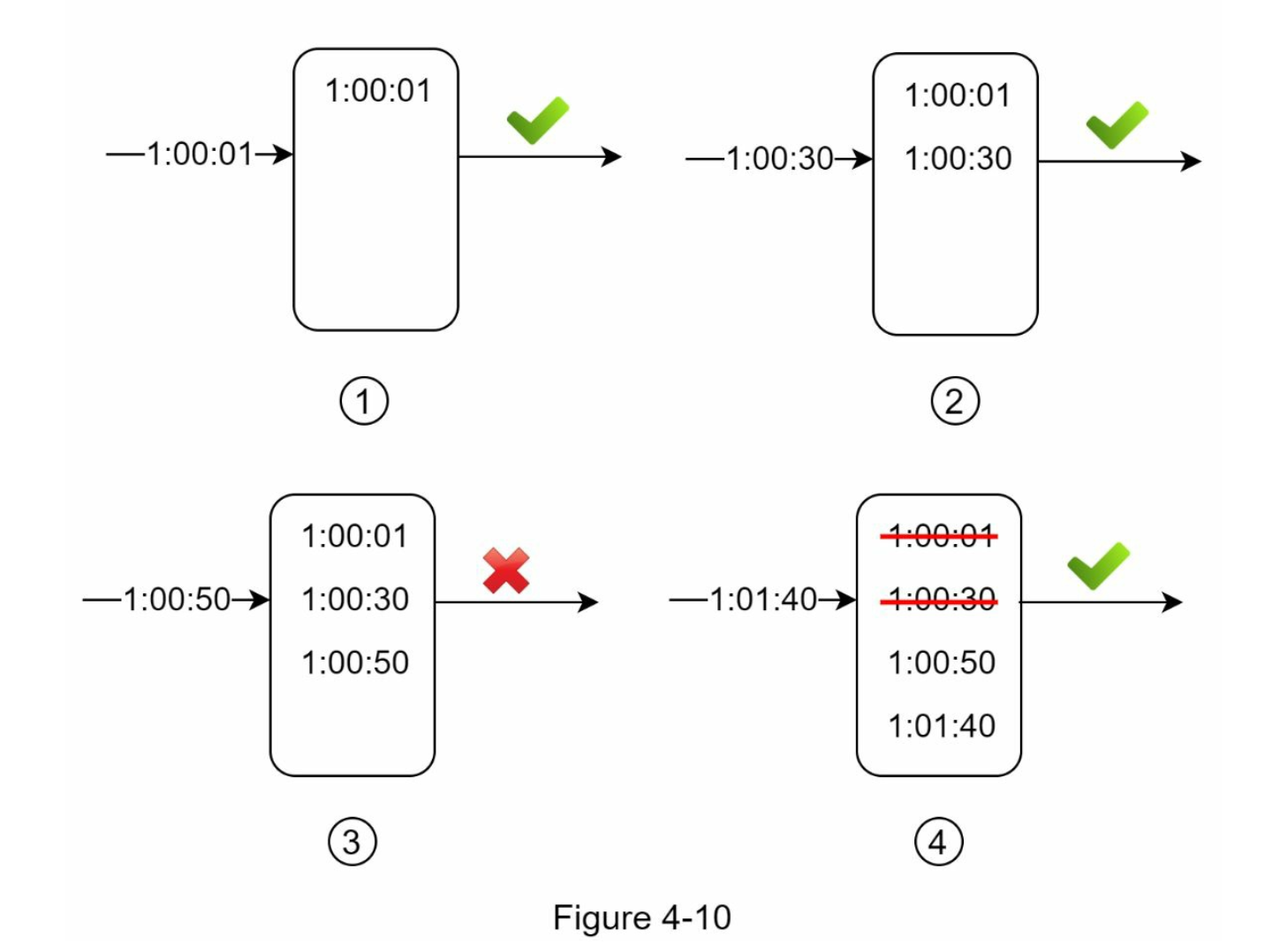

我们用图4-10所示的一个例子来解释该算法。

在这个例子中,限流器允许每分钟2个请求。通常情况下,Linux的时间戳会存储在日志中。然而,在我们的例子中,为了提高可读性,使用了人类可读的时间表示法。

- 当一个新的请求在 $$1:00:01$$ 到达时,该日志是空的。因此,该请求被允许。

- 一个新的请求在 $$1:00:30$$ 到达,时间戳 $$1:00:30$$ 被插入到日志中。插入后,日志大小为2,不大于允许的数量,因此,该请求被允许。

- 一个新的请求在 $$1:00:50$$ 到达,时间戳被插入到日志中。插入后,日志大小为3,大于允许的大小2。因此,这个请求被拒绝,尽管时间戳仍然在日志中。

- 一个新的请求在 $$1:01:40$$ 到达。在 $$\left [1:00:40,1:01:40 \right]$$ 范围内的请求是在最新的时间范围内,但在 $$1:00:40$$ 之前发送的请求是过时的。

- 两个过期的时间戳 $$1:00:01$$ 和 $$1:00:30$$ 被从日志中删除。在删除操作之后,日志大小变成了2;因此,请求被接受。

优点:

- 这种算法实现的速率限制是非常准确的。在任何滚动窗口中,请求都不会超过速率限制。

缺点:

- 该算法消耗了大量的内存,因为即使一个请求被拒绝,其时间戳仍可能被存储在内存中

滑动窗口计数器算法

滑动窗口计数器(Sliding window counter)算法是一种混合方法,结合了固定窗口计数器和滑动窗口日志。 该算法可以通过两种不同的方法来实现。我们将在本节中解释一种实现方法,并在本节末尾提供另一种实现方法的参考。

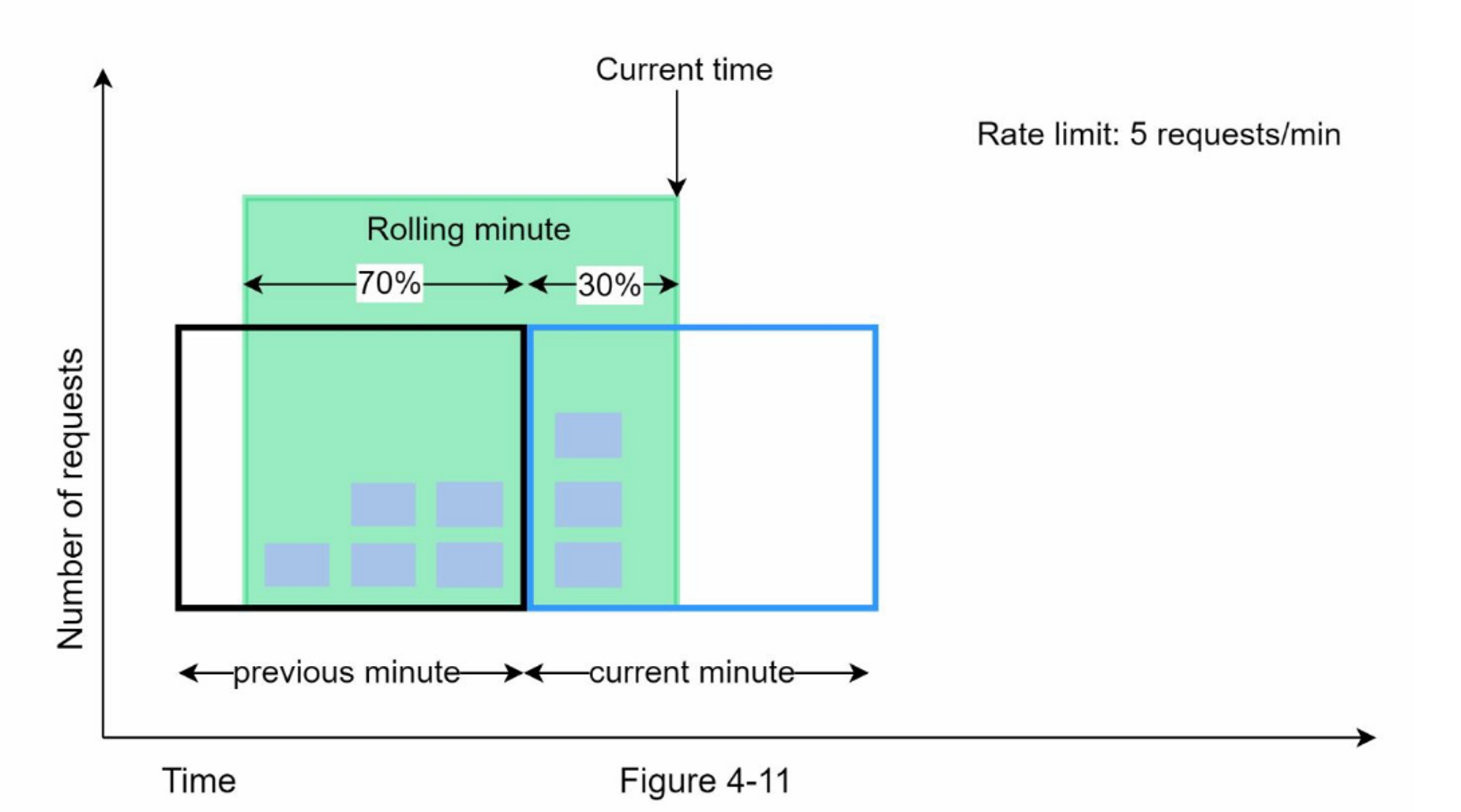

图4-11说明了这种算法的工作原理:

假设限流器允许每分钟最多有7个请求,在上一分钟有5个请求,当前一分钟有3个请求。对于在当前分钟内到达30%位置的新请求,滚动窗口中的请求数用以下公式计算:

- 当前窗口中的请求数量 + 上一个窗口中的请求数量 * 滚动窗口和上一个窗口的重叠百分比

- 使用这个公式,我们得到 $$3 + 5 \times 0.7 % = 6.5$$ 个请求。根据不同的使用情况,这个数字可以向上或向下取整。在我们的例子中,它被向下四舍五入为6。

由于限流器每分钟最多允许7个请求,当前的请求可以通过。然而,再收到一个请求后,就会达到限制。

由于篇幅所限,我们在此不讨论其他的实现。有兴趣的读者可以参考参考资料[9]。这种算法并不完美。它有优点也有缺点。

优点:

- 它平滑了流量的峰值,因为速率是基于前一个窗口的平均速率。

- 内存高效

缺点:

- 它只适用于不太严格的回看窗口。它是实际速率的近似值,因为它假设前一个窗口的请求是均匀分布的。然而,这个问题可能并不像它看起来那么糟糕。 根据Cloudflare[10]所做的实验,在4亿个请求中,只有0.003%的请求被错误地允许或限制速率

高层次的架构

限流算法的基本思想很简单。在高层次上,我们需要一个计数器来跟踪来自同一用户、IP地址等的多少个请求。如果计数器大于限制值,则请求被禁止。

我们应该在哪里存储计数器?由于磁盘访问速度慢,使用数据库并不是一个好主意。选择内存缓存是因为它速度快并且支持基于时间的过期策略。 例如,Redis[11]是实现速率限制的一个流行选择。它是一个内存中的存储,提供两个命令:INCR和EXPIRE

INCR:它使存储的计数器加1。EXPIRE:它为计数器设置一个超时。如果超时过后,计数器会被自动删除。

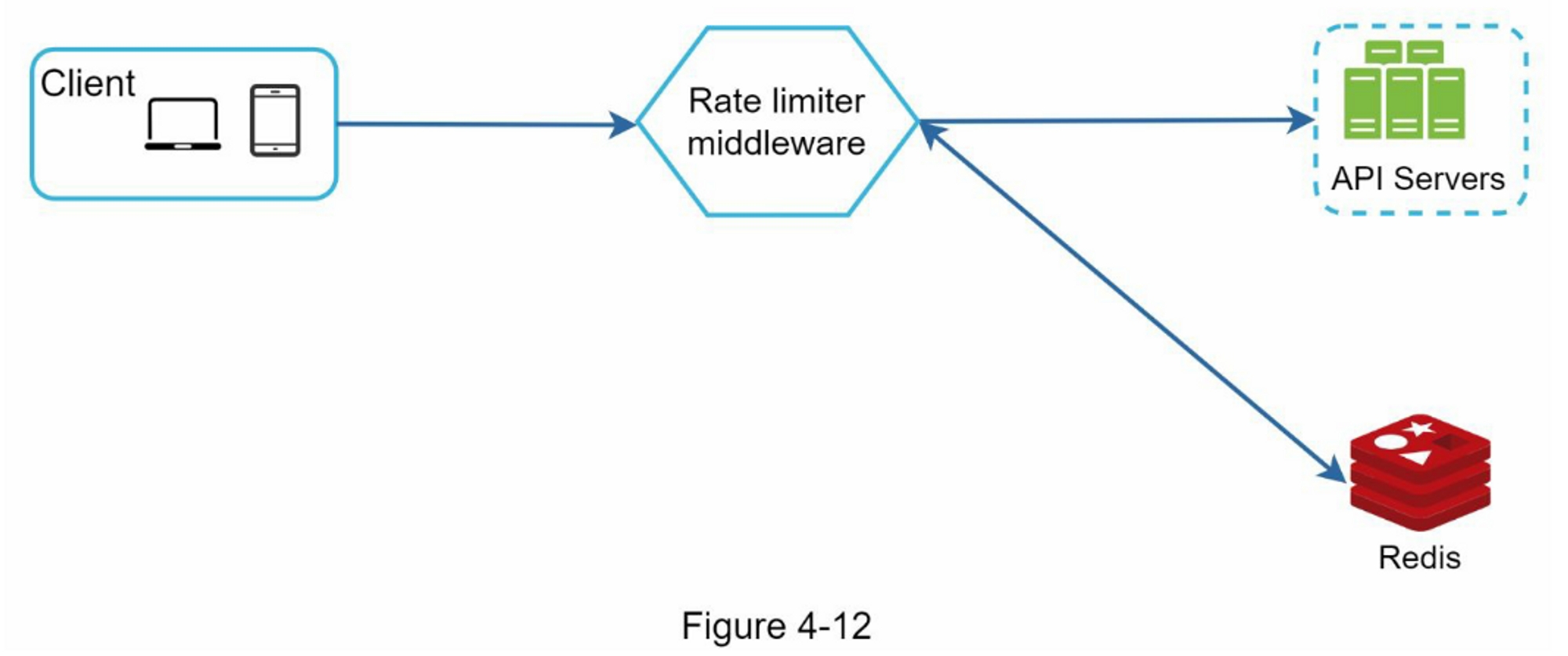

图4-12显示了速率限制的高层结构,其工作原理如下:

- 客户端向限流中间件发送请求

- 限流中间件从Redis中相应的桶中获取计数器,并检查是否达到限制

- 如果达到限制,则拒绝该请求

- 如果没有达到限制,请求会被发送到API服务器。同时,系统会增加计数器并将其保存回Redis。

第3步:深入设计

图4-12中的高层设计并没有回答以下问题:

- 如何创建速率限制规则?这些规则储存在哪里?

- 如何处理受限的请求?

在这一节中,我们将首先回答关于限流规则的问题,然后介绍处理限流请求的策略。最后,我们将讨论分布式环境中的限流、详细的设计、性能优化和监控。

限流规则

Lyft开源了他们的速率限制组件[12]。我们将窥探该组件的内部情况,并看看一些速率限制规则的例子。

domain: messaging

descriptors:

- key: message_type

Value: marketing

rate_limit:

unit: day

requests_per_unit: 5

在上述例子中,系统被配置为每天最多允许5条营销信息。下面是另一个例子:

domain: auth

descriptors:

- key: auth_type

Value: login

rate_limit:

unit: minute

requests_per_unit: 5

这个规则显示,客户不允许在1分钟内登录超过5次。规则一般写在配置文件中并保存在磁盘上。

超过速率限制

如果一个请求被限制了速率,API会向客户端返回一个HTTP响应代码429(请求太多)。根据不同的使用情况,我们可能会将速率受限的请求排队等候以后处理。 例如,如果一些订单由于系统过载而受到速率限制,我们可以保留这些订单以便以后处理。

限流器请求头

一个客户如何知道它是否被节流?客户端如何知道在被节流之前允许的剩余请求的数量?答案就在HTTP响应头中。限流器向客户端返回以下 HTTP 标头:

- X-Ratelimit-Remaining:窗口内允许请求的剩余数量

- X-Ratelimit-limit:它表示客户端在每个时间窗口可以进行多少次调用

- X-Ratelimit-Retry-After:等待的秒数,直到你可以再次提出请求而不被节流。

当用户发送过多请求时,将向客户端返回 429 too many requests 错误和 X-Ratelimit-Retry-After 标头。

详细设计

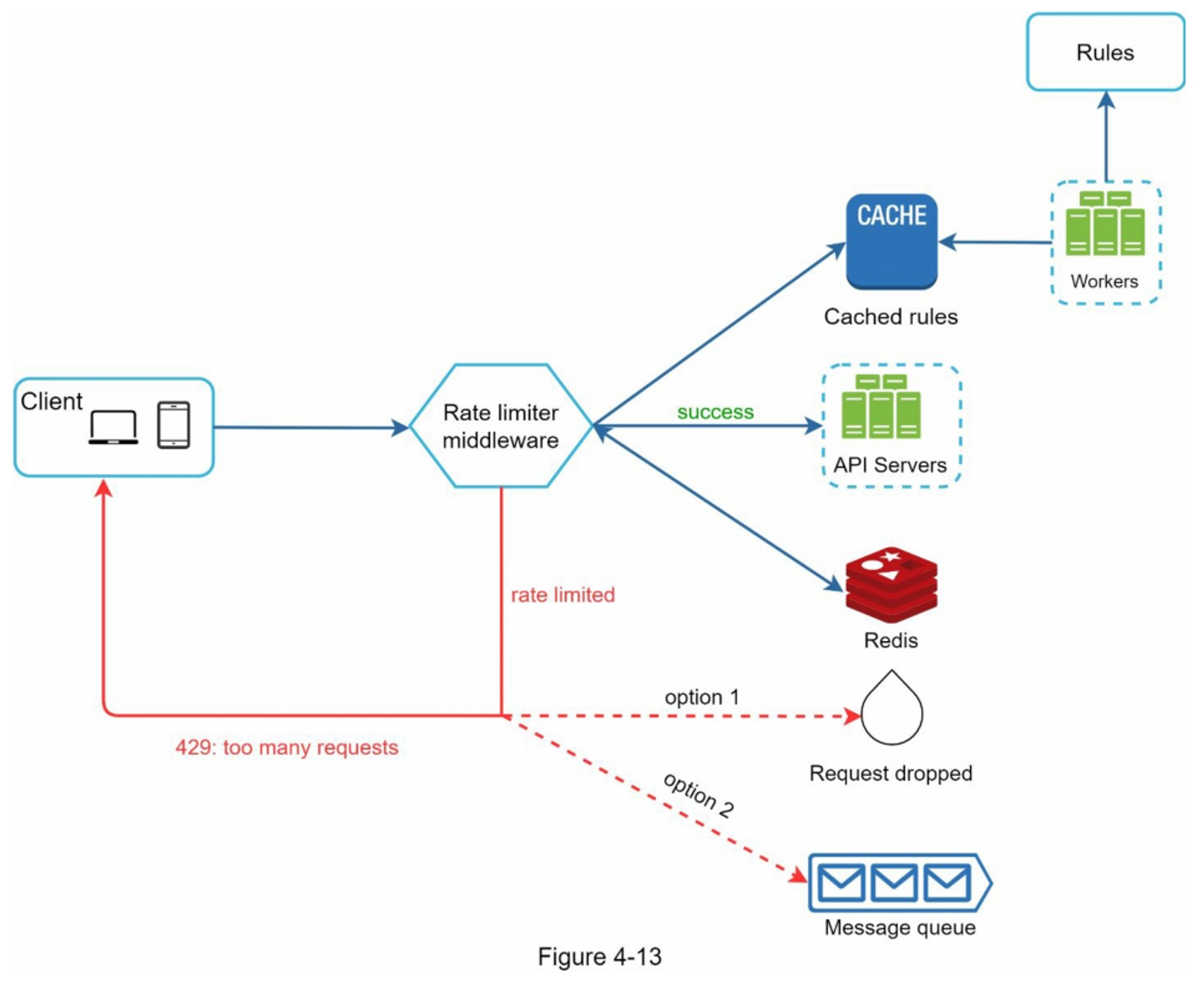

图 4-13 给出了系统的详细设计。

- 规则被存储在磁盘上。工作者经常从磁盘中提取规则,并将其存储在高速缓存中。

- 当客户端向服务器发送请求时,该请求首先被发送到限流中间件。

- 限流中间件从缓存中加载规则。它从Redis缓存中获取计数器和最后一次请求的时间戳。根据响应,限流器决定:

- 如果请求没有速率限制,它将被转发到API服务器。

- 如果请求受到速率限制,限流器会向客户端返回 429 too many requests 错误。 同时,请求被丢弃或转发到队列。

分布式环境下的限流器

构建一个在单个服务器环境下运行的限流器并不困难。然而,将系统扩展到支持多个服务器和并发线程是另一回事。这里有两个挑战:

- 竞争条件

- 同步问题

竞争条件

如前所述,限流器在高层的工作原理如下

- 从Redis读取计数器的值

- 检查 ( 计数器 + 1 ) 是否超过阈值

- 如果不是,则将 Redis 中的计数器值加 1

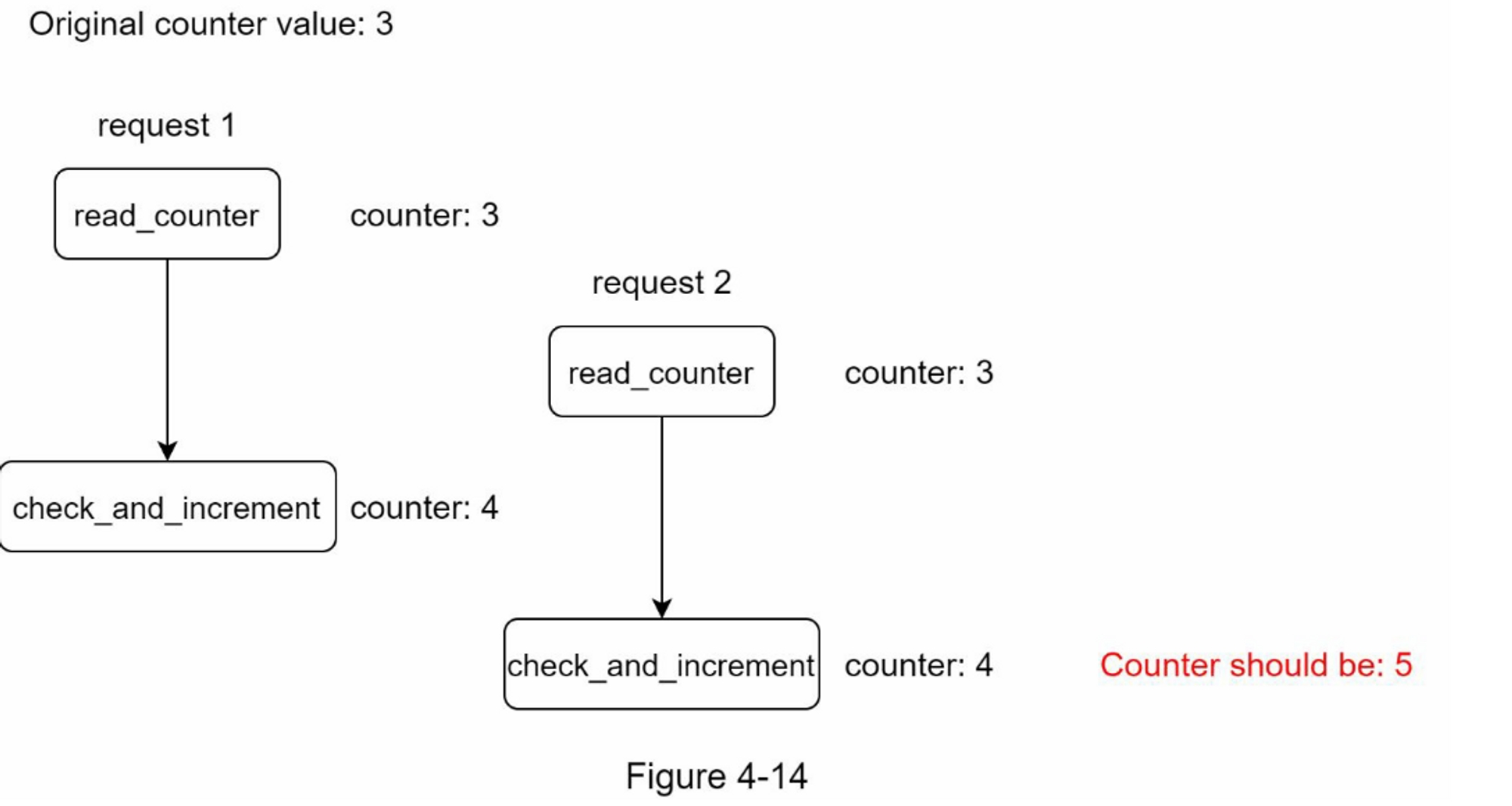

如图4-14所示,在高度并发的环境中会发生竞争条件。

假设 Redis 中的计数器值为 3。如果两个请求在其中一个请求写回值之前同时读取计数器值,则每个请求都会将计数器加 1 并在不检查另一个线程的情况下将其写回。 两个请求(线程)都认为它们具有正确的计数器值 4。但是,正确的计数器值应该是 5

锁是解决竞争条件最明显的解决方案。 但是,锁会显着降低系统速度。 通常使用两种策略来解决这个问题: Lua 脚本 [13] 和 Redis [8] 中的 sorted sets 数据结构。 对这些策略感兴趣的读者可以参考相应的参考资料[8] [13]。

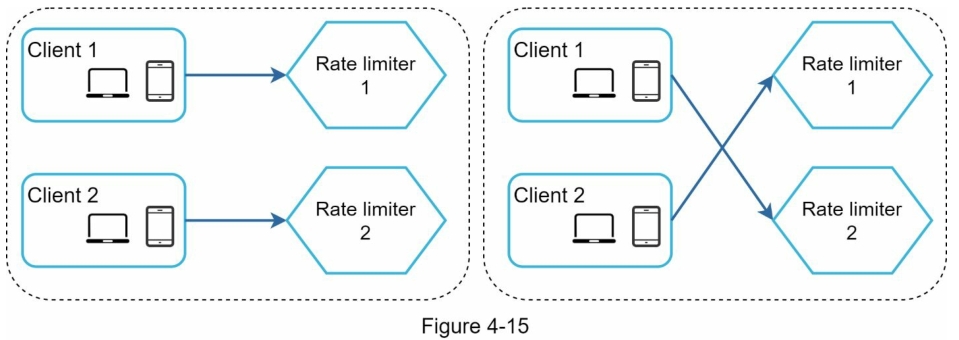

同步问题

同步是分布式环境中要考虑的另一个重要因素。 要支持数百万用户,一个限流器服务器可能不足以处理流量。 当使用多个限流器服务器时,需要同步。 例如,在图 4-15 的左侧,客户端 1 将请求发送到限流器 1,客户端 2 将请求发送到限流器 2。 由于 Web 层是无状态的,客户端可以将请求发送到不同的限流器,如图所示,在图 4-15 的右侧。 如果没有发生同步,限流器 1 不包含有关客户端 2 的任何数据。因此,限流器无法正常工作。

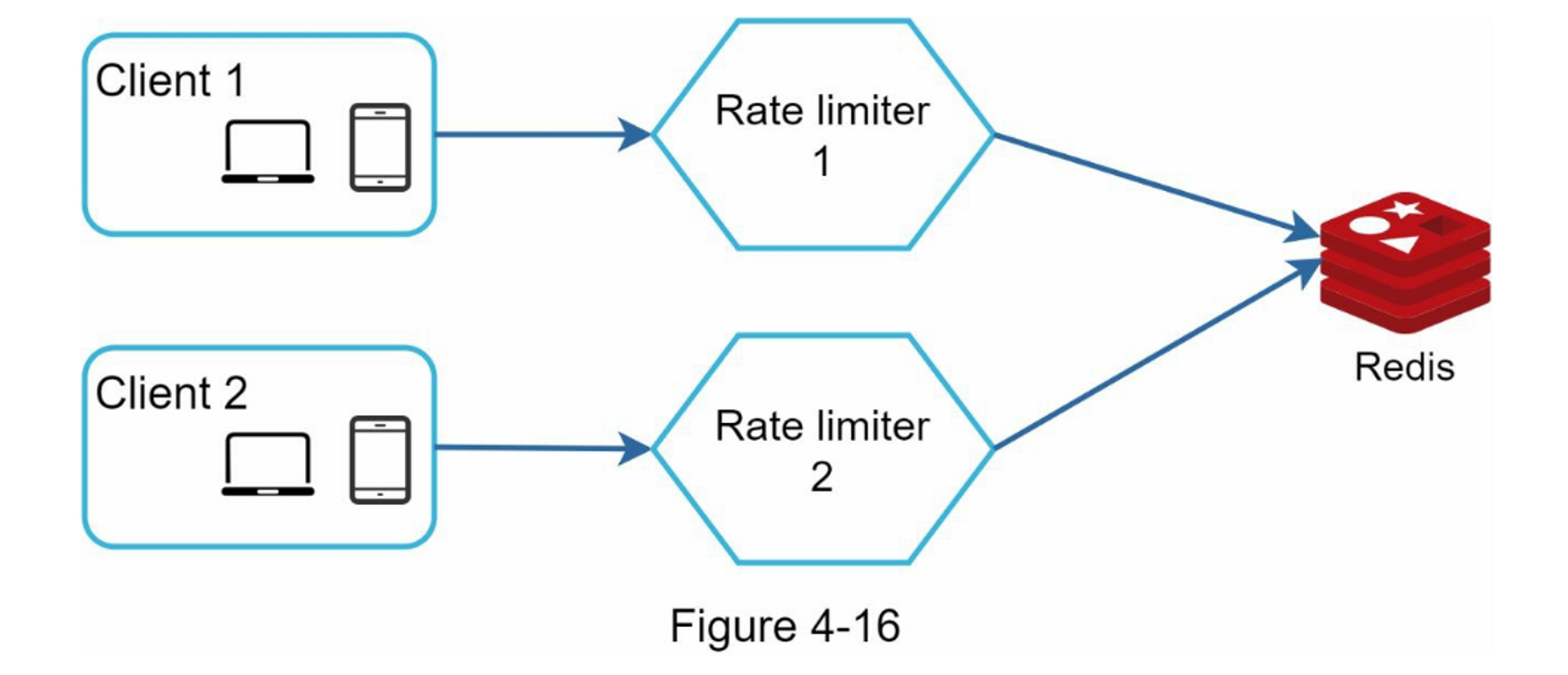

一种可能的解决方案是使用粘性会话,允许客户端将流量发送到相同的限流器。 这个解决方案是不可取的,因为它既不可扩展也不灵活。 更好的方法是使用像 Redis 这样的集中式数据存储。

设计如图 4-16 所示:

性能优化

性能优化是系统设计面试中的一个常见话题。我们将涉及两个方面的改进。

首先,多数据中心的设置对限流器至关重要,因为对于远离数据中心的用户来说,延迟很高。大多数云服务提供商在世界各地建立了许多边缘服务器位置。 例如,截至2020年5月20日,Cloudflare有194个地理上分布的边缘服务器[14]。流量被自动路由到最近的边缘服务器,以减少延时。

第二,用最终的一致性模型来同步数据。如果你不清楚最终的一致性模型,请参考 "第6章:设计一个键值存储 "中的 "一致性 "部分。

监控

限流器到位后,最重要的是要收集分析数据以检查限流器是否有效。

首先,我们要确保:

- 限流算法是有效的

- 限流规则是有效的

例如,如果速率限制规则过于严格,则会丢弃许多有效请求。 在这种情况下,我们想稍微放宽规则。 在另一个示例中,我们注意到当流量突然增加时(如抢购),我们的限流器变得无效。 在这种场景下,我们可能会更换算法来支持突发流量。 令牌桶很适合这种场景。

第4步:总结

在这一章中,我们讨论了速率限制的不同算法和它们的优点和缺点。

讨论的算法包括:

- 令牌桶

- 漏桶

- 固定窗口计数器

- 滑动窗口日志

- 滑动窗口计数器

然后,我们讨论了系统架构、分布式环境中的限流器、性能优化和监控。 与任何系统设计面试问题类似,如果时间允许,您可以提及其他谈话要点:

- 硬件 与 软件限流对比

- 硬件:请求的数量不能超过阈值

- 软件:请求可以在短时间内超过阈值

- 不同级别的限流。在本章中,我们只讨论了应用程序级别(HTTP:第 7 层)的限流,可以在其他层应用限流。例如,你可以使用Iptables[15](IP:第3层)按IP地址应用速率限制。 注意:开放系统互连模型(OSI模型)有7层[16]。第1层:物理层,第2层:数据链路层,第3层:网络层,第4层:传输层,第5层:会话层,第6层:表示层,第7层:应用层。

- 避免被限速,使用最佳实践设计你的客户端:

- 使用客户端缓存,以避免频繁调用API

- 了解限制,不要在短时间内发送太多请求

- 包含捕获异常或错误的代码,以便客户端可以从异常中恢复正常

- 为重试逻辑增加足够的回退时间

恭喜你走到了这一步!现在给自己一个鼓励,干得漂亮!

参考资料

[1] Rate-limiting strategies and techniques: https://cloud.google.com/solutions/rate-limiting-strategies-techniques

[2] Twitter rate limits: https://developer.twitter.com/en/docs/basics/rate-limits

[3] Google docs usage limits: https://developers.google.com/docs/api/limits

[4] IBM microservices: https://www.ibm.com/cloud/learn/microservices

[5] Throttle API requests for better throughput:

https://docs.aws.amazon.com/apigateway/latest/developerguide/api-gateway-request-throttling.html

[6] Stripe rate limiters: https://stripe.com/blog/rate-limiters

[7] Shopify REST Admin API rate limits: https://help.shopify.com/en/api/reference/rest-admin-api-rate-limits

[8] Better Rate Limiting With Redis Sorted Sets: https://engineering.classdojo.com/blog/2015/02/06/rolling-rate-limiter/

[9] System Design — Rate limiter and Data modelling: https://medium.com/@saisandeepmopuri/system-design-rate-limiter-and-data-modelling-9304b0d18250

[10] How we built rate limiting capable of scaling to millions of domains: https://blog.cloudflare.com/counting-things-a-lot-of-different-things/

[11] Redis website: https://redis.io/

[12] Lyft rate limiting: https://github.com/lyft/ratelimit

[13] Scaling your API with rate limiters: https://gist.github.com/ptarjan/e38f45f2dfe601419ca3af937fff574d#request-rate-limiter

[14] What is edge computing: https://www.cloudflare.com/learning/serverless/glossary/what-is-edge-computing/

[15] Rate Limit Requests with Iptables: https://blog.programster.org/rate-limit-requests-with-iptables

[16] OSI model: https://en.wikipedia.org/wiki/OSI_model#Layer_architecture

第05章:一致性hash设计

为了实现水平扩展,在服务器之间高效、均匀地分配请求/数据非常重要。一致哈希是实现这一目标的常用技术。但首先,让我们深入研究一下这个问题。

再哈希问题

如果你有n个缓存服务器,平衡负载的一个常用方法是使用以下哈希方法:

$$serverIndex = hash(key) \bmod N$$,其中N是服务器池的大小

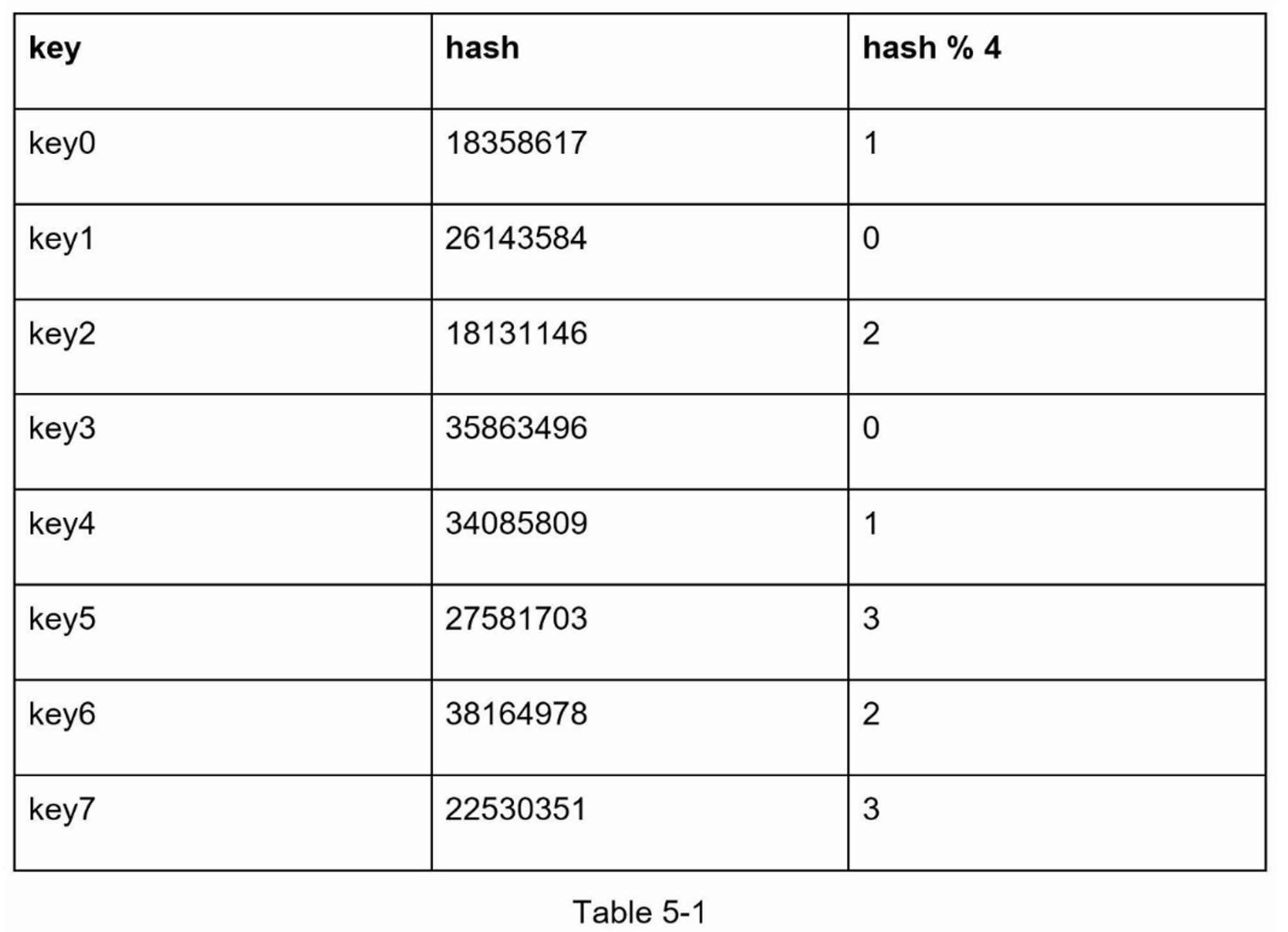

让我们用一个例子来说明它是如何工作的。如表5-1所示,我们有4个服务器和8个字符串键及其哈希值。

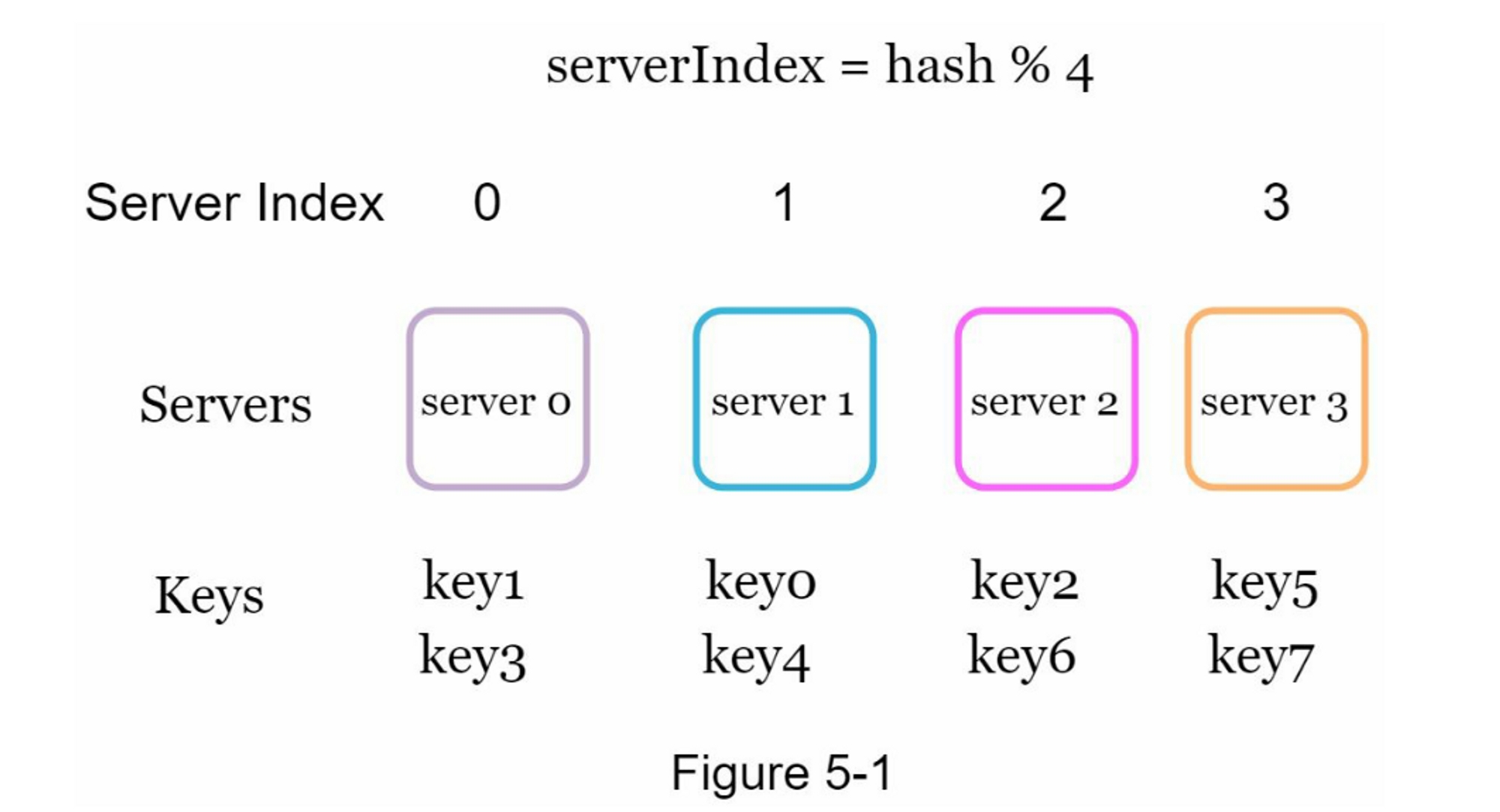

为了获取存储键的服务器,我们进行求余操作 $$f(key) \bmod 4$$。例如, $$hash(key0) \bmod 4 = 1$$ 意味着客户端必须联系服务器1来获取缓存的数据。图5-1显示了基于表5-1的键的分布情况

当服务器池的大小是固定的,而且数据分布均匀时,这种方法效果很好。然而,当增加新的服务器,或删除现有的服务器时,问题就会出现。

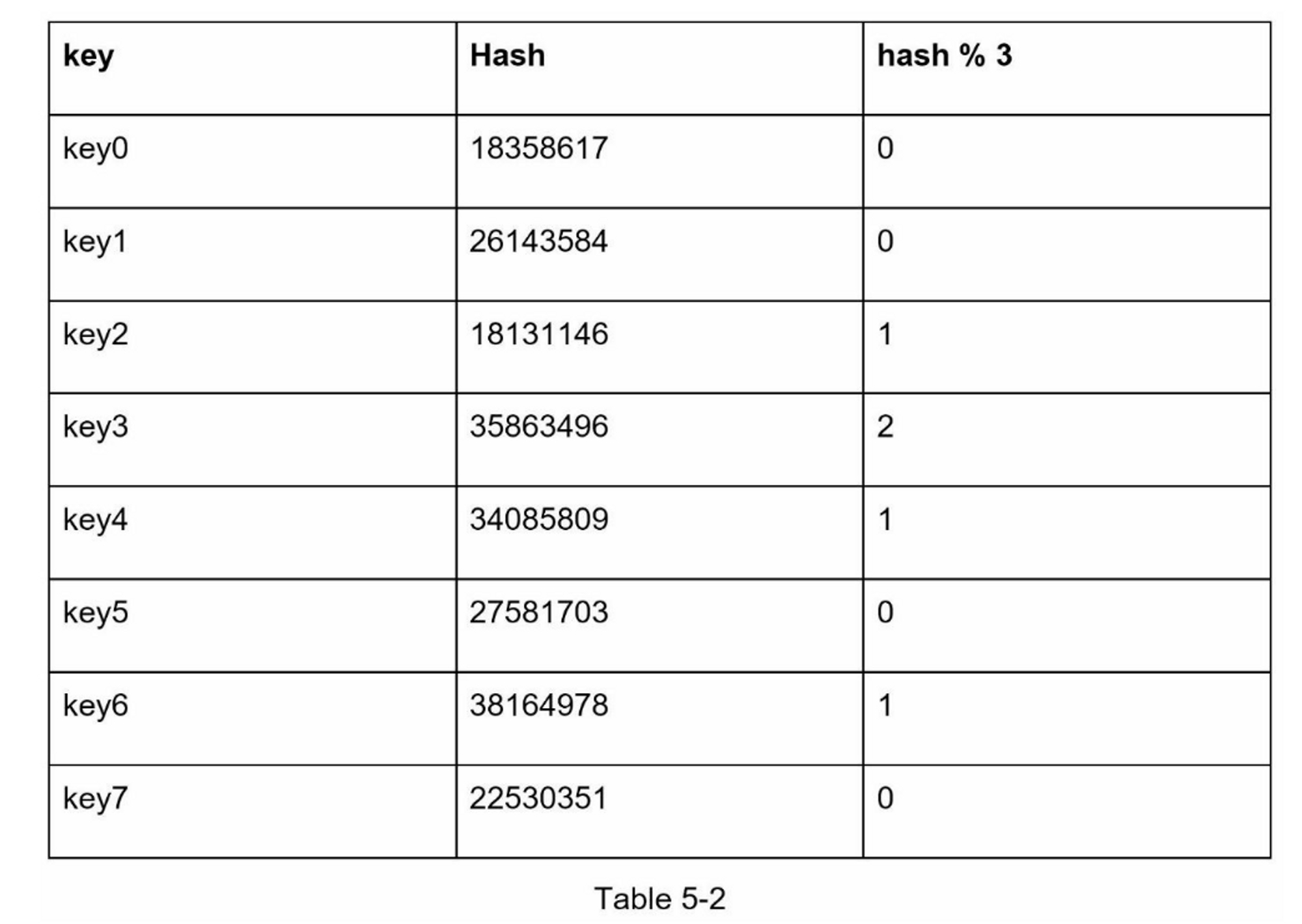

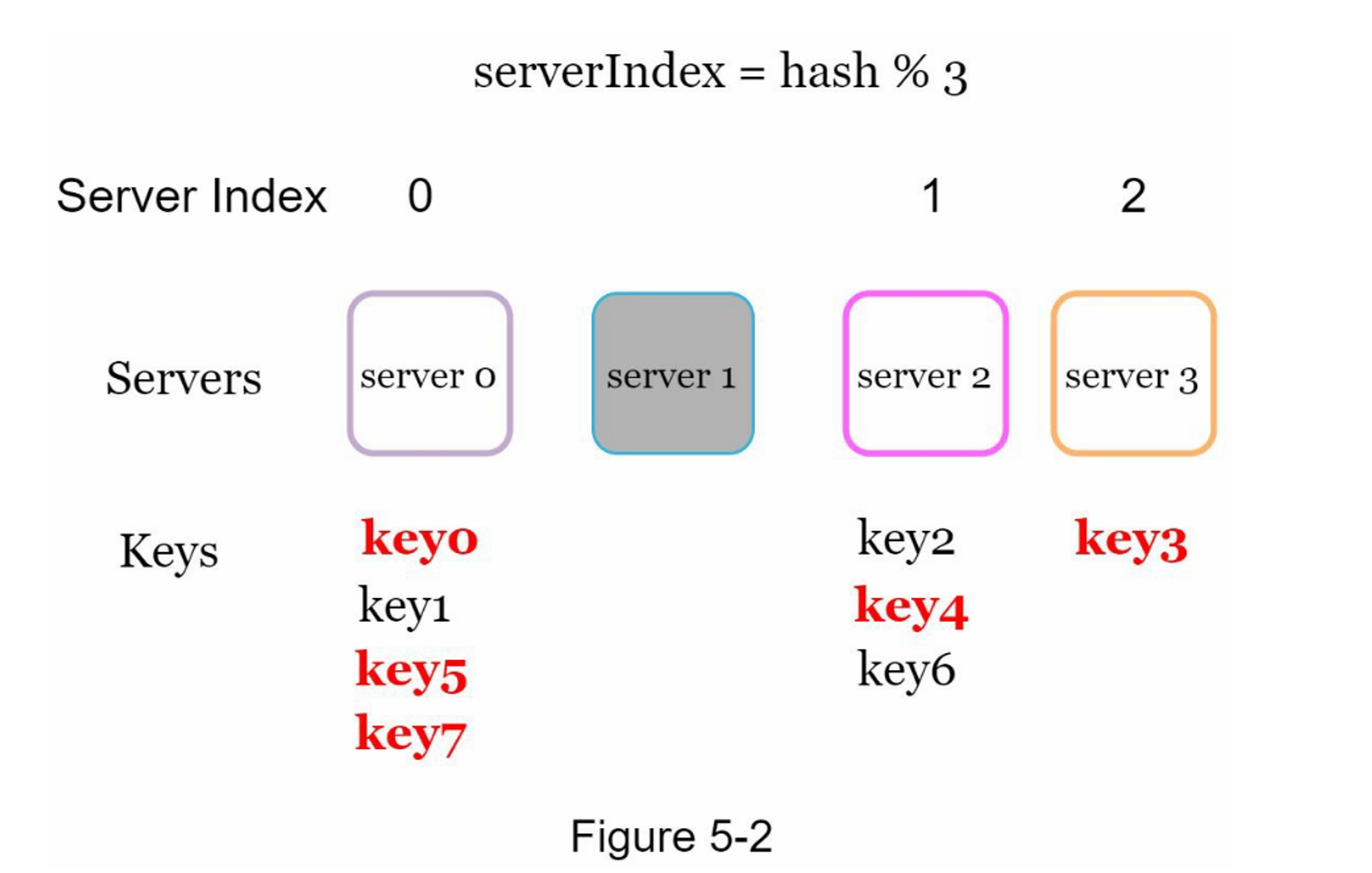

例如,如果服务器1下线了,服务器池的大小就变成了 3。使用相同的哈希函数,我们得到的键的哈希值是相同的。 但是应用求余操作,我们会得到不同的服务器索引,因为服务器的数量减少了 1。 通过应用 $$hash \bmod 3$$,我们得到的结果如表5-2所示:

图5-2显示了基于表5-2的新的键分布。

如图5-2所示,大多数键都被重新分配,而不仅仅是最初存储在脱机服务器(服务器1)中的键。 这意味着,当服务器1离线时,大多数缓存客户会连接到错误的服务器来获取数据,这就造成了高速缓存失误的风暴。一致性哈希是一种有效的技术来缓解这个问题。

一致性哈希

引用自维基百科:“一致性哈希是一种特殊的哈希,当重新调整哈希表的大小并使用一致性哈希时,平均只需要重新映射 $$k/n$$ 个键,其中 $$k$$ 是键的数量, $$n$$ 是槽的数量。 相比之下,在大多数传统的哈希表中,数组槽数量的变化导致几乎所有键都被重新映射 [1]”

哈希空间和哈希环

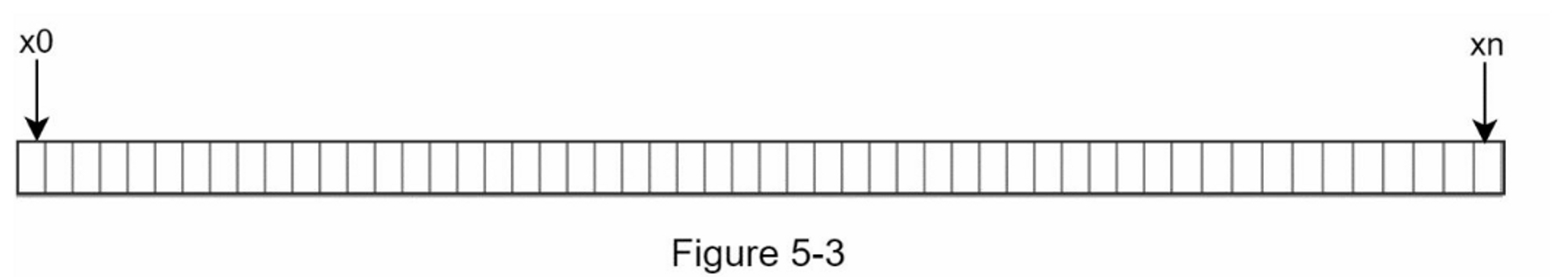

现在我们了解了一致性哈希的定义,让我们看看它是如何工作的。假设使用SHA-1作为哈希函数f,哈希函数的输出范围为: $$x_0,x_1,x_2,x_3,...,x_n$$。 在密码学中,SHA-1 的哈希空间从 $$0$$ 到 $$2^{160} – 1$$。也就是说, $$x_0$$ 对应 $$0$$, $$x_n$$ 对应 $$2^{160} – 1$$,中间的所有其他哈希值都在 $$0$$ 和 $$2^{160} – 1$$ 之间。 图 5-3 显示了哈希空间。

通过收集两端,我们得到一个哈希环,如图5-4所示:

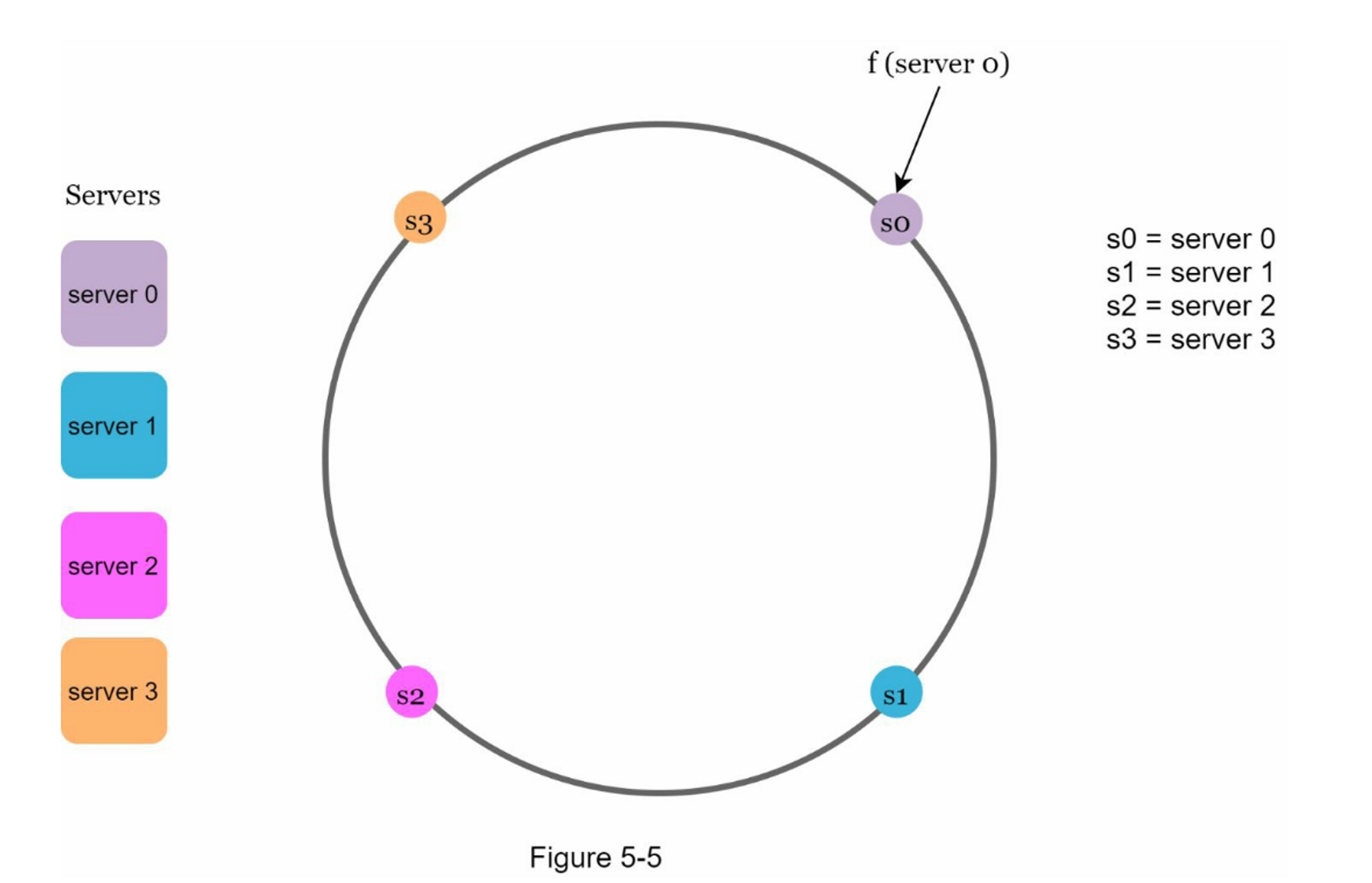

哈希服务器

使用相同的哈希函数 f,我们根据服务器的 IP 或名称将服务器映射到环上。 图 5-5 显示哈希环上映射了 4 个服务器

哈希键

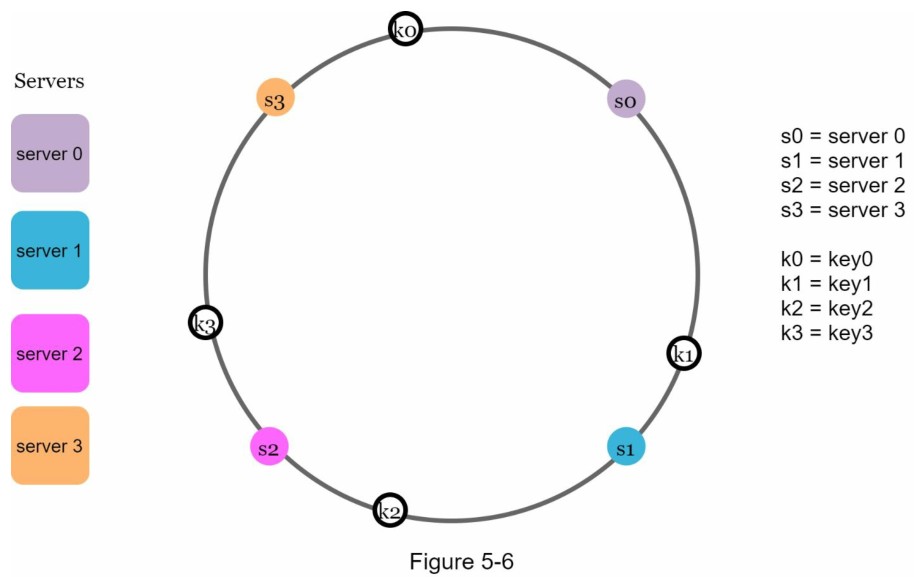

值得一提的是,这里使用的哈希函数与“rehashing problem”中的哈希函数不同,没有模运算。 如图5-6所示,4个缓存键(key0、key1、key2、key3)被哈希到哈希环Server lookup。

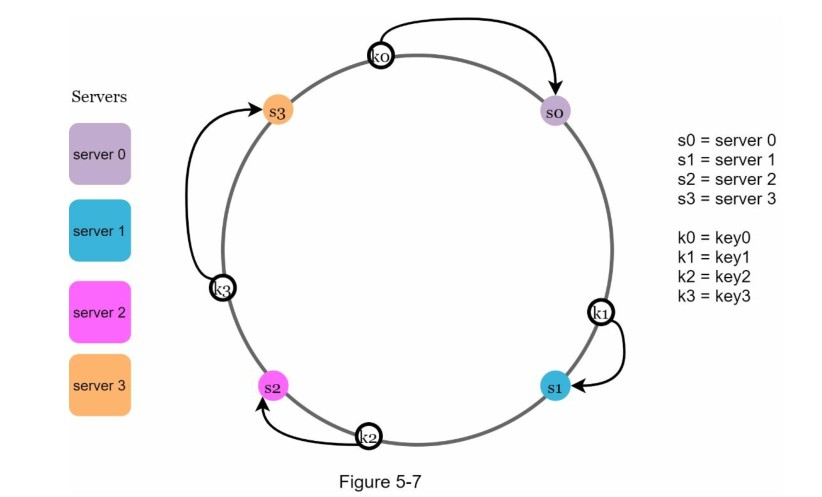

服务器查找

为了确定键存放在哪个服务器上,我们从键在环上的位置顺时针查找,直到找到一个服务器。 图5-7解释了这个过程。顺时针方向查找,key0存储在server0;key1存储在server1;key2存储在server2,key3存储在server3。

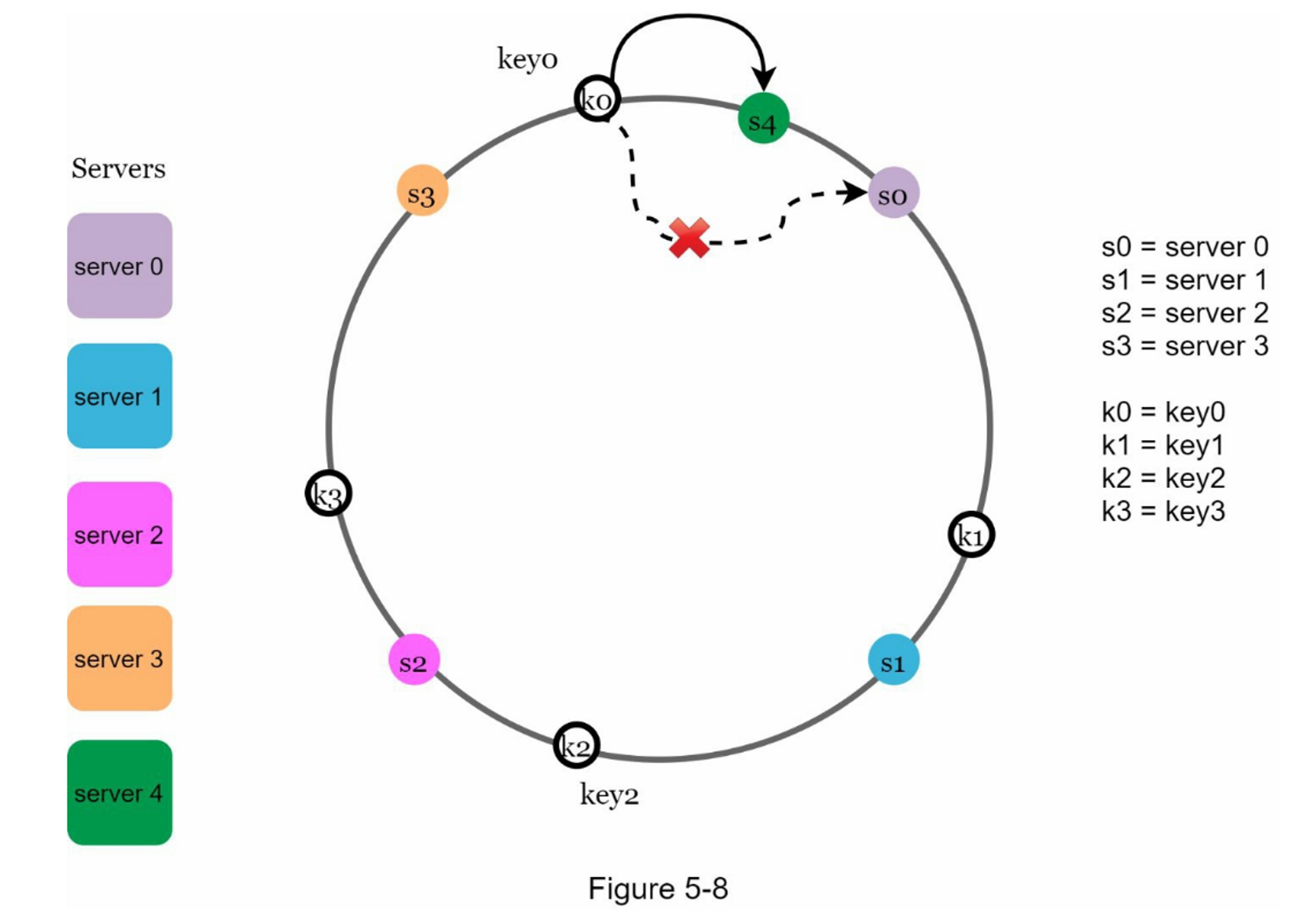

添加一台服务器

使用上述逻辑,增加一台新的服务器将只需要重新分配一部分的键。

在图5-8中,新增server4后,只需要重新分配key0即可。 k1、k2 和 k3 保留在相同的服务器上。 让我们仔细看看其中的逻辑,在加入server4之前,key0是存放在server0上的。现在key0会存放在server4上,因为server4是从key0在环上顺时针方向第一个遇到的server。 根据一致性哈希算法,其他键不会被重新分配。

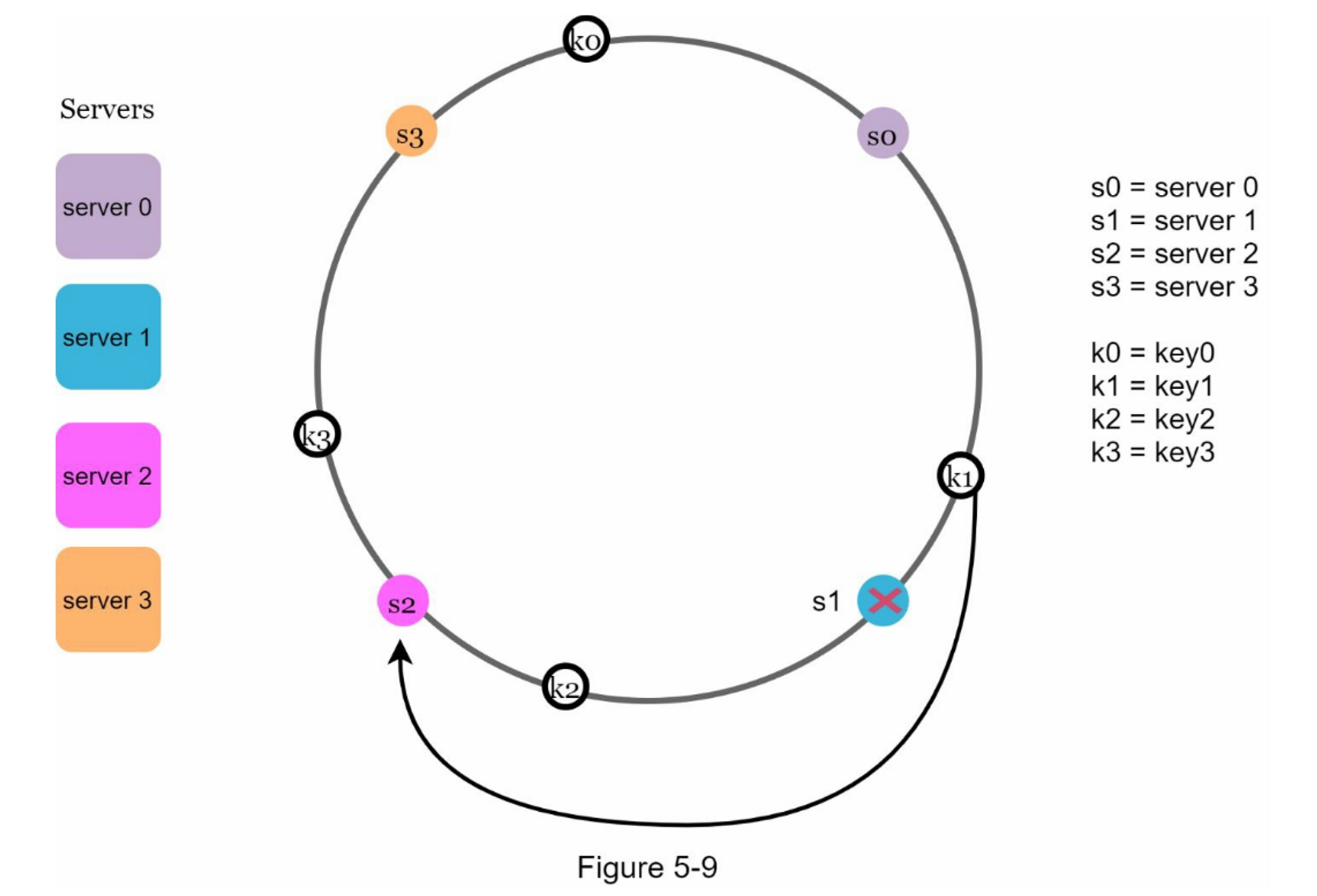

移除一台服务器

当一台服务器被移除时,只有一小部分的键需要用一致的哈希法进行重新分配。 在图5-9中,当server1被移除时,只有key1必须被重新映射到server2。 其余的键不受影响。

基本方法中的两个问题

一致哈希算法是由麻省理工学院的Karger等人提出的[1]。

基本步骤如下:

- 使用均匀分布的哈希函数将服务器和键映射到环上。

- 要想知道一个键被映射到哪个服务器,从键的位置顺时针查找,直到找到环上的第一个服务器。

这种方法存在两个问题:

-

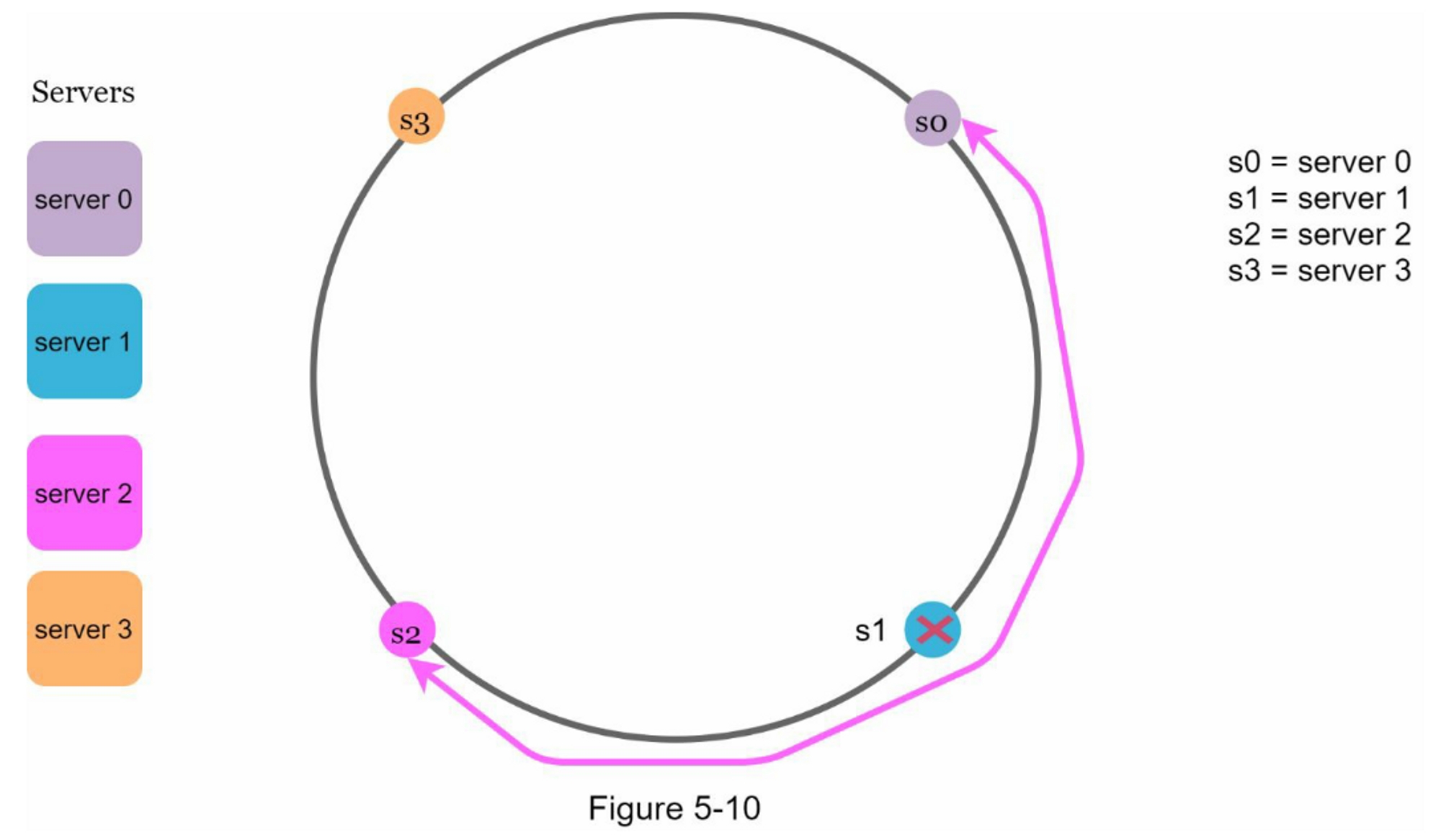

首先,考虑到可以添加或删除服务器,不可能保持环上所有服务器的分区大小相同。 分区是相邻服务器之间的哈希空间。 分配给每个服务器的环上分区的大小可能非常小或相当大。在图5-10中,如果删除s1,s2的分区(用双向箭头突出显示)是s0和s3分区的两倍。

-

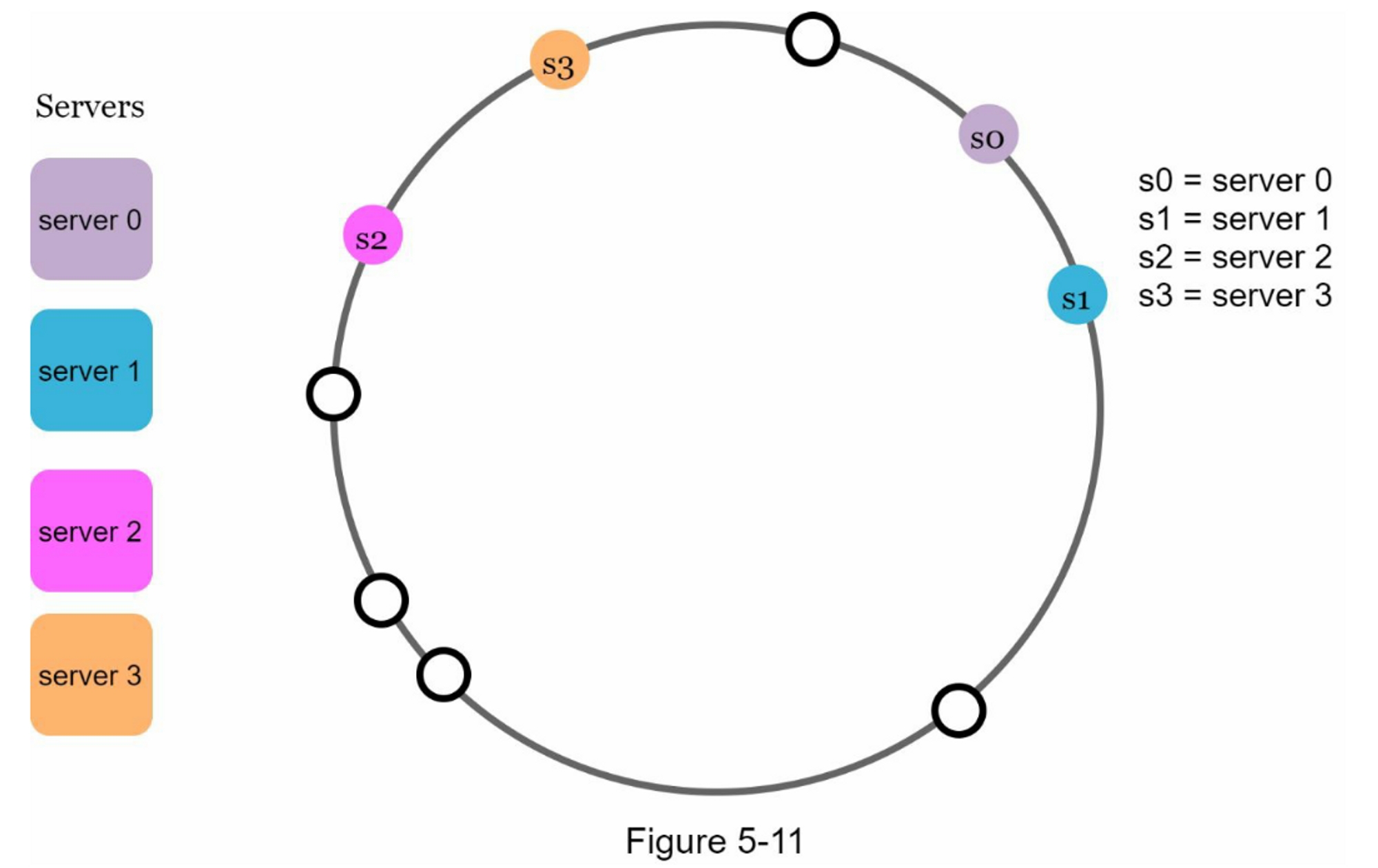

第二,在环上有可能出现不均匀的键分布。例如,如果服务器被映射到图5-11中所列的位置,大部分的密钥都存储在

serve2上。然而,server1和serser3没有数据。

一种叫做虚拟节点或复制的技术被用来解决这些问题

虚拟节点

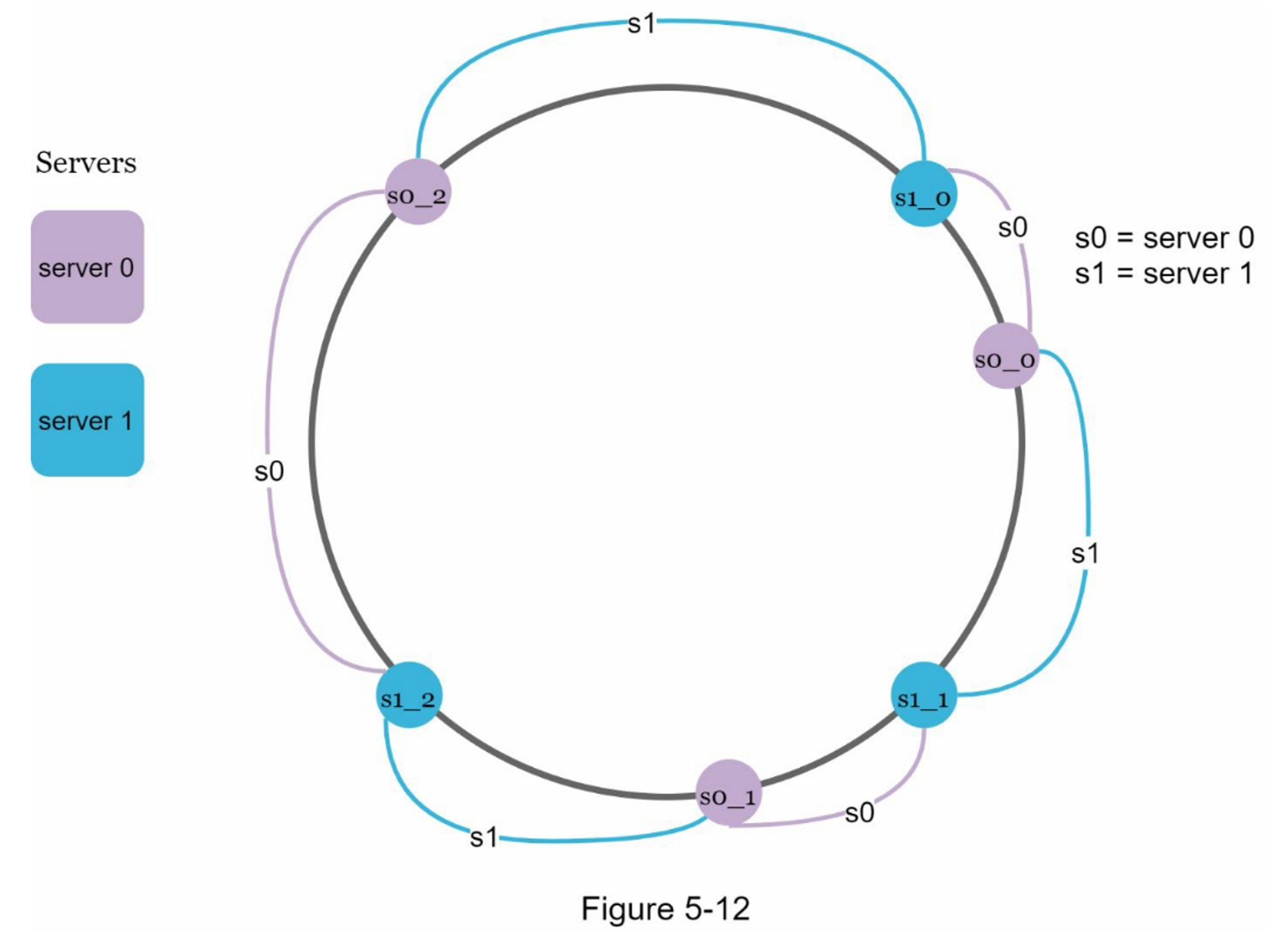

虚拟节点是指真实节点,每个服务器由环上的多个虚拟节点表示。在图5-12中,server0和server1都有3个虚拟节点。 3是任意选择的;而在现实世界的系统中,虚拟节点的数量要大得多。我们不用s0,而是用s0_0、s0_1和s0_2来代表环上的server0。 同样地,s1_0、s1_1和s1_2代表环上的server1。通过虚拟节点,每个服务器负责多个分区。标签为s0的分区(边)由server0管理。 另一方面,标签为s1的分区则由server1管理。

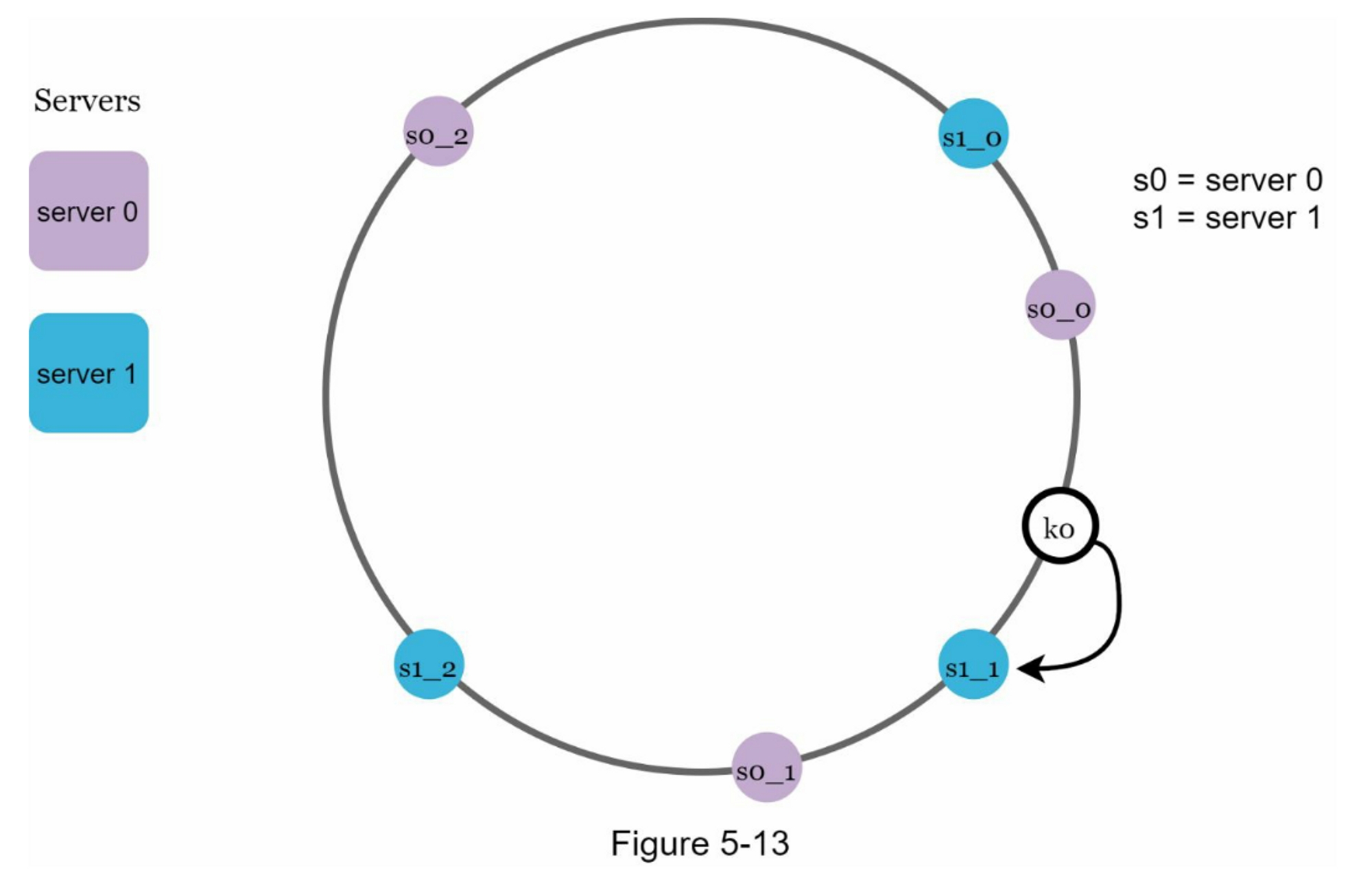

为了找到键存储在哪个服务器上,我们从键的位置顺时针方向找到环上遇到的第一个虚拟节点。 在图5-13中,为了找出k0存储在哪个服务器上,我们从k0的位置顺时针方向找到虚拟节点s1_1,它就是是server1。

随着虚拟节点数量的增加,密钥的分布变得更加均衡。 这是因为随着虚拟节点数量的增加,标准偏差变小,导致数据分布更加均衡。 标准偏差衡量数据的离散程度。 一项在线研究 [2] 的实验结果显示,对于一两百个虚拟节点,标准偏差在均值的 5%(200 个虚拟节点)和 10%(100 个虚拟节点)之间。 当我们增加虚拟节点的数量时,标准偏差会更小。 但是,需要更多空间来存储有关虚拟节点的数据。 这是一个权衡,我们可以调整虚拟节点的数量以满足我们的系统要求。

找出受影响的键

当一个服务器被添加或删除时,有一部分数据需要重新分配。我们怎样才能找到受影响的范围来重新分配?

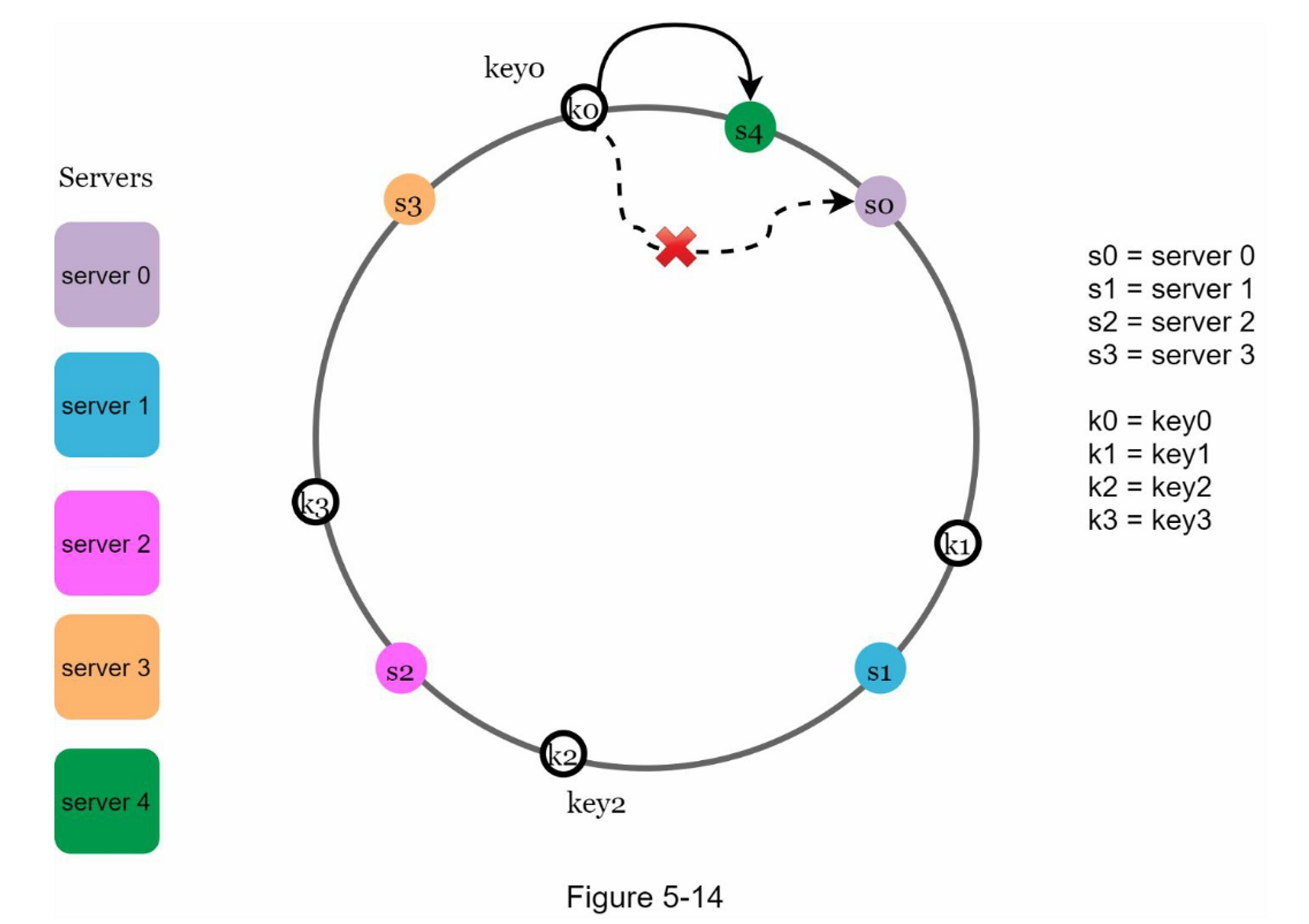

在图5-14中,Server 4加入环中。 受影响的范围从 s4(新添加的节点)开始并沿环逆时针方向移动,直到找到服务器(s3)。 因此,位于 s3 和 s4 之间的键需要重新分配给 s4。

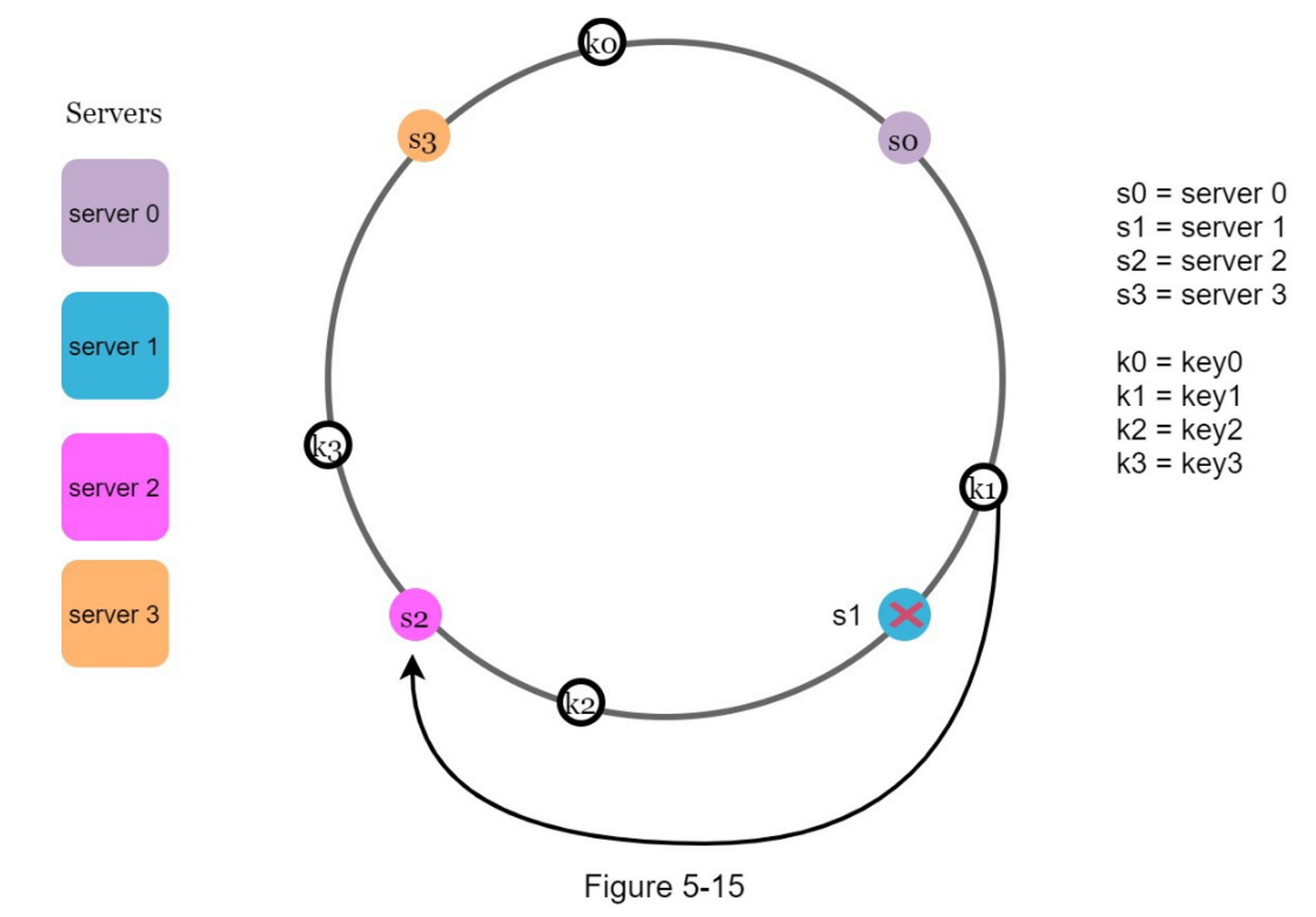

如图 5-15 所示,当一个服务器(s1)被移除时,受影响的范围从 s1(被移除的节点)开始并沿环逆时针方向移动,直到找到一个服务器(s0)。 因此,位于 s0 和 s1 之间的密钥必须重新分配给 s2。

总结

在这一章中,我们深入讨论了一致性哈希,包括为什么需要它以及它是如何工作的。

一致性哈希的好处包括:

- 当服务器被添加或删除时,很小一部分的键被重新分配。

- 容易水平扩展,因为数据分布更加均匀。

- 缓解热点健问题。 对特定分片的过度访问可能会导致服务器过载。 想象一下 Katy Perry、Justin Bieber 和 Lady Gaga 的数据最终都在同一个分片上。 一致性哈希通过更均匀地分配数据来缓解这个问题。

一致性哈希广泛用于现实世界的系统,包括一些著名的系统:

- 亚马逊 Dynamo 数据库的分区组件 [3]

- Apache Cassandra 中跨集群的数据分区 [4]

- Discord 聊天应用 [5]

- Akamai 内容分发网络 [6]

- Maglev 网络负载均衡器 [7]

恭喜你走到了这一步!现在给自己一个鼓励,干得漂亮!

参考资料

[1] Consistent hashing: https://en.wikipedia.org/wiki/Consistent_hashing

[2] Consistent Hashing:

https://tom-e-white.com/2007/11/consistent-hashing.html

[3] Dynamo: Amazon’s Highly Available Key-value Store:

https://www.allthingsdistributed.com/files/amazon-dynamo-sosp2007.pdf

[4] Cassandra - A Decentralized Structured Storage System:

http://www.cs.cornell.edu/Projects/ladis2009/papers/Lakshman-ladis2009.PDF

[5] How Discord Scaled Elixir to 5,000,000 Concurrent Users:

https://blog.discord.com/scaling-elixir-f9b8e1e7c29b

[6] CS168: The Modern Algorithmic Toolbox Lecture #1: Introduction and Consistent Hashing:

http://theory.stanford.edu/~tim/s16/l/l1.pdf

[7] Maglev: A Fast and Reliable Software Network Load Balancer:

https://static.googleusercontent.com/media/research.google.com/en//pubs/archive/44824.pdf

第06章:key-value 存储设计

键值存储,也称为键值数据库,是一种非关系数据库。每个唯一标识符都存储为一个键及其关联值,这种数据配对称为“键值”对。

在键值对中,键必须是唯一的,通过键可以访问与键关联的值。键可以是纯文本或散列值。出于性能原因,短键效果更好。键是什么样子的?

- 纯文本键:“last_logged_in_at”

- 哈希键:253DDEC4

键值对中的值可以是字符串、列表、对象等。在键值存储中,值通常被视为不透明的对象,如Amazon dynamo [1], Memcached [2], Redis [3], 等。

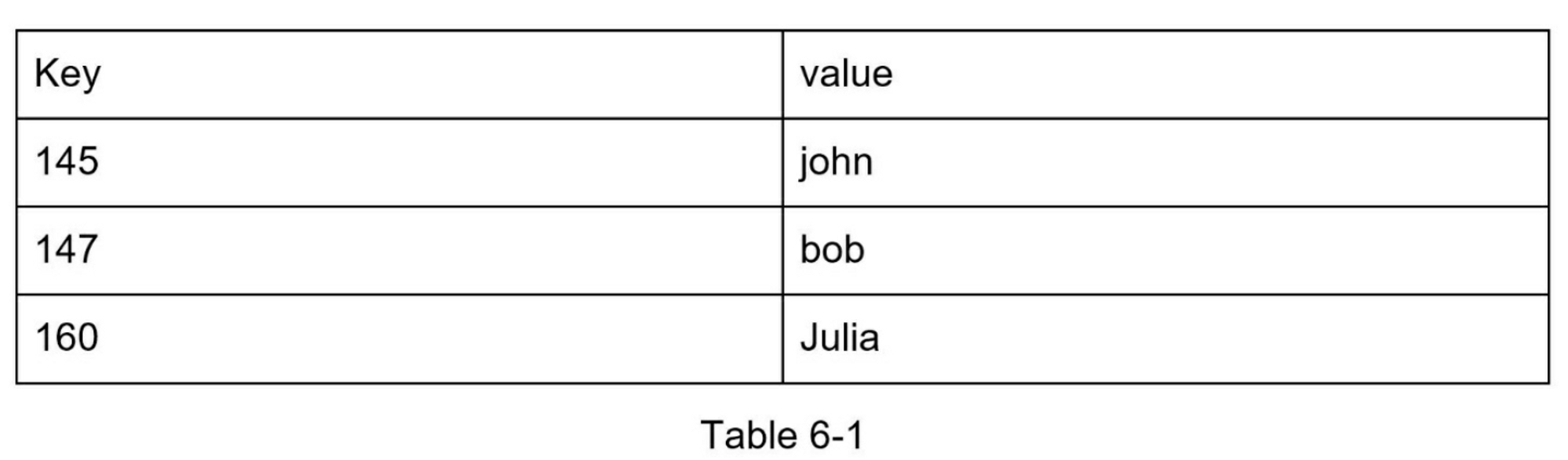

下面是一个键值存储中的数据片段:

在本章中,你需要设计一个支持以下操作的键值存储:

put(key, value)// 插入与“key”关联的“value”get(key)// 获取与“key”关联的“value”

理解问题并确定设计范围

这里没有完美的设计。每种设计都在读取、写入和内存使用方面取得了特定的权衡。必须在一致性和可用性之间做出另一个权衡。

在本章中,我们设计了一个包含以下特征的键值存储:

- 键值对的大小很小:不到 10 KB。

- 有能力存储大数据。

- 高可用性:系统响应迅速,即使在出现故障时也是如此。

- 高可扩展性:系统可以扩展以支持大数据集。

- 自动缩放:服务器的添加/删除应该根据流量自动进行。

- 可调节的一致性。

- 低延迟。

单一服务器的键值存储

开发一个驻扎在单个服务器中的键值存储很容易,一种直观的方法是将键值对存储在哈希表中,该哈希表将所有内容保存在内存中。

为了在一个服务器中容纳更多的数据,可以做两个优化措施:

- 数据压缩

- 只在内存中存储经常使用的数据,其余的存储在磁盘上

即使进行了这些优化,单个服务器也可以很快达到其容量。需要分布式键值存储来支持大数据

分布式键值存储

分布式键值存储也称为分布式哈希表,它将键值对分布在许多服务器上。在设计分布式系统时,了解 CAP(C一致性、A可用性、P分区容错性)定理很重要。

CAP 定理指出,分布式系统不可能同时提供以下三种保证中的两种以上:一致性、可用性和分区容错性。让我们熟悉一些定义。

一致性:一致性意味着所有客户端无论连接到哪个节点,都在同一时间看到相同的数据。

可用性:可用性意味着即使某些节点已关闭,任何请求数据的客户端都会得到响应。

分区容忍度:分区表示两个节点之间的通信中断,分区容错意味着系统在网络分区的情况下继续运行。

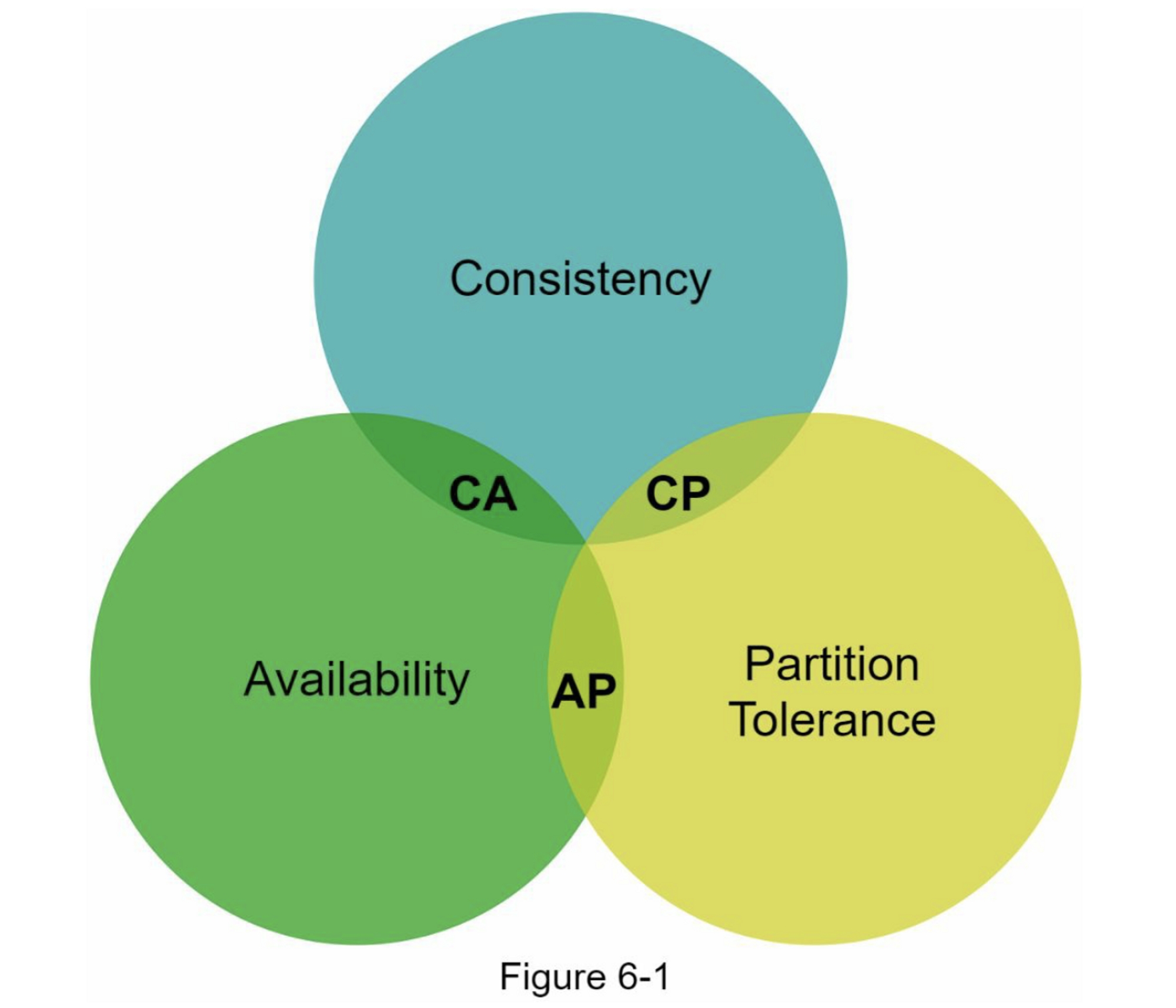

CAP 定理指出,必须牺牲三个属性之一来支持 3 个属性中的 2 个,如图 6-1 所示:

如今,键值存储根据它们支持的两个 CAP 特性进行分类:

CP(一致性和分区容错)系统:CP 键值存储在牺牲可用性的同时支持一致性和分区容错。

AP(可用性和分区容错)系统:AP 键值存储支持可用性和分区容错,同时牺牲一致性

CA(一致性和可用性)系统:CA 键值存储支持一致性和可用性,同时牺牲分区容错性。由于网络故障是不可避免的,分布式系统必须容忍网络分区。因此,CA 系统不能存在于现实世界的应用程序中。

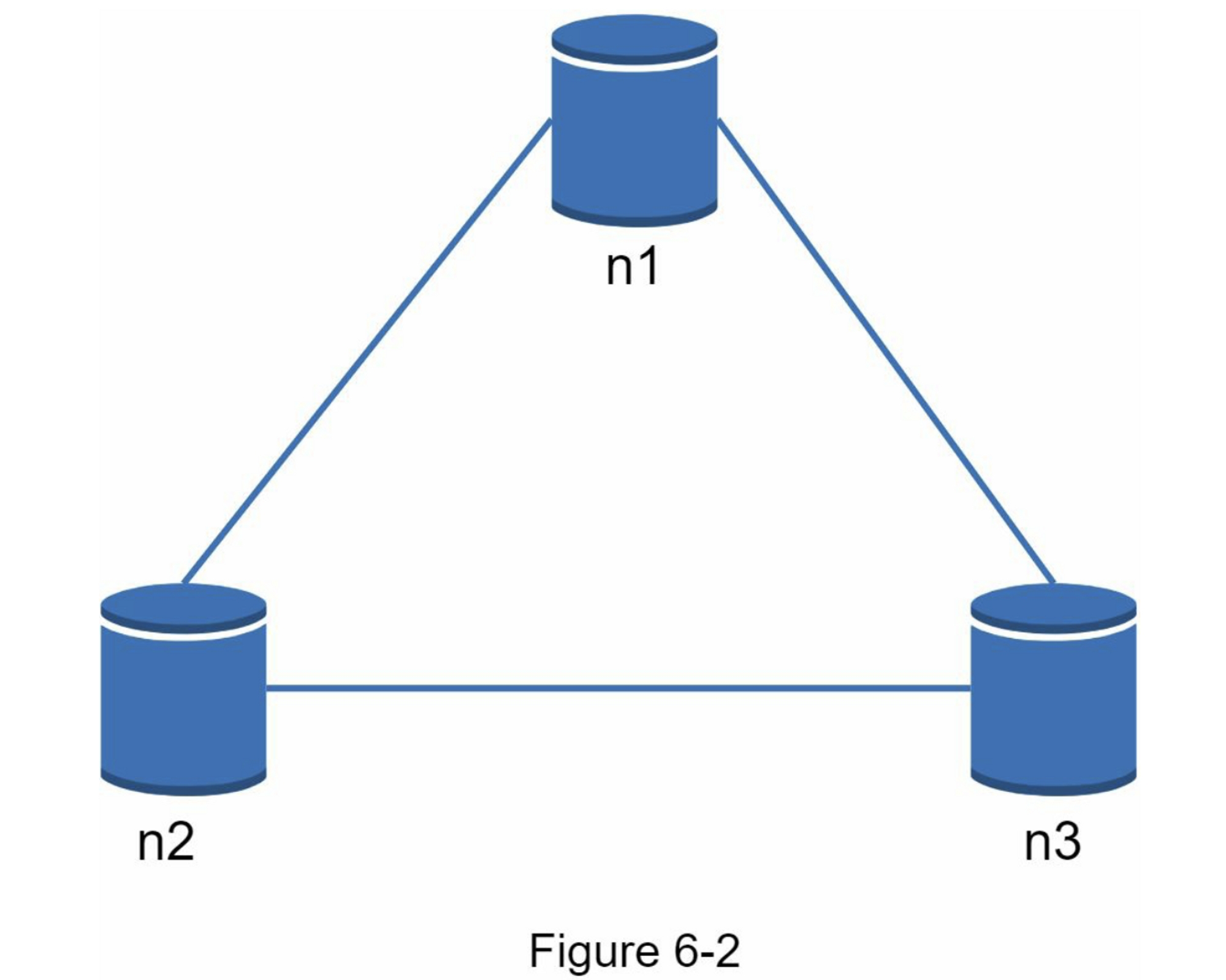

您在上面阅读的内容主要是定义部分。为了更容易理解,让我们看一些具体的例子。在分布式系统中,数据通常会被复制多次。假设数据被复制到三个副本节点n1、n2和n3上,如图6-2所示。

-

理想情况

在理想世界中,网络分区永远不会发生。写入 n1 的数据会自动复制到 n2 和 n3。实现了一致性和可用性。

-

真实世界的分布式系统

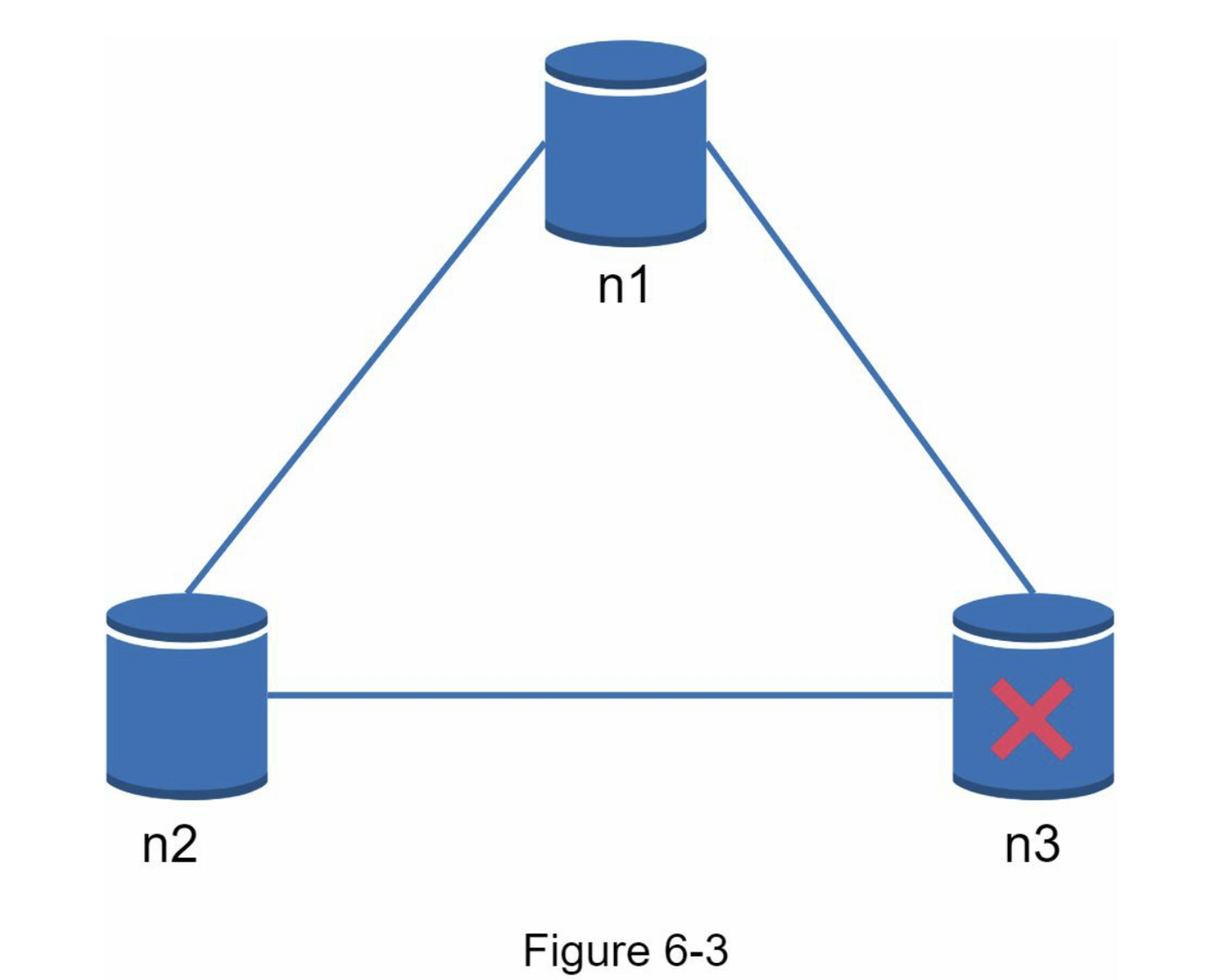

在分布式系统中,分区是不可避免的,当出现分区时,我们必须在一致性和可用性之间做出选择。图6-3中,n3宕机,无法与n1、n2通信。如果客户端将数据写入 n1 或 n2,则数据无法传播到 n3。如果数据写入 n3 但尚未传播到 n1 和 n2,则 n1 和 n2 将具有陈旧数据。

如果我们选择一致性大于可用性(CP系统),我们必须阻止所有对n1和n2的写操作,以避免这三个服务器之间的数据不一致,这使得系统不可用。银行系统通常有极高的一致性要求。例如,对于银行系统来说,显示最新的余额信息是至关重要的。如果由于网络分区而发生不一致,在不一致问题解决之前,银行系统会返回一个错误。

然而,如果我们选择可用性大于一致性(AP系统),系统就会一直接受读取,即使它可能返回陈旧的数据。对于写,n1和n2将继续接受写,当网络分区解决后,数据将被同步到n3。

选择正确的 CAP 以确保适合你的用例是构建分布式键值存储的重要一步。你可以与面试官讨论这个问题并相应地设计系统

系统组件

在本节中,我们将讨论以下用于构建键值存储的核心组件和技术:

- 数据分区

- 数据复制

- 一致性

- 不一致解决方案

- 故障处理

- 系统架构图

- 写入路径

- 读取路径

下面的内容主要基于三个流行的键值存储系统:Dynamo [4]、Cassandra [5] 和 BigTable [6]。

数据分区

对于大型应用程序,将完整的数据集放在单个服务器中是不可行的。实现这一点的最简单方法是将数据拆分为更小的分区并将它们存储在多个服务器中。分区数据时有两个挑战:

- 跨多个服务器平均分配数据。

- 当节点被添加或删除时,尽量减少数据移动。

第 5 章中讨论的一致性哈希是解决这些问题的一种很好的技术。让我们重新审视一致性哈希在高层次上的工作原理。

-

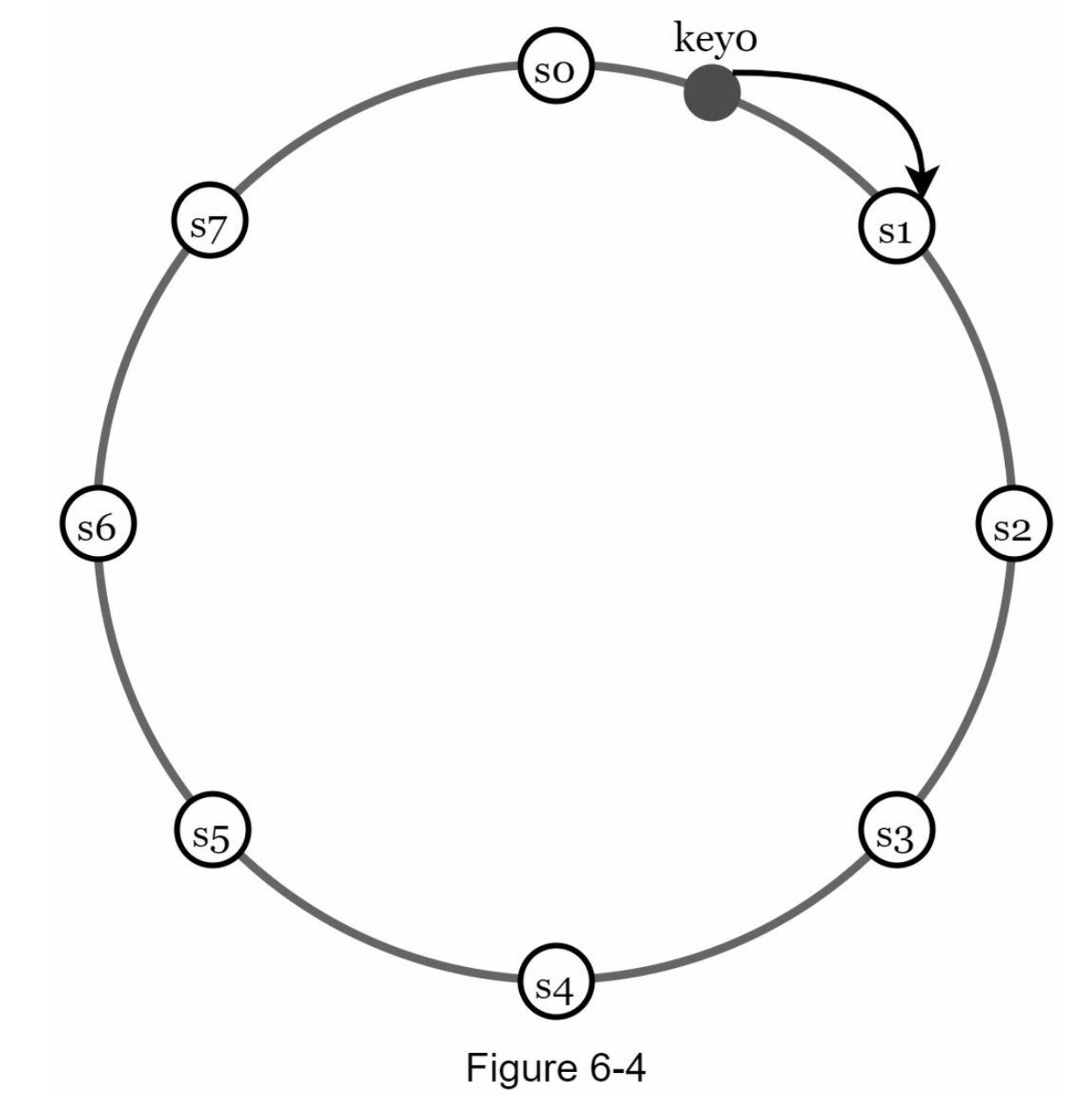

首先,服务器被放置在哈希环上。在图 6-4 中,8 个服务器,分别用 s0、s1、...、s7 表示,放在哈希环上。

-

接下来,将一个键散列到同一个环上,并将其存储在顺时针方向移动时遇到的第一个服务器上。例如,key0 使用此逻辑存储在 s1 中。

使用一致性哈希对数据进行分区有以下优点:

- 自动缩放:可以根据负载自动添加和删除服务器

- 异构性:服务器的虚拟节点数与服务器容量成正比。例如,容量越大的服务器分配的虚拟节点越多。

数据复制

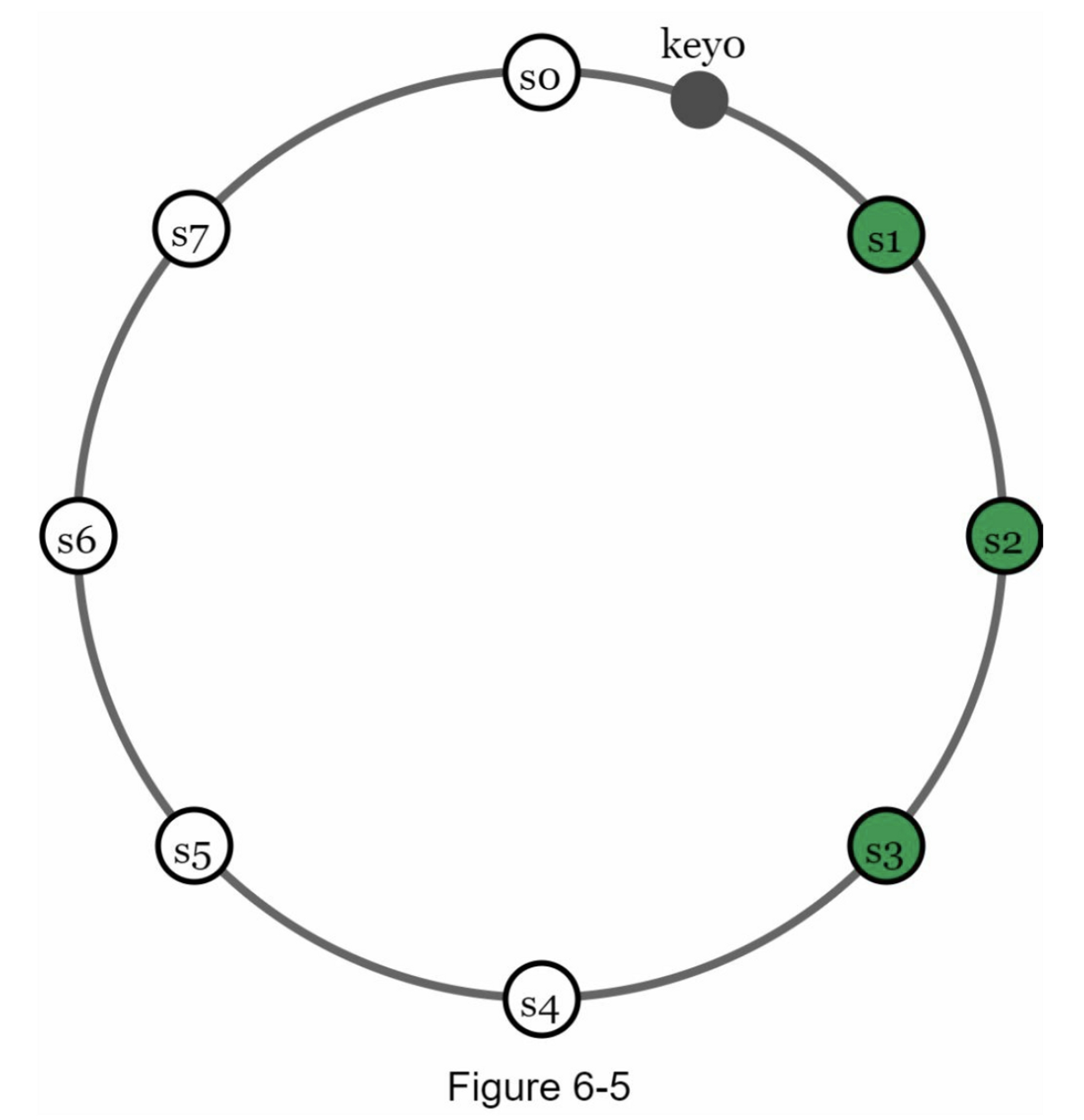

为了实现高可用性和可靠性,必须在 N 个服务器上异步复制数据,其中 N 是一个可配置参数。这N台服务器的选择逻辑如下:将key映射到哈希环上的某个位置后,从该位置顺时针走,选择环上的前N台服务器存储数据副本。在图 6-5(N = 3)中,key0 被复制到 s1、s2 和 s3。

对于虚拟节点,环上的前 N 个节点可能由少于 N 个物理服务器拥有。为避免此问题,我们在执行顺时针行走逻辑时仅选择唯一的服务器。

由于停电、网络问题、自然灾害等原因,同一数据中心内的节点经常同时发生故障。为了更好的可靠性,副本被放置在不同的数据中心,数据中心之间通过高速网络连接。

一致性

由于数据在多个节点进行复制,因此必须跨副本同步。Quorum 共识可以保证读写操作的一致性。 让我们先建立几个定义。

N = 副本数

W = 大小为 W 的规定写入。要将写入操作视为成功,必须从 W 个副本确认写入操作。

R = 大小为 R 的读取规定人数。为了使读取操作被认为是成功的,读取操作必须等待至少R个副本的响应。

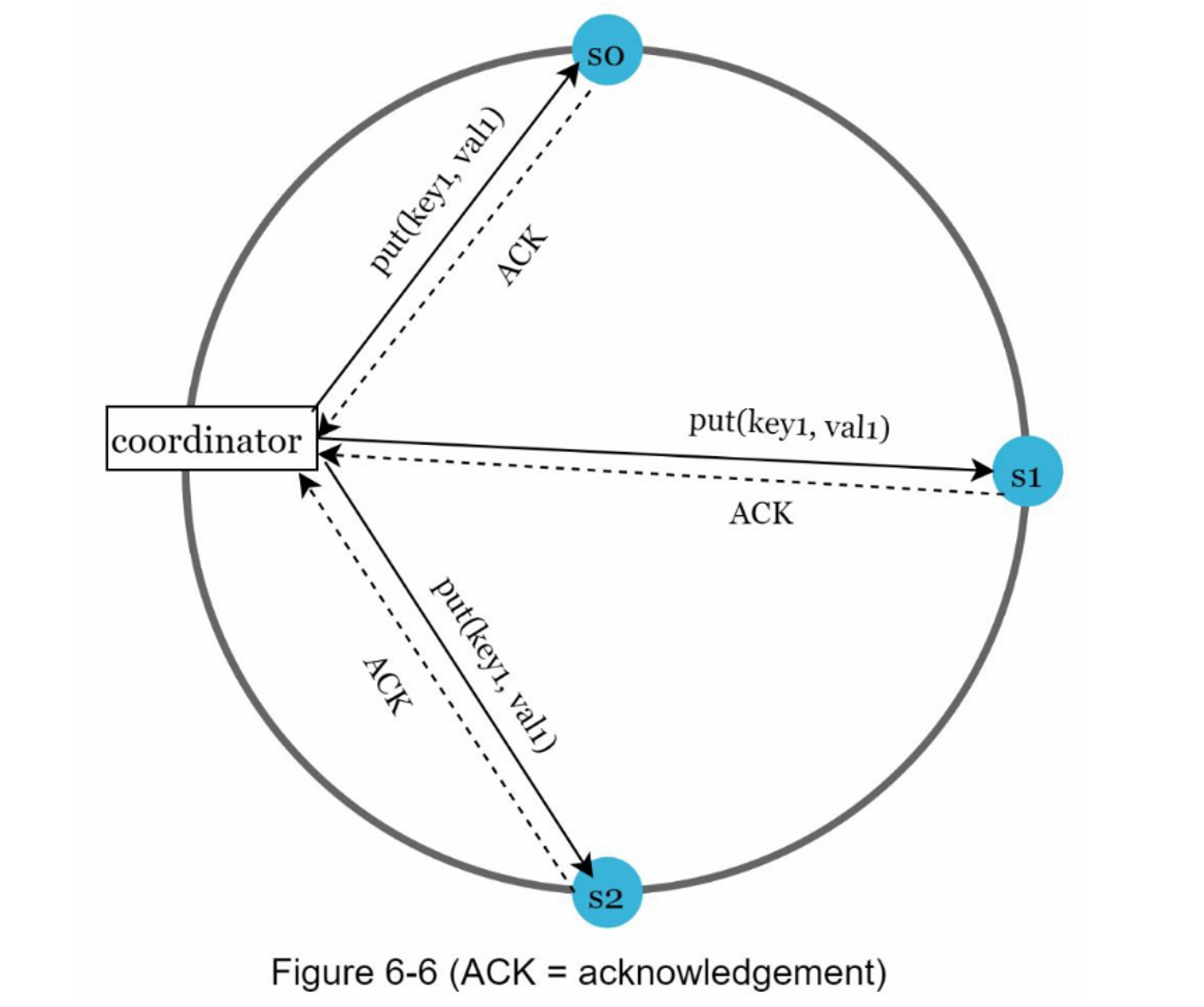

考虑以下图 6-6 中所示的示例,其中 N = 3。

W = 1 并不意味着数据写在一台服务器上。 例如,对于图 6-6 中的配置,数据被复制到 s0、s1 和 s2。 W = 1 表示协调器必须至少收到一个确认才能认为写操作成功。例如,如果我们收到来自 s1 的确认,我们就不再需要等待来自 s0 和 s2 的确认。 协调器充当客户端和节点之间的代理。

W、R和N的配置是一个典型的延迟和一致性之间的权衡。如果W = 1 或R = 1,操作会很快返回,因为协调器只需要等待来自一个副本的响应。 如果 W 或 R > 1,系统提供更好的一致性; 但是,查询会变慢,因为协调器必须等待最慢副本的响应。

如果W+R>N,就能保证强一致性,因为至少有一个重叠的节点拥有最新的数据,以保证一致性。

如何配置N、W和R以适应我们的使用情况?

下面是一些可能的设置:

- 如果R=1,W=N,系统被优化为快速读取

- 如果W=1,R=N,系统被优化为快速写入

- 如果W+R>N,就可以保证强一致性(通常N=3,W=R=2)。

- 如果W+R<=N,则不能保证强一致性

根据要求,我们可以调整W、R、N的值,以达到理想的一致性水平。

一致性模型

一致性模型是设计键值存储时要考虑的另一个重要因素。 一致性模型定义了数据一致性的程度,并且存在多种可能的一致性模型:

- 强一致性:任何读操作都会返回一个与最新的写数据项的结果相对应的值。客户端永远不会看到过期的数据

- 弱一致性:后续的读操作可能看不到最新的值。

- 最终一致性:这是弱一致性的一种特殊形式。只要有足够的时间,所有的更新都会被传播,而且所有的副本都是一致的。

强一致性通常是通过强迫一个副本不接受新的读/写,直到每个副本都同意当前的写来实现的。这种方法对于高可用系统来说并不理想,因为它可能会阻塞新的操作。Dynamo和Cassandra采用最终一致性,这是我们推荐的键值存储的一致性模型。

从并发写入来看,最终一致性允许不一致的值进入系统,并迫使客户端读取这些值来进行调和。下一节将解释调和是如何与版本管理一起工作的。

不一致的解决方法:版本控制

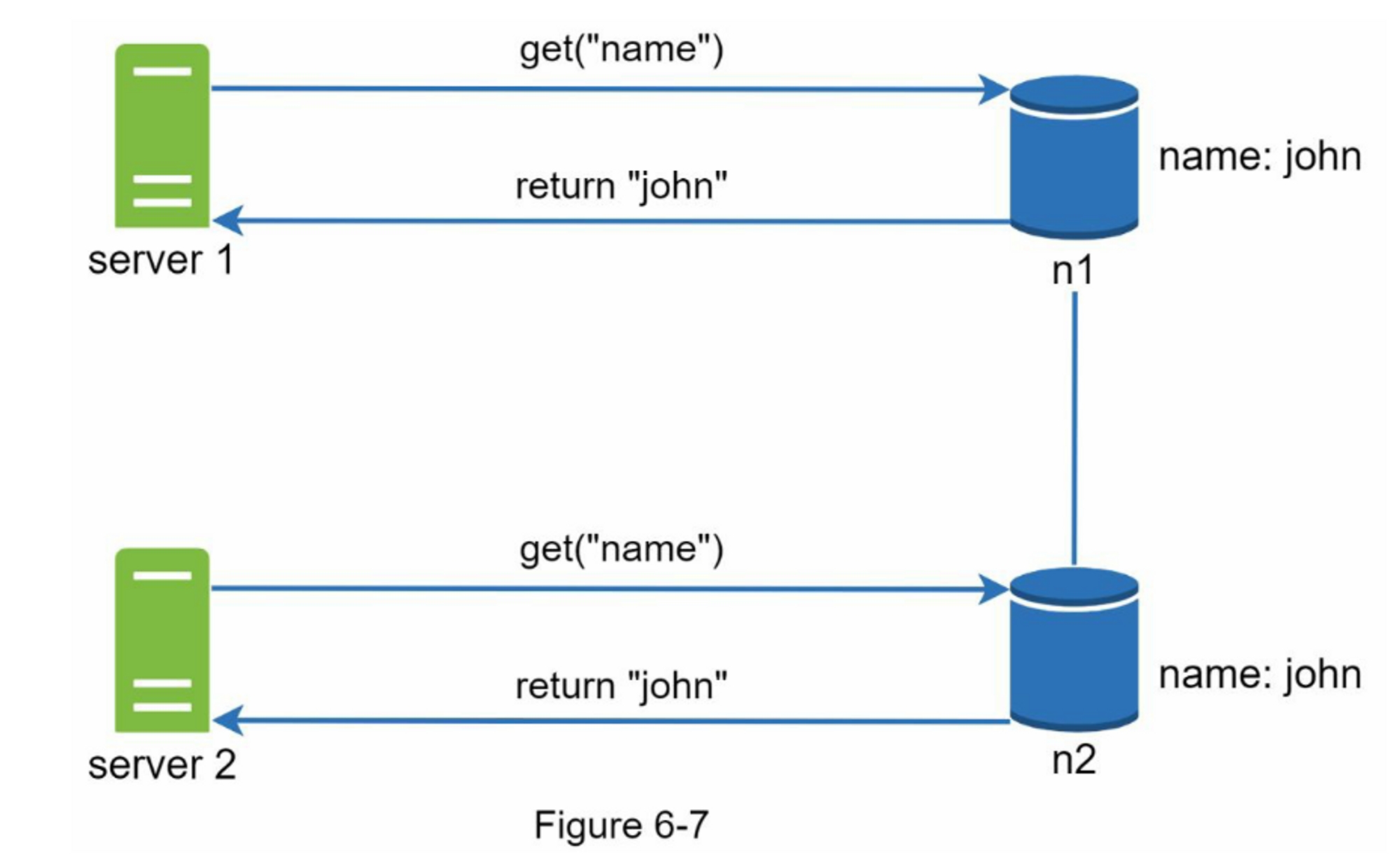

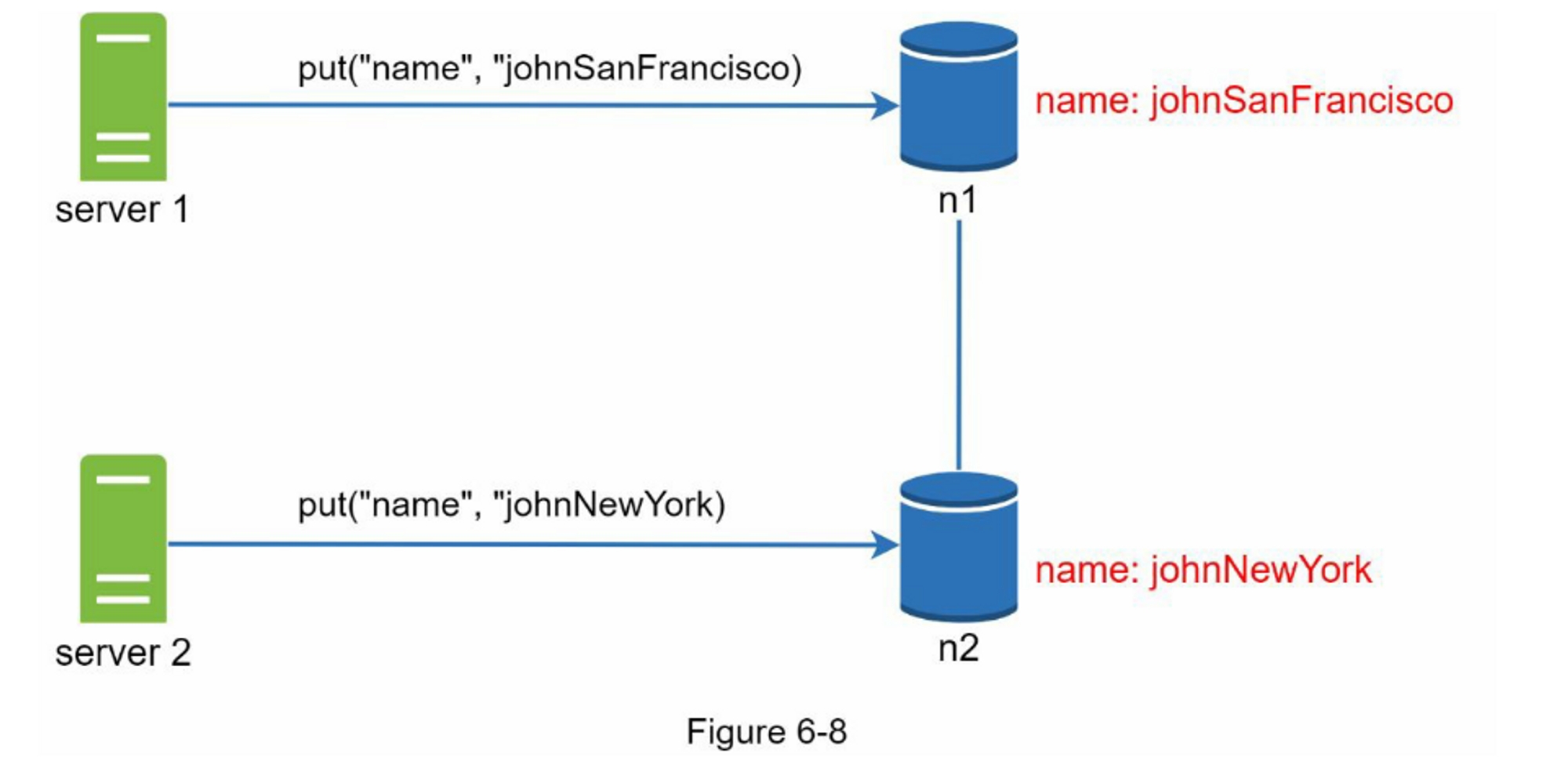

复制提供了高可用性,但会导致副本之间的不一致。 版本控制和矢量锁用于解决不一致问题。版本化意味着将每一次数据修改都视为一个新的不可更改的数据版本。在我们谈论版本控制之前,让我们用一个例子来解释不一致是如何发生的:

如图6-7所示,副本节点n1和n2的值相同。 让我们称这个值为原始值。 server 1 和 server 2 通过 get(“name”) 操作获得相同的值。

接下来,server 1 将名称更改为“johnSanFrancisco”,server 2 将名称更改为“johnNewYork”,如图 6-8 所示。 这两个更改是同时执行的。 现在,我们有冲突的值,称为版本 v1 和 v2。

在此示例中,可以忽略原始值,因为修改是基于它的。 但是,没有明确的方法来解决最后两个版本的冲突。 为了解决这个问题,我们需要一个可以检测冲突并协调冲突的版本控制系统。

向量时钟是解决此问题的常用技术。

让我们来看看向量时钟是如何工作的。

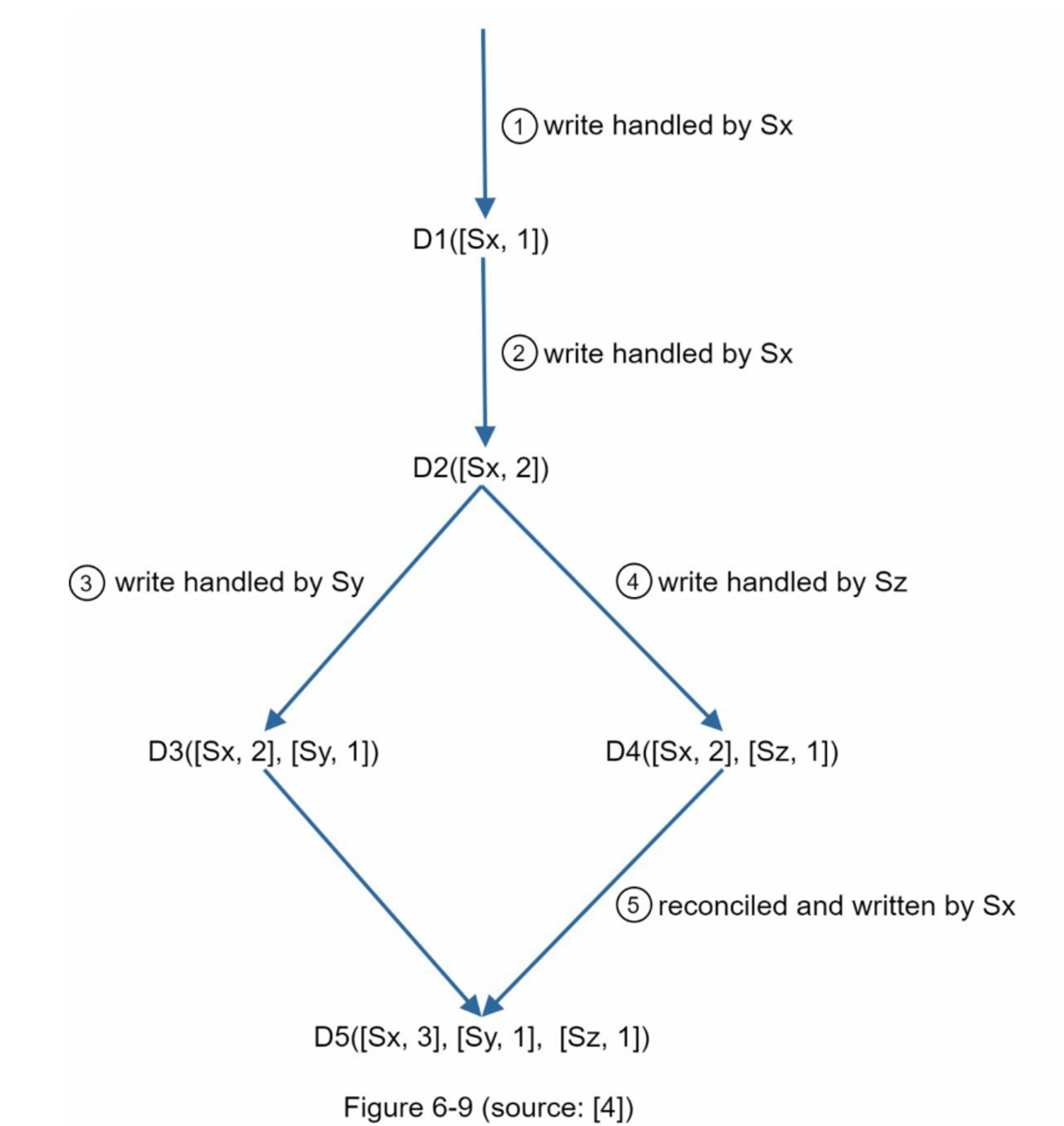

向量时钟是与数据项关联的键值 [server, version] 对。 它可用于检查一个版本是否先于、成功或与其他版本冲突。

假设一个向量时钟用 D([S1, v1], [S2, v2], ..., [Sn, vn]) 表示,其中 D 是数据项,v1 是版本计数器,s1 是服务器数字等。如果数据项 D 被写入服务器 Si,系统必须执行以下任务之一:

- 如果 [Si, vi] 存在,则增加 vi。

- 否则,创建一个新的条目[Si, 1]。

上面的抽象逻辑用一个具体的例子来解释,如图6-9所示:

- 客户端向系统写入数据项 D1,写入由服务器 Sx 处理,服务器现在具有向量时钟 D1[(Sx, 1)]。

- 另一个客户端读取最新的 D1,将其更新为 D2,然后写回。 D2 继承自 D1,因此它会覆盖 D1。 假设写入由同一个服务器 Sx 处理,该服务器现在具有向量时钟 D2([Sx, 2])。

- 另一个客户端读取最新的 D2,将其更新为 D3,然后写回。 假设写操作由服务器 Sy 处理,它现在有向量时钟 D3([Sx, 2], [Sy, 1]))。

- 另一个客户端读取最新的 D2,将其更新为 D4,然后写回。 假设写入由服务器 Sz 处理,它现在有 D4([Sx, 2], [Sz, 1]))。

- 当另一个客户端读取D3和D4时,发现冲突,这是由于数据项D2被Sy和Sz同时修改造成的。 冲突由客户端解决,并将更新的数据发送到服务器。 假设写入由 Sx 处理,它现在有 D5([Sx, 3], [Sy, 1], [Sz, 1])。 我们将很快解释如何检测冲突。

使用向量时钟,如果Y的向量时钟中的每个参与者的版本计数器大于或等于版本X中的版本计数器,则很容易判断版本X是版本Y的祖先(即无冲突)。例如,向量时钟 D([s0, 1], [s1, 1])] 是 D([s0, 1], [s1, 2]) 的祖先。因此,未记录任何冲突。

类似地,如果 Y 的向量时钟中有任何参与者的计数器小于其在 X 中对应的计数器,则可以判断版本 X 是 Y 的兄弟版本(即存在冲突)。例如,以下两个 矢量时钟表示存在冲突:D([s0, 1], [s1,2]) 和 D([s0, 2], [s1, 1])

尽管向量时钟可以解决冲突,但也有两个明显的缺点。 首先,向量时钟增加了客户端的复杂性,因为它需要实现冲突解决逻辑。

其次,向量时钟中的 [server: version] 对可能会快速增长。为了解决这个问题,我们为长度设置了一个阈值,如果超过了限制,则删除最旧的对。这可能导致协调效率低下,因为后代关系无法准确确定。然而,基于Dynamo论文[4],亚马逊在生产中还没有遇到这个问题;因此,这可能是大多数公司可以接受的解决方案。

故障处理

与任何大规模的系统一样,故障不仅是不可避免的,而且是常见的。处理故障情况是非常重要的。在本节中,我们首先介绍检测故障的技术。然后,我们将介绍常见的故障解决策略。

-

故障检测

在分布式系统中,仅因为另一台服务器这样说就认为一台服务器已宕机是不够的。 通常,至少需要两个独立的信息源才能将服务器标记为宕机。

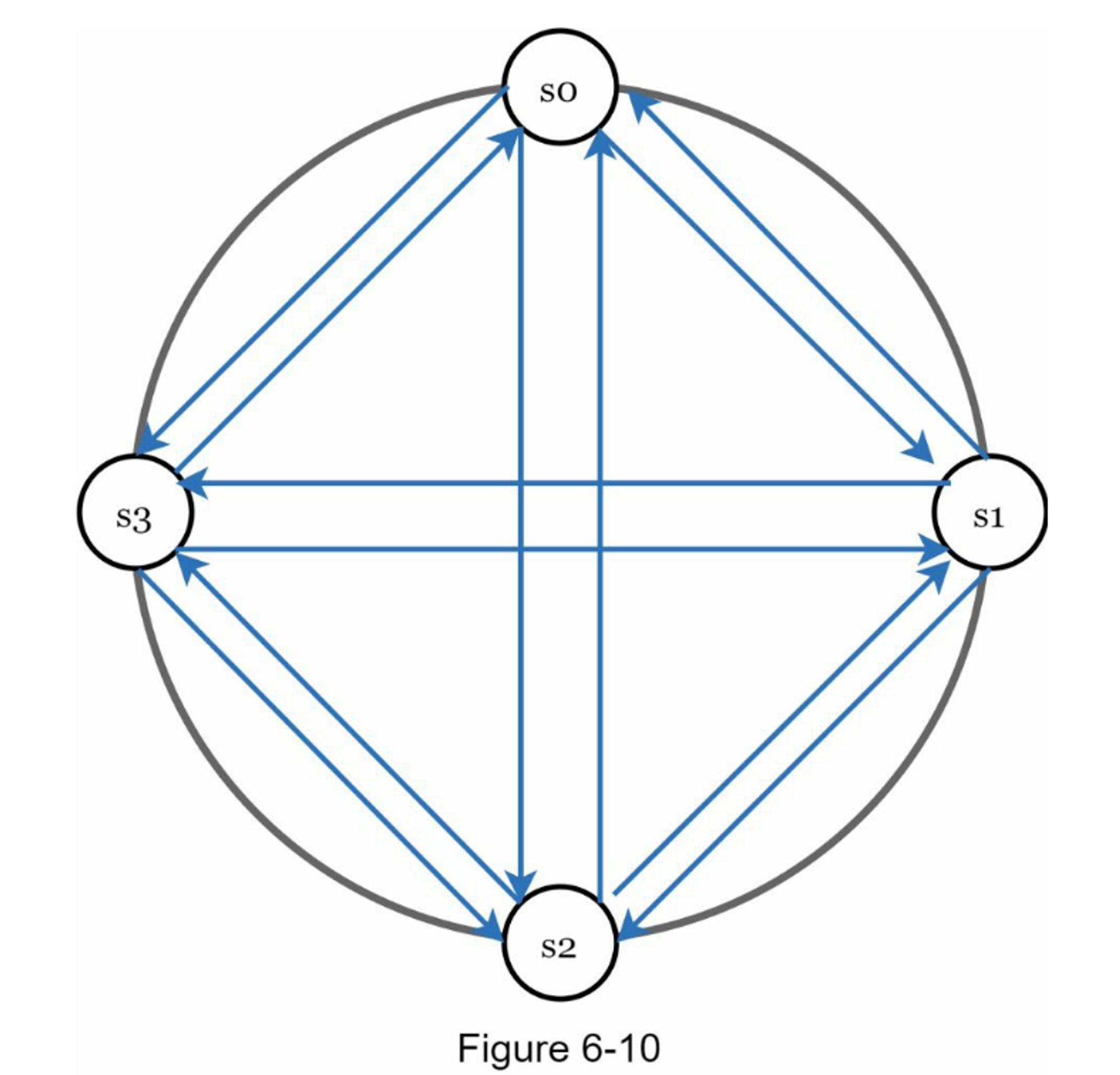

如图 6-10 所示,all-to-all 多播是一种直接的解决方案。 但是,当系统中有很多服务器时,这是低效的。

一个更好的解决方案是使用分散的故障检测方法,如

gossip协议。gossip协议的工作原理如下:- 每个节点维护一个节点成员列表,其中包含成员ID和心跳计数器。

- 每个节点定期增加它的心跳计数器

- 每个节点定期向一组随机节点发送心跳,然后再传播到另一组节点上

- 一旦节点收到心跳,成员名单就会更新到最新信息。

- 如果心跳没有增加超过预定的时间,该成员被认为是离线的。

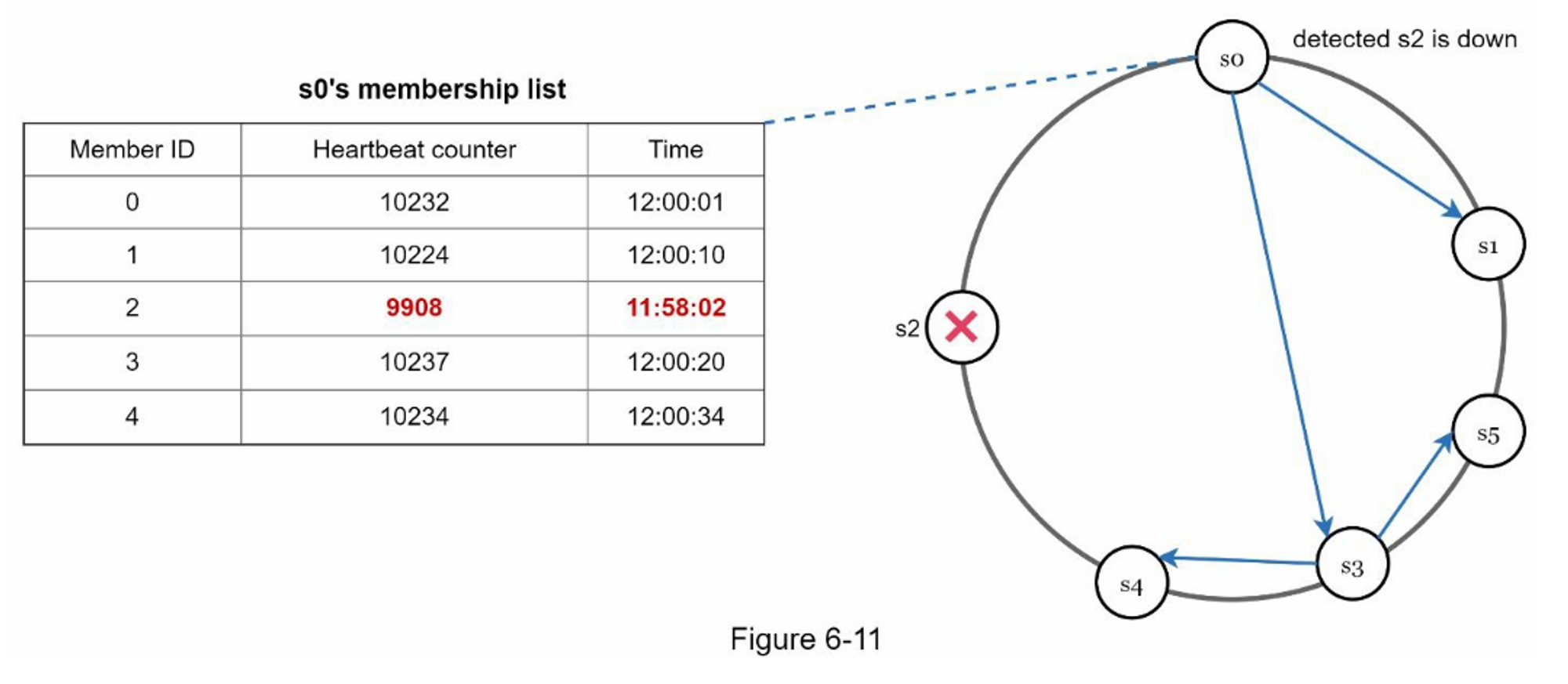

如图6-11所示:

- 节点s0维护一个节点成员列表,如左侧所示

- 节点s0注意到节点s2(成员ID=2)的心跳计数器很长时间没有增加。

- 节点s0向一组随机节点发送包括s2的信息的心跳。一旦其他节点确认s2的心跳计数器长时间没有更新,节点s2就会被标记下来,这个信息会传播给其他节点。

-

处理暂时性故障

通过

gossip协议检测到故障后,系统需要部署一定的机制来确保可用性。 在严格的仲裁方法(quorum)中,读取和写入操作可以被阻止,如仲裁共识部分所示。一种称为“草率仲裁(

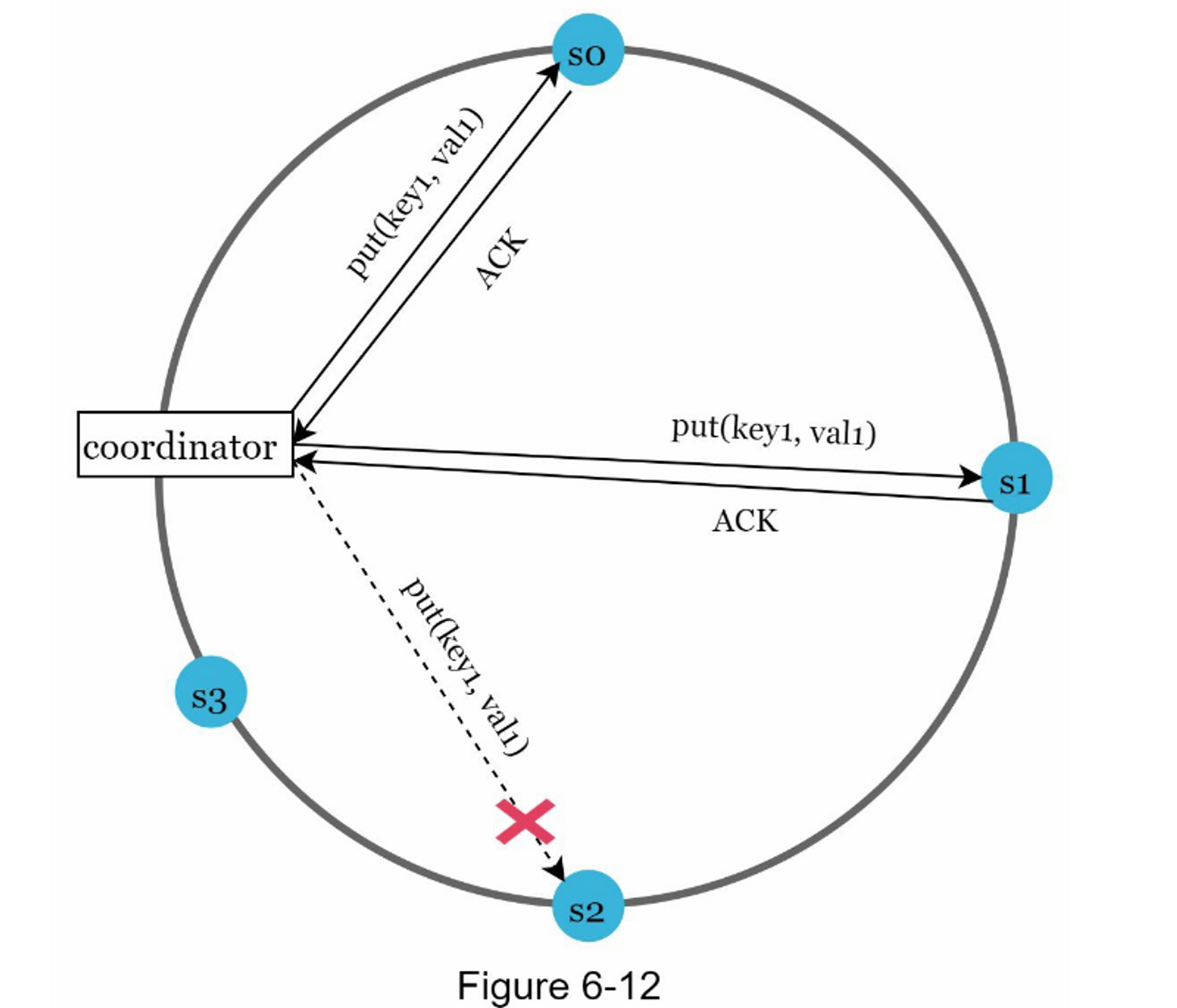

sloppy quorum)”[4] 的技术用于提高可用性。 系统不会强制执行法定人数要求,而是选择前 W 个健康的服务器进行写入,并选择前 R 个健康的服务器进行哈希环上的读取。 离线服务器将被忽略。如果由于网络或服务器故障导致服务器不可用,将由另一台服务器临时处理请求,当宕机服务器启动时,更改将被推回以实现数据一致性。这个过程称为暗示切换(hinted handof)。由于图6-12中s2不可用,读写暂时交由s3处理,当 s2 重新上线时,s3 会将数据交还给 s2。

-

处理永久性故障

提示切换用于处理临时故障。 如果副本永久不可用怎么办?

为了处理这种情况,我们实施了一个反熵协议(anti-entropy protocol) 来保持副本同步。 反熵需要比较副本上的每条数据,并将每个副本更新为最新版本。

Merkle树用于检测不一致,并尽量减少传输的数据量。

引自维基百科 [7]:“哈希树或 Merkle 树是一棵树,其中每个非叶节点都标有其子节点的标签或值(如果是叶子)的哈希值。 哈希树允许对大型数据结构的内容进行高效和安全的验证”。

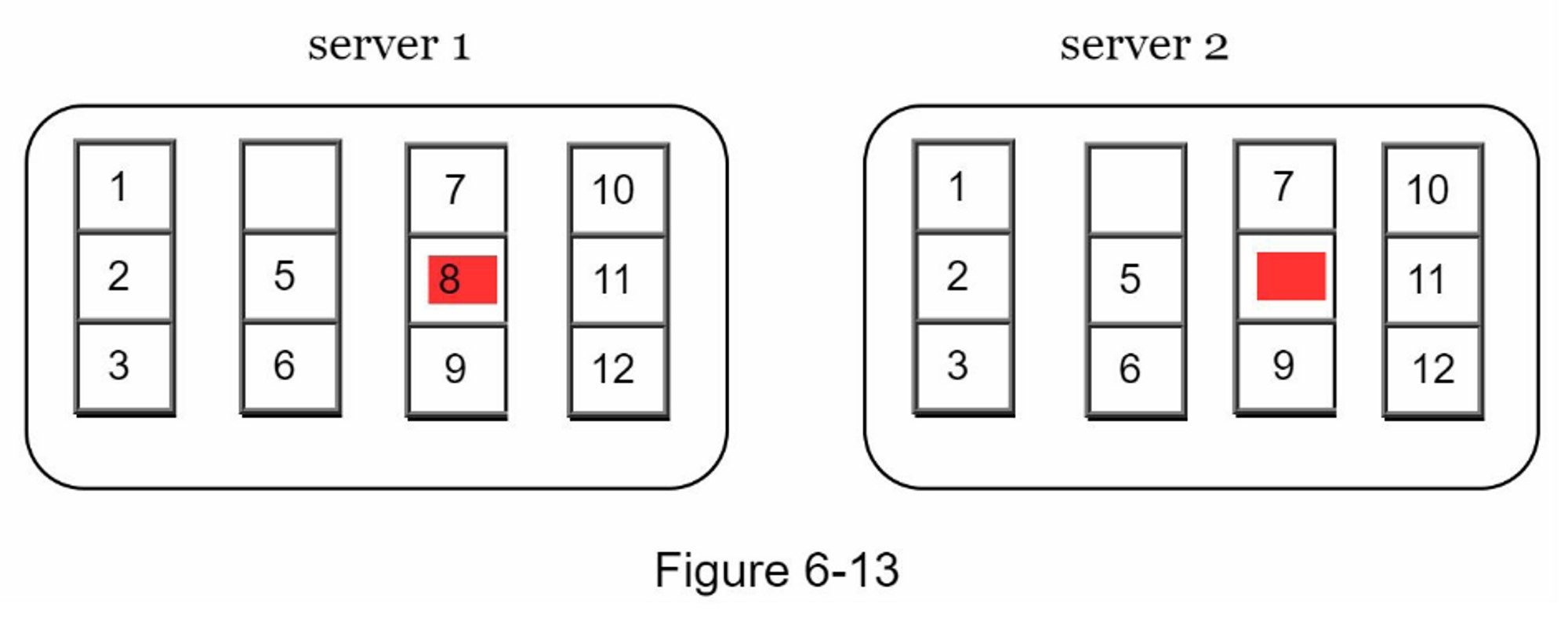

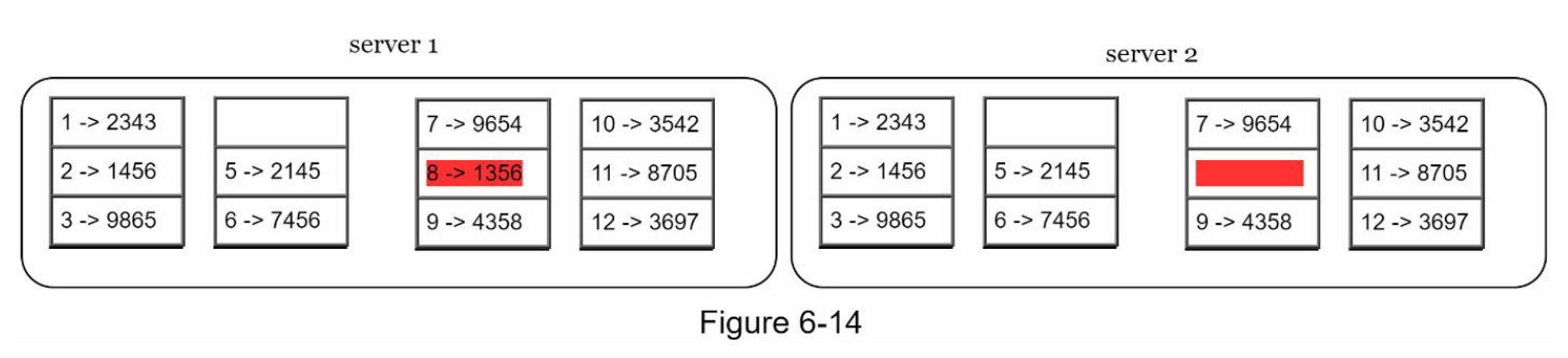

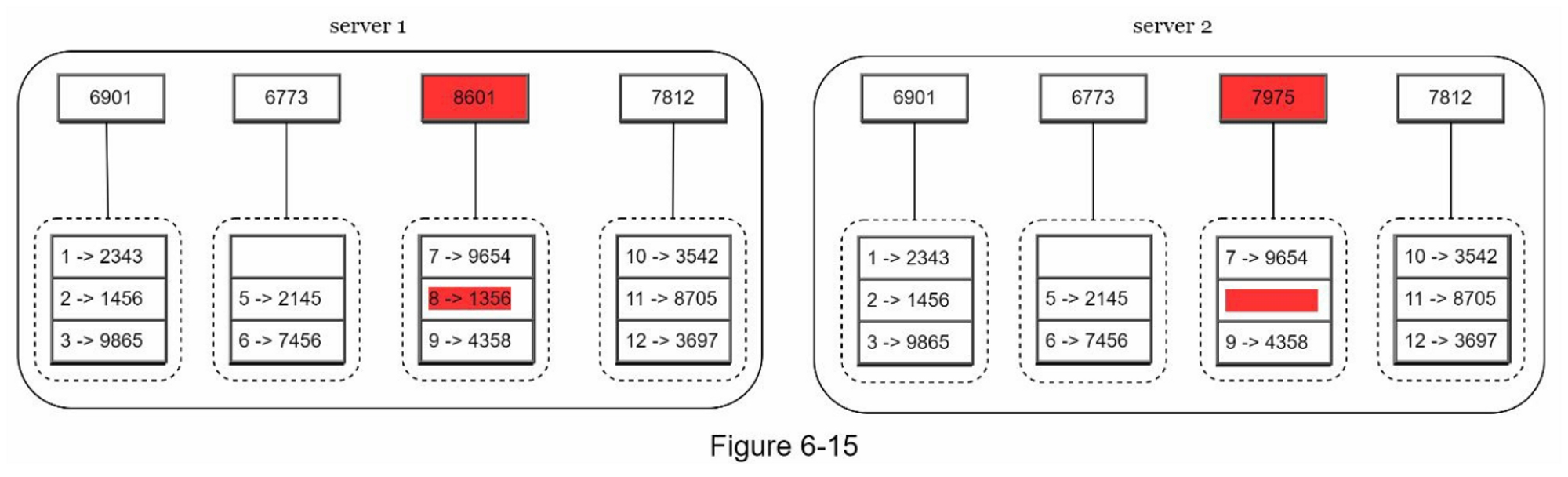

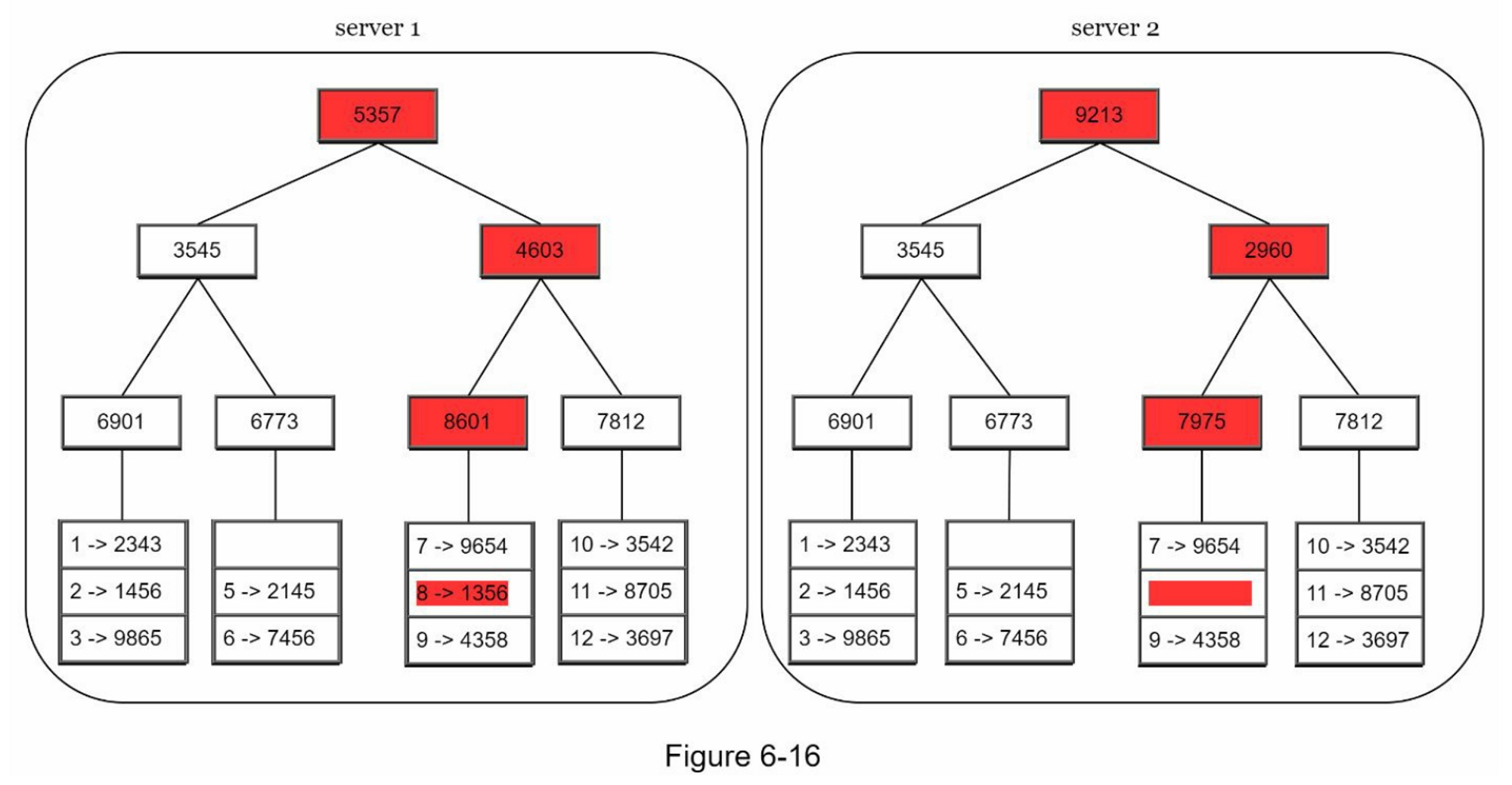

假设键空间是从 1 到 12,下面的步骤展示了如何构建 Merkle 树,突出显示的框表示不一致。

- 第1步:将密钥空间划分为桶(在我们的例子中为4个),如图6-13所示。 一个桶被用作根级节点,以保持树的有限深度

- 第2步:一旦创建了桶,使用统一的散列方法对桶中的每个密钥进行散列(图6-14)。

- 第3步:为每个桶创建一个哈希节点(图6-15)

- 第4步:通过计算子代的哈希值,向上建立树,直到根(图6-16)。

要比较两个Merkle树,首先要比较根哈希值。如果根哈希值匹配,则两个服务器有相同的数据。如果根哈希值不一致,那么就比较左边的子哈希值,然后是右边的子哈希值。你可以遍历该树,找到哪些桶没有被同步,并只同步这些桶。

使用Merkle树,需要同步的数据量与两个副本之间的差异成正比,而不是它们包含的数据量。在现实世界的系统中,桶的大小是相当大的。例如,一个可能的配置是每十亿个键有一百万个桶,所以每个桶只包含1000个键。

-

处理数据中心的中断故障

数据中心的中断可能是由于停电、网络中断、自然灾害等原因造成的。为了建立一个能够处理数据中心中断的系统,在多个数据中心之间复制数据是非常重要的。即使一个数据中心完全离线,用户仍然可以通过其他数据中心访问数据。

系统构架图

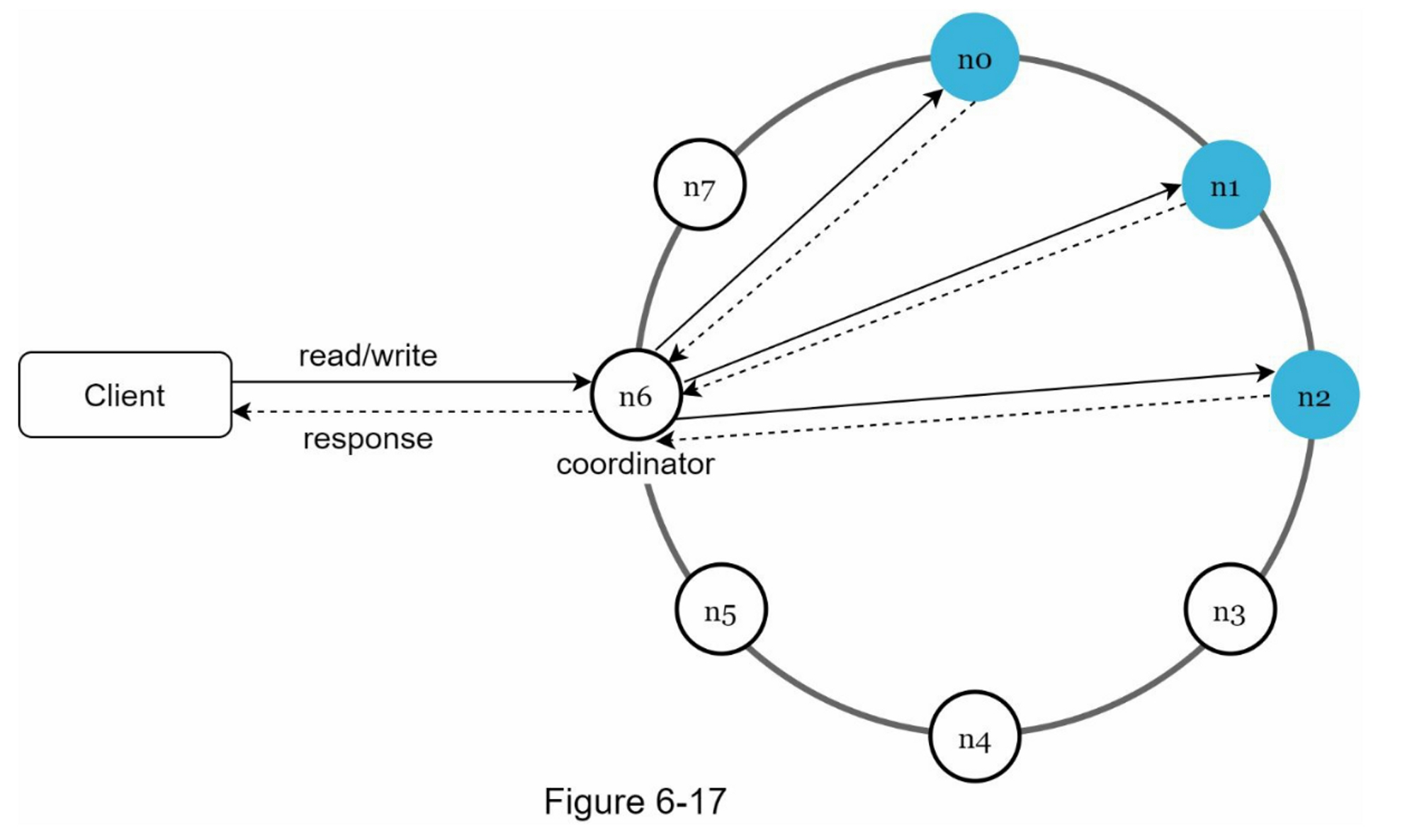

现在我们已经讨论了设计键值存储时的不同技术考虑,我们可以将注意力转移到架构图上,如图 6-17 所示。

架构的主要特点列举如下:

- 客户端通过简单的API与键值存储通信:

get(key)和put(key, value)。 - 协调器是一个节点,在客户端和键值存储之间充当代理。

- 节点采用一致性hash的散列方式分布在一个环上。

- 该系统是完全去中心化的,所以添加和移动节点可以自动进行。

- 数据在多个节点上复制。

- 不存在单点故障,因为每个节点都有相同的职责。

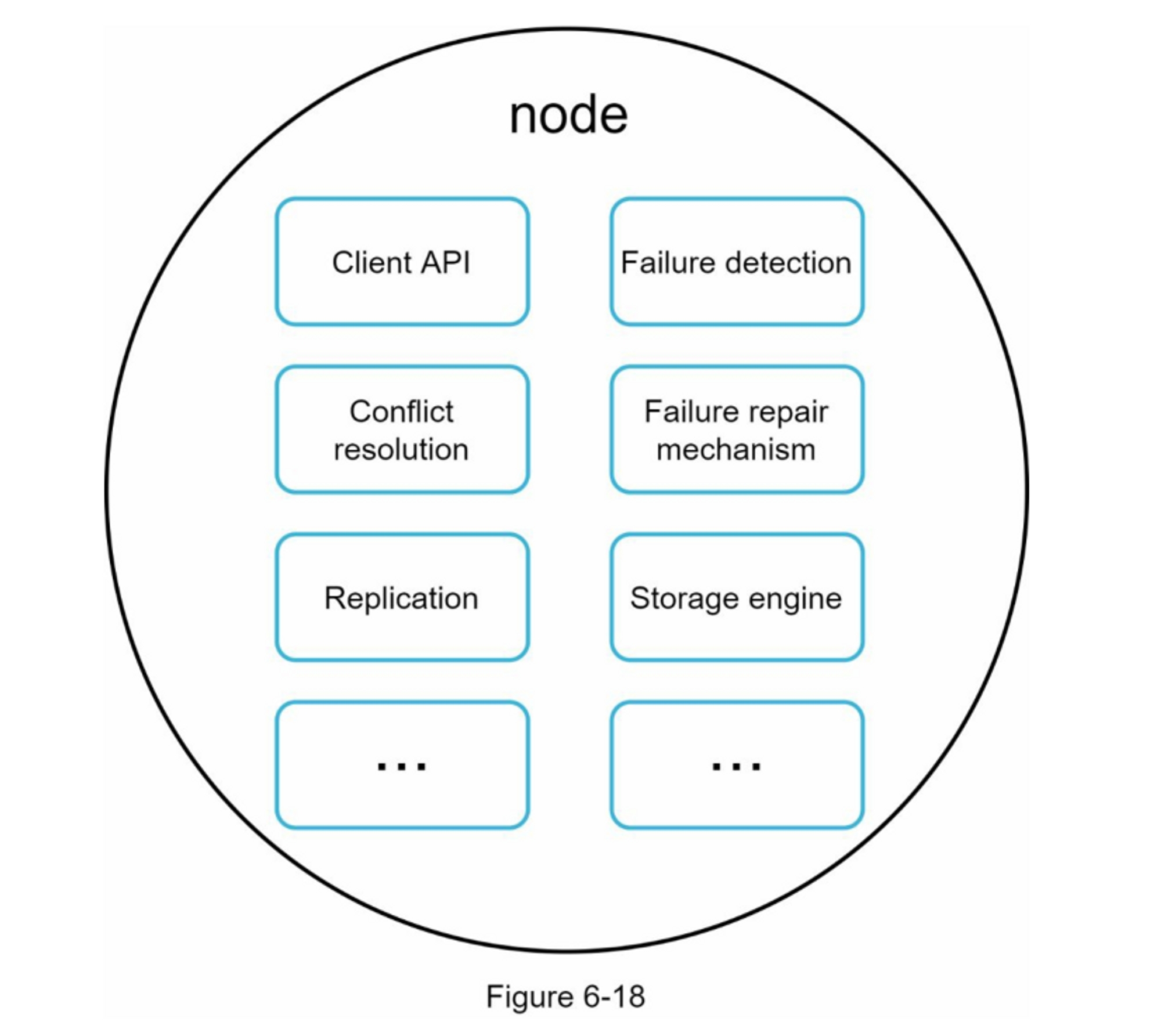

由于设计是分散的,每个节点执行许多任务,如图6-18所示。

写入路径

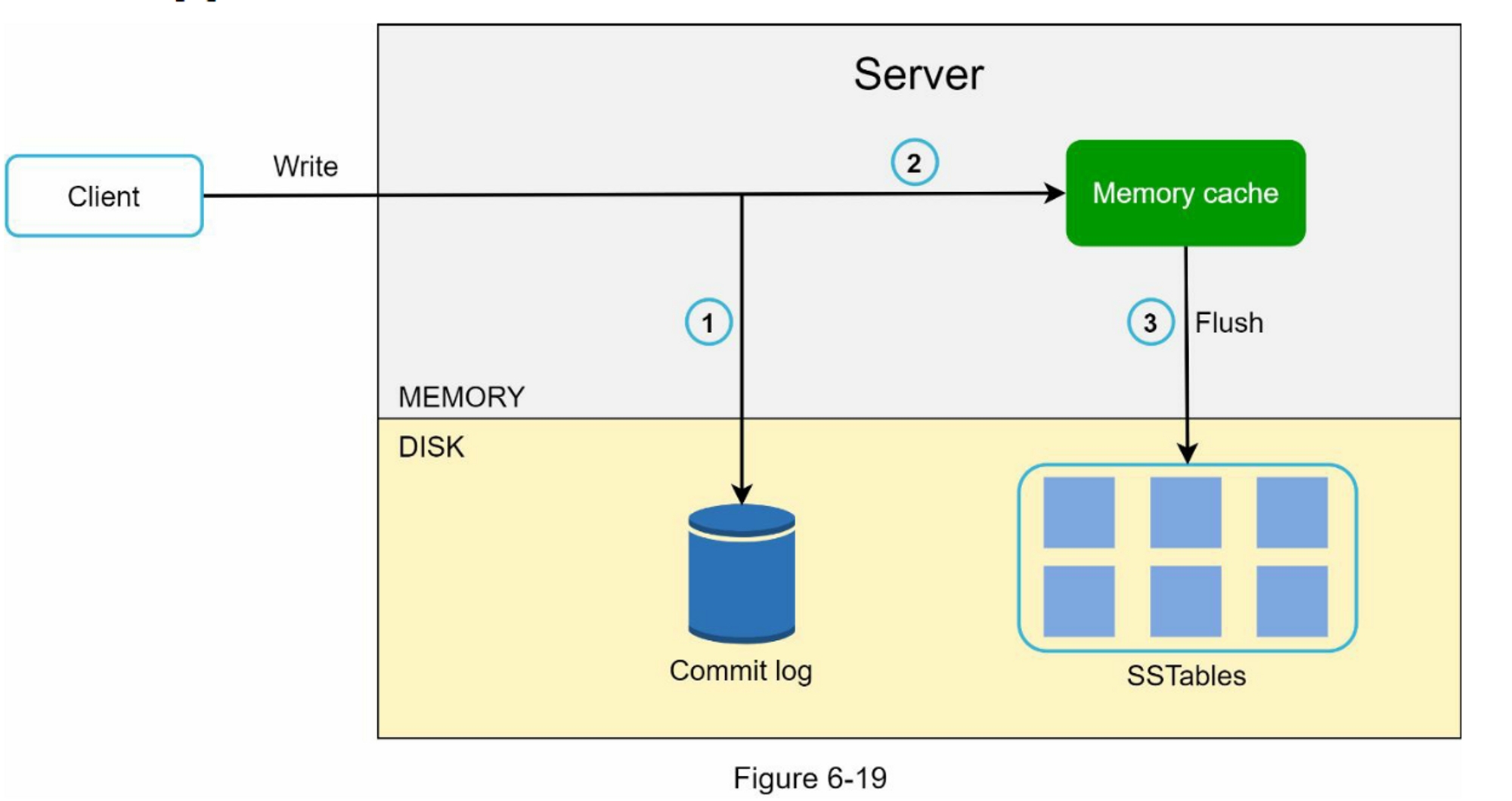

图 6-19 解释了将写请求定向到特定节点后会发生什么。 请注意,建议的写/读路径设计主要基于 Cassandra [8] 的体系结构。

- 写入请求持久保存在提交日志文件中。

- 数据保存在内存缓存中。

- 当内存缓存已满或达到预定义的阈值时,数据将刷新到磁盘上的 SSTable [9]。 注意:排序字符串表 (SSTable) 是 <key, value> 对的排序列表。 有兴趣进一步了解 SStable 的读者,请参阅参考资料 [9]。

读取路径

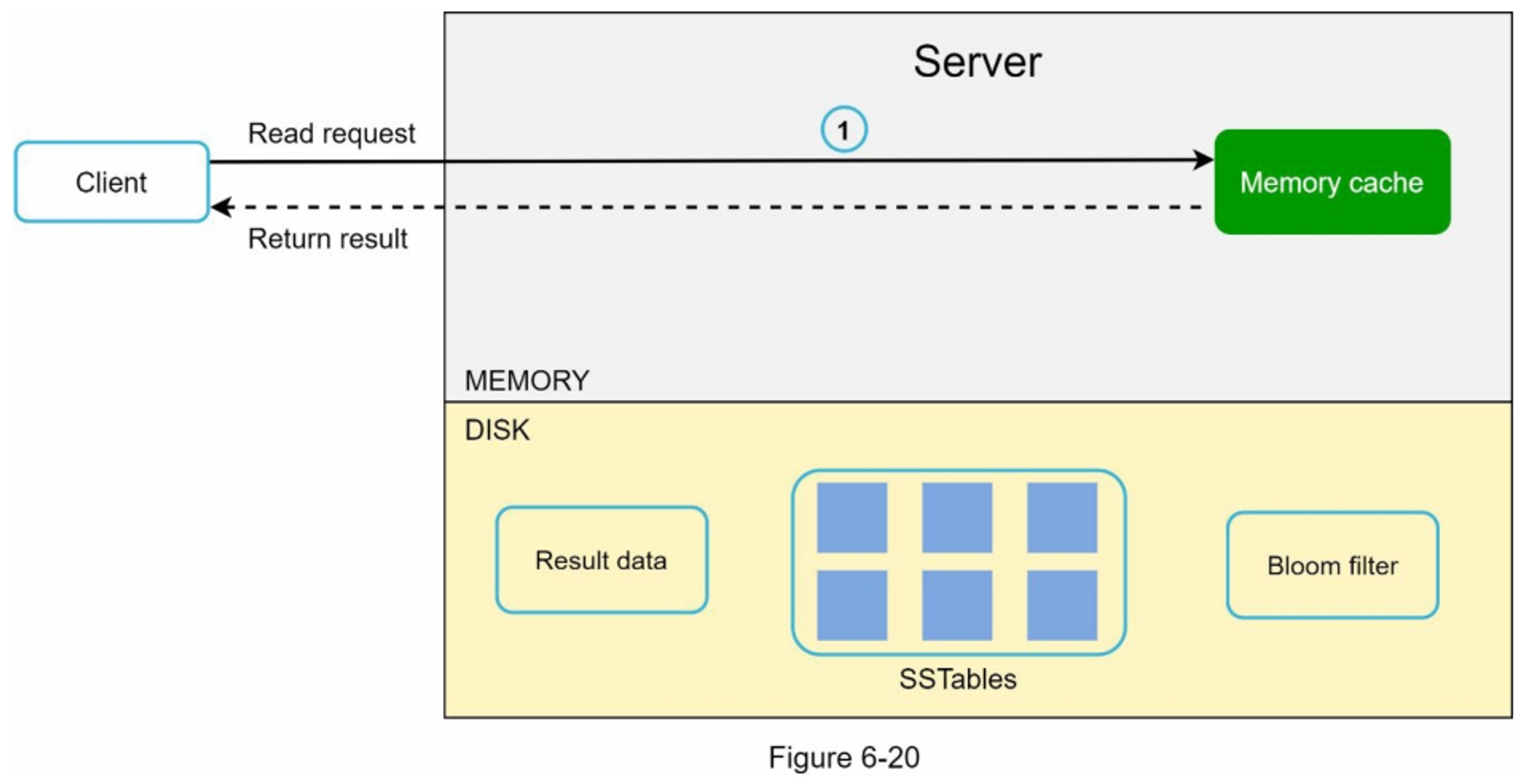

读取请求被引导到一个特定的节点后,它首先检查数据是否在内存缓存中。如果是,数据就会被返回给客户端,如图6-20所示。

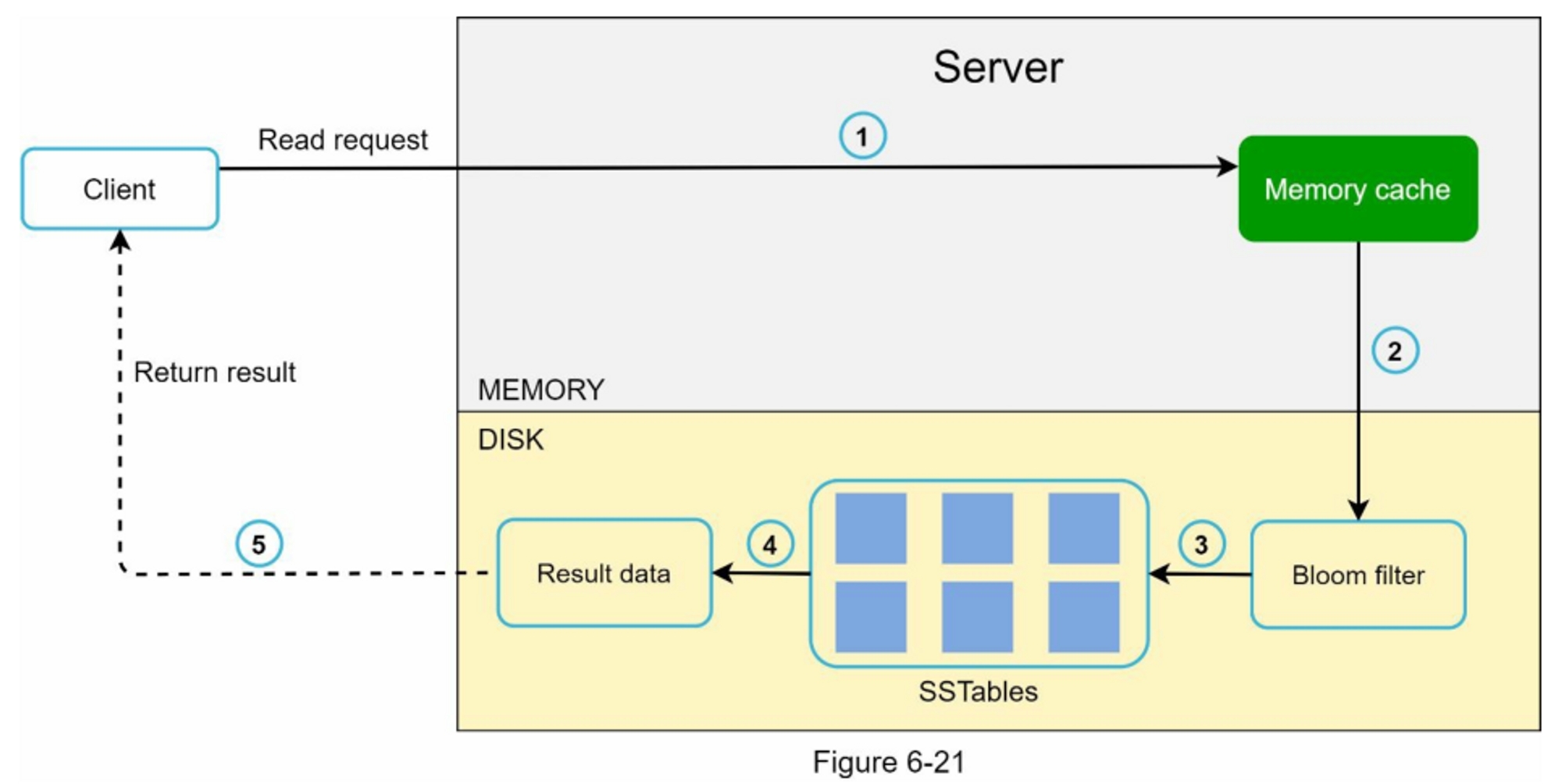

如果数据不在内存中,就会从磁盘中检索出来。我们需要一个有效的方法来找出哪个SSTable中包含了该键。布隆过滤器[10]通常被用来解决这个问题。

当数据不在内存中时,读取路径如图6-21所示。

- 系统首先检查数据是否在内存中。如果没有,就转到第2步。

- 如果数据不在内存中,系统会检查Bloom过滤器。

- Bloom过滤器被用来计算哪些SSTables可能包含密钥。

- SSTables会返回数据集的结果。

- 数据集的结果被返回给客户端。

总结

本章涵盖了许多概念和技术。为了加深记忆,下表总结了分布式键值存储的特点和相应的技术。

| 目标/问题 | 技术 |

|---|---|

| 存储大数据的能力 | 使用一致性哈希将负载分散到多个服务器上 |

| 高可用性读取 | 数据复制 多数据中心设置 |

| 高可用性写入 | 使用向量时钟(vector clocks)进行版本控制和冲突解决 |

| 数据分区 | 一致性哈希 |

| 增量可扩展性 | 一致性哈希 |

| 异质性(heterogeneity) | 一致性哈希 |

| 处理临时性故障 | 草率仲裁(sloppy quorum)和暗示切换(hinted handoff) |

| 处理永久性故障 | Merkle 树 |

| 处理数据中心中断 | 跨数据中心复制 |

参考资料

- [1] Amazon DynamoDB: https://aws.amazon.com/dynamodb/

- [2] memcached: https://memcached.org/

- [3] Redis: https://redis.io/

- [4] Dynamo: Amazon’s Highly Available Key-value Store: https://www.allthingsdistributed.com/files/amazon-dynamo-sosp2007.pdf

- [5] Cassandra: https://cassandra.apache.org/

- [6] Bigtable: A Distributed Storage System for Structured Data: https://static.googleusercontent.com/media/research.google.com/en//archive/bigtable- osdi06.pdf

- [7] Merkle tree: https://en.wikipedia.org/wiki/Merkle_tree

- [8] Cassandra architecture: https://cassandra.apache.org/doc/latest/architecture/

- [9] SStable: https://www.igvita.com/2012/02/06/sstable-and-log-structured-storage-leveldb/

- [10] Bloom filter https://en.wikipedia.org/wiki/Bloom_filter

第07章:在分布式系统中设计唯一 ID 生成器

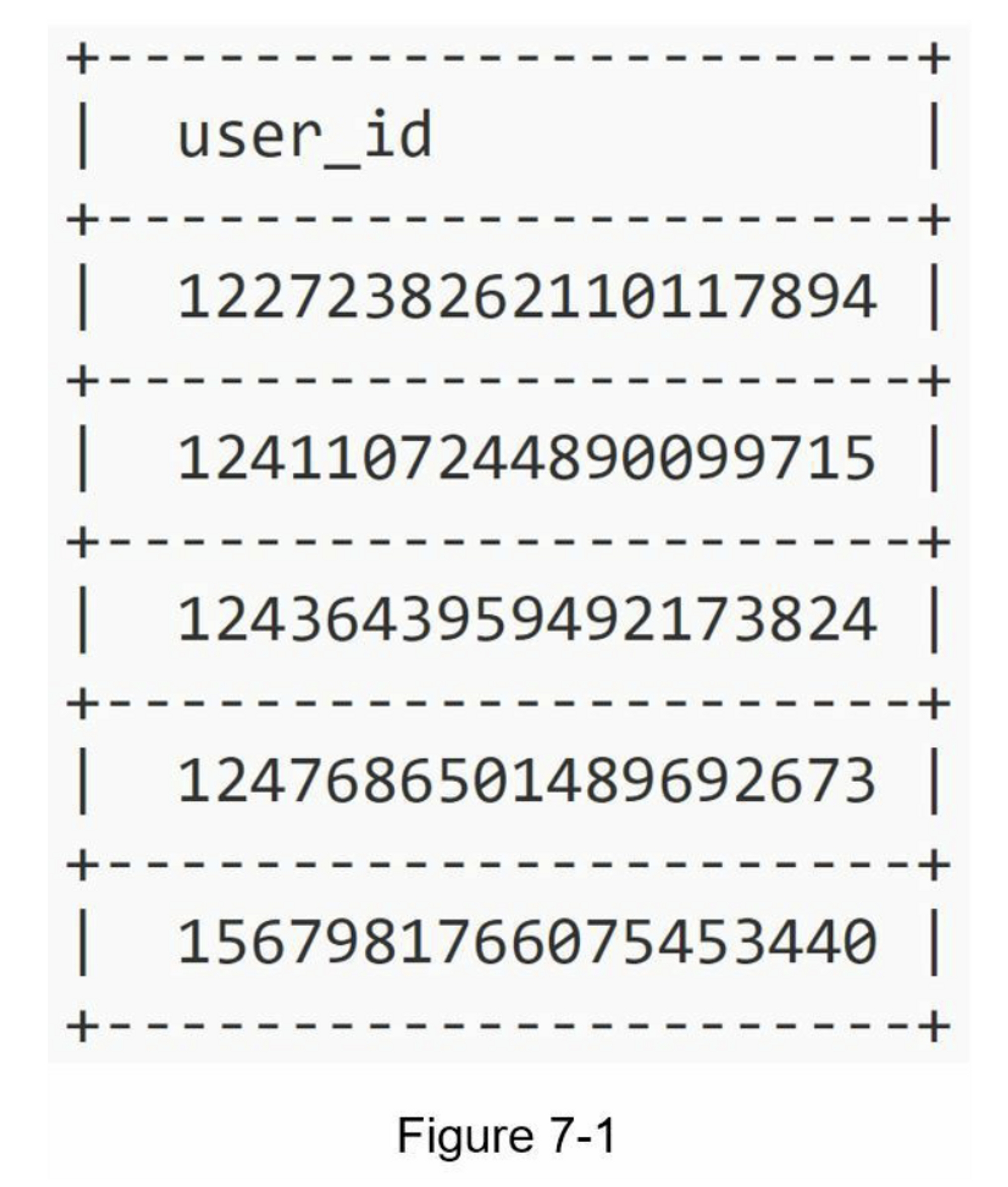

在本章中,要求在分布式系统中设计一个唯一 ID 生成器。 你的第一个想法可能是在传统数据库中使用具有 auto_increment 属性的主键。 但是,auto_increment 在分布式环境中不起作用,因为 单个数据库服务器不够大,跨多个数据库以最小延迟生成唯一 ID 具有挑战性。 以下是唯一 ID 的一些示例:

第1步:了解问题并确定设计范围

了解清楚问题是解决任何系统设计面试问题的第一步。下面是一个候选人与面试官互动的例子:

候选人:唯一ID有什么特点?

面试官:ID 必须是唯一的,并且是可排序的。

候选人:每增加一条记录,ID 是否加 1?

面试官:ID是按时间递增的,不一定只递增1,当天晚上创建的ID比早上创建的ID大。

候选人:ID 是否只包含数值?

面试官:是的,这很正确。

候选人:ID长度要求是多少?

面试官:ID 应该适合 64 位。

候选人:系统的规模是多少?

面试官:系统应该可以每秒生成10000个ID。

以上是可以向面试官提出的一些示例问题。了解需求并澄清歧义很重要。

本次面试题,要求如下:

- ID 必须是唯一的。

- ID 只是数值。

- ID 适合 64 位。

- ID 按日期排序。

- 能够每秒生成超过 10,000 个唯一 ID。

第2步:提出高层次的设计方案并获得认同

可以使用多个选项在分布式系统中生成唯一ID。

我们考虑的选项有:

- 多主复制

- 通用唯一标识符 (UUID)

- Ticket 服务器

- 推特雪花算法

让我们看看它们是如何工作的,以及每个选项的优缺点。

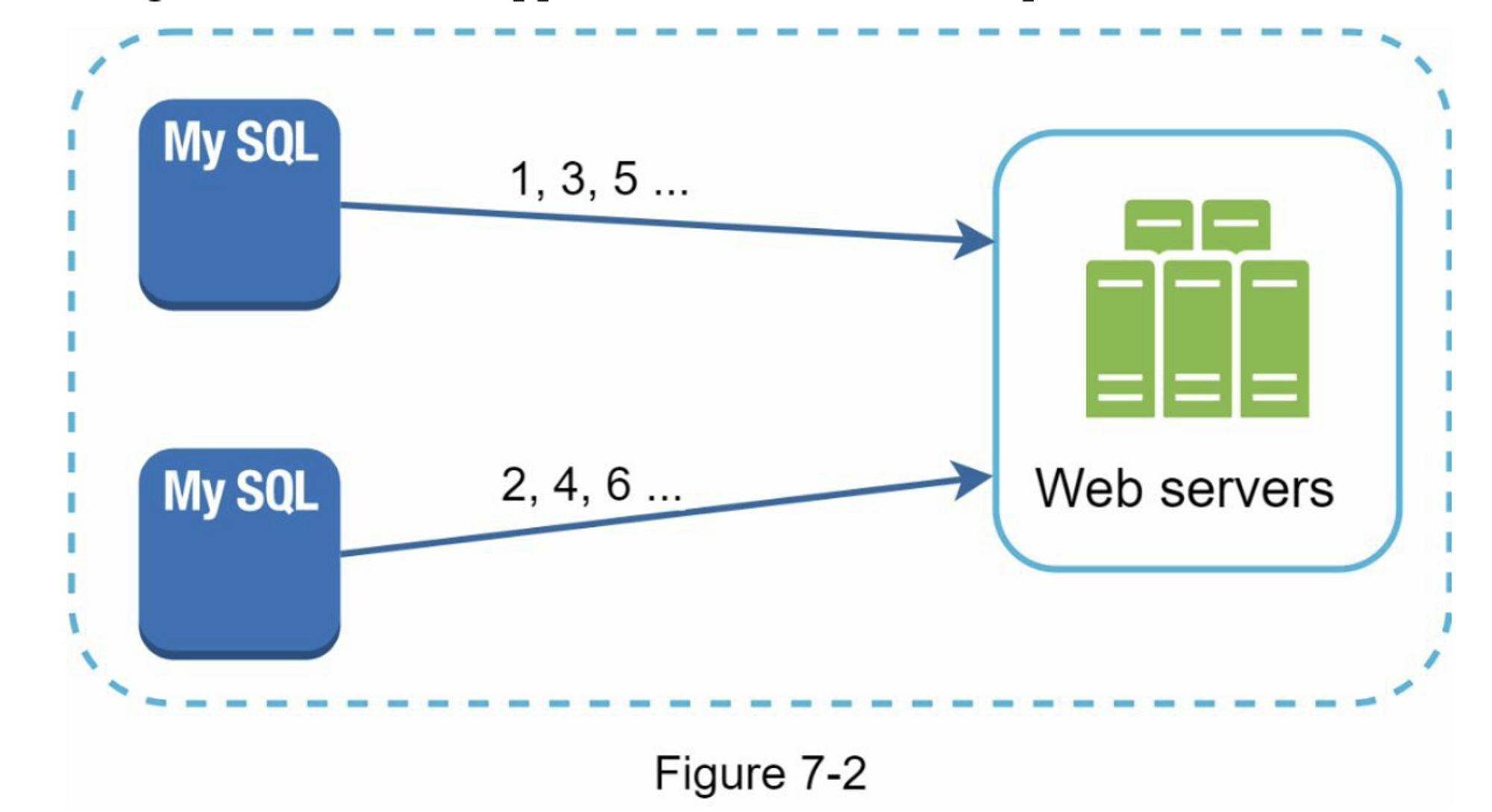

多主复制

如图7-2所示,第一种方式是多主复制。

这种方法使用数据库的 auto_increment 特性。我们不是将下一个 ID 增加 1,而是将其增加 k,其中 k 是正在使用的数据库服务器的数量。如图 7-2 所示,下一个要生成的 ID 等于同一服务器中的前一个 ID 加 2。这解决了一些可扩展性问题,因为 ID 可以随着数据库服务器的数量而扩展。

然而,这种策略有一些主要的缺点:

- 难以通过多个数据中心进行扩展

- ID在多个服务器上不随时间而增长

- 在增加或删除服务器时,不能很好地扩展

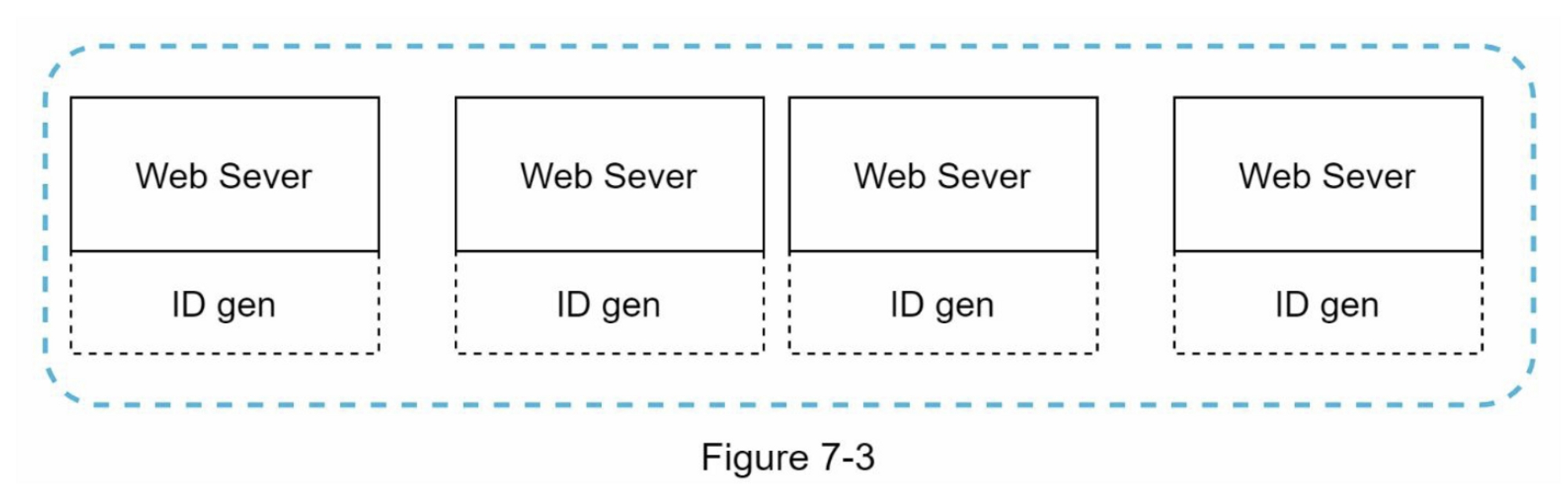

UUID

UUID 是另一种获取唯一 ID 的简单方法。 UUID 是一个 128 位数字,用于识别计算机系统中的信息。UUID获得串通的概率非常低。引自维基百科,"在每秒产生10亿个UUIDs,大约100年后,创造一个重复的概率会达到50%" [1] 。

以下是 UUID 的示例:09c93e62-50b4-468d-bf8a-c07e1040bfb2。 UUID 可以独立生成,无需服务器之间的协调。图 7-3 展示了 UUID 的设计。

在这个设计中,每个Web服务器都包含一个ID生成器,并且Web服务器负责独立生成ID。

优点:

- 生成 UUID 很简单。服务器之间不需要协调,因此不会有任何同步问题。

- 该系统易于扩展,因为每个 Web 服务器负责生成它们使用的 ID。 ID 生成器可以轻松地与 Web 服务器一起扩展。

缺点:

- ID 是 128 位长,但我们的要求是 64 位。

- ID 不会随时间上升

- ID 可以是非数字的。

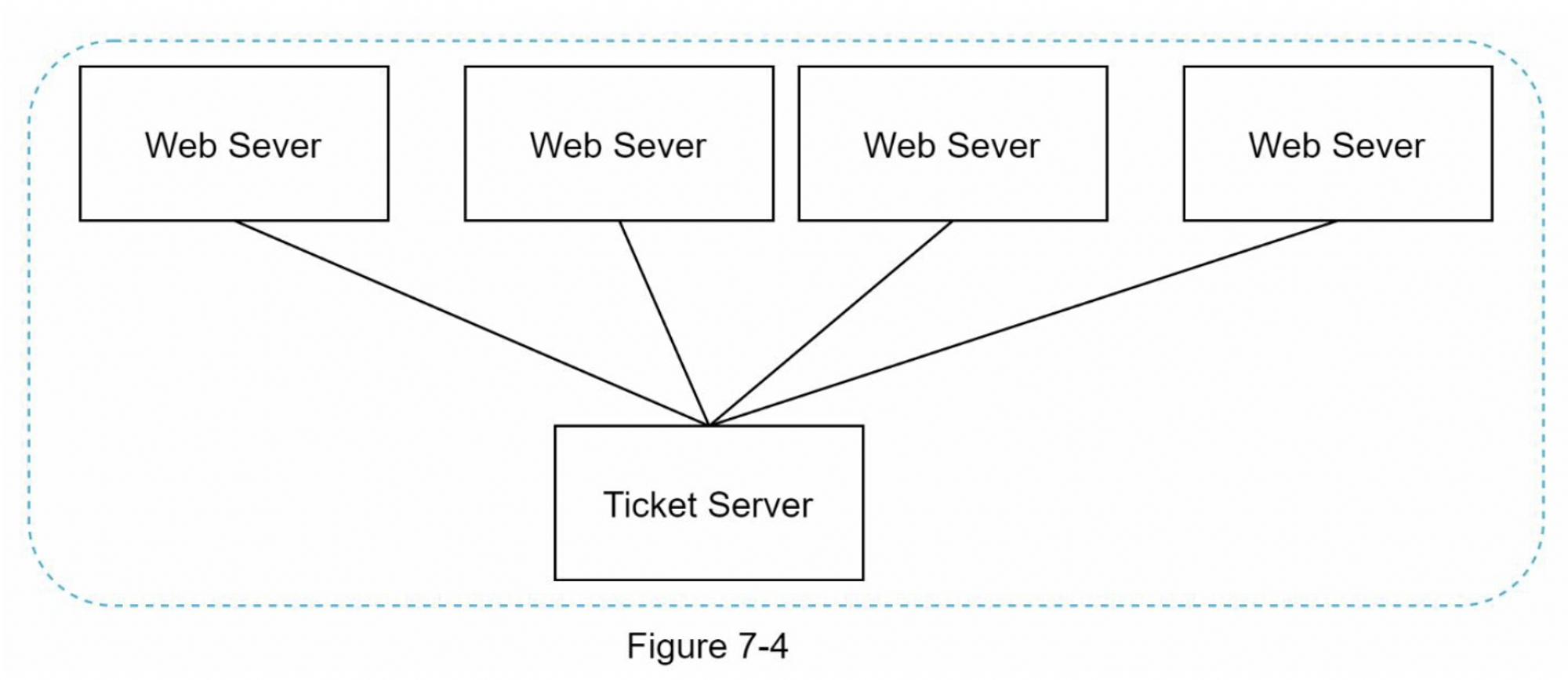

Ticket 服务器

票据服务器是产生唯一ID的另一种有趣的方式。Flicker开发了票据服务器来生成分布式主键[2]。值得一提的是,该系统是如何工作的。

这个想法是在一个单一的数据库服务器(Ticket Server)中使用一个集中的自动增量功能。要了解更多这方面的信息,请参考flicker的工程博客文章[2] 。

优点:

- 数字 ID

- 易于实施,适用于中小型应用程序

缺点:

- 单点故障。单个票务服务器意味着如果票务服务器发生故障,所有依赖它的系统都将面临问题。为了避免单点故障,我们可以设置多个票务服务器。然而,这将引入新的挑战,如数据同步。

推特雪花算法

上面提到的方法给了我们一些关于不同的ID生成系统如何工作的想法。然而,它们都不符合我们的具体要求;因此,我们需要另一种方法。Twitter 独特的 ID 生成系统“snowflake”[3] 很有启发性,可以满足我们的要求。

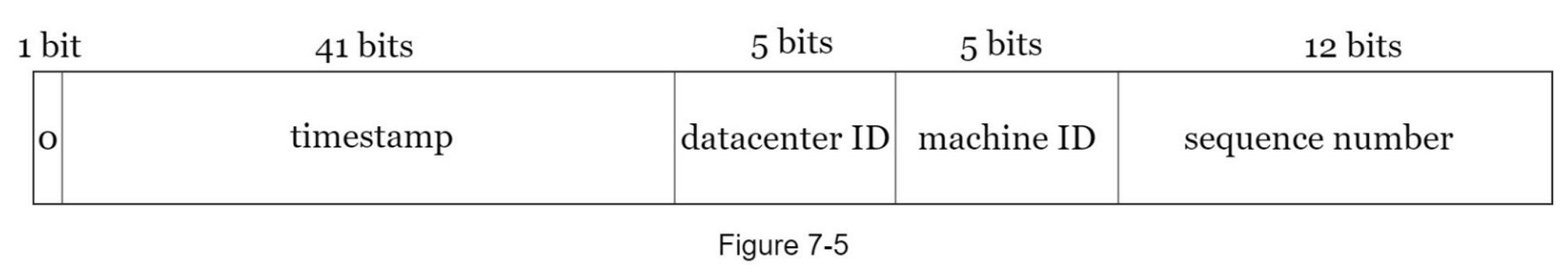

分而治之是我们的朋友。我们不是直接生成一个ID,而是将一个ID分成不同的部分。图7-5显示了一个64位ID的布局。

下面对每个部分进行解释:

- 符号位:1 位,它将始终为 0。这是为将来使用保留的。它可以潜在地用于区分有符号数和无符号数。

- 时间戳:41 位。自纪元或自定义纪元以来的毫秒数。我们使用 Twitter 雪花默认纪元 1288834974657,相当于 2010 年 11 月 4 日 01:42:54 UTC。

- 数据中心 ID:5 位,这给了我们 $$2 ^ 5 = 32$$ 个数据中心。

- 机器 ID:5 位,每个数据中心有 $$2 ^ 5 = 32$$ 台机器

- 序列号:12 位。对于在该机器/进程上生成的每个 ID,序列号都会递增 1。该数字每毫秒重置为 0。

第3步:深入设计

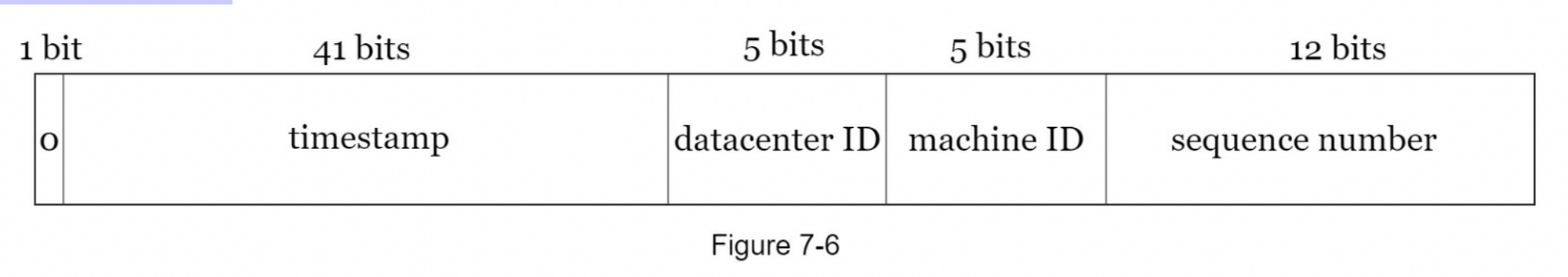

在高层设计中,我们讨论了在分布式系统中设计唯一ID生成器的各种方案。我们确定了一种基于Twitter雪花ID生成器的方法。让我们深入了解一下这个设计。为了恢复我们的记忆,设计图被重新列在下面。

数据中心ID和机器ID是在启动时选择的,一般在系统运行后就固定下来。数据中心ID和机器ID的任何变化都需要仔细审查,因为这些数值的意外变化会导致ID冲突。时间戳和序列号是在ID生成器运行时生成的。

时间戳

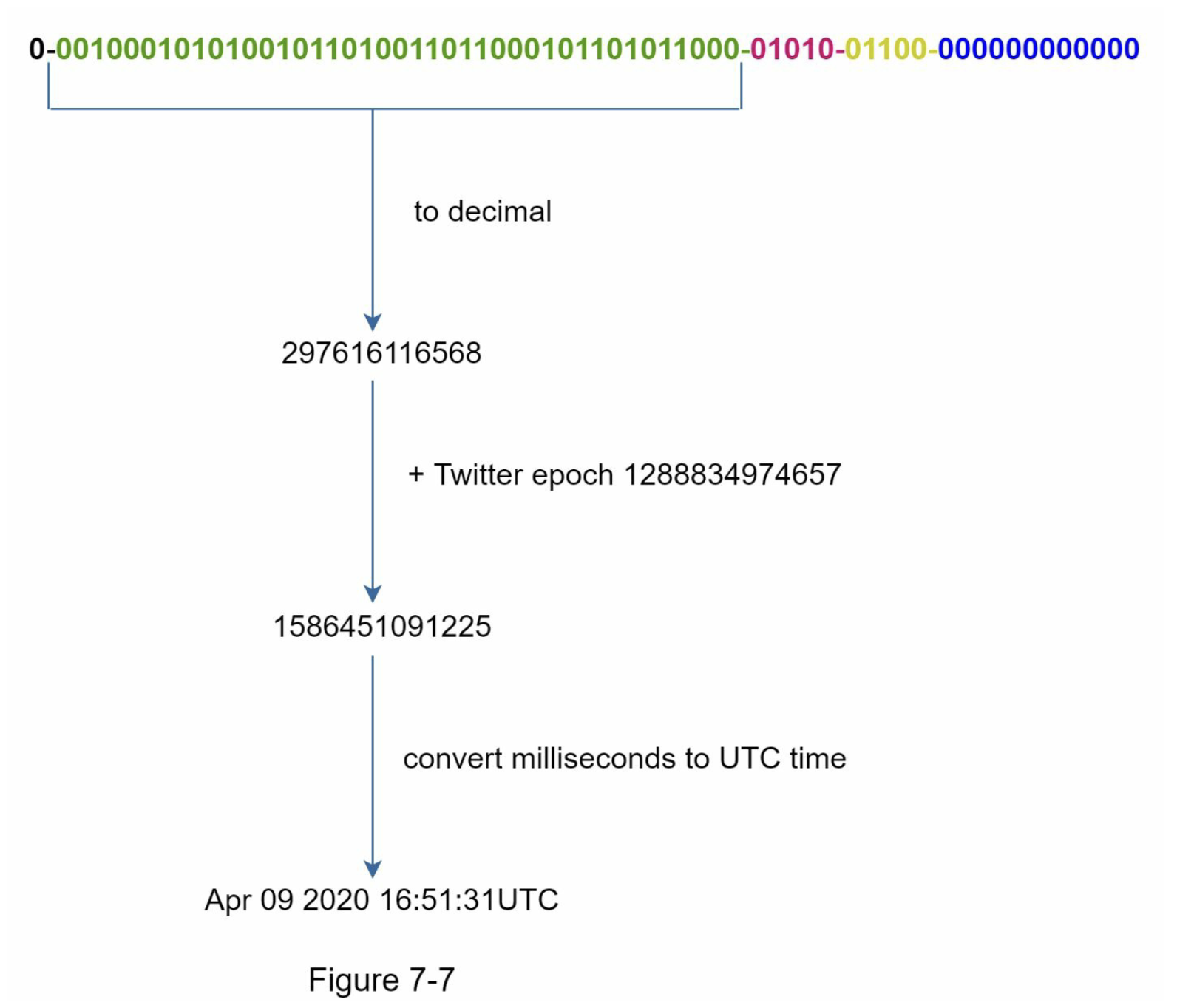

最重要的41位组成了时间戳部分。由于时间戳随时间增长,ID可按时间排序。

图 7-7 显示了二进制表示如何转换为 UTC 的示例。您还可以使用类似的方法将 UTC 转换回二进制表示。

可以用 41 位表示的最大时间戳是: $$2 ^ {41} - 1 = 2199023255551毫秒(ms)$$,这样我们就可以得到。 $$\approx 69年=2199023255551毫秒/1000秒/365天/24小时/3600秒$$。

这意味着 ID 生成器将工作 69 年,并且自定义纪元时间接近今天的日期会延迟溢出时间。 69年后,我们将需要一个新的纪元时间或采用其他技术来迁移ID。

序列号

序列号是 12 位,这给了我们 $$\mathbf{2 ^ {12} = 4096}$$ 种组合。除非在同一台服务器上在一毫秒内生成多个 ID,否则该字段为 0。理论上,一台机器每毫秒最多可以支持4096个新ID。

第4步:总结

在本章中,我们讨论了设计唯一 ID 生成器的不同方法:多主复制、UUID、票务服务器和类似 Twitter 雪花的唯一 ID 生成器。我们选择了雪花,因为它支持我们所有的用例,并且在分布式环境中是可扩展的。

如果面试结束时有额外时间,这里有一些额外的谈话要点:

- 时钟同步。在我们的设计中,我们假设 ID 生成服务器具有相同的时钟。当服务器在多个内核上运行时,此假设可能不成立。同样的挑战存在于多机场景中。时钟同步的解决方案超出了本书的范围;但是,了解问题的存在很重要。网络时间协议是这个问题最流行的解决方案。有兴趣的读者可以参考参考资料[4]。

- 节段长度调整。例如,较少的序列号但较多的时间戳位对低并发性和长期应用是有效的。

- 高可用性。由于 ID 生成器是关键任务系统,因此它必须具有高可用性

恭喜你走到了这一步!现在给自己一个鼓励,干得漂亮!

参考资料

[1] Universally unique identifier: https://en.wikipedia.org/wiki/Universally_unique_identifier

[2] Ticket Servers: Distributed Unique Primary Keys on the Cheap:https://code.flickr.net/2010/02/08/ticket-servers-distributed-unique-primary-keys-on-the-cheap

[3] Announcing Snowflake: https://blog.twitter.com/engineering/en_us/a/2010/announcing-snowflake.html

[4] Network time protocol: https://en.wikipedia.org/wiki/Network_Time_Protocol

第08章:短网址设计

在这一章中,我们将解决一个有趣而经典的系统设计面试问题:设计一个像tinyurl一样的URL缩短服务。

第1步:了解问题并确定设计范围

系统设计的面试问题是故意留有余地的。为了设计一个精心设计的系统,关键是要问清楚问题。

候选人:你能举个例子说明URL缩短器的工作原理吗?

面试官:假设 URL https://www.systeminterview.com/q=chatsystem&c=loggedin&v=v3&l=long 是原始 URL。你的服务创建了一个长度较短的别名:https://tinyurl.com/y7keocwj。如果你单击较短的别名URL,它会将你重定向到原始 URL。

候选人:流量是多少?

面试官:每天产生1亿个URL。

候选人:缩短后的URL有多长?

面试官:越短越好。

候选人:缩短的网址中允许使用哪些字符?

面试官:短网址可以是数字(0-9)和字符(a-z,A-Z)的组合。

候选人:缩短的URL可以删除或更新吗?

面试官:为了简单起见,我们假设缩短的URL不能被删除或更新。

以下是基本用例:

- URL缩短:给定一个长的URL => 返回一个短得多的URL

- URL重定向:给定一个短的URL => 重定向到原来的URL

- 高可用性、可扩展性和容错考虑

粗略估计系统量级

- 写操作:每天产生1亿个URL。

- 每秒写操作:亿/24/3600 = 1160

- 读操作:假设读操作和写操作的比例为10:1,读每秒操作:1160 * 10 = 11,600

- 假设 URL 缩短服务将运行 10 年,这意味着我们必须支持 1 亿 * 365 * 10 = 3650 亿条记录。

- 假设平均 URL 长度为 100。

- 10 年的存储需求:3650 亿 * 100 字节 * 10 年 = 365 TB

重要的是,你要与面试官一起探讨假设和计算,以便你们两个人都在同一起跑线上。

第2步:提出高层次的设计方案并获得认同

在本节中,我们将讨论 API 端点、URL 重定向和 URL 缩短。

API 端点

API端点促进了客户和服务器之间的通信。我们将设计REST风格的API。如果你不熟悉restful API,你可以查阅外部资料,比如参考资料中的资料[1]。一个URL缩短器主要需要两个API端点。

-

网址缩短。 要创建一个新的短 URL,客户端发送一个 POST 请求,其中包含一个参数:原始长 URL。 API 如下所示:

POST api/v1/data/shorten

- 请求参数:{longUrl: longURLString}。

- 返回 shortURL

-

URL重定向。为了将一个短的URL重定向到相应的长的URL,一个客户端发送一个GET请求。该API看起来像这样:

GET api/v1/shortUrl

- 返回用于HTTP重定向的 longURL

URL 重定向

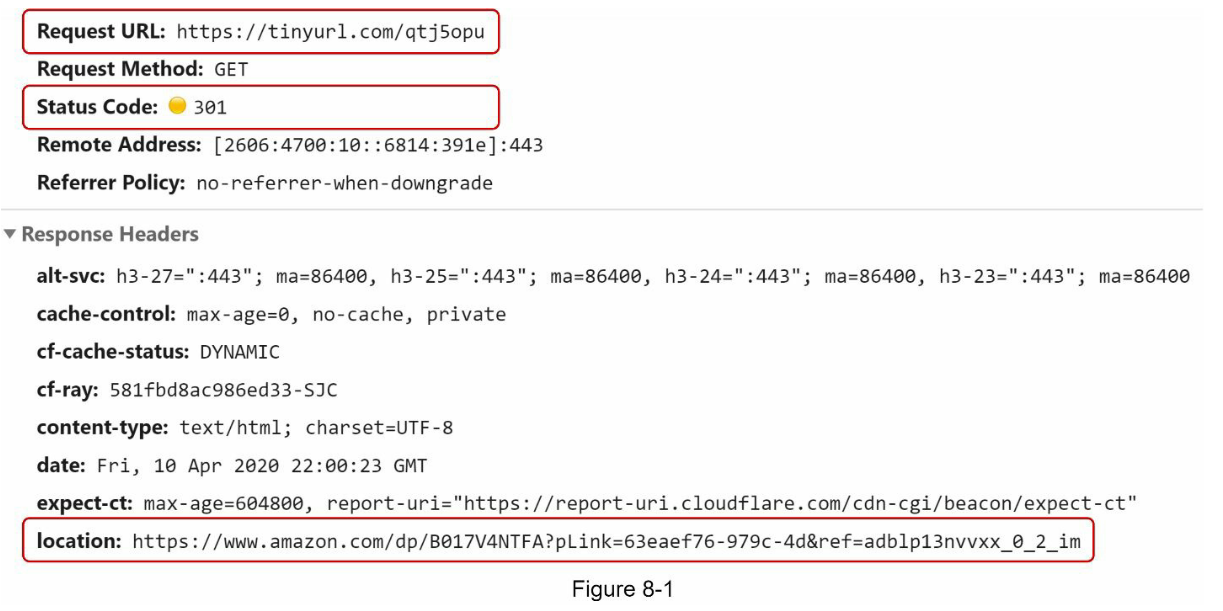

图8-1显示了当你在浏览器上输入一个tinyurl时会发生什么。一旦服务器收到tinyurl请求,它就会用301重定向将短网址改为长网址。

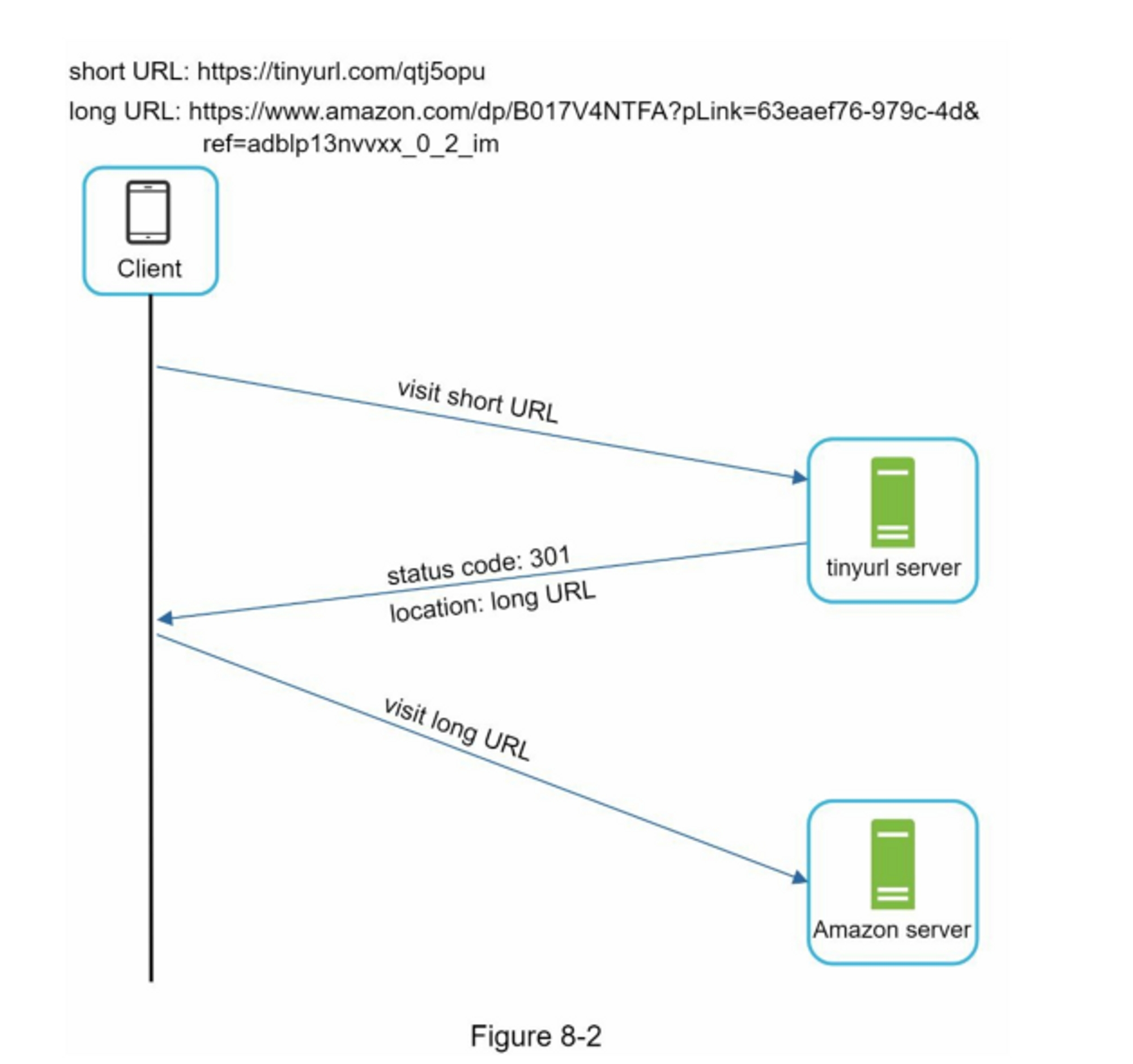

客户端和服务器之间的详细通信情况如图8-2所示。

值得在这里讨论的一件事是 301 重定向与 302 重定向。

- 301重定向。301重定向表明,请求的URL被 "永久 "地移到了长URL上。由于是永久重定向,浏览器会缓存响应,对同一URL的后续请求将不会被发送到URL缩短服务上。相反,请求将直接被重定向到长网址服务器。

- 302重定向。302重定向意味着URL被 "暂时 "移到长URL上,这意味着对同一URL的后续请求将首先被发送到URL缩短服务上。然后,它们会被重定向到长网址服务器。

每种重定向方法都有其优点和缺点。如果优先考虑减少服务器负载,使用301重定向是有意义的,因为只有同一URL的第一个请求被发送到URL缩短服务器。然而,如果分析是重要的,302重定向是一个更好的选择,因为它可以更容易地跟踪点击率和点击的来源。

实现URL重定向的最直观的方法是使用哈希表。假设哈希表存储<shortURL, longURL>对,URL重定向可以通过以下方式实现。

- 获取longURL:

longURL = hashTable.get(shortURL) - 一旦你得到longURL,就执行URL重定向。

缩短网址

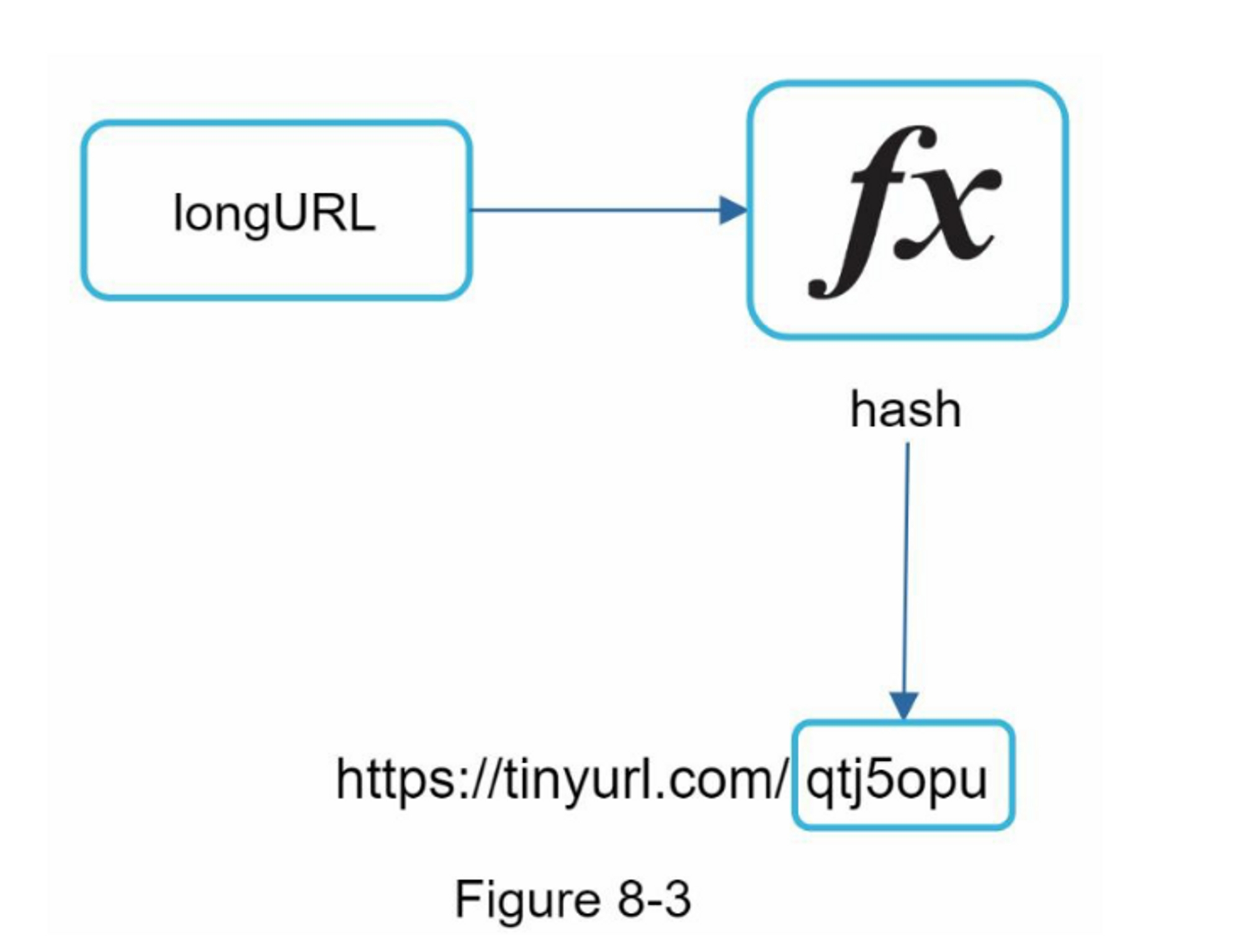

让我们假设短的URL看起来像这样:www.tinyurl.com/{hashValue}。为了支持缩短URL的用例,我们必须找到一个哈希函数fx,将长URL映射到hashValue,如图8-3所示。

哈希函数必须满足以下要求。

- 每个longURL必须被散列成一个hashValue。

- 每个hashValue都可以被映射回longURL。

哈希函数的详细设计将深入讨论。

第3步:深入设计

到目前为止,我们已经讨论了URL缩短和URL重定向的高层设计。在本节中,我们将深入探讨以下内容:数据模型、哈希函数、URL缩短和URL重定向。

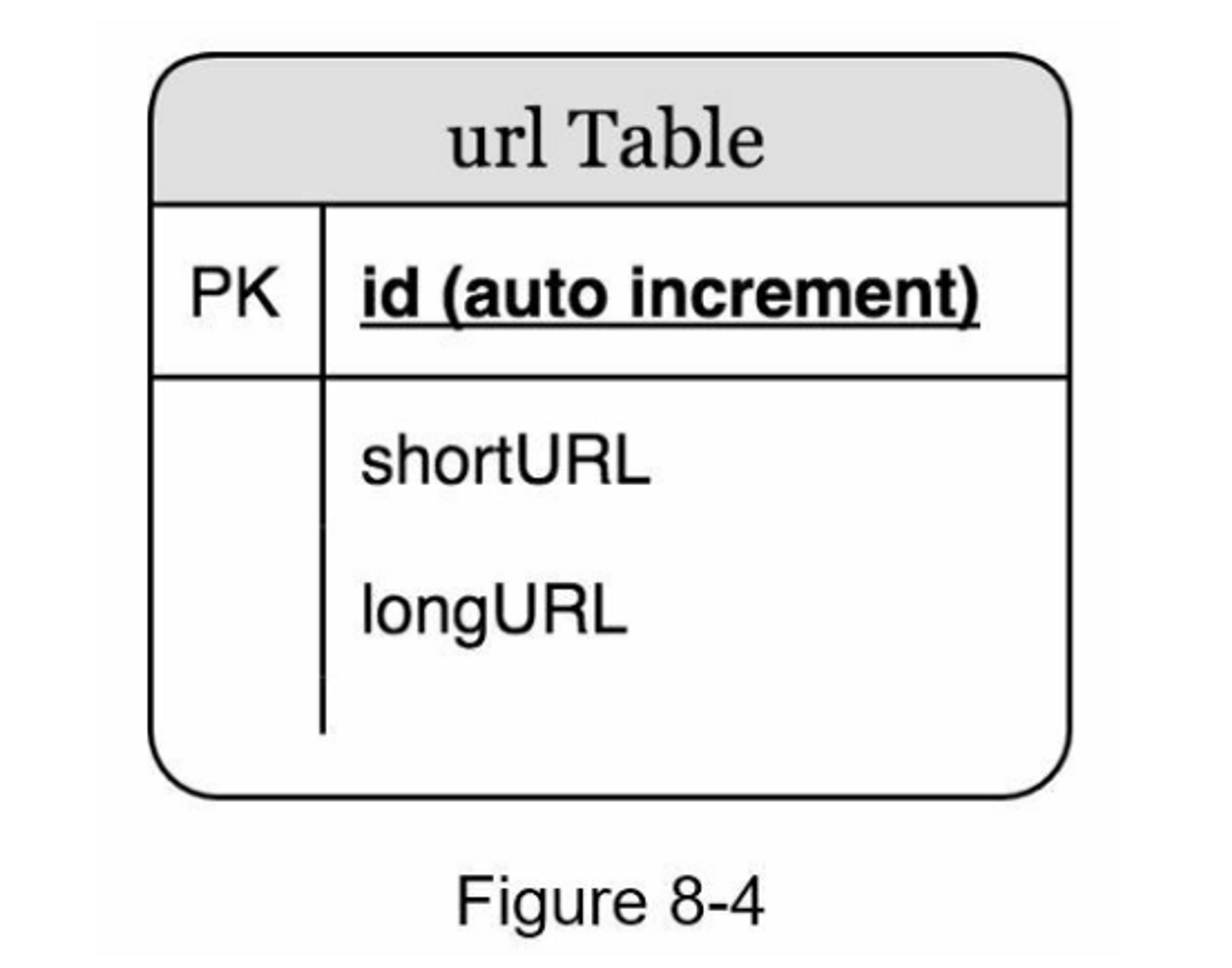

数据模型

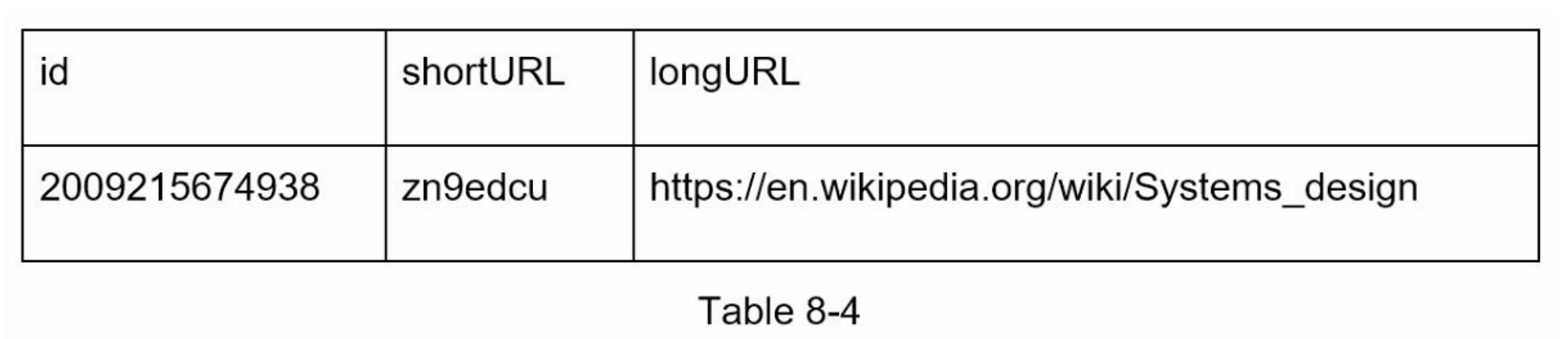

在高层设计中,所有的东西都存储在一个哈希表中。这是一个很好的起点;然而,这种方法在现实世界的系统中是不可行的,因为内存资源是有限的和昂贵的。一个更好的选择是将<shortURL, longURL>映射存储在一个关系数据库中。图8-4显示了一个简单的数据库表设计。简化版的表包含3列:id、shortURL、longURL。

哈希函数

哈希函数用于将一个长的URL哈希成一个短的URL,也称为 hashValue。

哈希值的长度

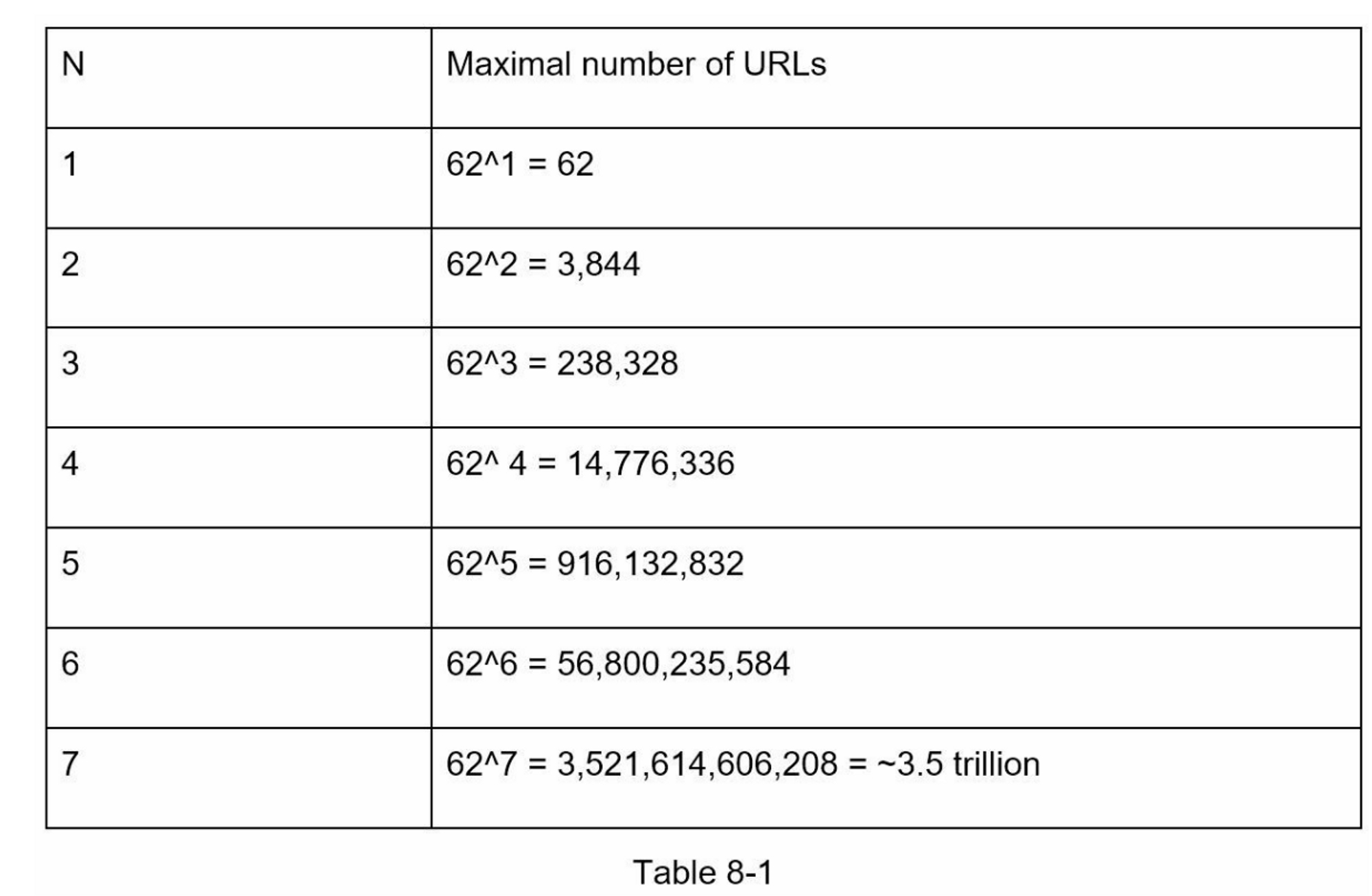

hashValue 由[0-9, a-z, A-Z]中的字符组成,包含 $$10+26+26=62$$ 个可能的字符。要计算 hashValue 的长度,请找出最小的 n,使 $$62^n \ge 365亿$$。根据估计,系统必须支持多达 3650 亿个 URL。 表 8-1 显示了 hashValue 的长度和它可以支持的相应的最大 URL 数。

当 $$n = 7$$ 时, $$62 ^ n \approx 3.5万亿$$,3.5 万亿足以容纳 3650亿个URL,所以 hashValue 的长度为 7。

我们将探讨两种类型的URL缩短器的哈希函数。第一种是 "哈希+碰撞解决",第二种是 "base 62 转换"。让我们逐一来看看它们。

哈希+碰撞解决

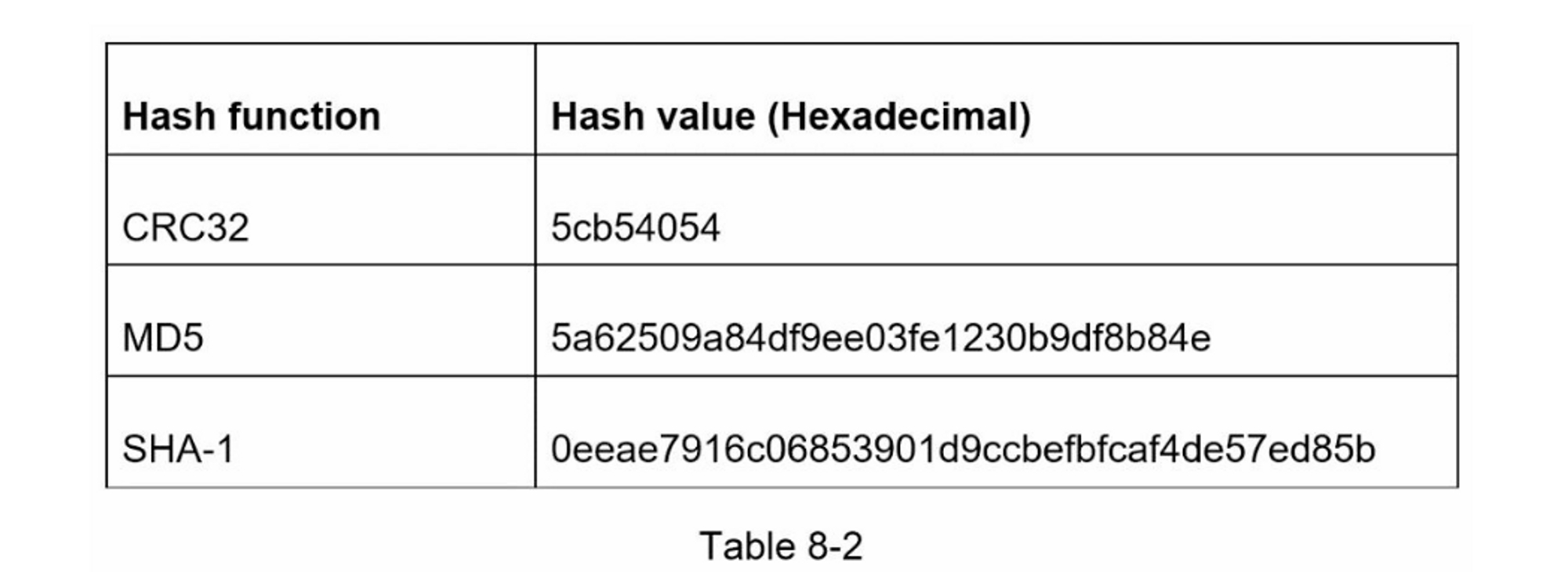

为了缩短长的URL,我们应该实现一个散列函数,将长的URL散列成一个7个字符的字符串。一个直接的解决方案是使用知名的哈希函数,如CRC32、MD5或SHA-1。下表比较了在这个URL(https://en.wikipedia.org/wiki/Systems_design)上应用不同哈希函数后的哈希结果:

如表8-2所示,即使是最短的哈希值(来自CRC32)也太长了(超过7个字符)。我们怎样才能使它更短呢?

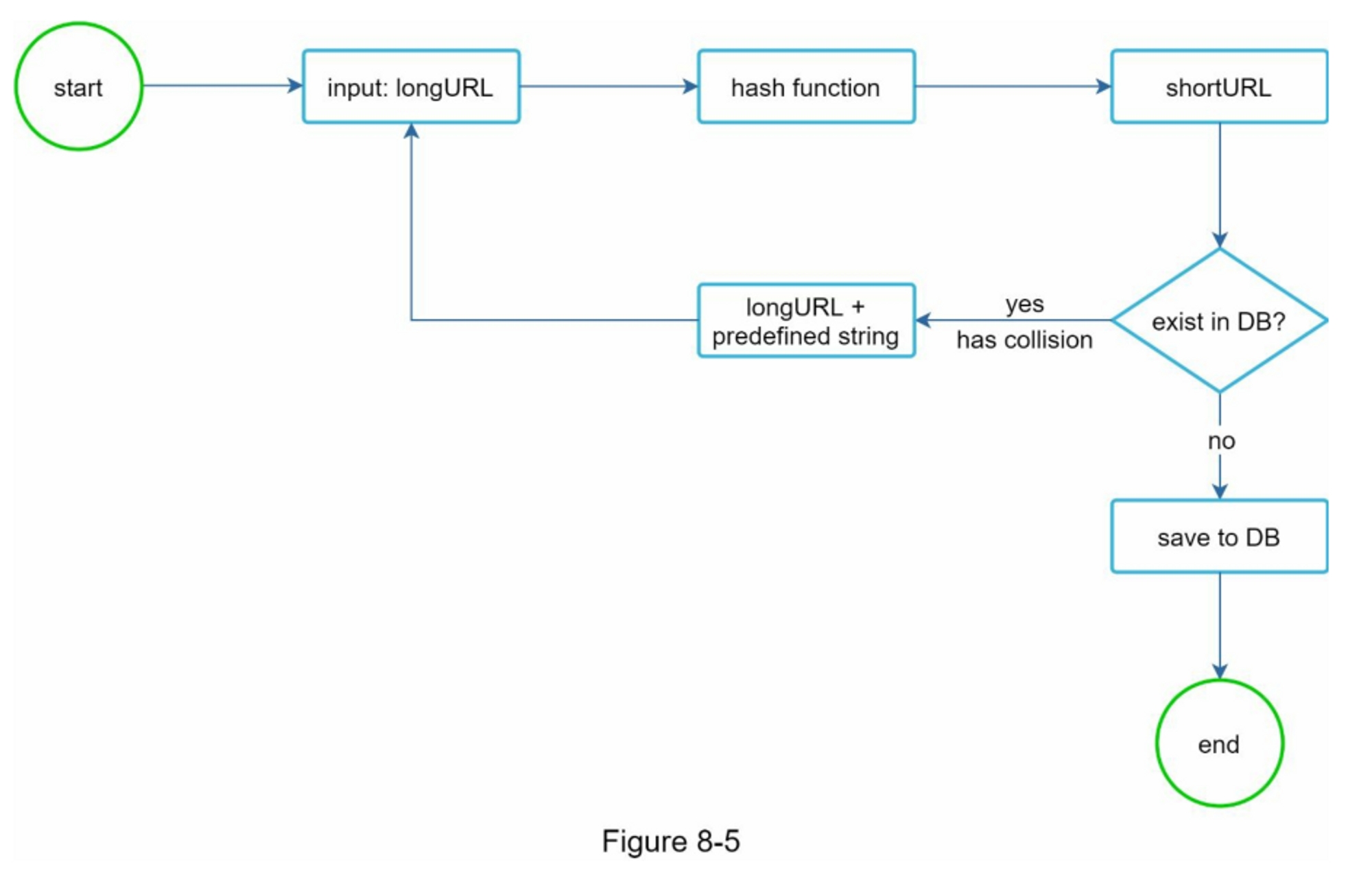

第一种方法是收集哈希值的前7个字符;然而,这种方法会导致哈希碰撞。为了解决哈希碰撞,我们可以递归地追加一个新的预定义字符串,直到不再发现碰撞。这一过程在图8-5中得到了解释。

这种方法可以消除碰撞;但是,查询数据库以检查每个请求是否存在短网址的成本很高。一种叫做Bloom过滤器的技术[2]可以提高性能。布隆过滤器是一种空间效率高的概率技术,用来测试一个元素是否是一个集合的成员。更多细节请参考参考资料[2]。

base 62 转换

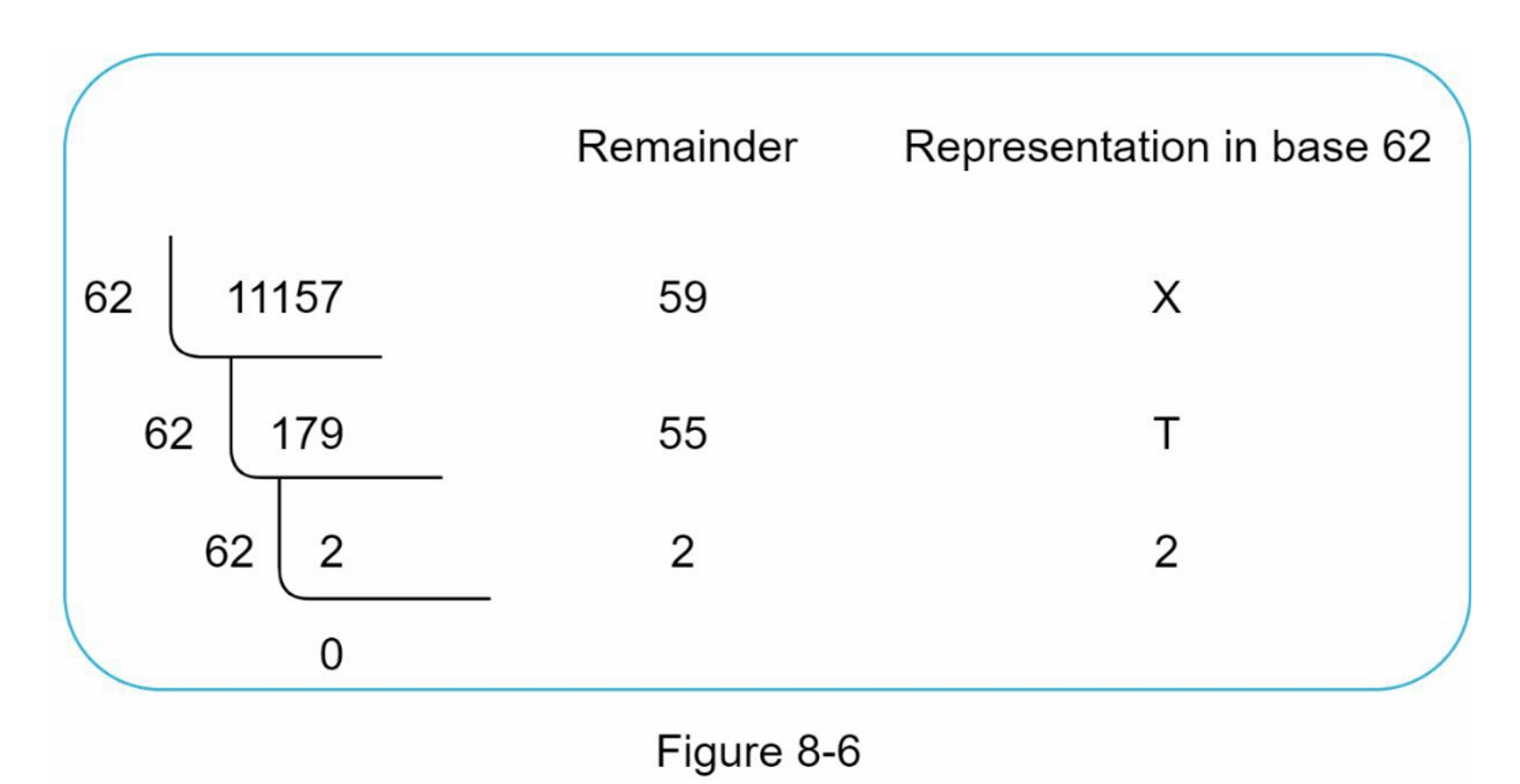

Base 转换是 URL 缩短器常用的另一种方法。 Base 转换有助于在不同的数字表示系统之间转换成相同的数字。 使用 Base 62 转换,因为 hashValue 有 62 个可能的字符。 让我们用一个例子来解释转换的工作原理:将 $$11157_{10}$$ 转换为 base 62 表示( $$11157_{10}$$ 在 base 10 系统中表示 11157)。

-

从名字上看,base 62 是一种使用 62 个字符进行编码的方式。 映射是: 0-0, ..., 9-9, 10-a, 11-b, ..., 35-z, 36-A, ..., 61-Z,其中“a”代表 10,“Z” ' 代表 61,等等。

-

$$11157_{10} = 2 \times 62^2 + 55 \times 62^1 + 59 \times 62^0 = \left [2, 55, 59 \right ] \rightarrow \left [2, T, X \right]$$ 以 base 62 表示。

对话过程如图8-6所示。

-

因此,短网址是:https://tinyurl.com/2TX

两种方法的比较

下表显示了两种方法的差异。

| 哈希+碰撞解决 | base 62 转换 |

|---|---|

| 固定短URL长度 | 短URL长度不固定,它随着 id 变化 |

| 不需要唯一ID生成器 | 该选项依赖于唯一ID生成器 |

| 可能出现冲突,必须解决 | 碰撞是不可能的,因为 ID 是唯一的 |

| 不可能计算出下一个可用的短网址,因为它不依赖于ID。 | 如果新条目的 ID 递增 1,则很容易找出下一个可用的短 URL。 这可能是一个安全问题。 |

URL 缩短的深入研究

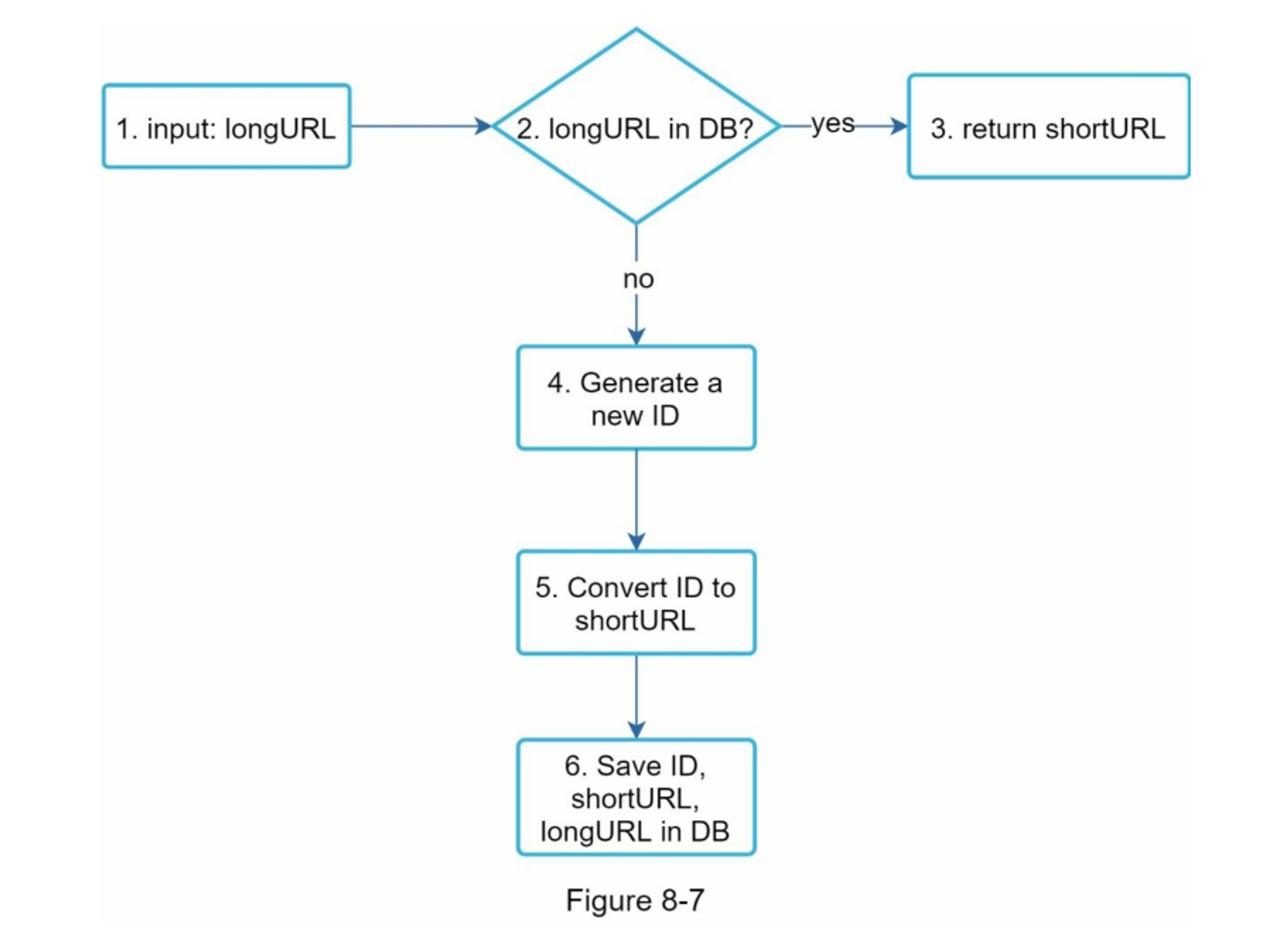

作为系统的核心部分之一,我们希望URL缩短的流程在逻辑上是简单和实用的。在我们的设计中使用了62进制转换。我们建立了以下图表(图8-7)来演示这个流程。

- longURL 是输入的

- 系统检查 longURL 是否存在于数据库中

- 如果是的话,这意味着longURL之前被转换为shortURL。在这种情况下,从数据库中获取shortURL并将其返回给客户端。

- 如果不是,longURL是新的。一个新的唯一ID(主键)由唯一ID生成器生成。

- 使用base 62转换将ID转换为shortURL。

- 用ID、shortURL和longURL创建一个新的数据库记录。

为了使流程更容易理解,让我们看一个具体的例子。

-

假设输入的longURL是:https://en.wikipedia.org/wiki/Systems_design

-

唯一ID生成器返回ID:2009215674938

-

使用62进制转换将ID转换为shortURL。ID(2009215674938)被转换为 "zn9edcu"。

-

将ID、shortURL和longURL保存到数据库,如表8-4所示。

值得一提的是分布式唯一 ID 生成器。 它的主要功能是生成全局唯一 ID,用于创建 shortURL。 在高度分布式的环境中,实现唯一 ID 生成器具有挑战性。 幸运的是,我们已经在“第 7 章:在分布式系统中设计唯一 ID 生成器”中讨论了一些解决方案。 你可以回过头来回顾它来刷新你的记忆。

URL重定向的深入研究

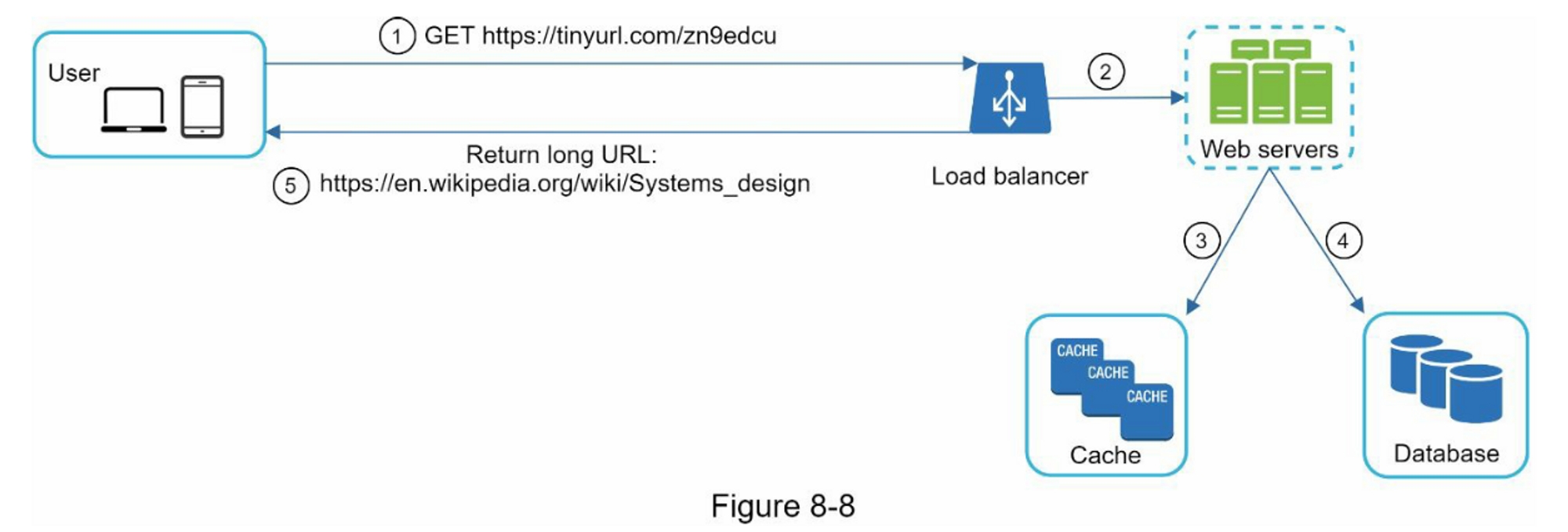

图 8-8 显示了 URL 重定向的详细设计。 由于读取多于写入,<shortURL, longURL> 映射存储在缓存中以提高性能。

URL重定向的流程总结如下:

- 一个用户点击了一个短的URL链接:

https://tinyurl.com/zn9edcu - 负载均衡器将请求转发给网络服务器

- 如果shortURL已经在缓存中,直接返回longURL。

- 如果短URL不在缓存中,从数据库中获取长URL。如果它不在数据库中,很可能是用户输入了一个无效的短网址。

- longURL被返回给用户。

第4步:总结

在本章中,我们讨论了 API 设计、数据模型、哈希函数、URL 缩短和 URL 重定向。

如果在面试结束时有多余的时间,这里有几个额外的谈话要点:

- 速率限制器:我们可能面临的一个潜在安全问题是恶意用户发送大量的 URL 缩短请求。 速率限制器有助于根据 IP 地址或其他过滤规则过滤掉请求。 如果您想重温有关速率限制的记忆,请参阅“第 4 章:设计速率限制器”。

- Web 服务器扩展:由于 Web 层是无状态的,因此很容易通过添加或删除 Web 服务器来扩展 Web 层。

- 数据库的扩展。数据库复制和分片是常见的技术。

- 分析。数据对商业成功越来越重要。将分析解决方案整合到URL缩短器中,可以帮助回答一些重要的问题,如有多少人点击一个链接?他们何时点击链接?等等。

- 可用性、一致性和可靠性。这些概念是任何大型系统成功的核心。我们在第1章中对它们进行了详细讨论,请对这些主题进行复习记忆

恭喜你走到了这一步!现在给自己一个鼓励,干得漂亮!

参考资料

[1] A RESTful Tutorial: https://www.restapitutorial.com/index.html

[2] Bloom filter: https://en.wikipedia.org/wiki/Bloom_filter

第09章:网络爬虫设计

本章重点介绍网络爬虫设计:一道有趣且经典的系统设计面试题。

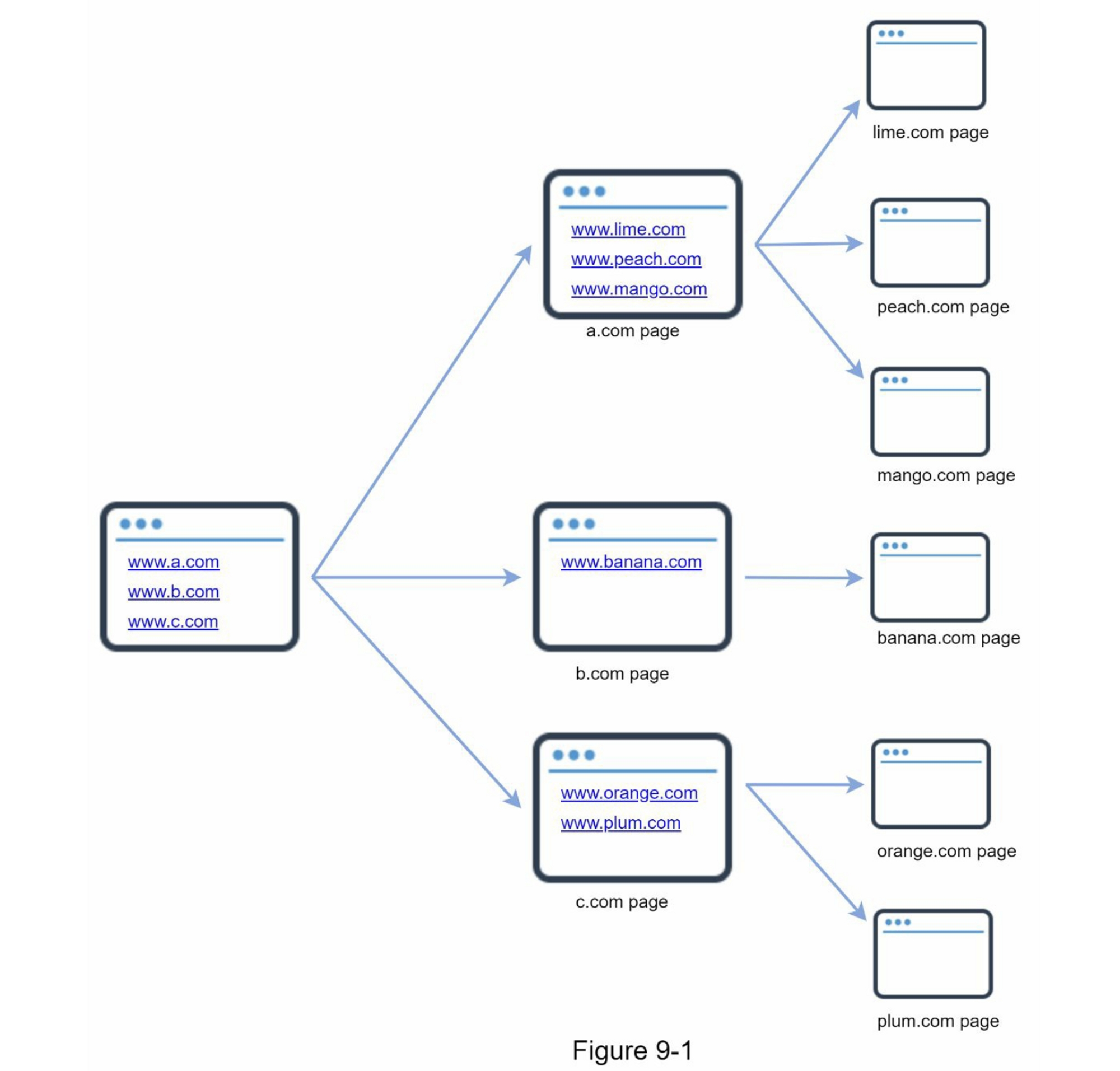

网络爬虫被称为机器人或蜘蛛。搜索引擎广泛使用它来发现 Web 上的新内容或更新内容。内容可以是网页、图像、视频、PDF 文件等。网络爬虫首先收集一些网页,然后按照这些页面上的链接收集新内容。图 9-1 显示了抓取过程的可视化示例。

爬虫有多种用途:

- 搜索引擎索引:这是最常见的用例。爬虫收集网页以为搜索引擎创建本地索引。例如,Googlebot 是 Google 搜索引擎背后的网络爬虫。

- 网络存档:这是从网络收集信息以保存数据以备将来使用的过程。例如,许多国家图书馆运行爬虫来存档网站。著名的例子是美国国会图书馆 [1] 和欧盟网络档案馆 [2]。

- 网络挖掘:网络的爆炸式增长为数据挖掘提供了前所未有的机会。 网络挖掘有助于从 Internet 中发现有用的知识。例如,顶级金融公司使用爬虫下载股东大会和年度报告以了解公司的关键举措。

- 网络监控:这些爬虫有助于监控 Internet 上的版权和商标侵权行为。例如,Digimarc [3] 利用爬虫来发现盗版作品和报告。

开发网络爬虫的复杂性取决于我们打算支持的规模。它可以是一个只需要几个小时即可完成的小型学校项目,也可以是一个需要专门的工程团队不断改进的大型项目。因此,我们将在下面探讨支持的规模和功能。

第1步:了解问题并确定设计范围

网络爬虫的基本算法很简单:

- 给定一组URLs,下载所有由URLs指向的网页。

- 从这些网页中提取 URL。

- 将新的 URL 添加到要下载的 URL 列表中。重复这3个步骤。

网络爬虫真的像这个基本算法一样简单吗?不完全是。设计一个高度可扩展的网络爬虫是一项极其复杂的任务。任何人都不太可能在面试时间内设计出一个庞大的网络爬虫。在进入设计之前,我们必须提出问题以了解需求并建立设计范围:

候选人:爬虫的主要目的是什么?它用于搜索引擎索引、数据挖掘或其他用途吗?

面试官:搜索引擎索引。

候选人:网络爬虫每个月收集多少网页?

采访者:10 亿页。

候选人:包括哪些内容类型?仅 HTML 还是其他内容类型(如 PDF 和图像)?

面试官:只有 HTML。

候选人:我们是否考虑新增或编辑的网页?

面试官:是的,我们应该考虑新添加或编辑的网页。

候选人:我们需要存储从网络上爬取的 HTML 页面吗?

面试官:是的,最多5年

应聘者:我们如何处理内容重复的网页?

面试官:重复内容的页面应该忽略。

以上是您可以向面试官提出的一些示例问题。了解需求并澄清歧义很重要。即使你被要求设计一个简单的产品,比如网络爬虫,你和你的面试官可能不会有相同的假设。

除了要向面试官澄清的功能之外,记下优秀网络爬虫的以下特征也很重要:

- 可伸缩性(Scalability):网络非常大。那里有数十亿个网页。使用并行化网络爬行应该非常有效。

- 鲁棒性(Robustness):网络充满了陷阱。错误的 HTML、无响应的服务器、崩溃、恶意链接等都很常见。爬虫必须处理所有这些边缘情况。

- 礼貌(Politeness):爬虫不应该在短时间间隔内向网站发出太多请求。

- 可扩展性(Extensibility):系统非常灵活,因此只需进行最少的更改即可支持新的内容类型。比如我们以后要抓取图片文件,应该不需要重新设计整个系统。

粗略估算

以下估算基于许多假设,与面试官沟通以达成共识很重要。

- 假设每月下载 10 亿个网页。

- QPS: $$1,000,000,000 / 30 天 / 24 小时 / 3600 秒 = 400 页/秒。$$

- $$峰值 QPS = 2 \times QPS = 800$$

- 假设平均网页大小为 500k

- $$10 亿页 \times 500k = 每月 500 TB$$ 存储空间。如果您对数字存储单元不清楚,请重新阅读第 2 章中的“2 的幂”部分。

- 假设数据存储五年, $$500 TB \times 12 个月 \times 5 年 = 30 PB$$。需要 30 PB 的存储来存储五年的内容。

第2步:提出高层次的设计方案并获得认同

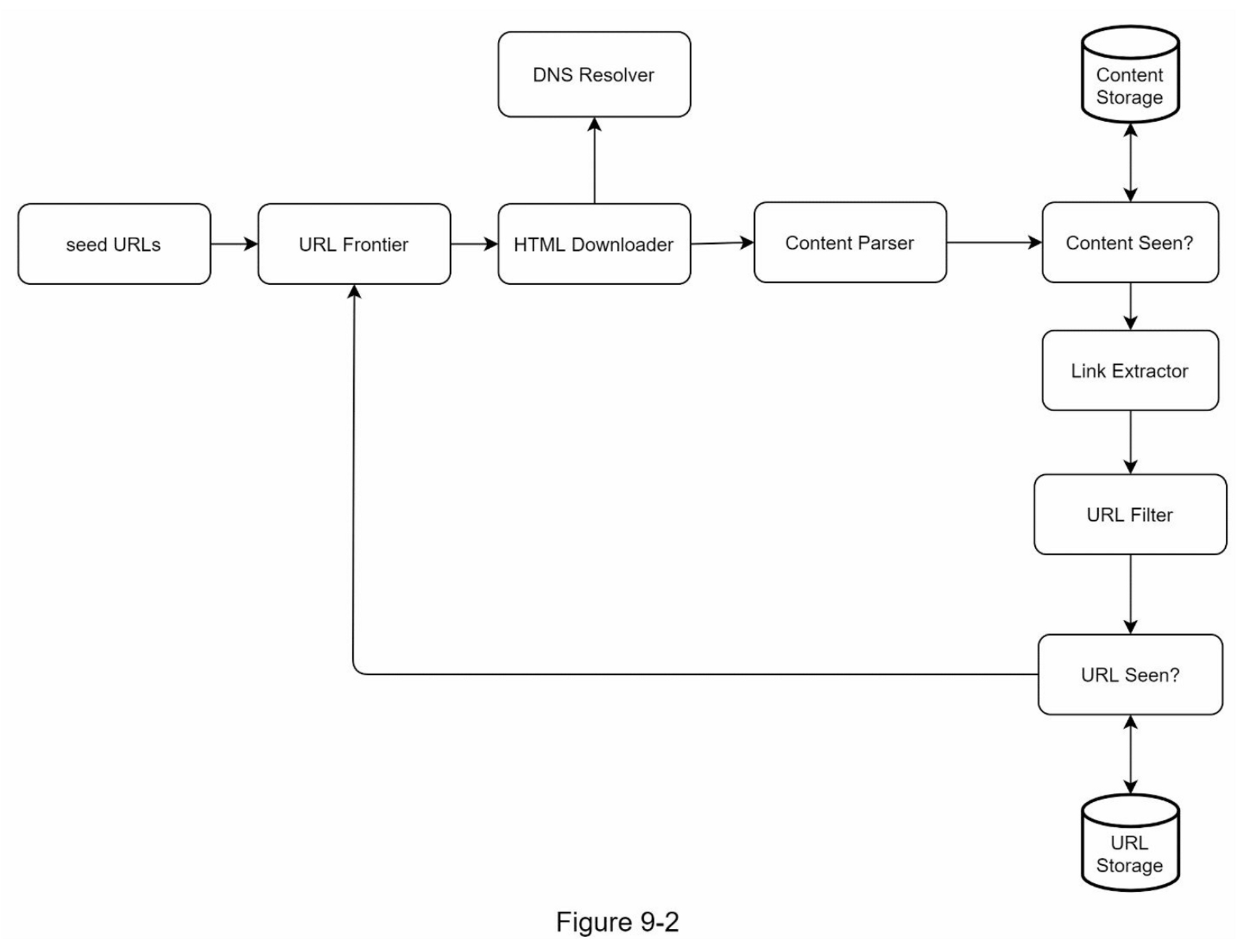

一旦需求明确了,我们就开始进行高层设计。受以前关于网络抓取的研究[4][5]的启发,我们提出了一个高层设计,如图9-2所示。

首先,我们探索每个设计组件以了解它们的功能。然后,我们逐步检查爬虫工作流程。

Seed URLs

网络爬虫使用种子 URL 作为爬网过程的起点。例如,要抓取大学网站的所有网页,选择种子 URL 的一种直观方法是使用大学的域名。

要抓取整个网络,我们需要创造性地选择种子 URL。一个好的种子 URL 是一个很好的起点,爬虫可以利用它来遍历尽可能多的链接。一般的策略是将整个 URL 空间分成更小的空间。第一个提议的方法是基于位置的,因为不同的国家可能有不同的流行网站.

另一种方法是根据主题选择种子网址;例如,我们可以将 URL 空间划分为购物、体育、医疗保健等。种子 URL 选择是一个开放式问题,您不应该给出完美的答案,先大胆想想。

URL Frontier

大多数现代网络爬虫将爬行状态分为两种:待下载和已下载。存储待下载的URL的组件被称为URL Frontier。你可以把它称为先进先出(FIFO)队列。关于URL Frontier的详细信息,请参考深入研究的内容。

HTML Downloader

HTML Downloader 从互联网上下载网页。这些URL是由URL Frontier提供的。

DNS Resolver

要下载网页,必须将 URL 转换为 IP 地址。 HTML Downloader 调用 DNS Resolver 为 URL 获取相应的 IP 地址。例如,截至 2019 年 3 月 5 日,URL www.wikipedia.org 已转换为 IP 地址 198.35.26.96。

Content Parser

下载网页后,必须对其进行解析和验证,因为格式错误的网页可能会引发问题并浪费存储空间。在爬网服务器中实现内容解析器会减慢爬网过程。因此,Content Parser(内容解析器)是一个单独的组件。

Content Seen?

在线研究[6]显示,29%的网页是重复的内容,这可能导致同一内容被多次存储。我们引入了 "Content Seen? "数据结构,以消除数据的冗余,缩短处理时间。它有助于检测以前存储在系统中的新内容。为了比较两个HTML文档,我们可以逐个字符进行比较。然而,这种方法既慢又费时,特别是当涉及到数十亿的网页时。完成这项任务的一个有效方法是比较两个网页的哈希值[7]。

Content Storage

它是一个用于存储HTML内容的存储系统。存储系统的选择取决于诸如数据类型、数据大小、访问频率、寿命等因素,磁盘和内存都被使用。

- 大部分内容存储在磁盘上,因为数据集太大而无法放入内存。

- 热门内容保存在内存中以减少延迟。

URL Extractor

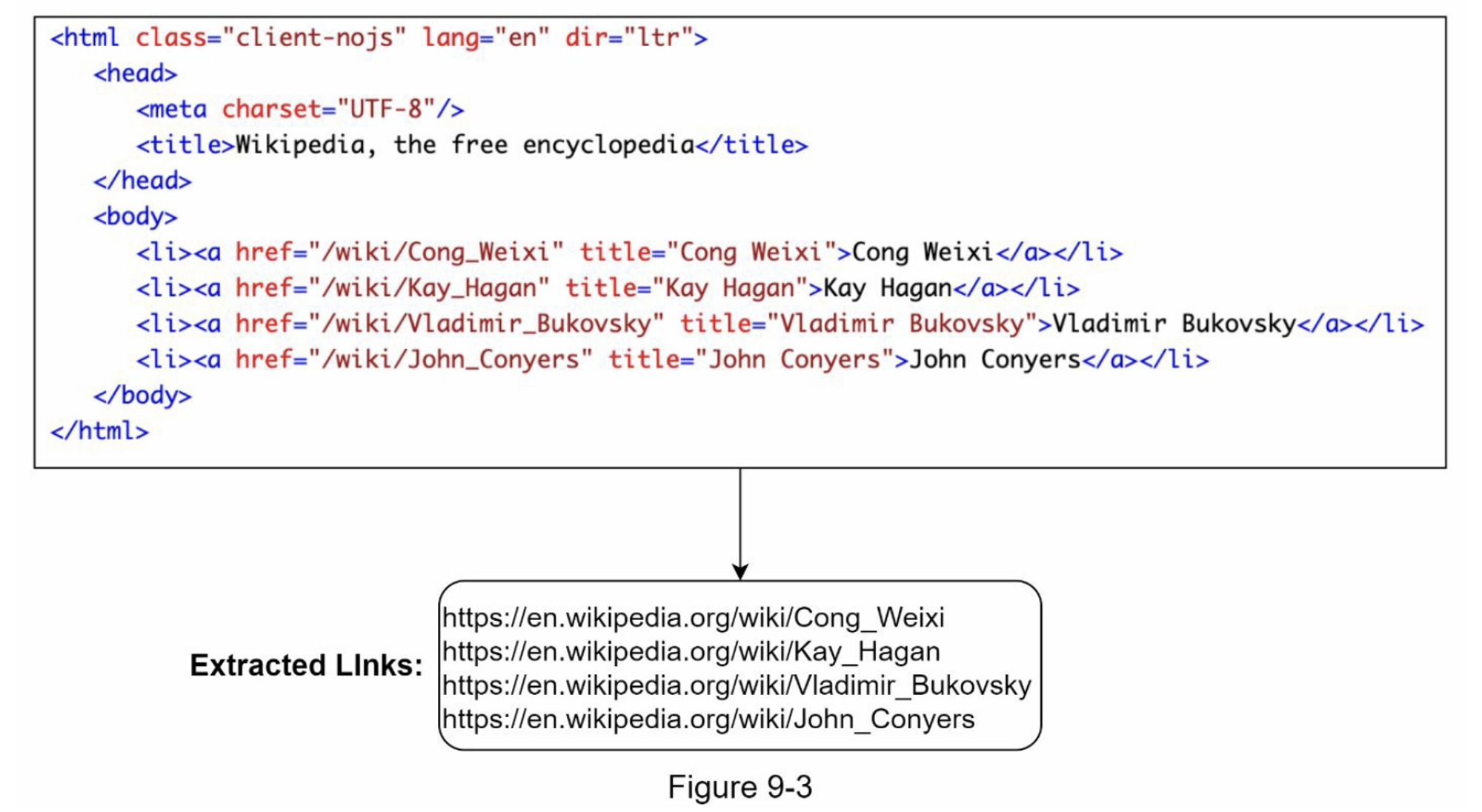

URL Extractor(网址提取器) 从 HTML 页面解析和提取链接。图 9-3 显示了链接提取过程的示例。通过添加“https://en.wikipedia.org”前缀将相对路径转换为绝对 URL。

URL Filter

URL Filter 排除某些内容类型、文件扩展名、错误链接和“黑名单”站点中的 URL。

URL Seen?

"URL Seen? "是一个数据结构,用于跟踪之前被访问过的或已经在Frontier中的URL。"URL Seen? "有助于避免多次添加相同的URL,因为这可能会增加服务器负载并导致潜在的无限循环。

布隆过滤器和哈希表是实现 "URL Seen? "组件的常用技术。我们不会在这里介绍布隆过滤器和哈希表的详细实现。欲了解更多信息,请参考参考资料[4][8]。

URL Storage

URL Storage 存储已经访问过的 URL。到目前为止,我们已经讨论了每个系统组件。接下来,我们将它们放在一起来解释工作流程。

网络爬虫工作流程

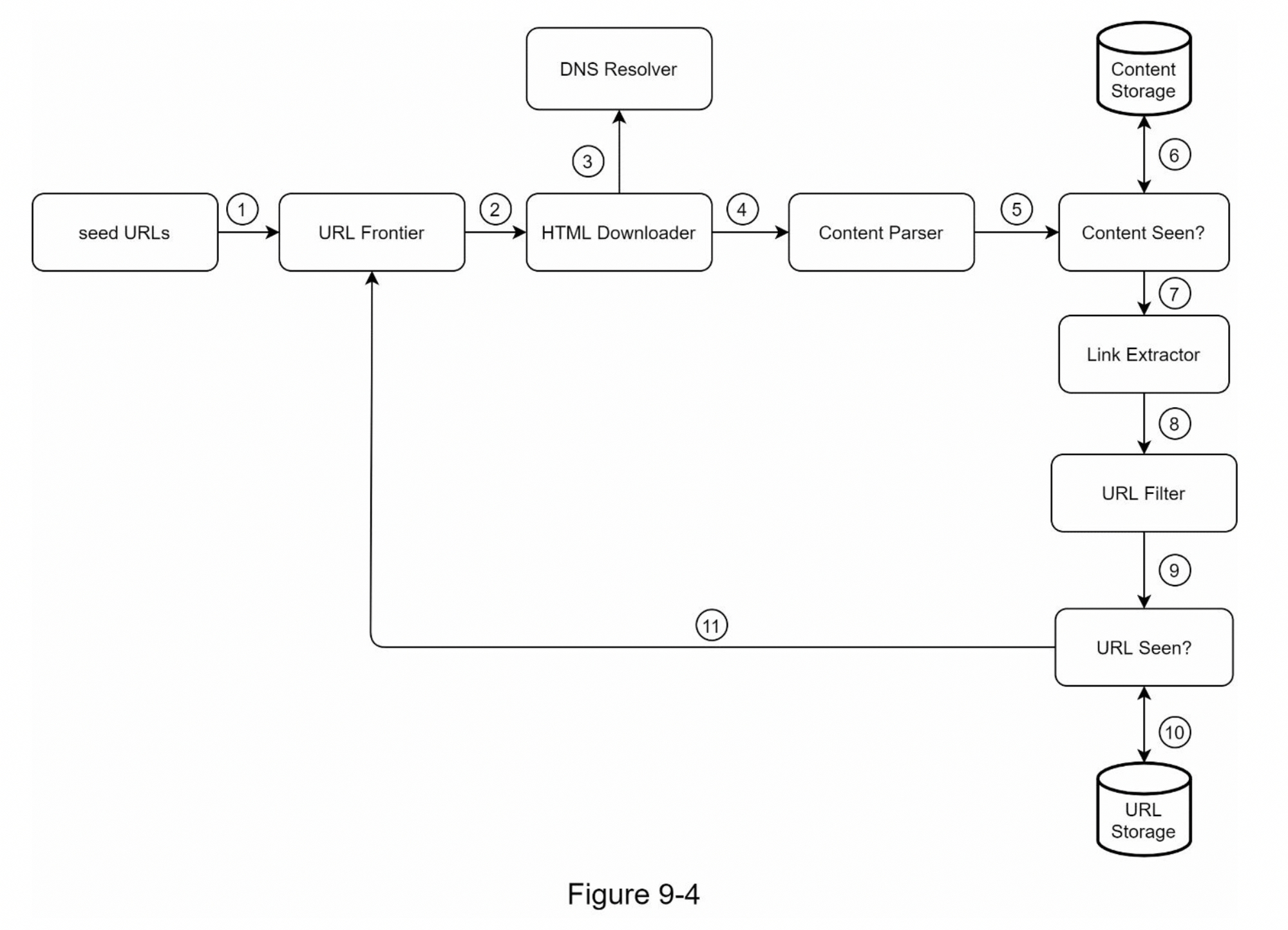

为了更好地逐步解释工作流程,在设计图中添加了序列号,如图 9-4 所示。

第 1 步:将种子 URL 添加到 URL Frontier

第 2 步:HTML 下载器从 URL Frontier 获取 URL 列表。

第 3 步:HTML 下载器从 DNS 解析器获取 URL 的 IP 地址并开始下载。

第 4 步:Content Parser 解析 HTML 页面并检查页面是否格式错误。

第 5 步:内容经过解析和验证后,传递给“Content Seen?”组件。

第 6 步:“Content Seen”组件检查 HTML 页面是否已在存储中。

- 如果在存储中,这意味着不同URL 中的相同内容已经被处理过。在这种情况下,HTML 页面将被丢弃。

- 如果不在存储中,则系统之前没有处理过相同的内容。内容被传递给链接提取器。

第 7 步:网址提取器从 HTML 页面中提取网址。

第 8 步:将提取的网址传递给 URL 过滤器。

第 9 步:网址过滤后,传递给“URL Seen?”组件。

第 10 步:“URL Seen”组件检查一个URL是否已经在存储中,如果是,则之前处理过,不需要做任何事情。

第 11 步:如果一个 URL 以前没有被处理过,它被添加到 URL Frontier。

第3步:深入设计

到目前为止,我们已经讨论了高层设计。接下来,我们将深入讨论最重要的构建组件和技术:

- 深度优先搜索 (DFS) 与广度优先搜索 (BFS)

- URL Frontier

- HTML Downloader

- 鲁棒性(Robustness)

- 可扩展性(Extensibility)

- 检测并避免有问题的内容

DFS vs BFS

你可以把网络想象成一个有向图,其中网页作为节点,超链接(URL)作为边。抓取过程可以被视为从一个网页到其他网页的有向图的遍历。两种常见的图形遍历算法是DFS和BFS。然而,DFS通常不是一个好的选择,因为DFS的深度可能很深。

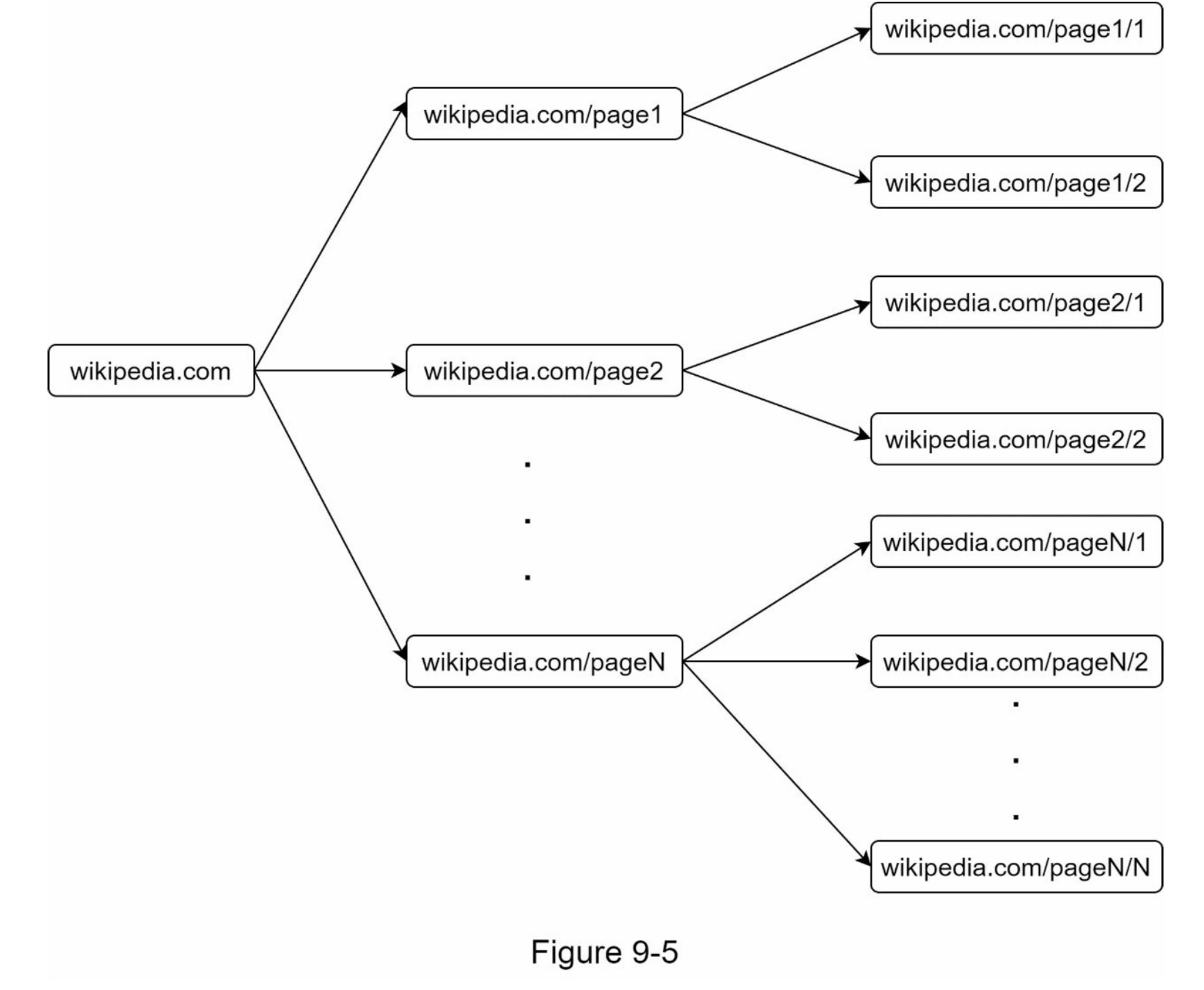

BFS 通常被网络爬虫使用,并通过先进先出 (FIFO) 队列实现。在 FIFO 队列中,URL 按照它们入队的顺序出队。但是,这种实现有两个问题:

-

来自同一网页的大多数链接都链接回同一主机。在图 9-5 中,wikipedia.com 中的所有链接都是内部链接,使得爬虫忙于处理来自同一主机(wikipedia.com)的 URL。当爬虫试图并行下载网页时,维基百科服务器将被请求淹没。这被认为是“不礼貌的”

-

标准的BFS没有考虑到一个URL的优先级。网络很大,不是每个页面都有相同的质量和重要性。因此,我们可能希望根据页面排名、网络流量、更新频率等来确定URL的优先级。

URL Frontier

URL Frontier 有助于解决这些问题。 URL Frontier 是一种存储要下载的 URL 的数据结构。 URL Frontier 是确保礼貌、URL 优先级和新鲜度的重要组成部分。参考资料 [5] [9] 中提到了一些关于 URL Frontier 的值得注意的论文。这些论文的研究结果如下:

-

礼貌性

一般来说,网络爬虫应该避免在短时间内向同一个托管服务器发送过多的请求。发送过多请求会被视为“不礼貌”,甚至被视为拒绝服务 (DOS) 攻击。例如,在没有任何限制的情况下,爬虫可以每秒向同一个网站发送数千个请求。这会使 Web 服务器不堪重负。

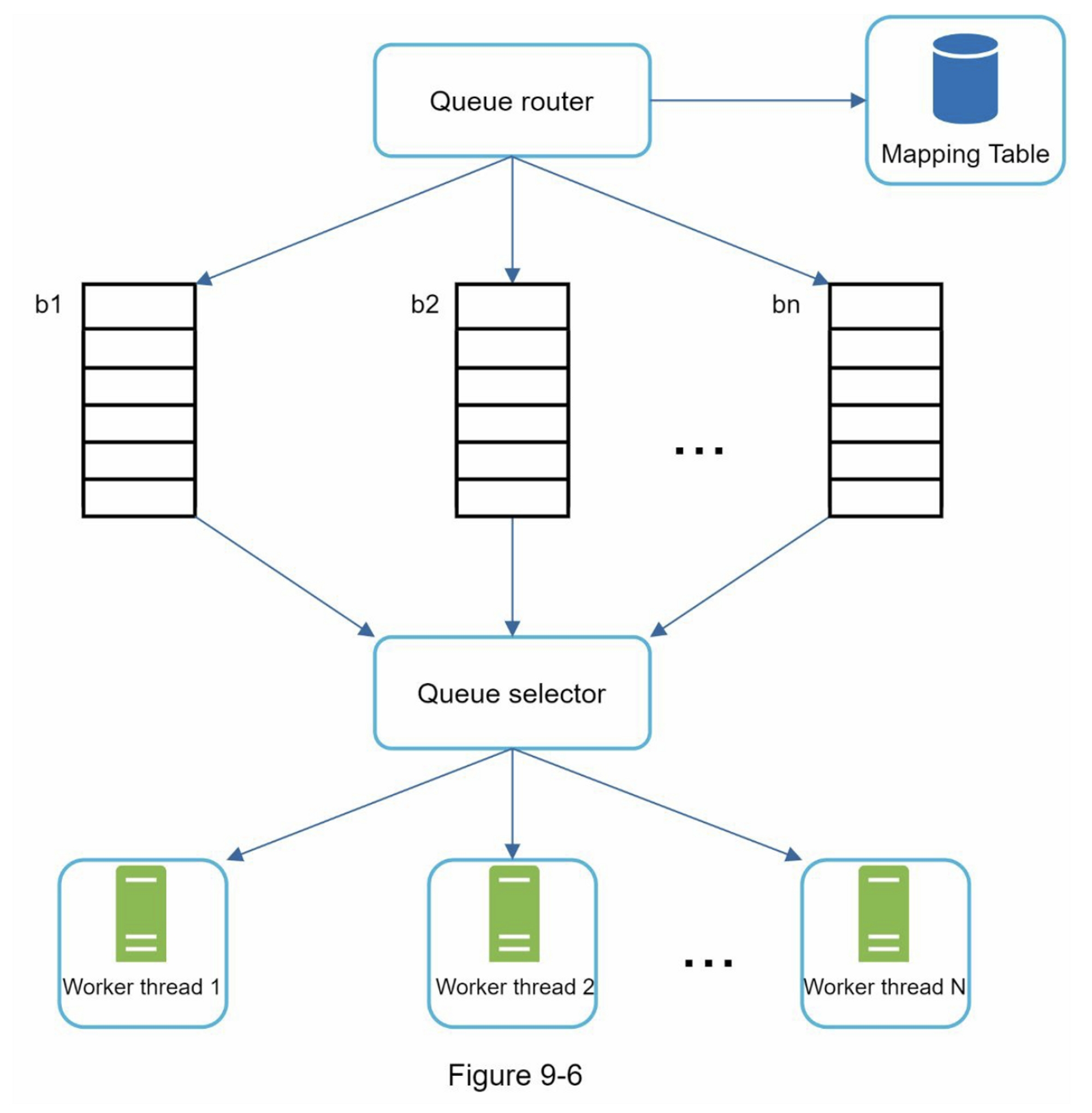

强制礼貌的一般想法是一次从同一主机下载一个页面。可以在两个下载任务之间添加延迟。礼貌约束是通过维护从网站主机名到下载(工作)线程的映射来实现的。每个下载线程都有一个单独的 FIFO 队列,并且只下载从该队列中获得的 URL。图 9-6 显示了管理礼貌的设计。

-

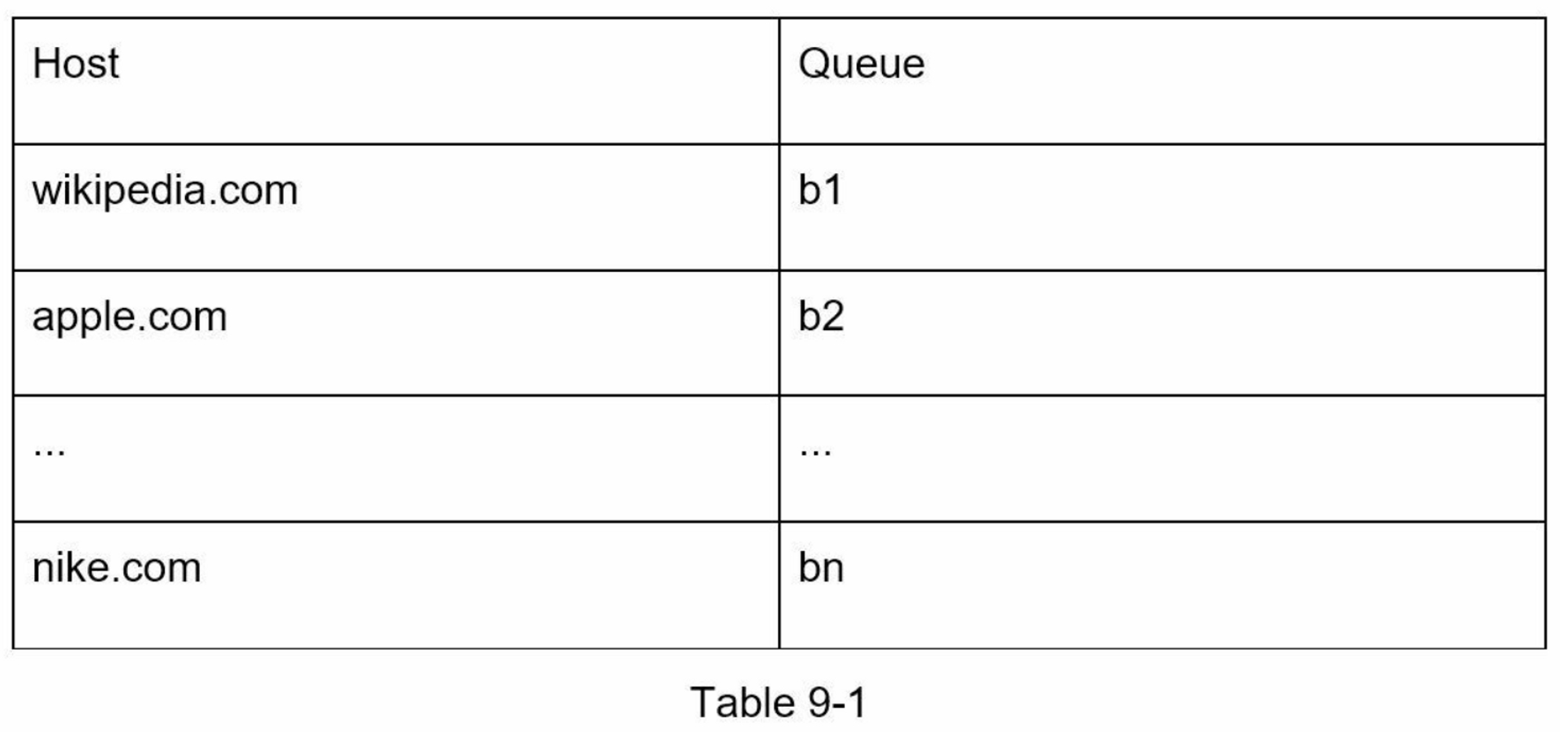

Queue router:它确保每个队列(b1,b2,... bn)仅包含来自同一主机的 URL。

-

Mapping table::它将每个主机映射到一个队列

-

FIFO 队列 b1、b2 到 bn:每个队列包含来自同一主机的 URL。

-

Queue selector:每个工作线程都映射到一个 FIFO 队列,它只从该队列下载 URL。队列选择逻辑由Queue selector完成

-

Worker thread 1 t到 N:一个工作线程从同一台主机上一个接一个地下载网页,可以在两个下载任务之间添加延迟。

-

-

优先级

一个关于 Apple 产品的讨论论坛上的随机帖子与苹果主页上的帖子具有非常不同的权重。尽管它们都有 "Apple "这个关键词,但爬虫首先抓取 Apple 主页是明智之举。

我们根据实用性对 URL 进行优先级排序,这可以通过 PageRank [10]、网站流量、更新频率等来衡量。“Prioritizer”是处理 URL 优先级的组件。有关此概念的深入信息,请参阅参考资料 [5] [10]。

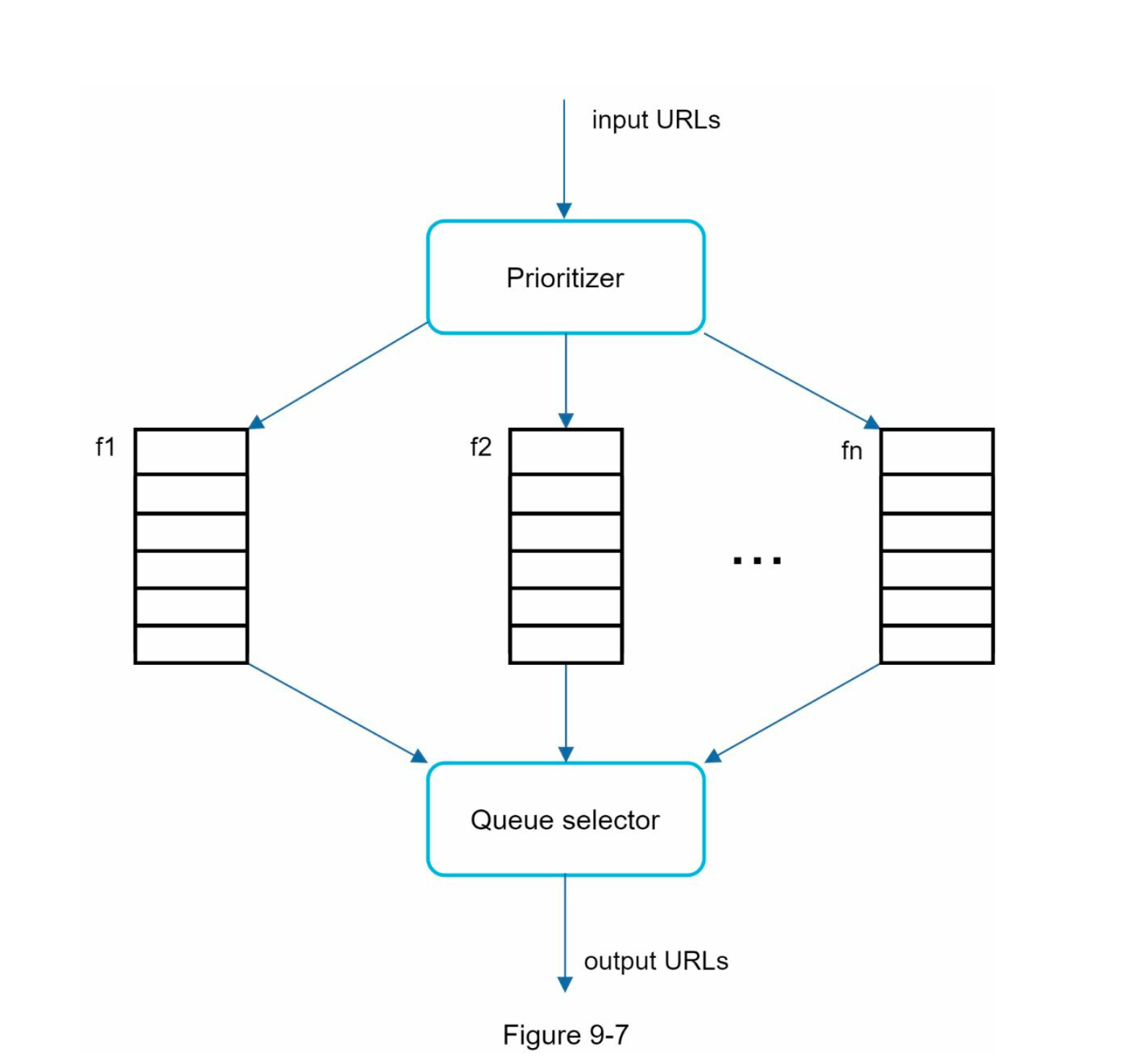

图 9-7 显示了管理 URL 优先级的设计。

- Prioritizer:它将 URL 作为输入并计算优先级。 •

- Queue f1 到 fn::每个队列都有一个分配的优先级。优先级高的队列被选中的概率更高。

- Queue selector:随机选择一个偏向于具有更高优先级的队列

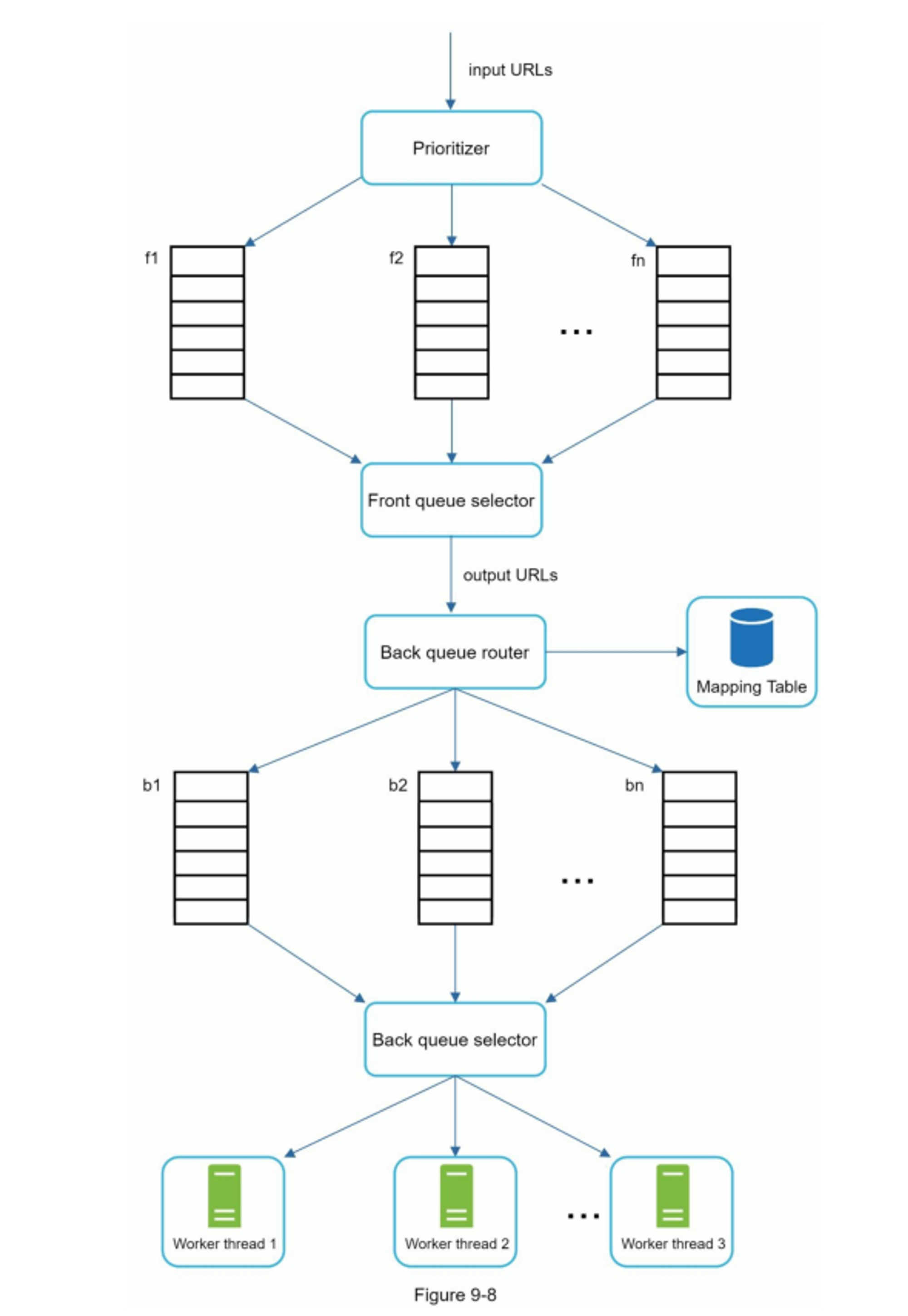

图 9-8 展示了 URL frontier 设计,它包含两个模块:

- 前端队列:管理优先级

- 后端队列:管理礼貌

-

新鲜度

网页不断被添加、删除和编辑。网络爬虫必须定期重新抓取下载的页面以保持我们的数据集最新。重新抓取所有 URL 既耗时又耗费资源。下面列出了几种优化新鲜度的策略:

- 根据网页的更新历史重新抓取。

- 对URL进行优先排序,优先和频繁地重新抓取重要页面。

-

URL Frontier 存储

在搜索引擎的真实世界抓取中,frontier 的 URL 数量可能达到数亿 [4]。将所有内容都放在内存中既不耐用也不可扩展。将所有内容都保存在磁盘中是不可取的,因为磁盘很慢;它很容易成为抓取的瓶颈。我们采用了混合方法。大多数 URL 都存储在磁盘上,因此存储空间不是问题。为了降低从磁盘读取和写入磁盘的成本,我们在内存中维护缓冲区以进行入队/出队操作。缓冲区中的数据会定期写入磁盘。

HTML 下载器

HTML下载器使用HTTP协议从互联网上下载网页。在讨论HTML下载器之前,我们先看一下Robots排除协议。

Robots.txt

Robots.txt,称为Robots排除协议,是网站用来与爬虫沟通的标准。它规定了爬虫可以下载哪些页面。在尝试爬行一个网站之前,爬虫应首先检查其相应的robots.txt,并遵守其规则。为了避免重复下载 robots.txt 文件,我们对该文件的结果进行了缓存。该文件会定期下载并保存到缓存中。下面是取自https://www.amazon.com/robots.txt 的robots.txt文件的一个片段。一些目录,如creatorhub,是不允许谷歌机器人访问的。

User-agent: Googlebot

Disallow: /creatorhub/*

Disallow: /rss/people/*/reviews

Disallow: /gp/pdp/rss/*/reviews

Disallow: /gp/cdp/member-reviews/

Disallow: /gp/aw/cr/

除了 robots.txt,性能优化是我们将为HTML下载器介绍的另一个重要概念。

性能优化

以下是HTML下载器的性能优化列表.

-

分布式抓取

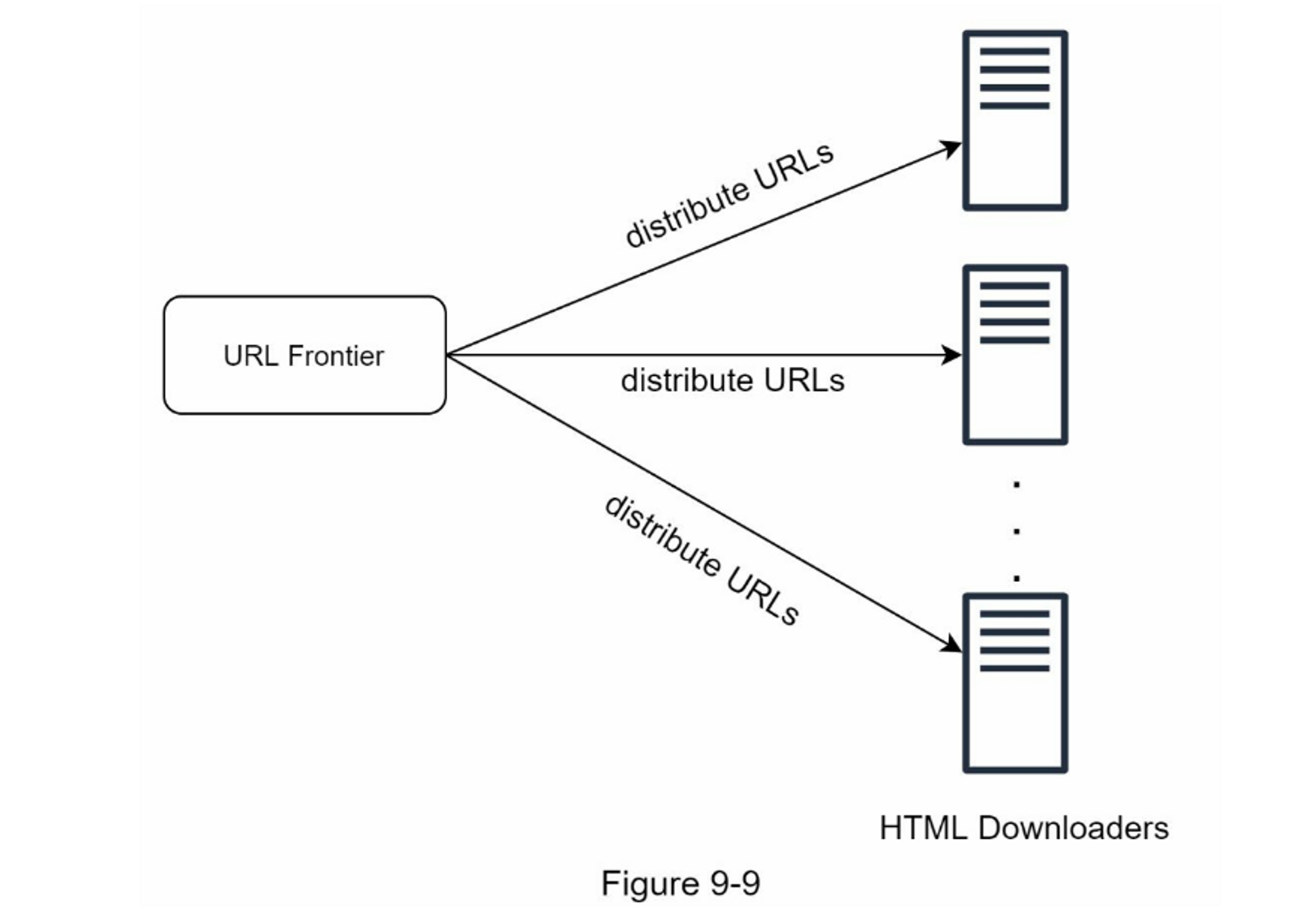

为了实现高性能,抓取工作被分配到多个服务器,每个服务器运行多个线程。URL空间被分割成更小的部分;因此,每个下载器负责URL的一个子集。图9-9显示了一个分布式抓取的例子。

-

缓存DNS解析器

DNS解析器是爬虫的一个瓶颈,因为由于许多DNS接口的同步性,DNS请求可能需要时间。DNS响应时间从10ms到200ms不等。一旦爬虫线程对DNS进行了请求,其他线程就会被阻断,直到第一个请求完成。维护我们的DNS缓存以避免频繁调用DNS是一种有效的速度优化技术。我们的DNS缓存保持域名到IP地址的映射,并通过cron作业定期更新。

-

位置

按地理分布抓取服务器。当爬行服务器离网站主机较近时,爬行者会体验到更快的下载时间。设计定位适用于大多数系统组件:抓取服务器、缓存、队列、存储等。

-

短暂的超时

有些网络服务器响应缓慢,或者根本不响应。为了避免漫长的等待时间,指定了一个最大的等待时间。如果一个主机在预定的时间内没有反应,爬虫将停止工作并抓取一些其他的网页。

鲁棒性

除了性能优化,鲁棒性也是一个重要的考虑因素。我们提出了一些提高系统鲁棒性的方法。

- 一致性哈希:这有助于在下载者之间分配负载。 可以使用一致性哈希添加或删除新的下载服务器。 有关详细信息,请参阅第 5 章:设计一致性哈希。

- 保存爬行状态和数据:为了防止失败,爬行状态和数据被写入存储系统。 通过加载保存的状态和数据,可以轻松地重新启动中断的爬网。

- 异常处理:错误在大型系统中是不可避免的,也是常见的。 爬虫必须在不使系统崩溃的情况下优雅地处理异常。

- 数据校验:这是防止系统出错的重要措施。

可扩展性(Extensibility)

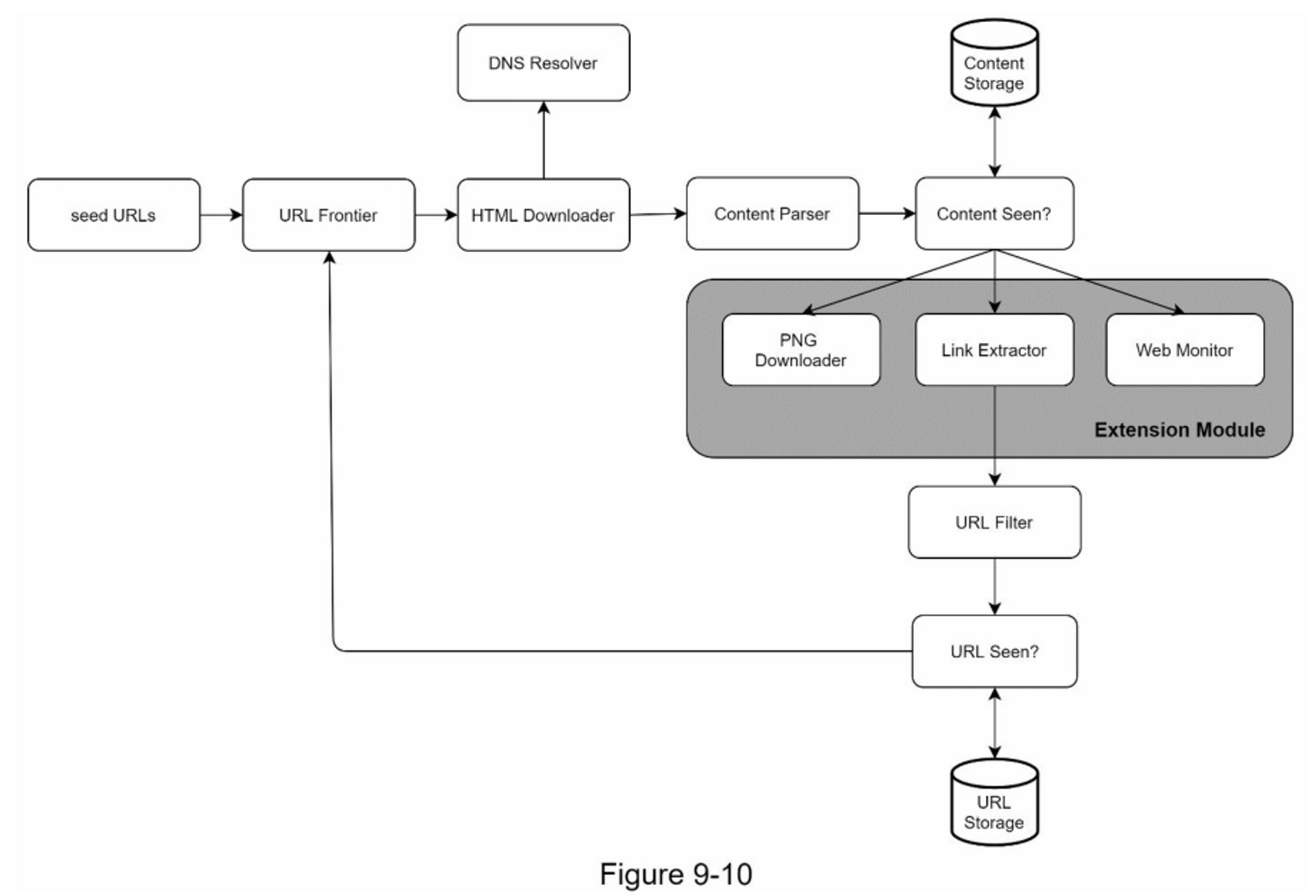

差不多每个系统都在不断发展,设计目标之一是使系统足够灵活,以支持新的内容类型。抓取器可以通过插入新的模块来扩展。图9-10显示了如何添加新模块。

- PNG下载器模块是用于下载PNG文件的插件。

- 增加了网络监控模块,以监控网络并防止版权和商标侵权。

检测并避免有问题的内容

本节讨论冗余、无意义或有害内容的检测和预防。

-

冗余内容

如前所述,近30%的网页是重复的。哈希值或校验和有助于检测重复[11]。

-

搜索引擎蜘蛛陷阱

搜索引擎蜘蛛陷阱是导致爬虫陷入无限循环的网页。 例如,一个无限深的目录结构如下:

http://www.spidertrapexample.com/foo/bar/foo/bar/foo/bar/...可以通过设置 URL 的最大长度来避免此类蜘蛛陷阱。但是,不存在检测蜘蛛陷阱的万能解决方案。 包含蜘蛛陷阱的网站很容易识别,因为在此类网站上发现的网页数量异常多。 很难开发自动算法来避免蜘蛛陷阱; 但是,用户可以手动验证和识别蜘蛛陷阱,并从爬虫中排除这些网站或应用一些自定义的 URL 过滤器。 -

垃圾数据

有些内容价值很小或没有价值,例如广告、代码片段、垃圾邮件 URL 等。这些内容对爬虫没有用,应尽可能排除。

第4步:总结

在本章中,我们首先讨论了一个好的爬虫的特征:可伸缩性、礼貌性、可扩展性和健壮性。 然后,我们提出了设计方案并讨论了关键组件。 构建可扩展的网络爬虫并不是一项简单的任务,因为网络非常庞大且充满陷阱。 即使我们涵盖了所有主题,我们仍然遗漏了许多相关的讨论要点:

- 服务器端渲染:众多的网站使用JavaScript、AJAX等脚本来即时生成链接。如果我们直接下载并解析网页,我们将无法检索到动态生成的链接。为了解决这个问题,我们在解析网页之前先进行服务器端的渲染(也叫动态渲染)[12]。

- 过滤不需要的页面:有限的存储容量和抓取资源,反垃圾信息组件有利于过滤掉低质量和垃圾页面 [13] [14]。

- 数据库复制和分片:复制和分片等技术用于提高数据层的可用性、可扩展性和可靠性。

- 水平扩展:对于大规模爬取,需要数百甚至数千台服务器来执行下载任务。 关键是保持服务器无状态。

- 可用性、一致性和可靠性。这些概念是任何大型系统成功的核心。我们在第1章中详细讨论了这些概念。重温一下你对这些主题的记忆。

- 分析:收集和分析数据是任何系统的重要组成部分,因为数据是微调的关键要素。

恭喜你走到了这一步!现在给自己一个鼓励,干得漂亮!

参考资料

- [1] US Library of Congress: https://www.loc.gov/websites/

- [2] EU Web Archive: http://data.europa.eu/webarchive

- [3] Digimarc: https://www.digimarc.com/products/digimarc-services/piracy-intelligence

- [4] Heydon A., Najork M. Mercator: A scalable, extensible web crawler World Wide Web, 2 (4) (1999), pp. 219-229

- [5] By Christopher Olston, Marc Najork: Web Crawling. http://infolab.stanford.edu/~olston/publications/crawling_survey.pdf

- [6] 29% Of Sites Face Duplicate Content Issues: https://tinyurl.com/y6tmh55y

- [7] Rabin M.O., et al. Fingerprinting by random polynomials Center for Research in Computing Techn., Aiken Computation Laboratory, Univ. (1981)

- [8] B. H. Bloom, “Space/time trade-offs in hash coding with allowable errors,” Communications of the ACM, vol. 13, no. 7, pp. 422–426, 1970.

- [9] Donald J. Patterson, Web Crawling: https://www.ics.uci.edu/~lopes/teaching/cs221W12/slides/Lecture05.pdf

- [10] L. Page, S. Brin, R. Motwani, and T. Winograd, “The PageRank citation ranking: Bringing order to the web,” Technical Report, Stanford University, 1998.

- [11] Burton Bloom. Space/time trade-offs in hash coding with allowable errors. Communications of the ACM, 13(7), pages 422--426, July 1970.

- [12] Google Dynamic Rendering: https://developers.google.com/search/docs/guides/dynamic-rendering

- [13] T. Urvoy, T. Lavergne, and P. Filoche, “Tracking web spam with hidden style similarity,” in Proceedings of the 2nd International Workshop on Adversarial Information Retrieval on the Web, 2006.

- [14] H.-T. Lee, D. Leonard, X. Wang, and D. Loguinov, “IRLbot: Scaling to 6 billion pages and beyond,” in Proceedings of the 17th International World Wide Web Conference, 2008.

第10章:设计一个通知系统

近年来,通知系统已经成为许多应用程序非常流行的功能。 通知提醒用户重要信息,如突发新闻、产品更新、活动、优惠等。它已成为我们日常生活中不可或缺的一部分。 在本章中,您需要设计一个通知系统。

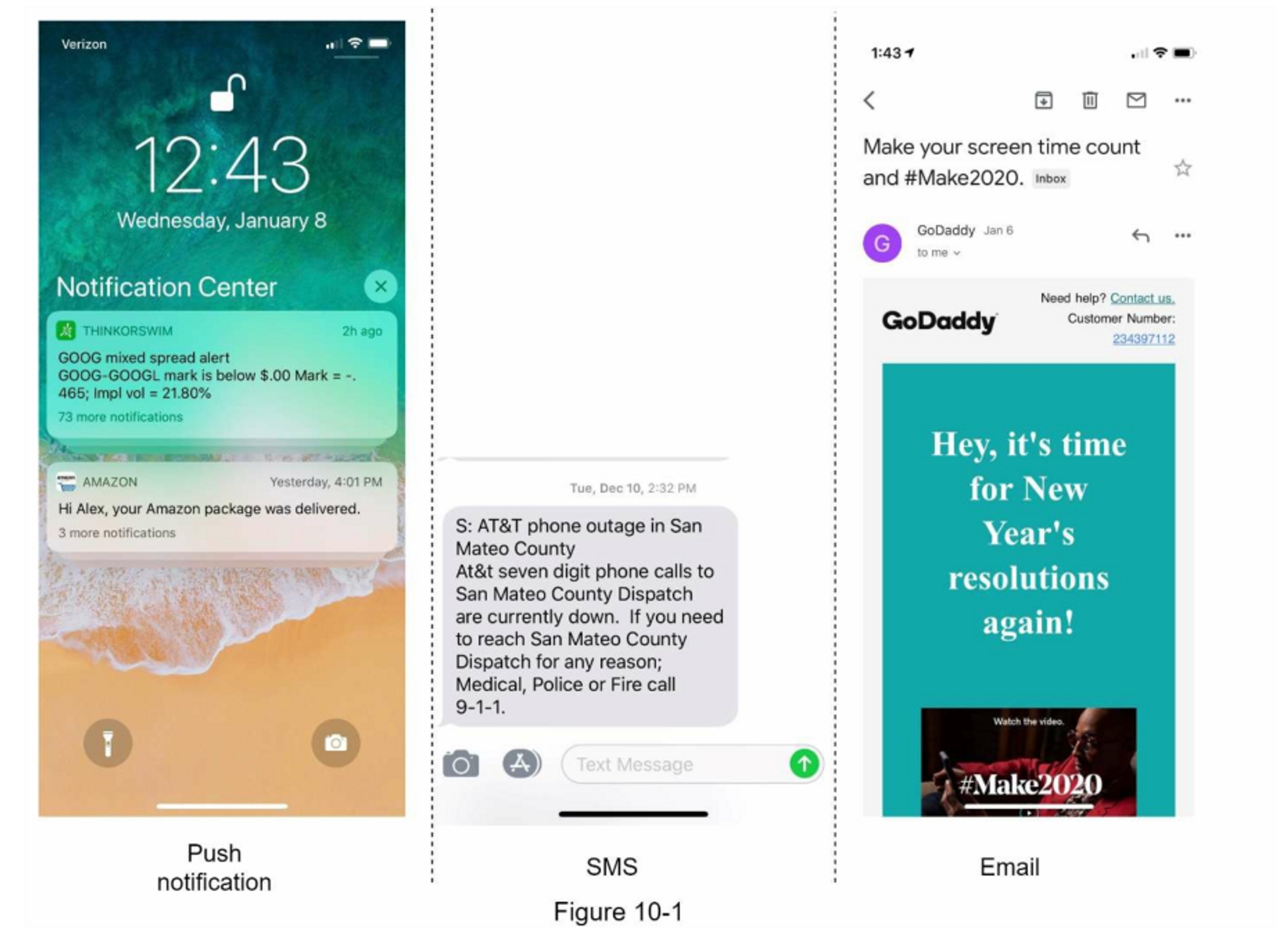

通知不仅仅是移动推送通知,三种类型的通知格式:移动推送通知、短信和电子邮件。 图 10-1 显示了每个通知的示例。

第1步:了解问题并确定设计范围

构建一个每天发送数百万条通知的可扩展系统并非易事。 它需要对通知生态系统有深入的了解。 面试问题特意设计为开放式和模棱两可的,你有责任提出问题以明确要求。

候选人:系统支持哪些类型的通知? 面试官:推送通知、短信、邮件。

候选人:它是一个实时的系统吗?

采访者。让我们说这是一个软实时系统。我们希望用户能尽快收到通知。但是,如果系统处于高负荷工作状态,稍有延迟也是可以接受的。

候选人:支持的设备有哪些?

面试官:iOS设备、安卓设备和笔记本电脑/台式机。

候选人:什么触发通知?

面试官:通知可以由客户端应用程序触发。 他们也可以由服务器端调度。

候选人:用户是否能够选择退出?

面试官:是的,选择退出的用户将不再收到通知。

候选人:每天发出多少份通知?

面试官:1000万条移动推送通知,100万条短信,500万封电子邮件。

第2步:提出高层次的设计方案并获得认同

本节展示了支持各种通知类型的高层设计:iOS推送通知、Android推送通知、短信和电子邮件。它的结构如下:

- 不同的通知类型

- 联系人信息收集流程

- 通知发送/接收流程

不同的通知类型

我们先看一下每种通知类型在高层次上是如何工作的。

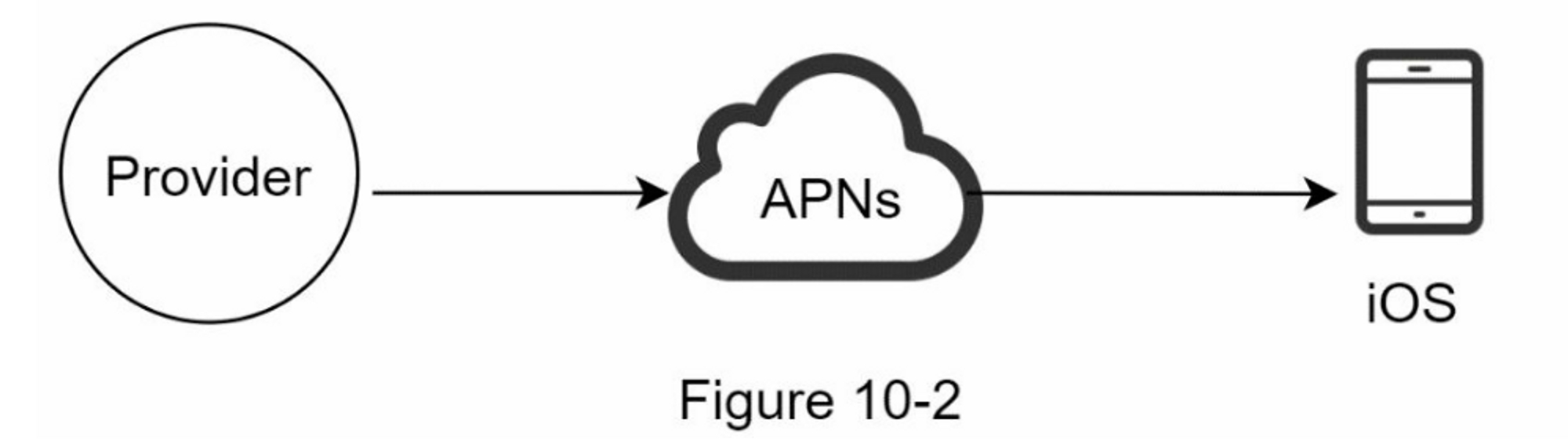

iOS推送通知

我们主要需要三个组件来发送 iOS 推送通知:

- Provider(提供商):提供商构建通知请求并将其发送到 Apple 推送通知服务 (APNS)。 要构建推送通知,提供者提供以下数据:

-

设备 token:这是用于发送推送通知的唯一标识符。

-

有效载荷:是一个包含通知有效载荷的 JSON 字典。 例子:

{ "aps": { "alert": { "title": "Game Request", "body": "Bob wants to play chess", "action-loc-key": "PLAY" }, "badge": 5 } }

-

- 苹果推送通知服务(APNS): 这是 Apple 提供的远程服务,用于将推送通知传播到 iOS 设备。

- iOS 设备:它是接收推送通知的终端客户端。

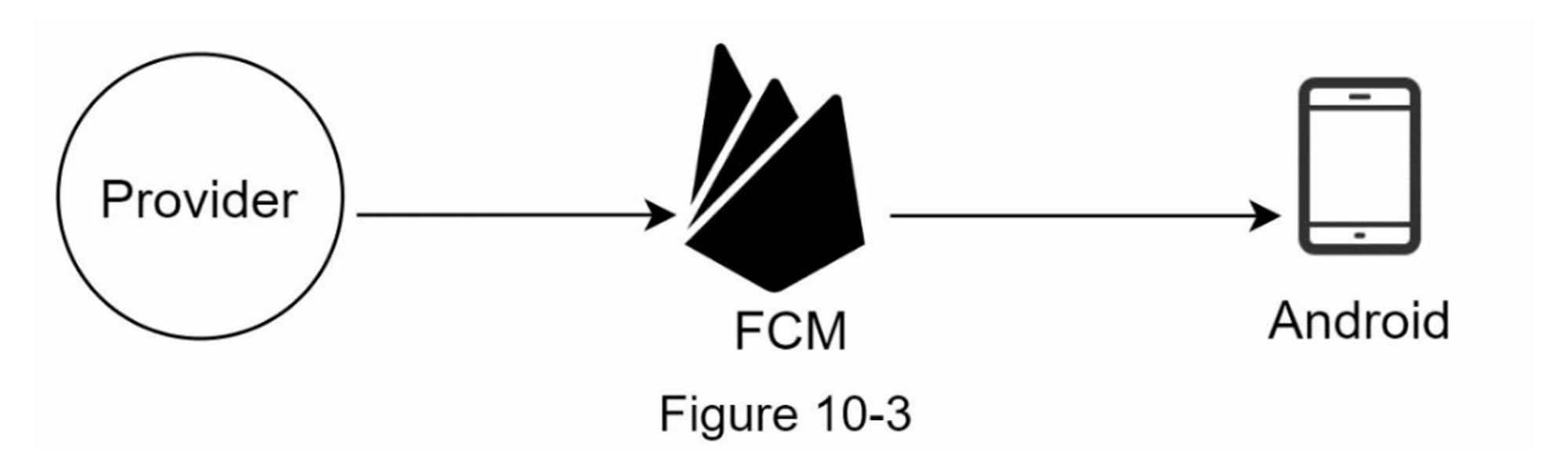

Android推送通知

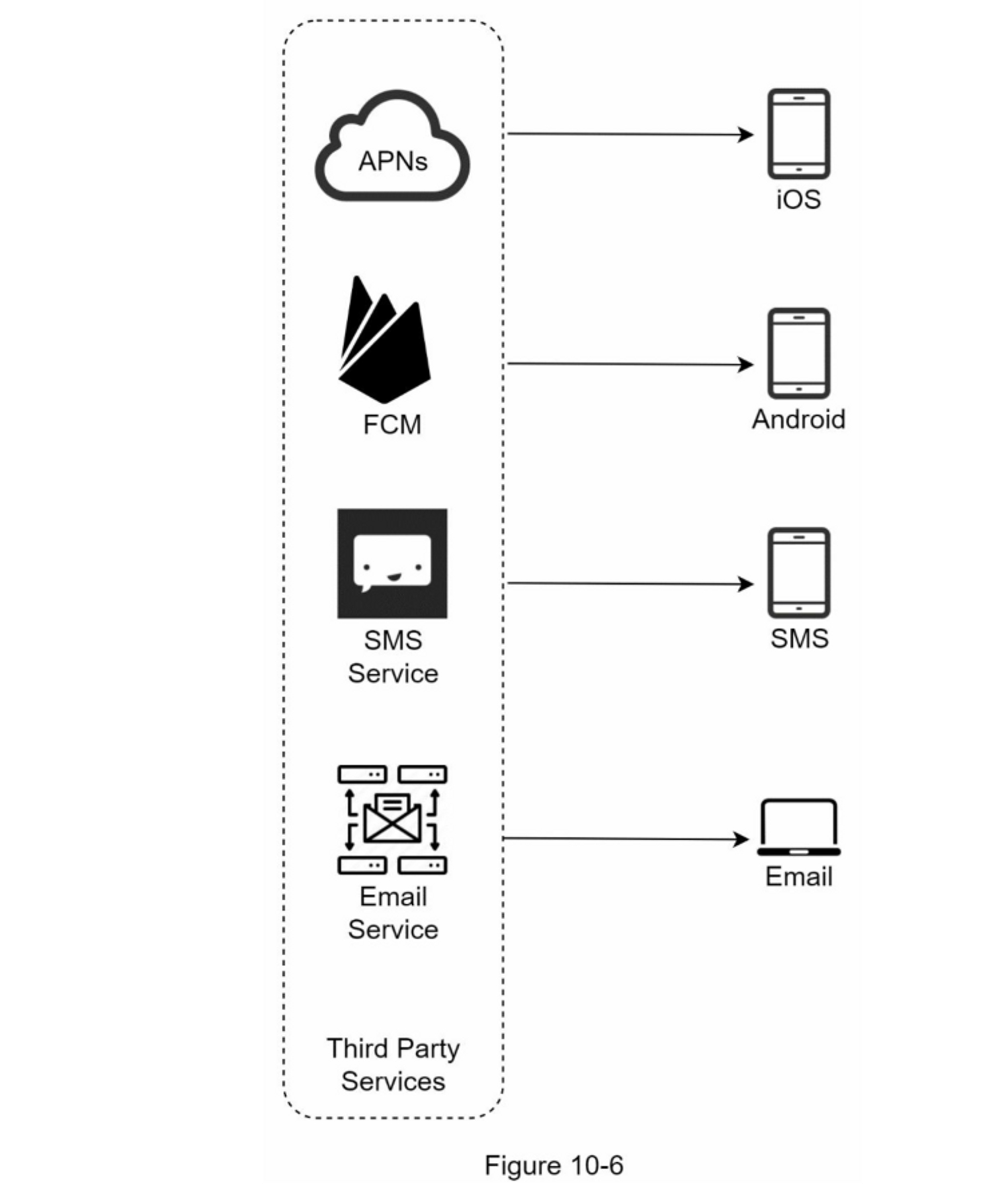

Android 采用了类似的通知流程。 Firebase Cloud Messaging (FCM) 通常用于向 Android 设备发送推送通知,而不是使用 APN。

短信

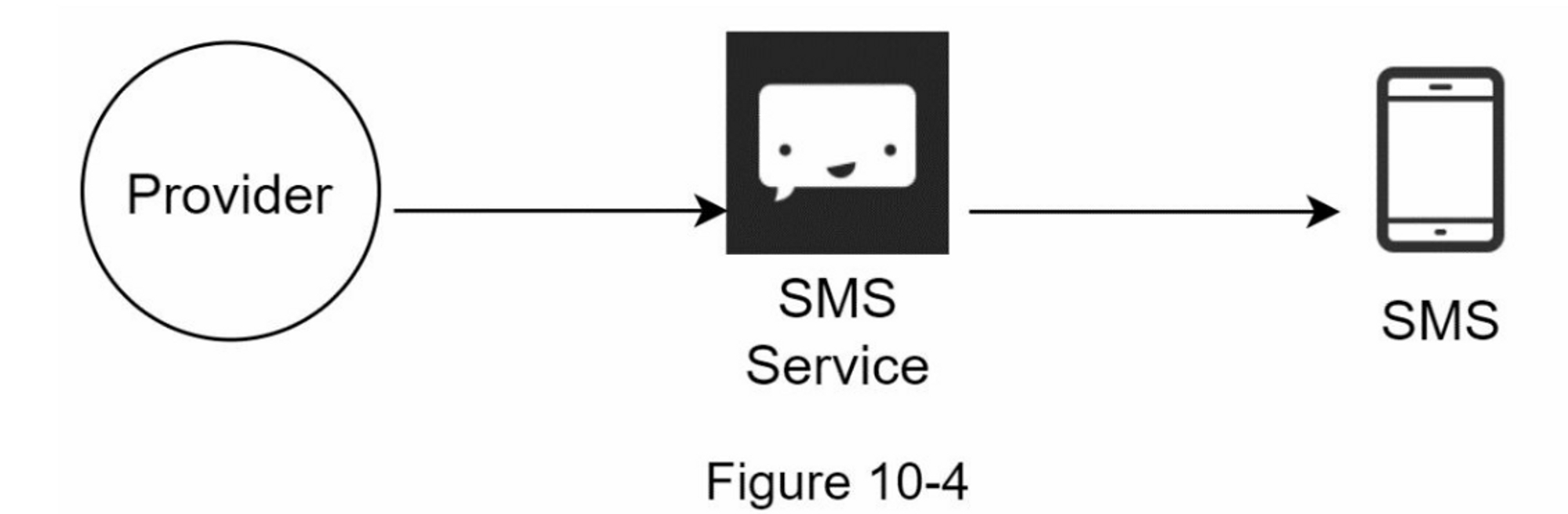

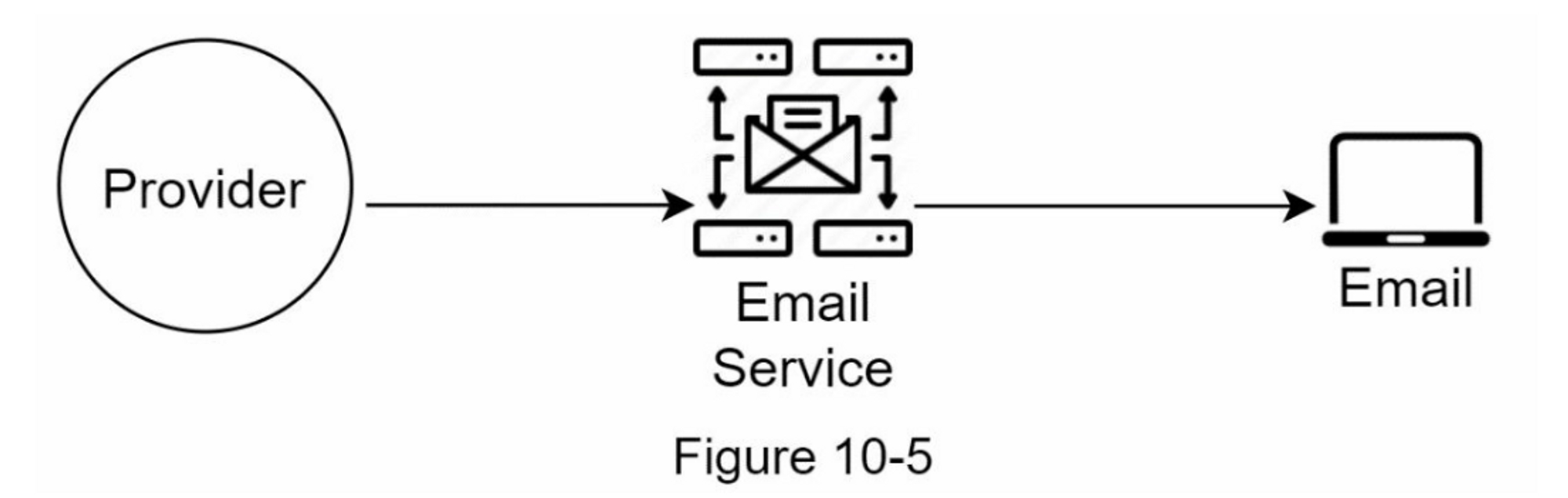

对于SMS信息,通常使用第三方SMS服务,如Twilio[1]、Nexmo[2]和其他许多服务。它们中的大多数是商业服务。

邮件

虽然公司可以设置自己的电子邮件服务器,但其中许多公司选择商业电子邮件服务。 Sendgrid [3] 和 Mailchimp [4] 是最受欢迎的电子邮件服务之一,它们提供更好的交付率和数据分析。

图 10-6 显示了包含所有第三方服务后的设计。

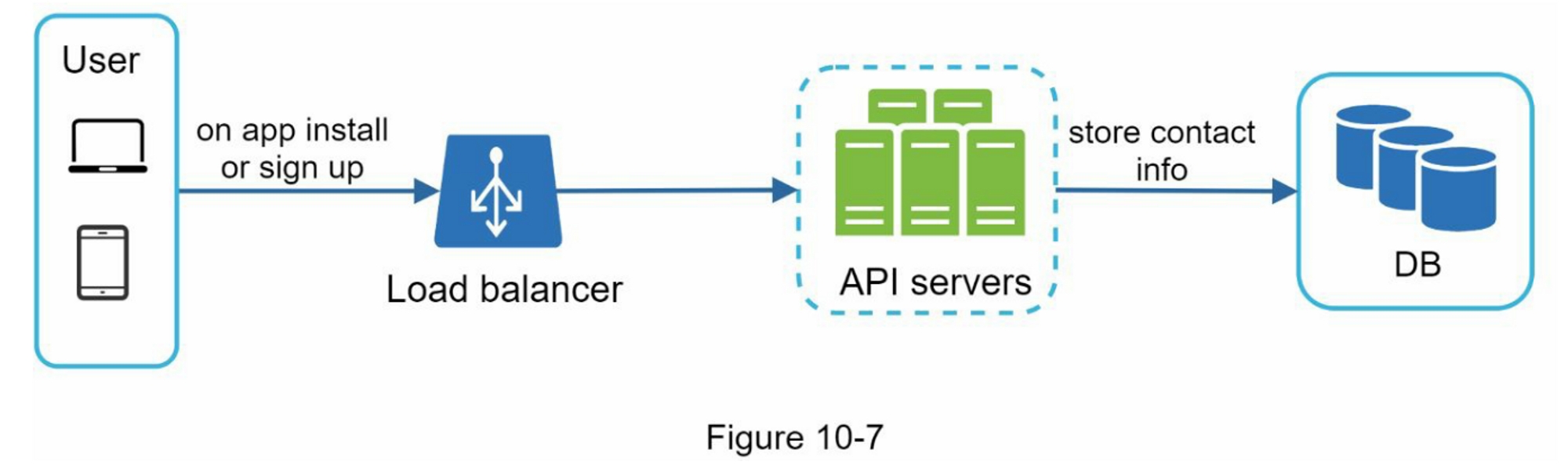

联系人信息收集流程

要发送通知,我们需要收集移动设备令牌、电话号码或电子邮件地址。 如图 10-7 所示,当用户安装我们的应用程序或首次注册时,API 服务器会收集用户联系信息并将其存储在数据库中。

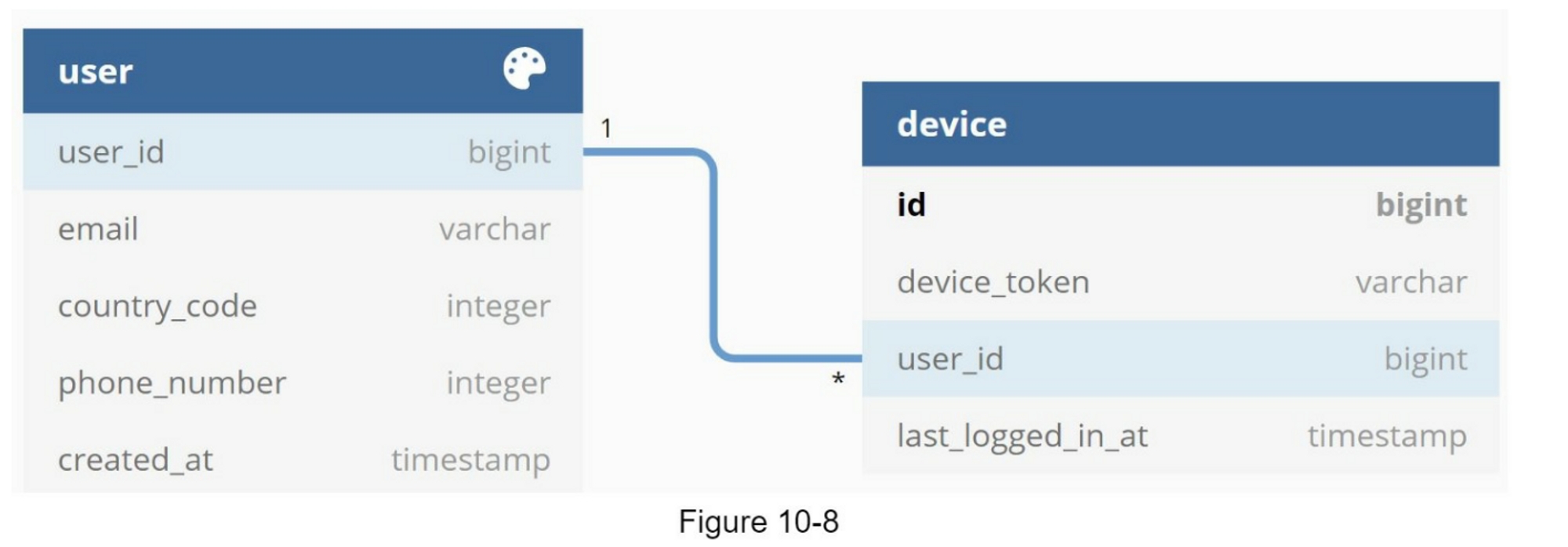

图10-8显示了存储联系人信息的简化数据库表。电子邮件地址和电话号码存储在用户表中,而设备令牌则存储在设备表中。一个用户可以有多个设备,表明推送通知可以被发送到所有的用户设备上。

通知发送/接收流程

我们将首先介绍初始设计;然后,提出了一些优化方案。

高层设计

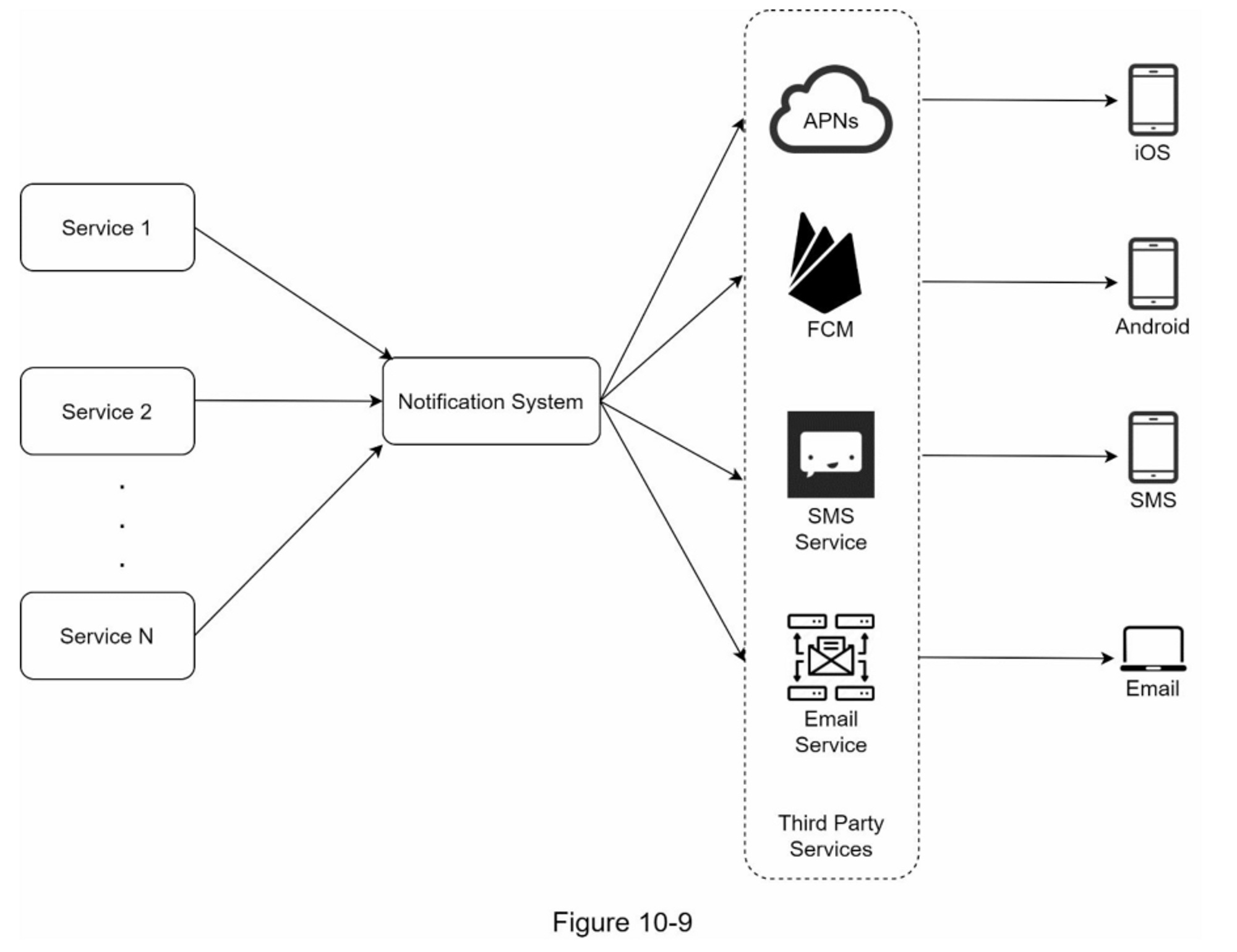

图 10-9 显示了设计,下面解释了每个系统组件。

服务1到N:一个服务可以是一个微服务,一个cron job,或者一个触发通知发送事件的分布式系统。例如,一个计费服务发送电子邮件提醒客户到期付款,或者一个购物网站通过短信告诉客户他们的包裹明天会被送到。

通知系统:通知系统是发送/接收通知的中心环节。从简单的东西开始,只使用一个通知服务器。它为服务1到N提供API,并为第三方服务建立通知有效载荷。

第三方服务:第三方服务负责向用户发送通知。在与第三方服务集成时,我们需要特别注意可扩展性。良好的可扩展性意味着一个灵活的系统可以很容易地插入或拔出第三方服务。另一个重要的考虑因素是,第三方服务可能在新的市场或在未来无法使用。例如,FCM在中国是不可用的。因此,在那里使用替代的第三方服务,如Jpush、PushY等。

iOS, Android, SMS, Email:用户在其设备上收到通知。

在这个设计中,发现了三个问题:

- 单点故障(SPOF):单一通知服务器意味着SPOF。

- 难以扩展:通知系统在一台服务器上处理所有与推送通知有关的事情。要独立扩展数据库、缓存和不同的通知处理组件是很有挑战性的。

- 性能瓶颈:处理和发送通知可能是资源密集型的。例如,构建HTML页面和等待第三方服务的响应可能需要时间。在一个系统中处理所有事情可能会导致系统过载,尤其是在高峰期。

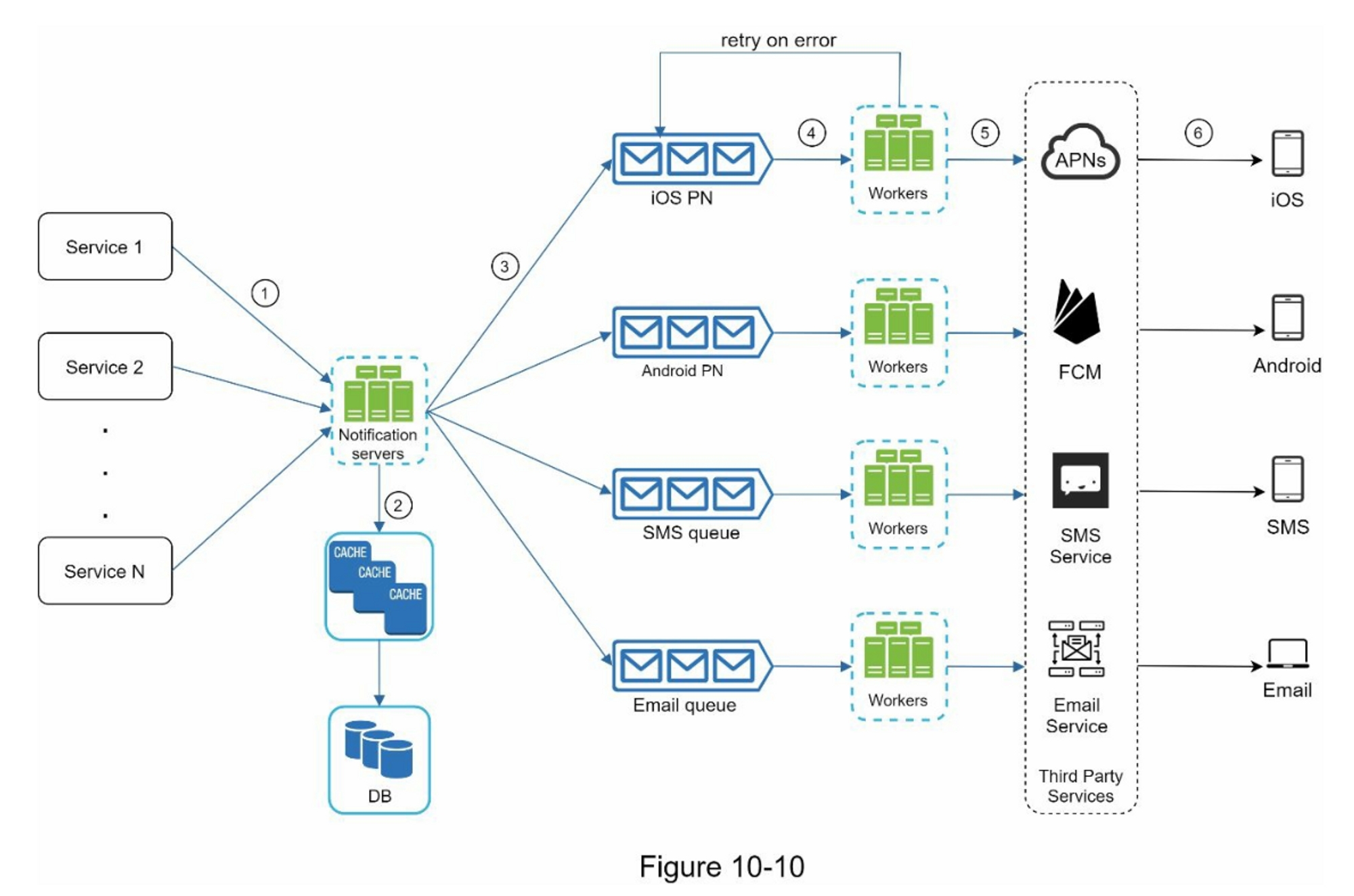

高层设计(改进后的)

在列举了初始设计中的挑战后,我们对设计进行了如下改进:

- 将数据库和缓存从通知服务器中移出

- 添加更多的通知服务器,并设置自动水平缩放功能

- 引入消息队列,使系统组件解耦

图10-10显示了改进后的高层设计。

浏览上图的最佳方式是从左到右。

- 服务1到N:它们代表不同的服务,通过通知服务器提供的API发送通知。

- 通知服务器: 它们提供以下功能:

-

为服务提供发送通知的API。这些API只能由内部或经过验证的客户访问,以防止垃圾邮件。

-

进行基本验证,以核实电子邮件、电话号码等。

-

查询数据库或缓存以获取渲染通知所需的数据。

-

将通知数据放到消息队列中进行并行处理。

下面是一个发送电子邮件的API的例子:

POST https://api.example.com/v/sms/send

Request body:

-

- 缓存:用户信息、设备信息、通知模板都被缓存了。

- 数据库:它存储了关于用户、通知、设置等方面的数据。

- 消息队列:它们消除了组件之间的依赖性。当大量的通知被发送出去时,消息队列可以作为缓冲区。每种通知类型都被分配了一个不同的消息队列,所以一个第三方服务的中断不会影响其他通知类型。

- Workers:Workers 是一组服务器,它们从消息队列中拉取通知事件并将它们发送到相应的第三方服务。

- 第三方服务:在最初的设计中已经解释过。

- iOS, Android, SMS, Email:在最初的设计中已经说明。

接下来,让我们来看看每个组件是如何一起工作来发送通知的。

- 一个服务调用通知服务器提供的API来发送通知

- 通知服务器从缓存或数据库中获取元数据,如用户信息、设备令牌和通知设置。

- 一个通知事件被发送到相应的队列进行处理。例如,一个iOS推送通知事件被发送到iOS PN队列中。

- 工作者从消息队列中获取通知事件。

- 工作者向第三方服务发送通知。

- 第三方服务向用户设备发送通知。

第3步:深入设计

在高层设计中,我们讨论了不同类型的通知、联系信息收集流程和通知发送/接收流程。我们将深入探讨以下内容。

- 可靠性(Reliability)

- 其他组件和考虑因素:通知模板、通知设置、速率限制、重试机制、推送通知的安全性、监控排队通知和事件跟踪。

- 更新后的设计

可靠性

在分布式环境中设计通知系统时,我们必须回答几个重要的可靠性问题。

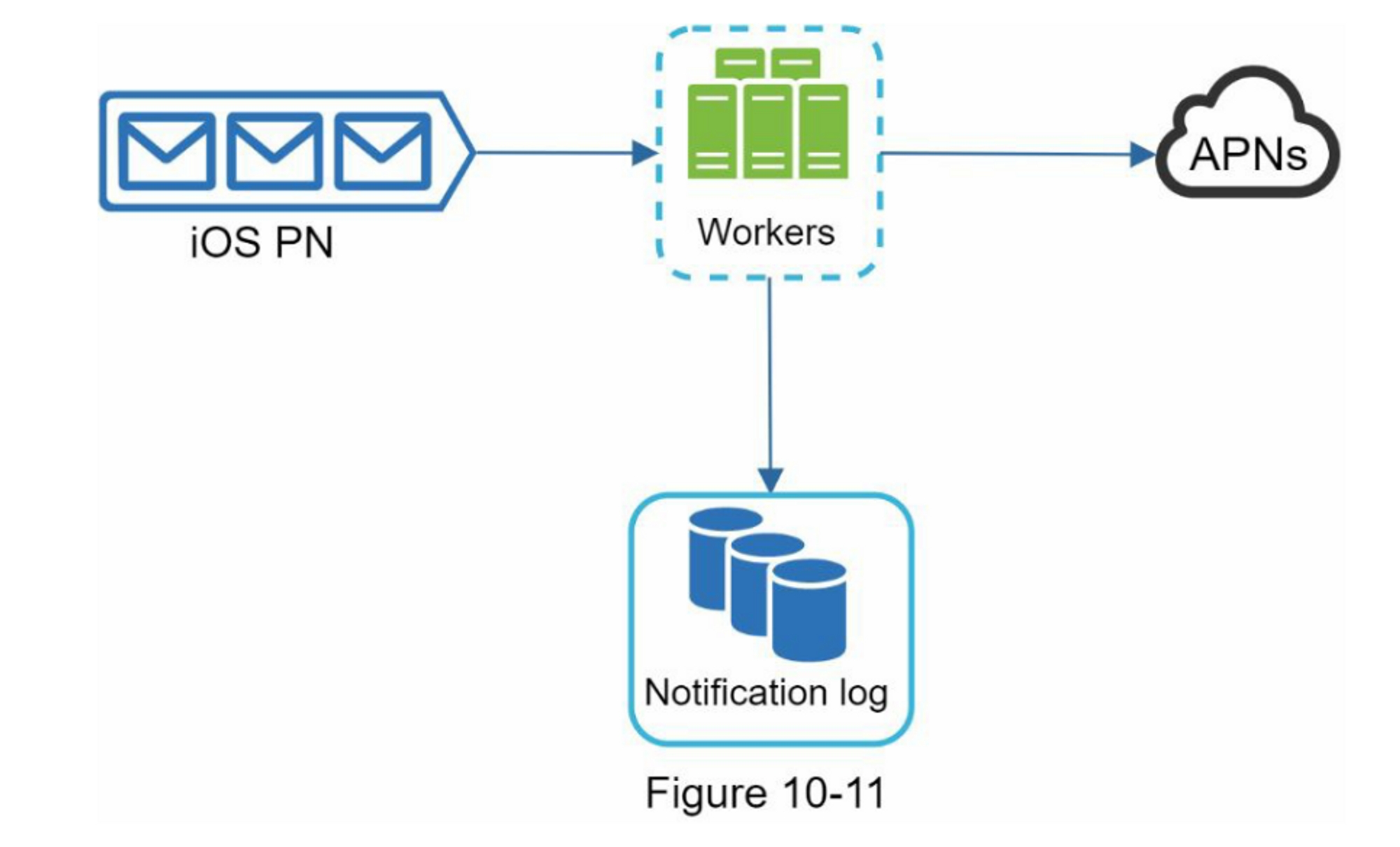

如何防止数据丢失?

通知系统最重要的要求之一是它不能丢失数据。 通知通常可以延迟或重新排序,但绝不会丢失。 为了满足这个需求,通知系统将通知数据持久化到数据库中,并实现了重试机制。 包含通知日志数据库以实现数据持久化,如图 10-11 所示。

接受者只会收到一次通知吗?

最简洁的答案是不。 尽管大多数时候通知只发送一次,但分布式特性可能会导致重复通知。 为了减少重复的发生,我们引入了重复数据删除机制并仔细处理每个失败案例。 这是一个简单的重复数据删除逻辑:

当一个通知事件第一次到达时,我们通过检查事件的ID来检查它是否在之前出现过。如果在之前出现过,它将被丢弃。否则,我们将发送通知。有兴趣的读者可以研究一下为什么我们不能仅一次发送,请参考参考资料[5]。

其他组件和考虑因素

我们已经讨论了如何收集用户的联系信息,发送和接收通知。一个通知系统远不止这些。在这里,我们讨论了额外的组件,包括模板重复使用、通知设置、事件跟踪、系统监控、速率限制等。

-

通知模板

一个大型的通知系统每天会发出数百万条通知,其中许多通知都遵循类似的格式。通知模板的引入是为了避免从头开始建立每一个通知。通知模板是一个预先格式化的通知,通过自定义参数、样式、跟踪链接等来创建你独特的通知。下面是一个推送通知的例子模板。

BODY: You dreamed of it. We dared it. [ITEM NAME] is back — only until [DATE]. CTA: Order Now. Or, Save My [ITEM NAME] The benefits of using notification templates include maintaining a consistent format, reducing the margin error, and saving time. -

通知设置

用户一般每天都会收到太多的通知,他们很容易感到不堪重负。因此,许多网站和应用程序让用户对通知设置进行细化控制。这些信息存储在通知设置表中,有以下字段:

user_id bigInt channel varchar # push notification, email or SMS opt_in boolean # opt-in to receive notification在向用户发送任何通知之前,我们首先检查用户是否选择接收这种类型的通知。

-

速率限制

为了避免用户被过多的通知所淹没,我们可以限制一个用户可以收到的通知数量。这一点很重要,因为如果我们发送得太频繁,接收者可能会完全关闭通知。

-

重试机制

当第三方服务无法发送通知时,该通知将被添加到消息队列中进行重试。如果问题持续存在,将向开发者发出警报。

-

推送通知的安全问题

对于iOS或Android应用程序,appKey和appSecret被用来保护推送通知API[6]。只有经过认证或验证的客户端才允许使用我们的API发送推送通知。有兴趣的用户应该参考参考资料[6]。

-

监视排队通知

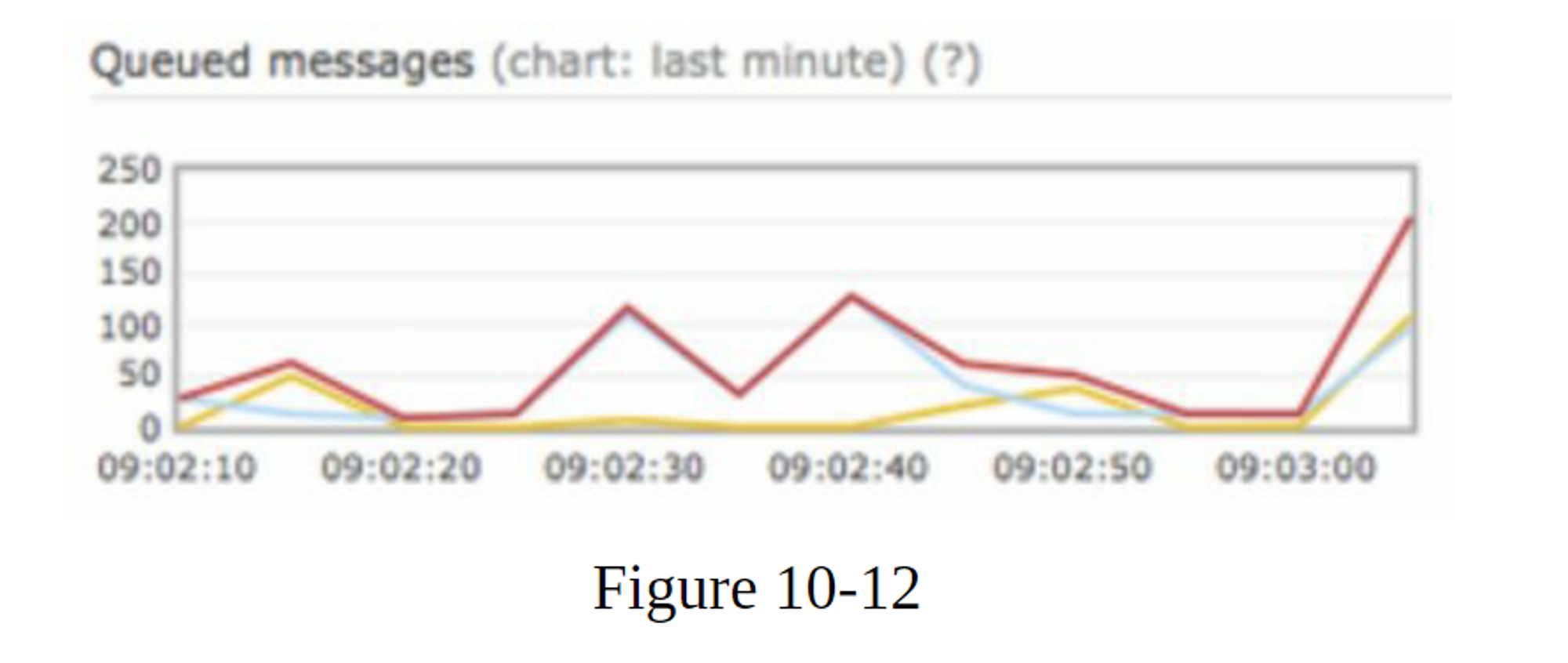

要监控的一个关键指标是排队通知的总数。如果这个数字很大,说明 workers 处理通知事件的速度不够快。为了避免通知交付的延迟,需要更多的工作者。图10-12(归功于[7])显示了一个待处理的排队消息的例子。

-

事件跟踪

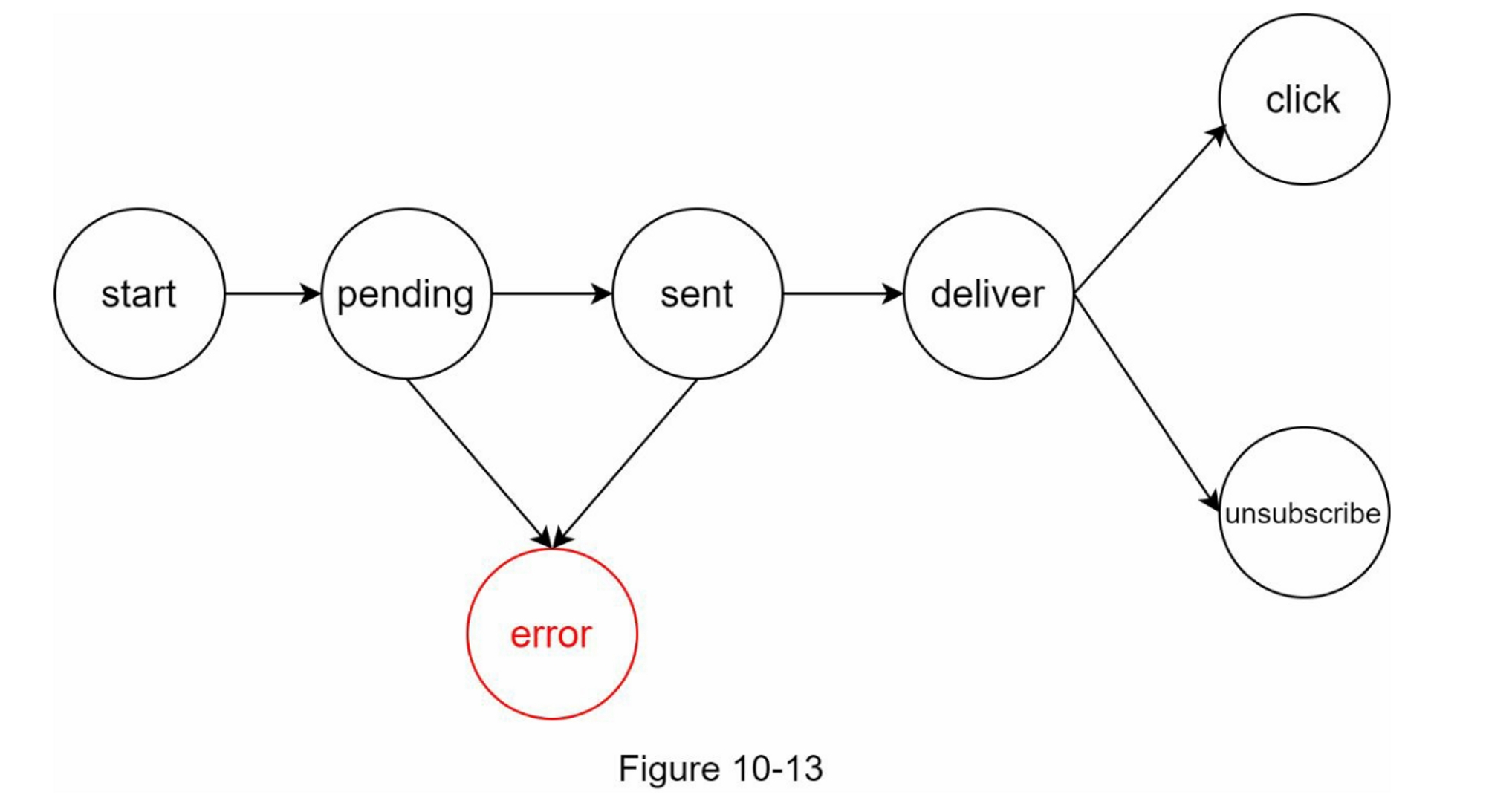

打开率、点击率和参与度等通知指标对于了解客户行为非常重要。 分析服务实现事件跟踪。 通常需要通知系统和分析服务之间的集成。 图 10-13 显示了可能出于分析目的而被跟踪的事件示例。

更新后的设计

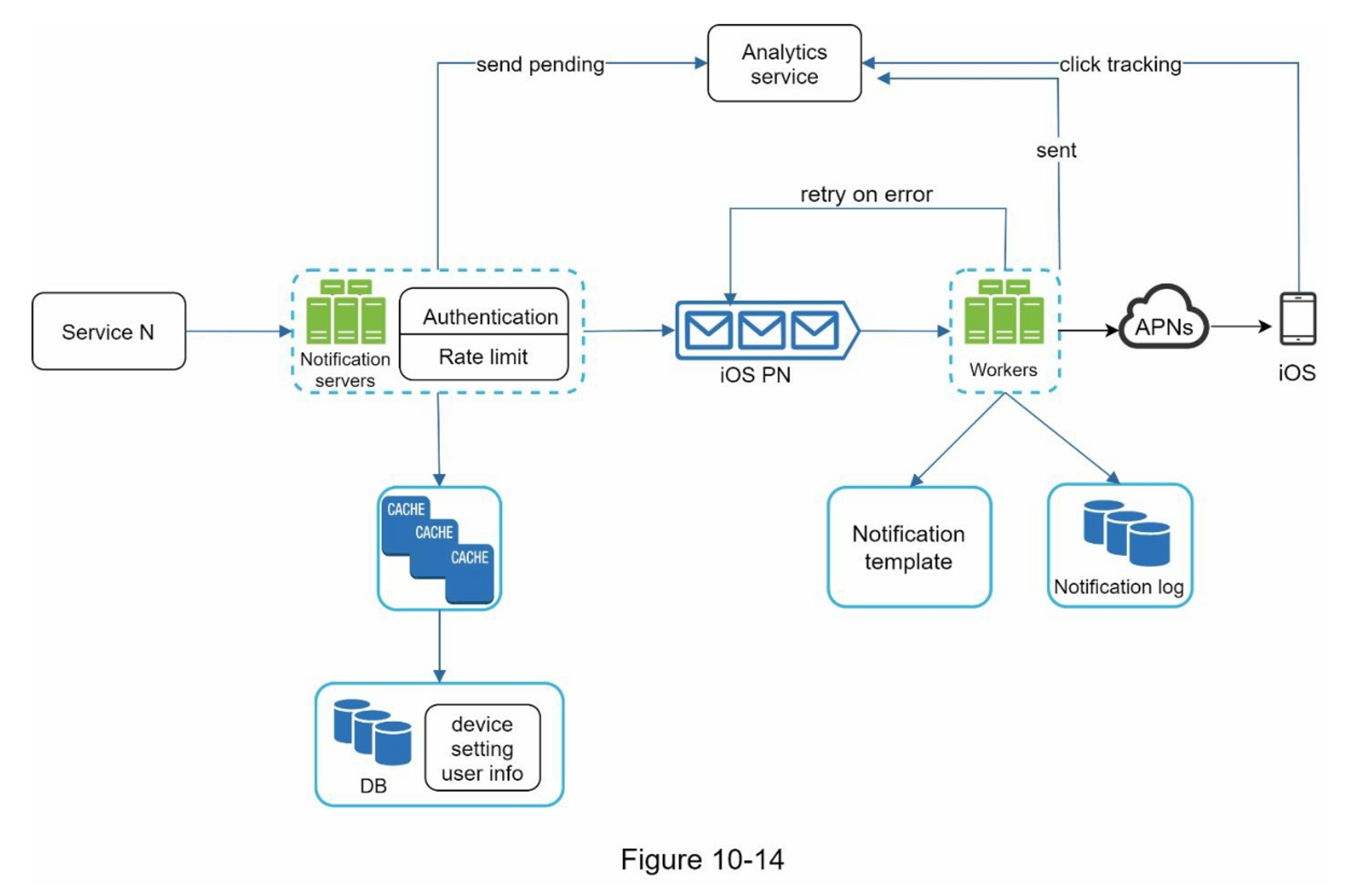

把所有东西放在一起,图10-14显示了更新的通知系统设计。

在这个设计中,与以前的设计相比,增加了许多新的组件。

- 通知服务器配备了两个更关键的功能:认证(authentication)和速率限制(rate limiti)。

- 我们还添加了一个重试机制来处理通知失败。如果系统发送通知失败,它们会被放回消息队列中,工作者会重试预定的次数。

- 此外,通知模板提供一致且高效的通知创建过程。

- 最后,为系统健康检查和未来改进增加了监测和跟踪系统。

第4步:总结

通知是不可缺少的,因为它们让我们及时了解重要信息。它可能是关于你在Netflix上最喜欢的电影的推送通知,关于新产品折扣的电子邮件,或关于你在线购物付款确认的信息。

在这一章中,我们描述了一个可扩展的通知系统的设计,它支持多种通知格式。推送通知、SMS消息和电子邮件。我们采用了消息队列来解耦系统组件。

除了高层次的设计,我们还深入挖掘了更多的组件和优化。

- 可靠性:我们提出了一个强大的重试机制,以尽量减少失败率。

- 安全性:AppKey/appSecret对用于确保只有经过验证的客户才能发送通知。

- 跟踪和监测:这些都是在通知流程的任何阶段实施的,以捕捉重要的统计资料。

- 尊重用户设置:用户可以选择不接收通知。 我们的系统在发送通知之前首先检查用户设置。

- 速率限制:用户会喜欢对他们收到的通知数量设置频率上限。

恭喜你走到了这一步!现在给自己一个鼓励,干得漂亮!

参考资料

- [1] Twilio SMS: https://www.twilio.com/sms

- [2] Nexmo SMS: https://www.nexmo.com/products/sms

- [3] Sendgrid: https://sendgrid.com/

- [4] Mailchimp: https://mailchimp.com/

- [5] You Cannot Have Exactly-Once Delivery: https://bravenewgeek.com/you-cannot-have-exactly-once-delivery

- [6] Security in Push Notifications: https://cloud.ibm.com/docs/services/mobilepush

- [7] RadditMQ: https://bit.ly/2sotIa6

第11章:设计一个信息推送系统

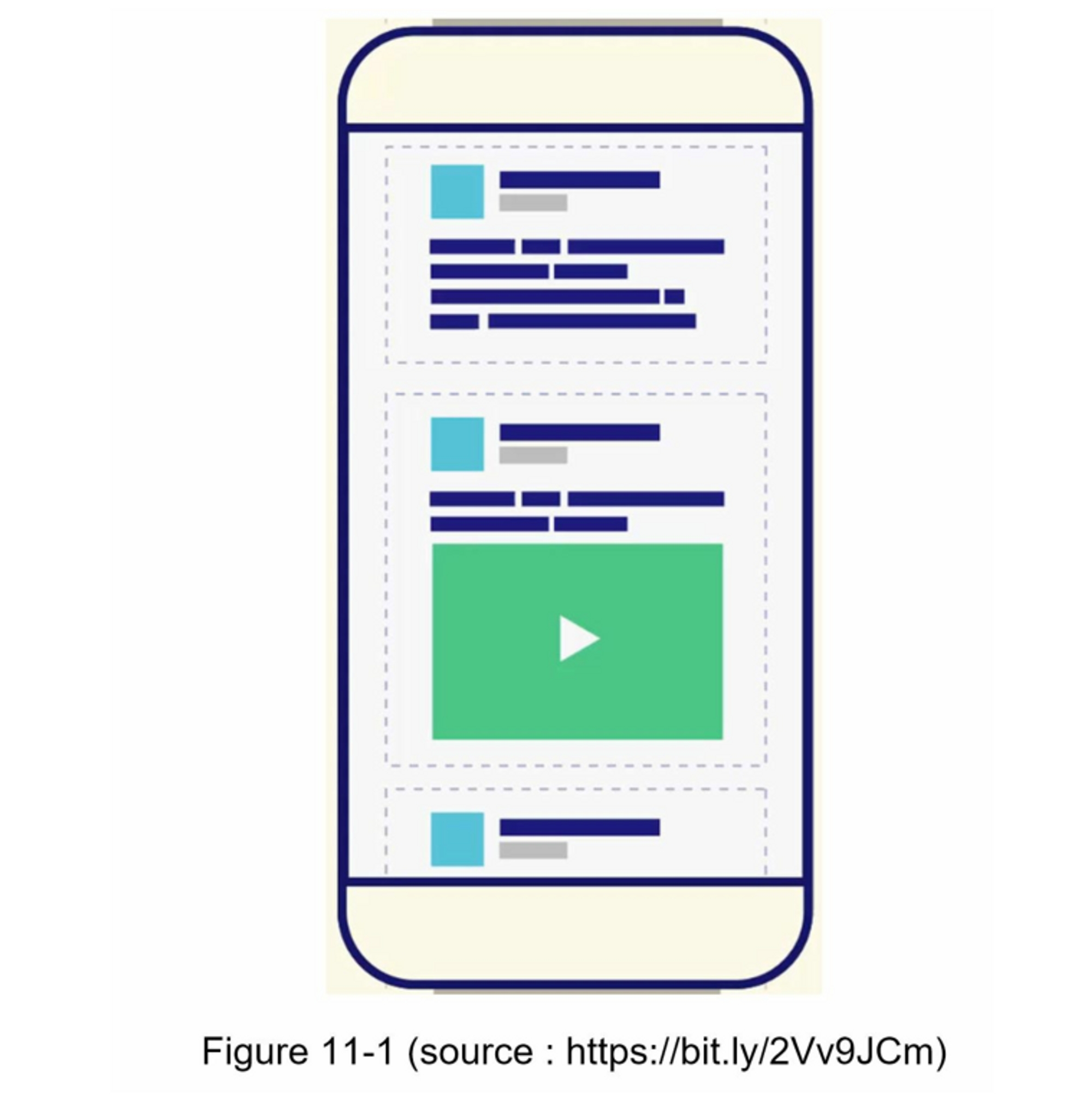

在本章中,您需要设计一个信息推送系统。 什么是信息推送? 根据 Facebook 帮助页面,“动态是位于首页中间不断更新的动态列表。动态包括您在 Facebook 上关注的用户、公共主页和小组发布的状态更新、照片、视频、链接、应用事件和点赞。”[1]。 这是一个流行的面试问题。 类似的常见问题有:设计 Facebook 信息推送、Instagram 推送、Twitter 时间线等。

第1步:了解问题并确定设计范围

第一组解释问题是为了了解当面试官要求你设计一个信息推送系统时,她的想法是什么。最起码,你应该弄清楚要支持哪些功能。下面是一个候选人与面试官互动的例子。

候选人:这是一个移动应用程序吗?还是一个网络应用?或者两者都是?

面试官:都是

候选人:哪些是重要的特征?

面试官:用户可以发布帖子,并在信息流页面上看到她朋友的帖子。

候选人:信息是按逆时针顺序排序,还是按任何特定顺序,如主题得分?例如,你的亲密朋友的帖子有更高的分数。

面试官:为了简单起见,让我们假设推送是按逆时针顺序排序的。

候选人:一个用户可以有多少个朋友?

面试官:5000

候选人:业务流量是多少?

面试官:1000万DAU

候选人:推送可以包含图片、视频,还是只有文字?

面试官:它可以包含媒体文件,包括图片和视频。

现在你已经收集了需求,我们把重点放在设计系统上。

第2步:提出高层次的设计方案并获得认同

该设计分为两个流程:信息流发布和信息流构建:

- 信息发布(Feed publishing):当用户发布帖子时,相应的数据被写入缓存和数据库。帖子被推送到她朋友的动态中。

- 信息流构建(Newsfeed building):为简单起见,我们假设信息推送是通过按时间倒序聚合朋友的帖子来构建的。

信息流发布 API

信息流 API是客户与服务器通信的主要方式。这些API是基于HTTP的,允许客户执行操作,其中包括发布状态、检索信息流、添加朋友等。

我们讨论两个最重要的API:信息流发布 API 和信息流检索 API。

-

信息流发布 API

要发布一个帖子,将向服务器发送一个HTTP POST请求。该API显示如下。

POST /v1/me/feed参数:

content:帖子内容的文本。auth_token:它用于验证API请求。

-

信息流检索 API

检索信息流的API如下:

GET /v1/me/feed参数:

auth_token:它用于验证API请求。

信息发布(Feed publishing)

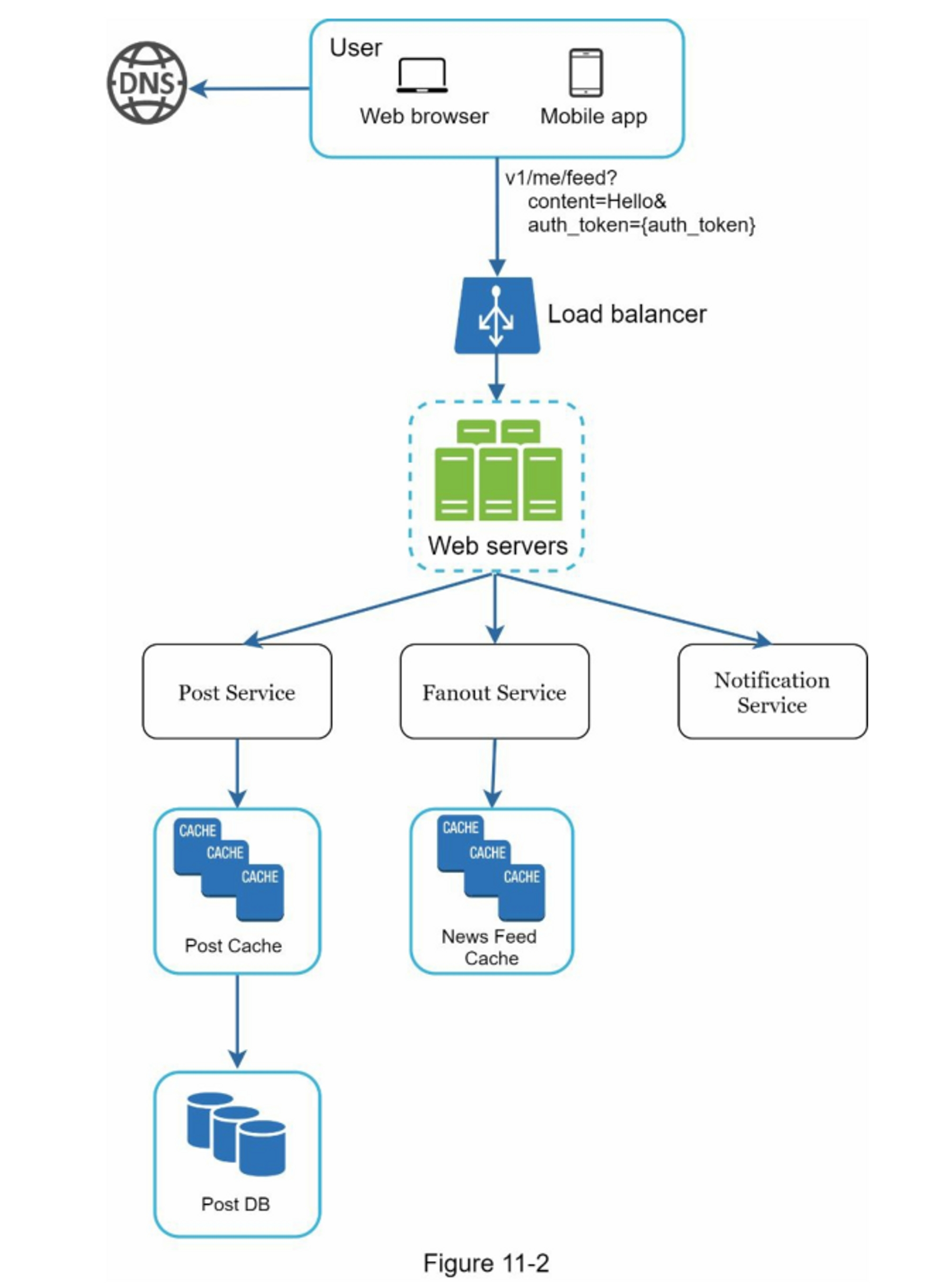

图11-2显示了发布流程的高层设计。

- User(用户):用户可以在浏览器或移动应用程序上查看信息流。一个用户通过API发布内容为 "你好 "的帖子:

/v1/me/feed?content=Hello&auth_token={auth_token} - Load balancer(负载均衡器):将流量分配给网络服务器。

- Web servers(网络服务器):网络服务器将流量重定向到不同的内部服务。

- Post service(帖子服务):在数据库和缓存中持久保存帖子。

- Fanout service(扇出服务):推送新内容到朋友的信息流。信息流数据存储在缓存中,以便快速检索。

- 通知服务:通知朋友有新内容,并发送推送通知。

信息流构建(Newsfeed building)

在这一节中,我们将讨论信息流是如何在幕后构建的。

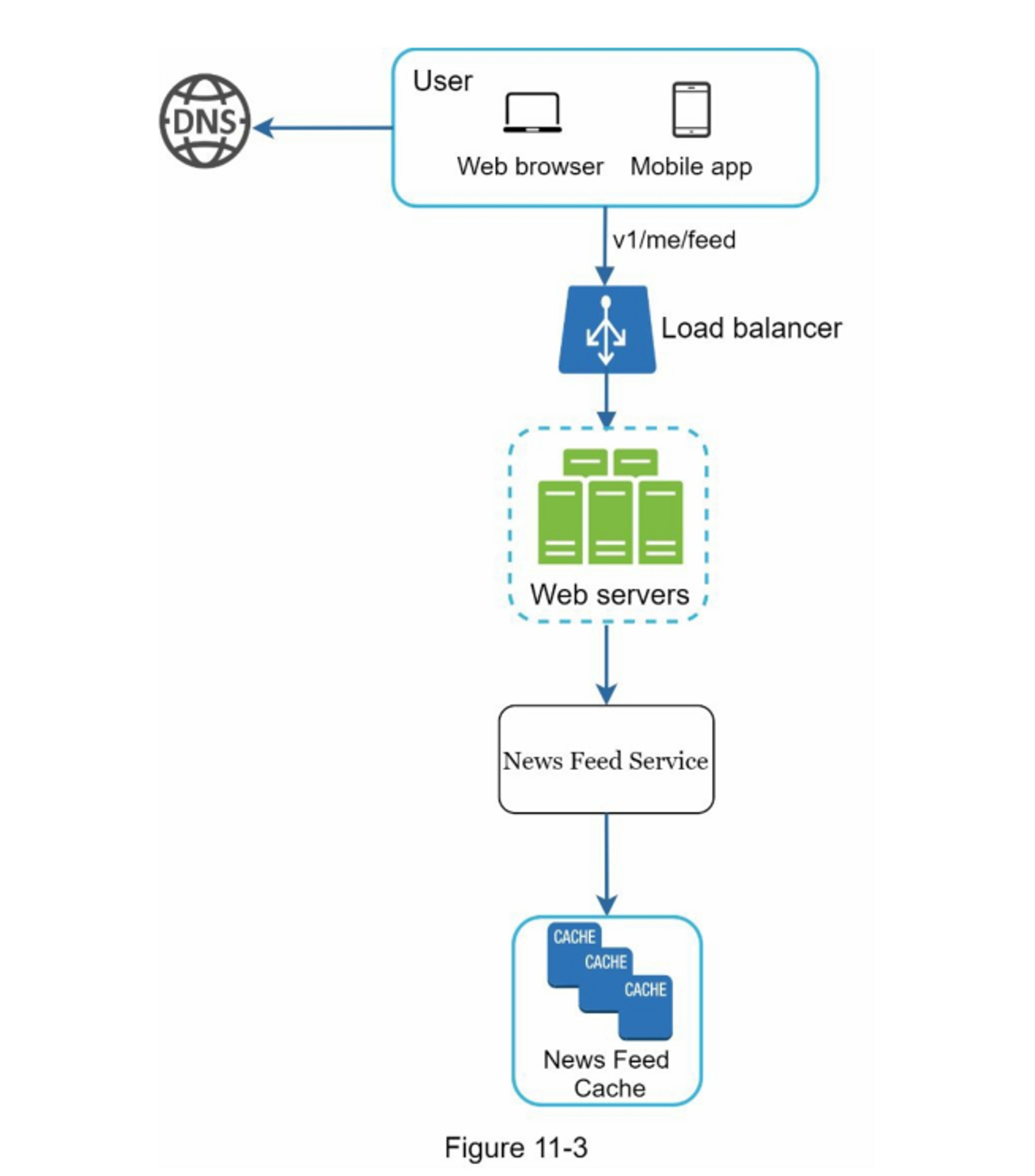

图11-3显示了高层设计。

- User(用户):一个用户发送了一个请求来检索她的信息。 该请求看起来像这样:

/v1/me/feed。 - Load balancer(负载均衡器):将流量分配给网络服务器。

- Web servers(网络服务器):网络服务器将请求路由到信息发布服务。

- Newsfeed service(信息馈送服务):信息馈送服务从缓存中获取信息。

- Newsfeed cache(信息流缓存):存储渲染信息流所需的信息ID。

第3步:深入设计

高层设计简要地涵盖了两个流程:信息发布和信息流构建。在这里,我们更深入地讨论这些主题。

信息发布深入研究

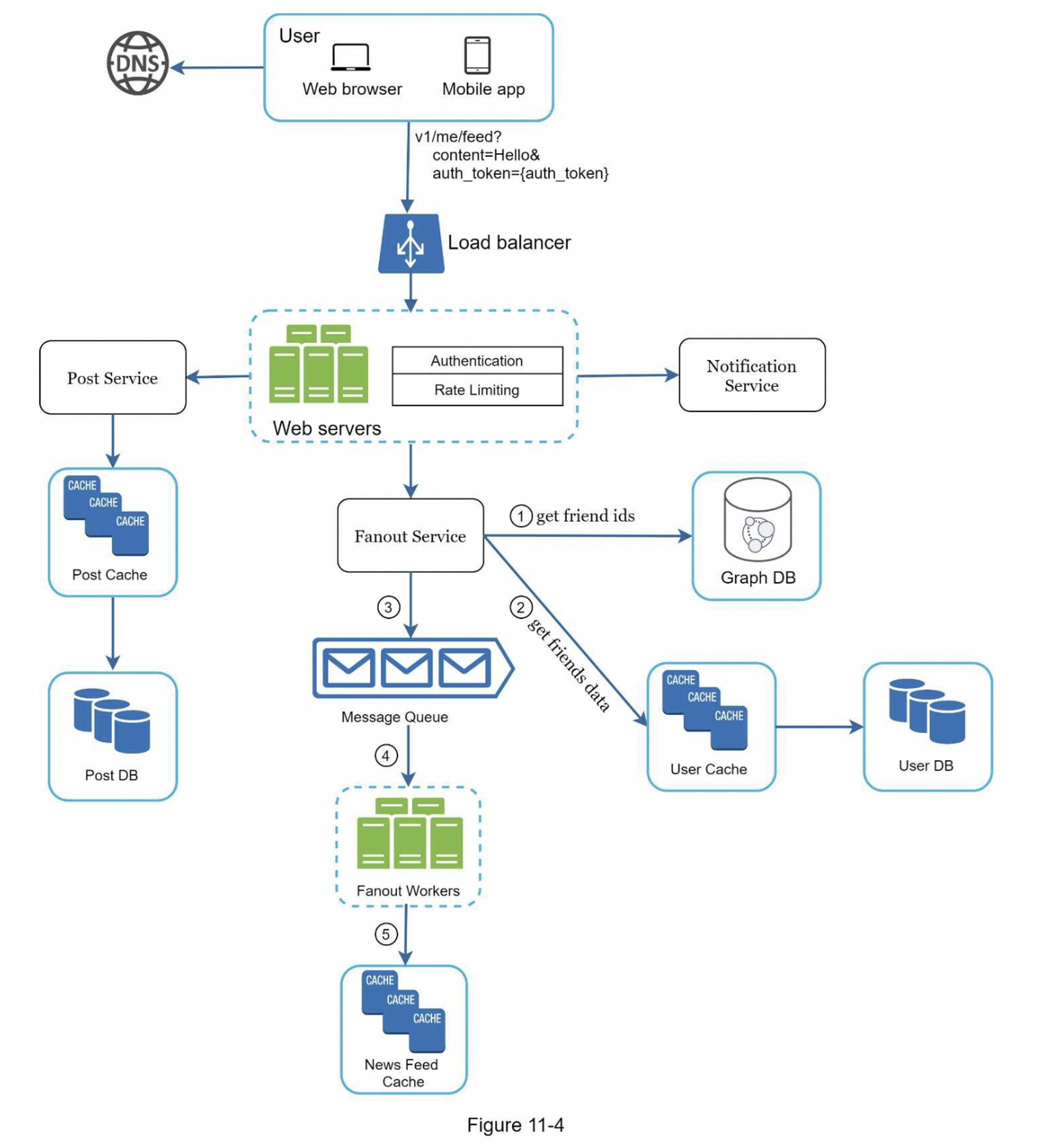

图 11-4 概述了信息发布的详细设计。我们已经讨论了高层次设计中的大部分组件,我们将重点关注两个组件:Web 服务器和扇出服务。

web 服务

除了与客户端通信外,Web 服务器还执行身份验证和速率限制。只有使用有效 auth_token 登录的用户才可以发帖。该系统限制用户在一定时期内可以发布的帖子数量,这对于防止垃圾邮件和滥用内容至关重要。

扇出服务

Fanout 是将帖子传递给所有朋友的过程。两种类型的扇出模型是:写扇出(也称为推模型)和读扇出(也称为拉模型)。两种模型各有利弊。我们解释他们的工作流程并探索支持我们系统的最佳方法。

写扇出

通过这种方法,信息流在写的时候就被预先计算了。一个新的帖子在发布后会立即被送到朋友的缓存中。

优点:

- 动态消息是实时生成的,可以第一时间推送给朋友。

- 获取信息流的速度很快,因为信息流是在写的时候预先计算的。

缺点:

- 如果一个用户有很多朋友,获取朋友列表并为所有朋友生成信息流是很慢的,而且很耗时间。这被称为热键问题。

- 对于不活跃的用户或那些很少登录的用户,预先计算的信息流会浪费计算资源。

读扇出

信息源是在阅读时间内产生的。这是一个按需分配的模式。当用户加载她的主页时,最近的帖子被拉出。

优点:

- 对于不活跃的用户或那些很少登录的用户,读取时的扇出效果更好,因为它不会在他们身上浪费计算资源。

- 数据不会被推送给朋友,所以不存在热键的问题。

缺点:

- 获取信息源的速度很慢,因为信息源不是预先计算的。

我们采用了一种混合方法,以获得两种方法的好处并避免其中的缺点。由于快速获取信息流是至关重要的,我们对大多数用户使用推送模式。对于名人或有很多朋友/粉丝的用户,我们让粉丝按需提取信息内容以避免系统过载。一致性哈希是缓解热键问题的一个有用技术,因为它有助于更均匀地分配请求/数据。

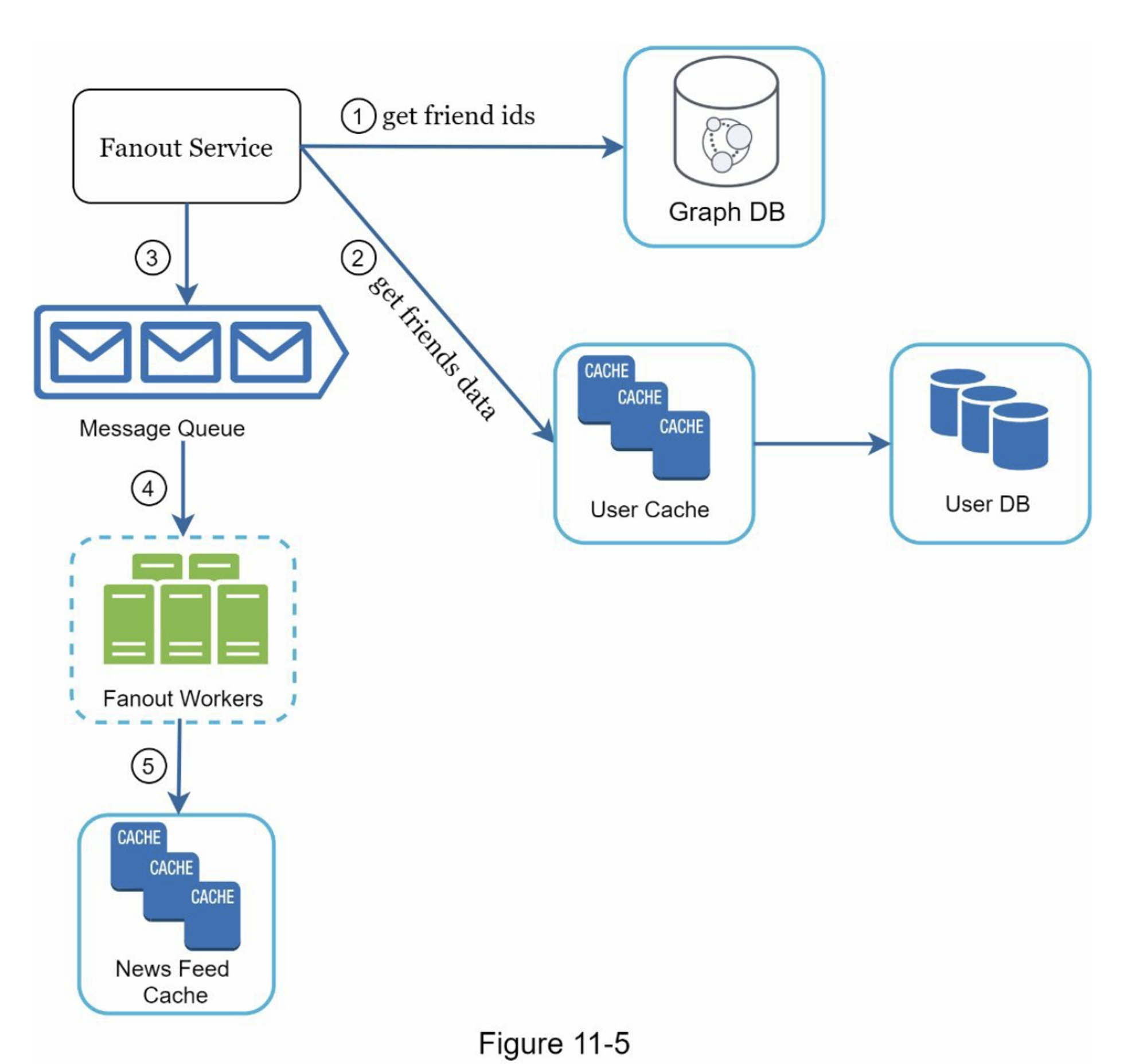

让我们仔细看看图11-5中所示的扇出服务。

扇出服务的工作原理如下:

-

从图形数据库中获取朋友 ID。 图数据库适用于管理朋友关系和朋友推荐。 希望了解更多有关此概念的感兴趣的读者应参阅参考资料 [2]。

-

从用户缓存中获取朋友信息。然后,系统根据用户设置过滤出朋友。例如,如果你把某人调成静音,她的帖子将不会显示在你的信息流中,尽管你们仍然是朋友。帖子可能不显示的另一个原因是,用户可以有选择地与特定的朋友分享信息或对其他人隐藏信息。

-

将好友列表和新帖子 ID 发送到消息队列。

-

Fanout worker 从消息队列中获取数据并将信息流数据存储在信息流缓存中。 你可以将信息流缓存视为一个

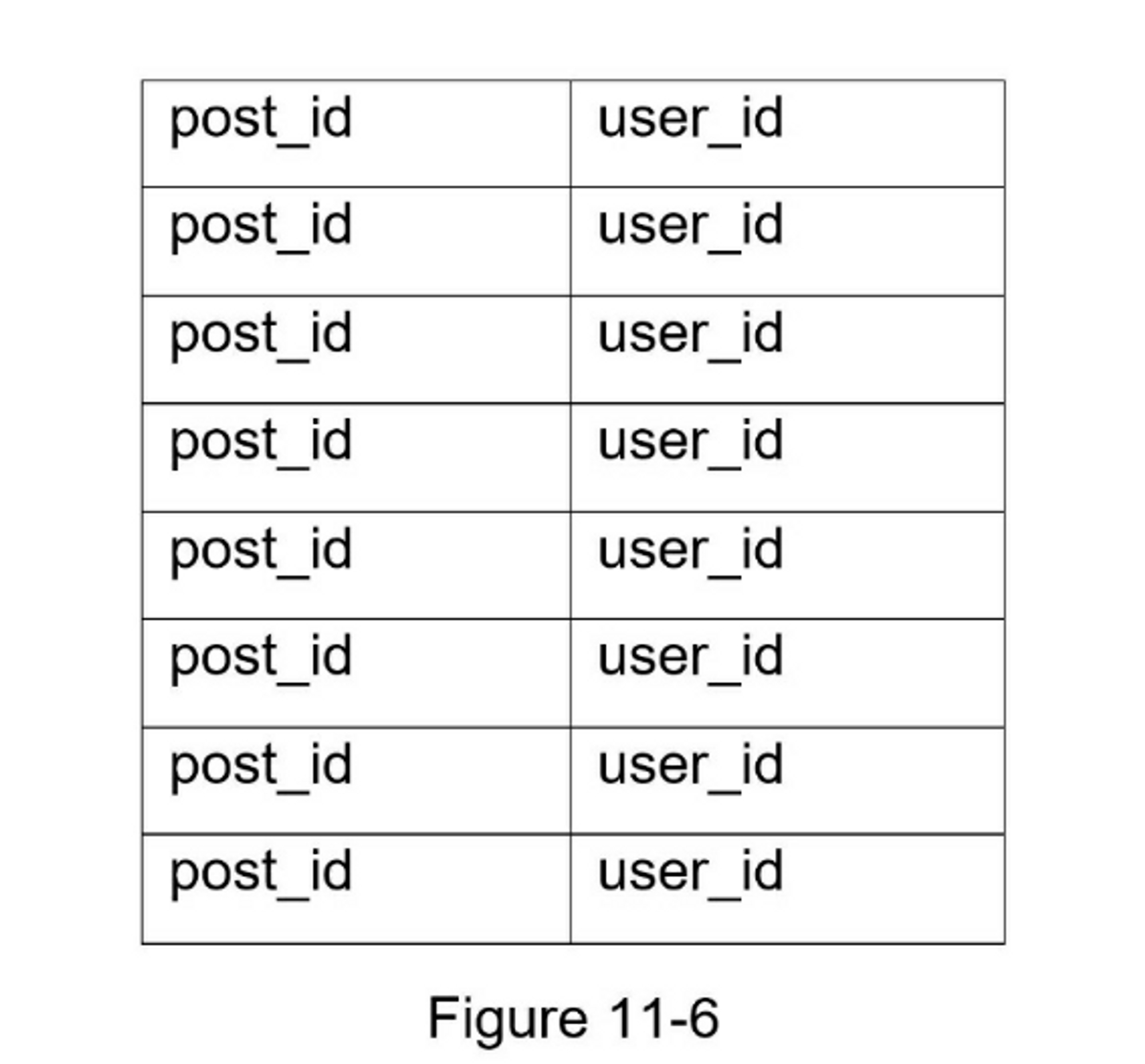

<post_id, user_id>结构的映射表。 每当发布新帖子时,新帖子将被追加到信息流表中,如图 11-6 所示。 如果我们将整个用户和帖子对象存储在缓存中,内存消耗会变得非常大。 因此,仅存储 ID。 为了保持较小的内存大小,我们设置了一个可配置的限制。 用户滚动浏览信息流中数千个帖子的机会很小。 大多数用户只对最新的内容感兴趣,所以缓存未命中率低。 -

将

<post_id, user_id>存储在信息流缓存中。 图 11-6 显示了缓存中信息流的示例。

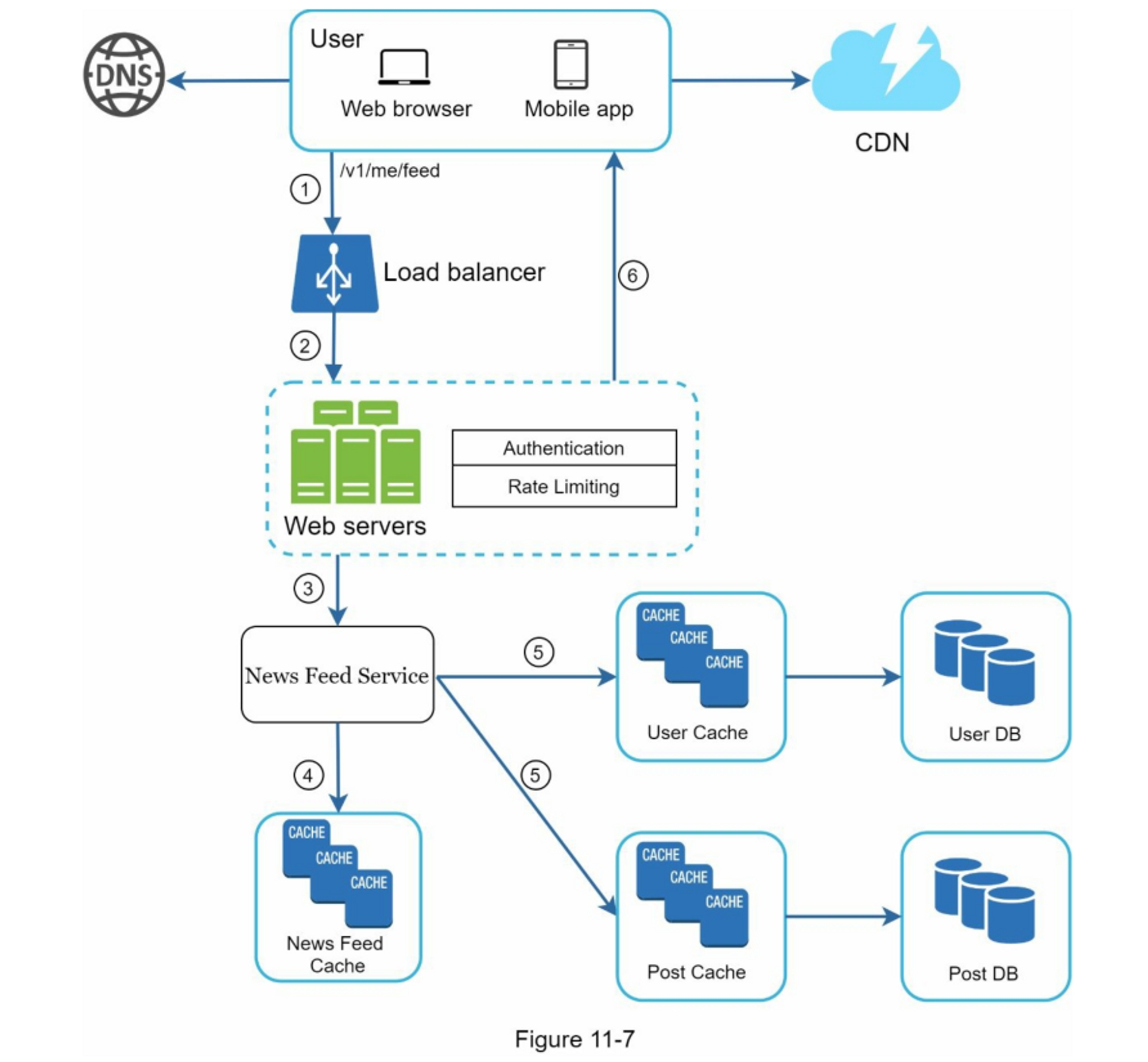

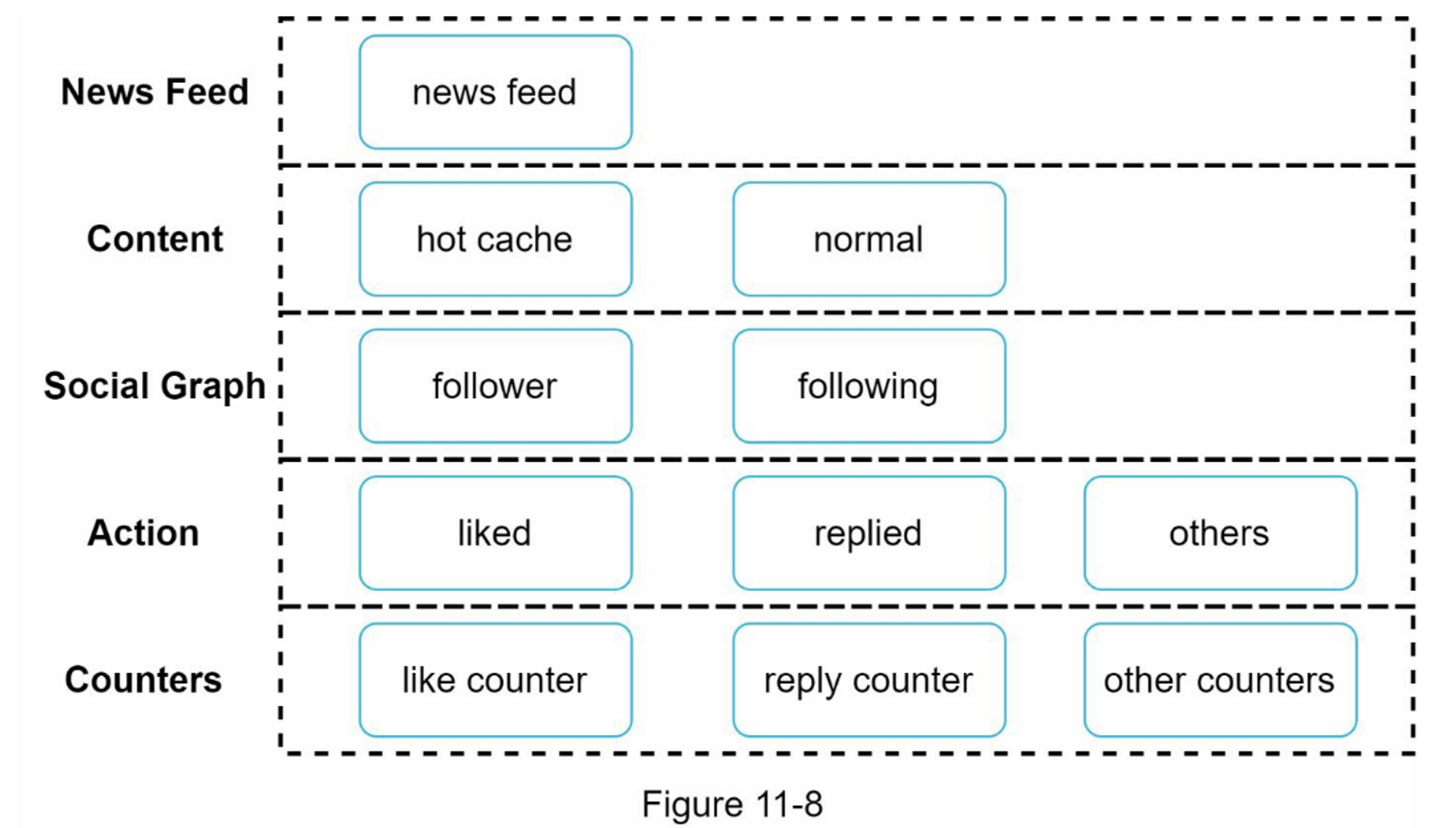

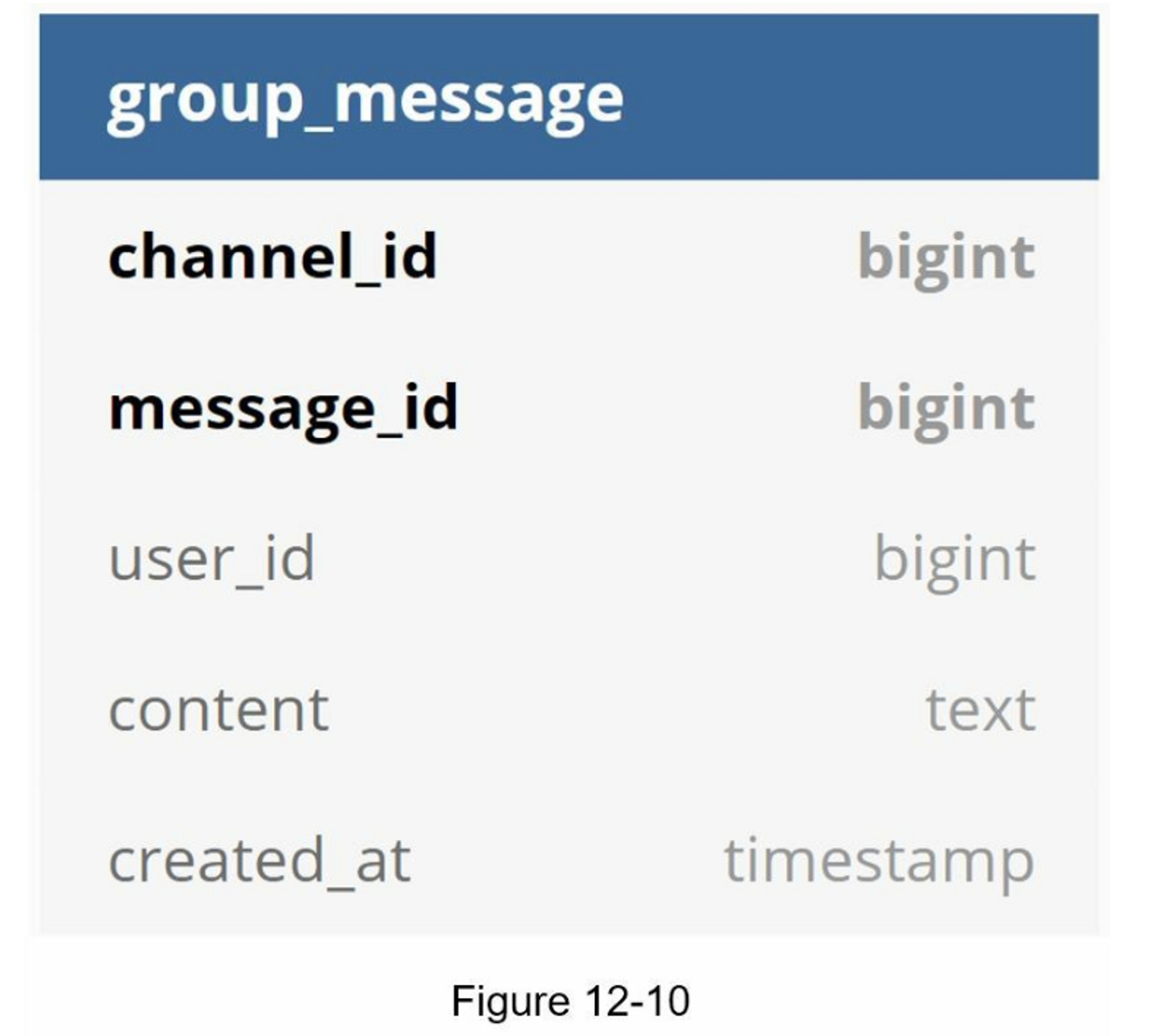

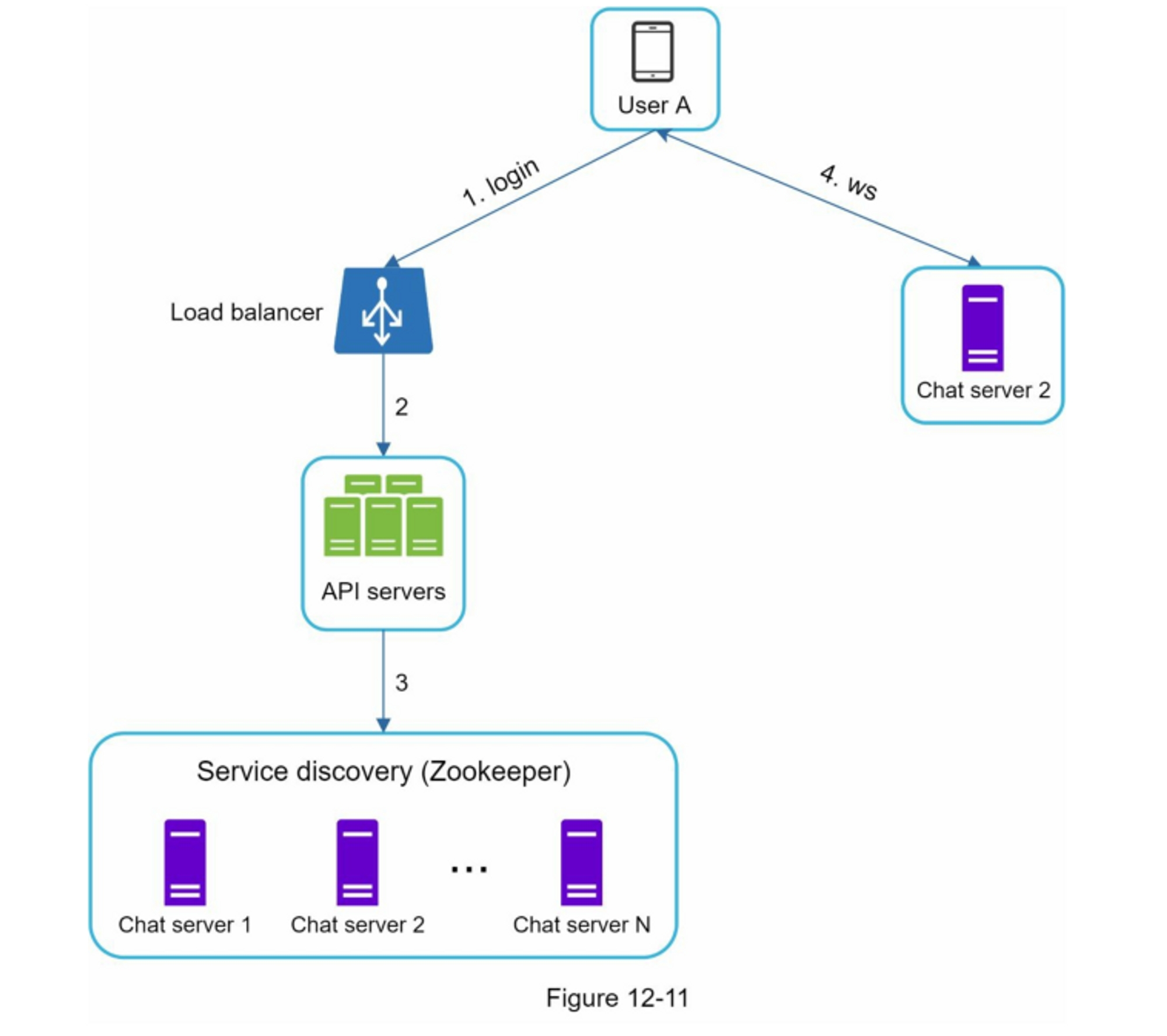

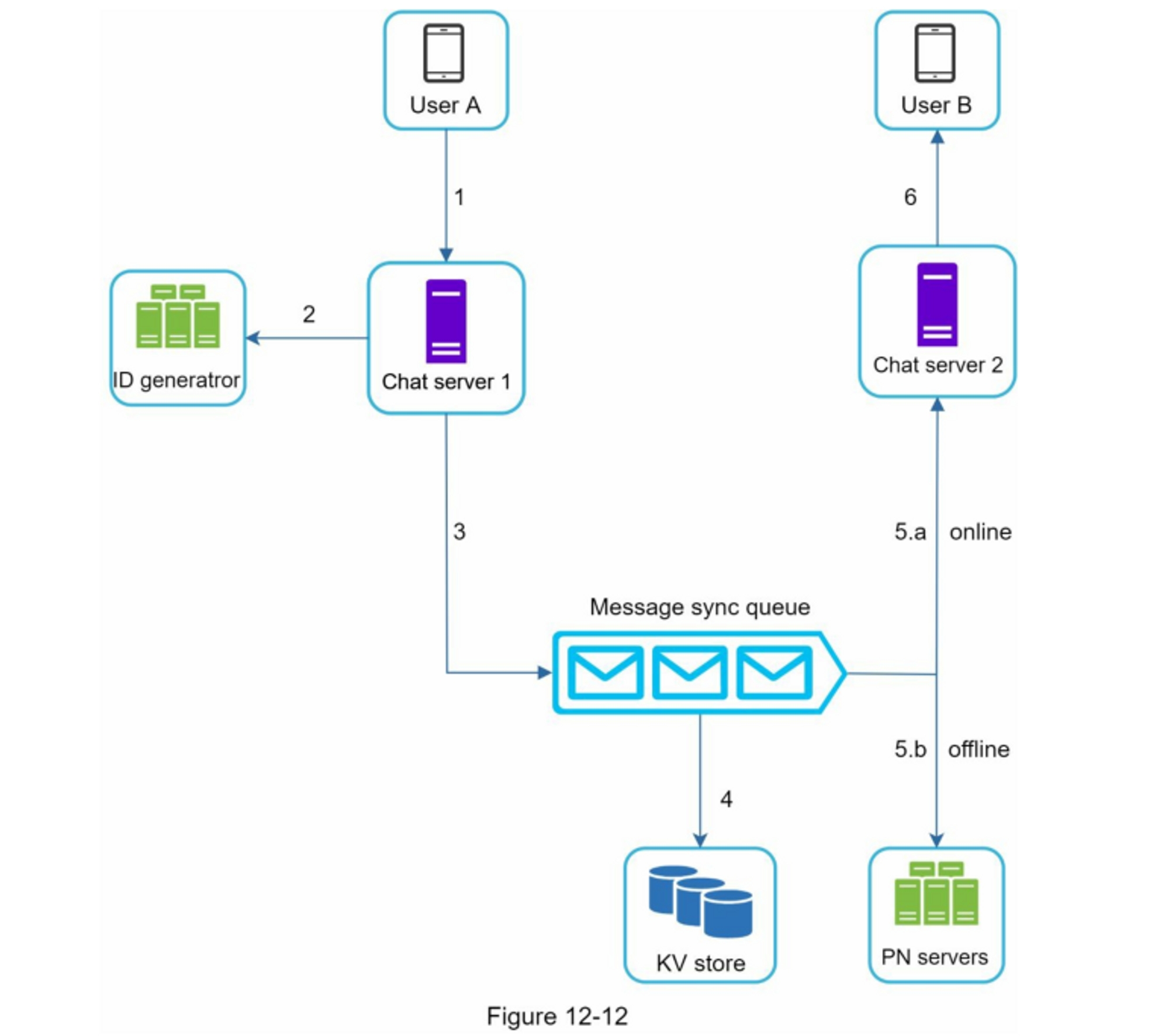

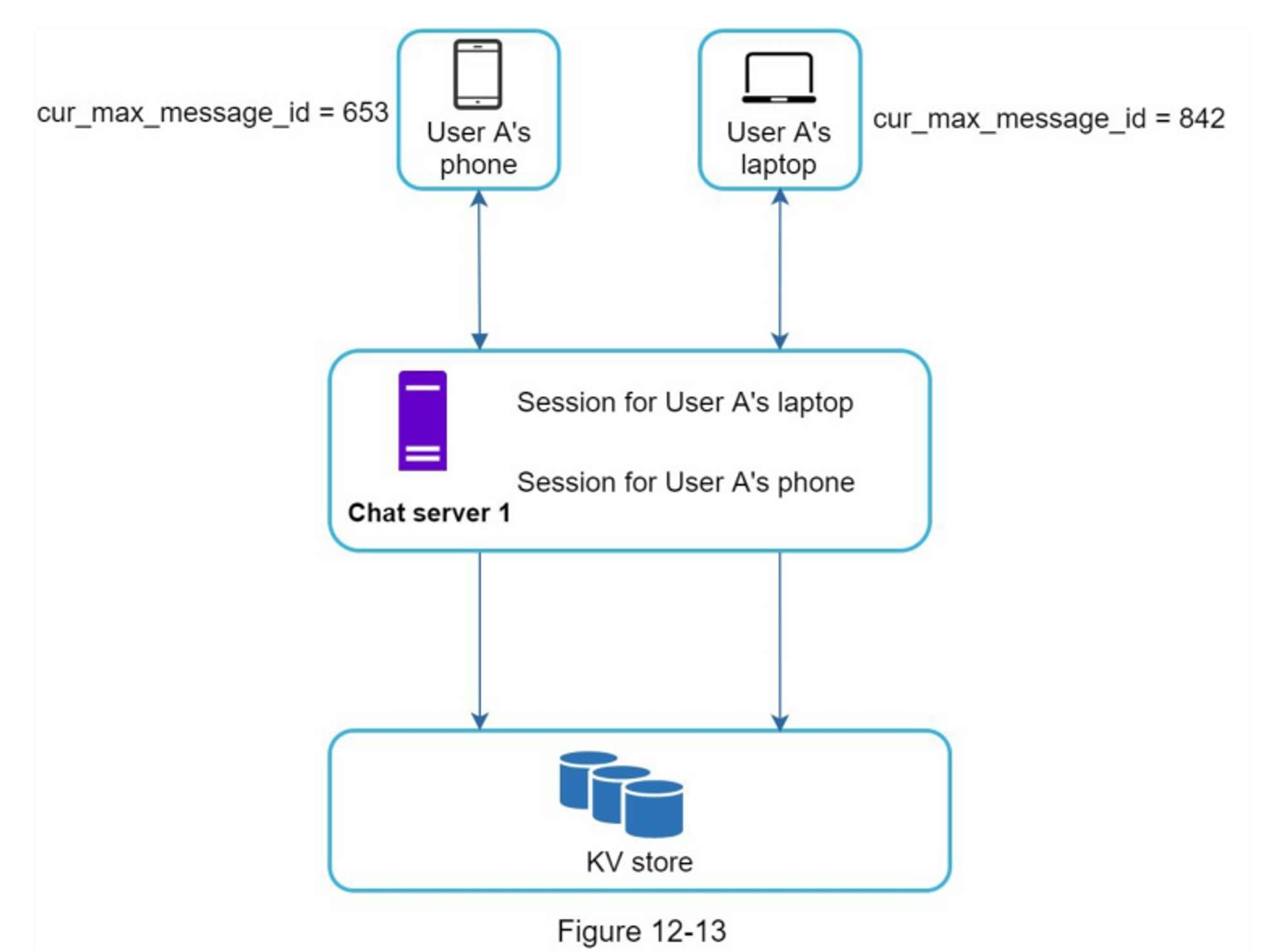

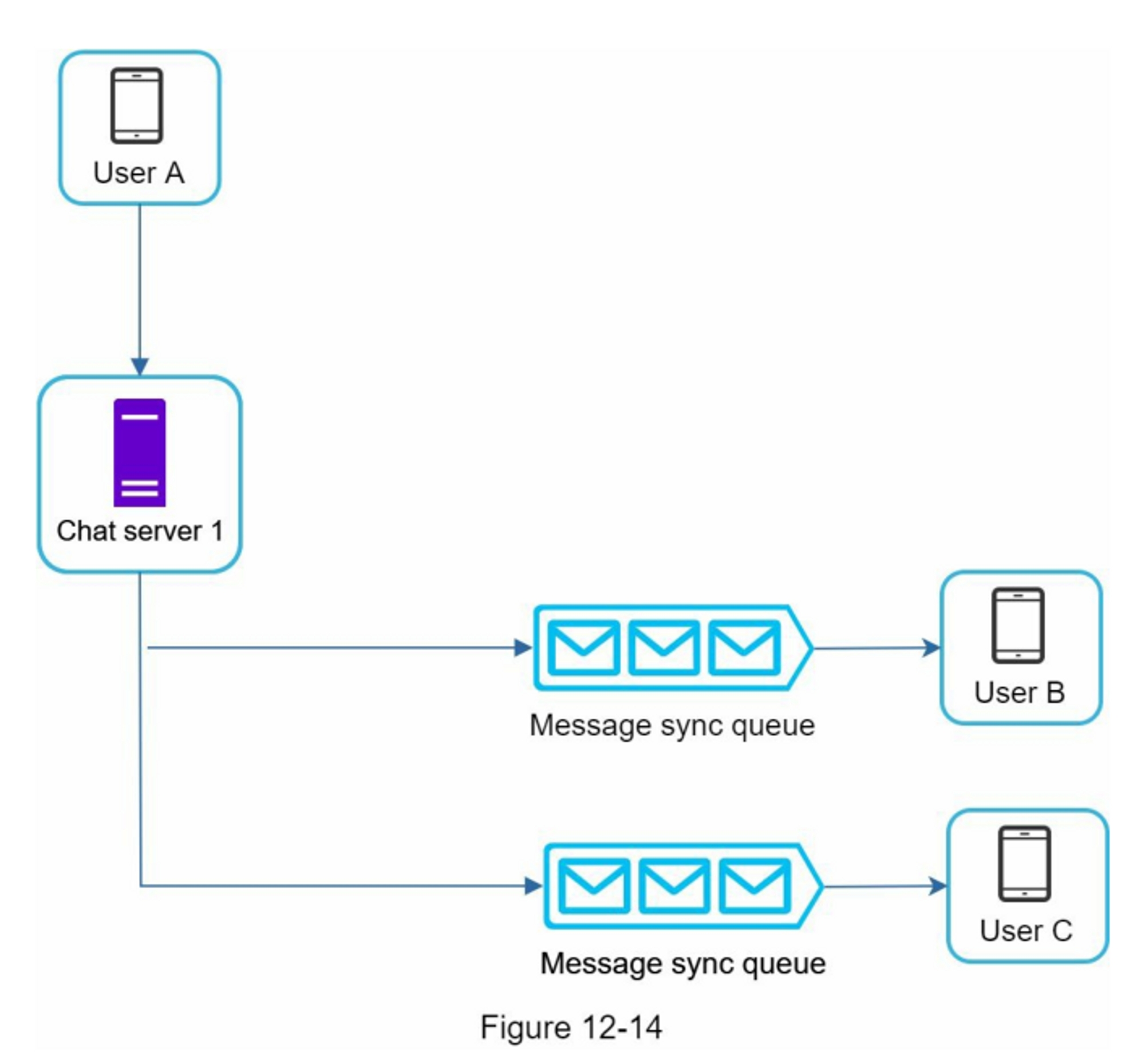

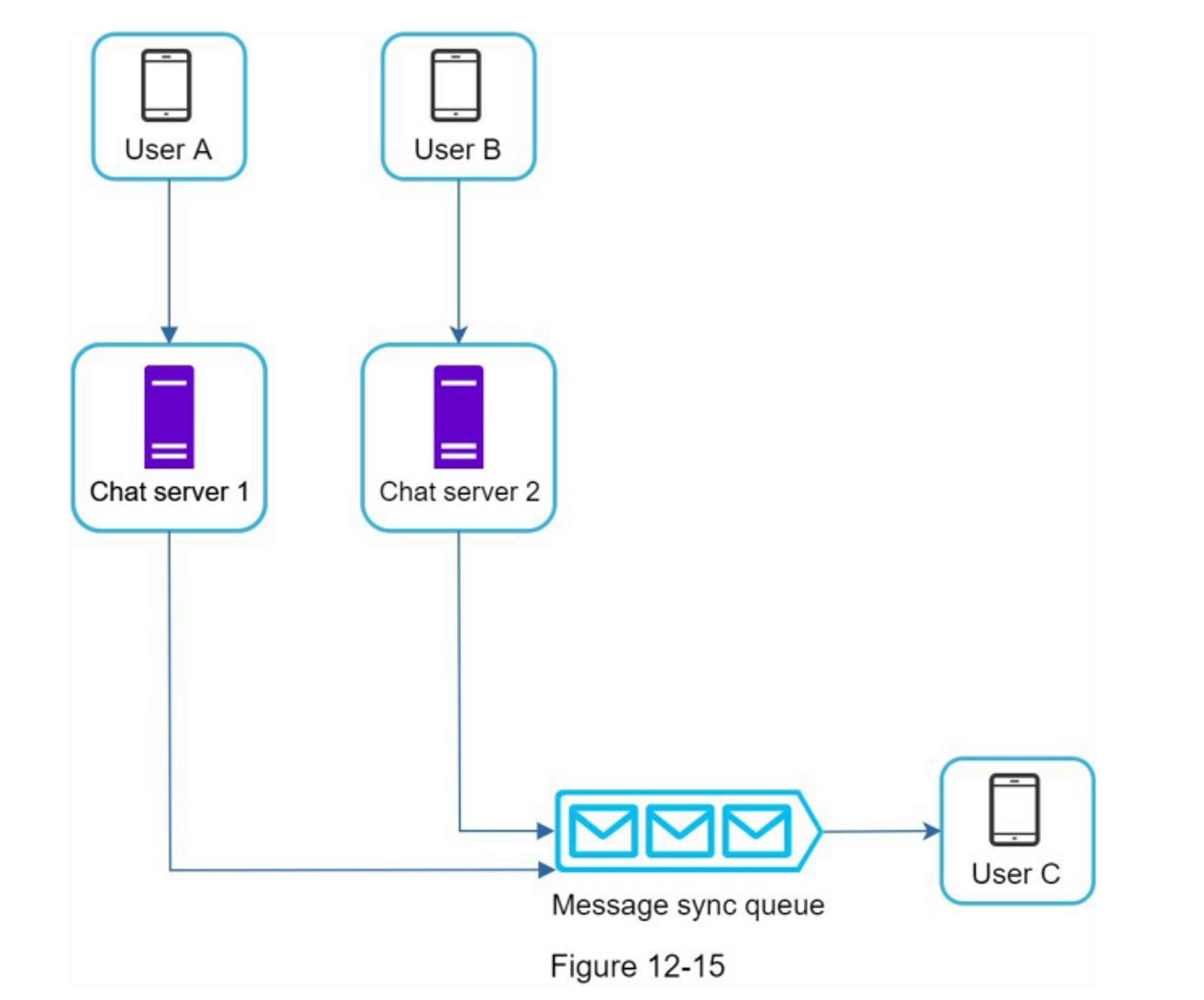

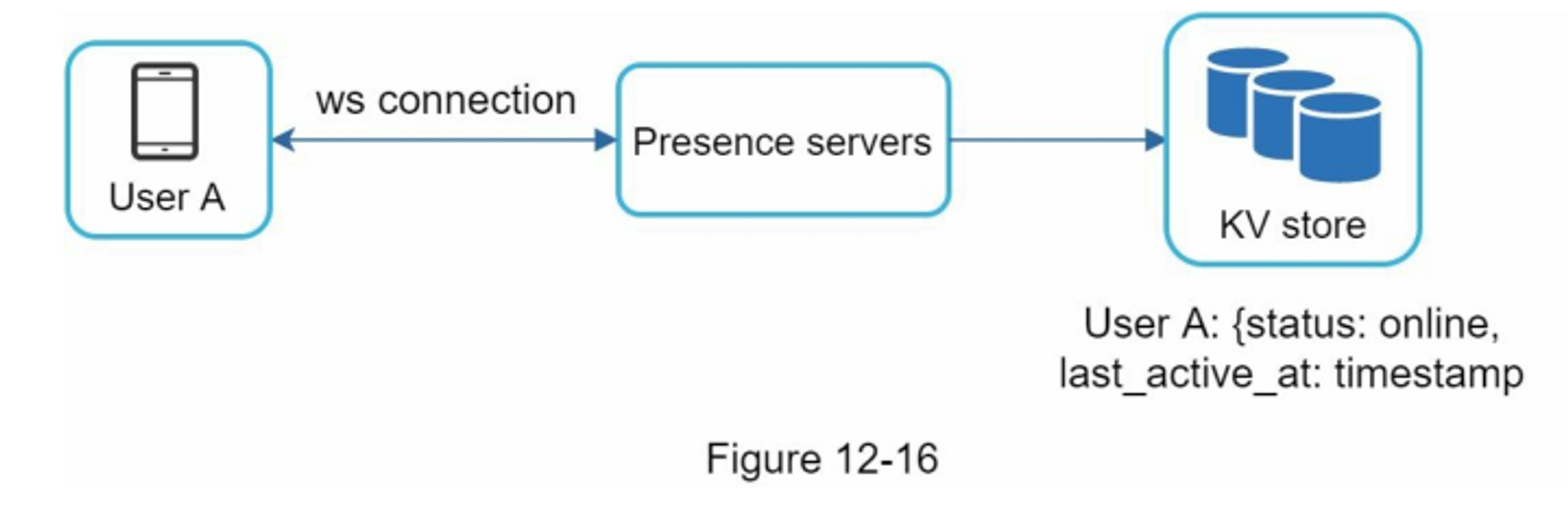

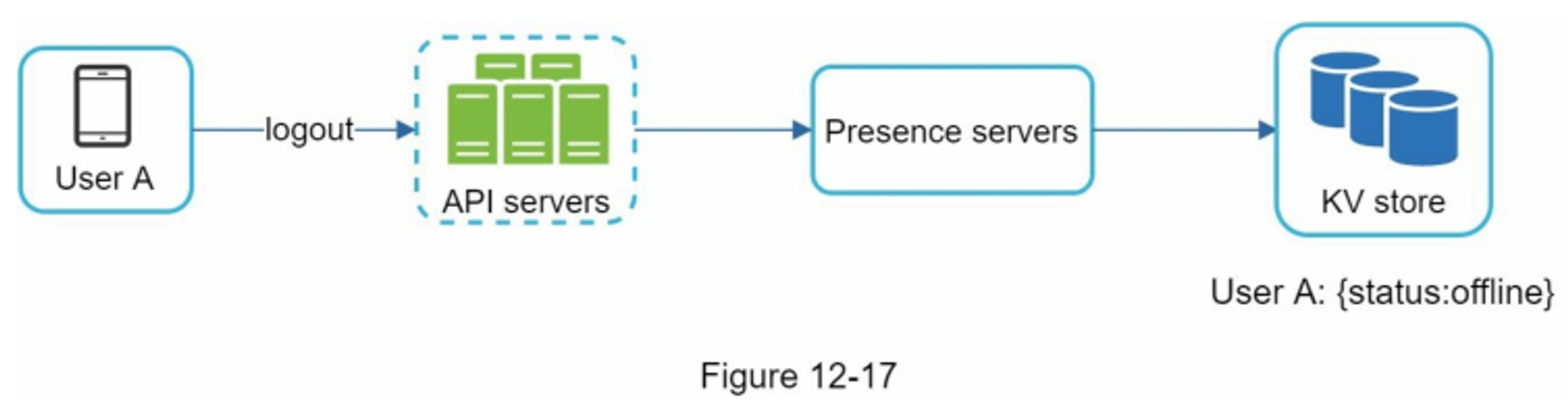

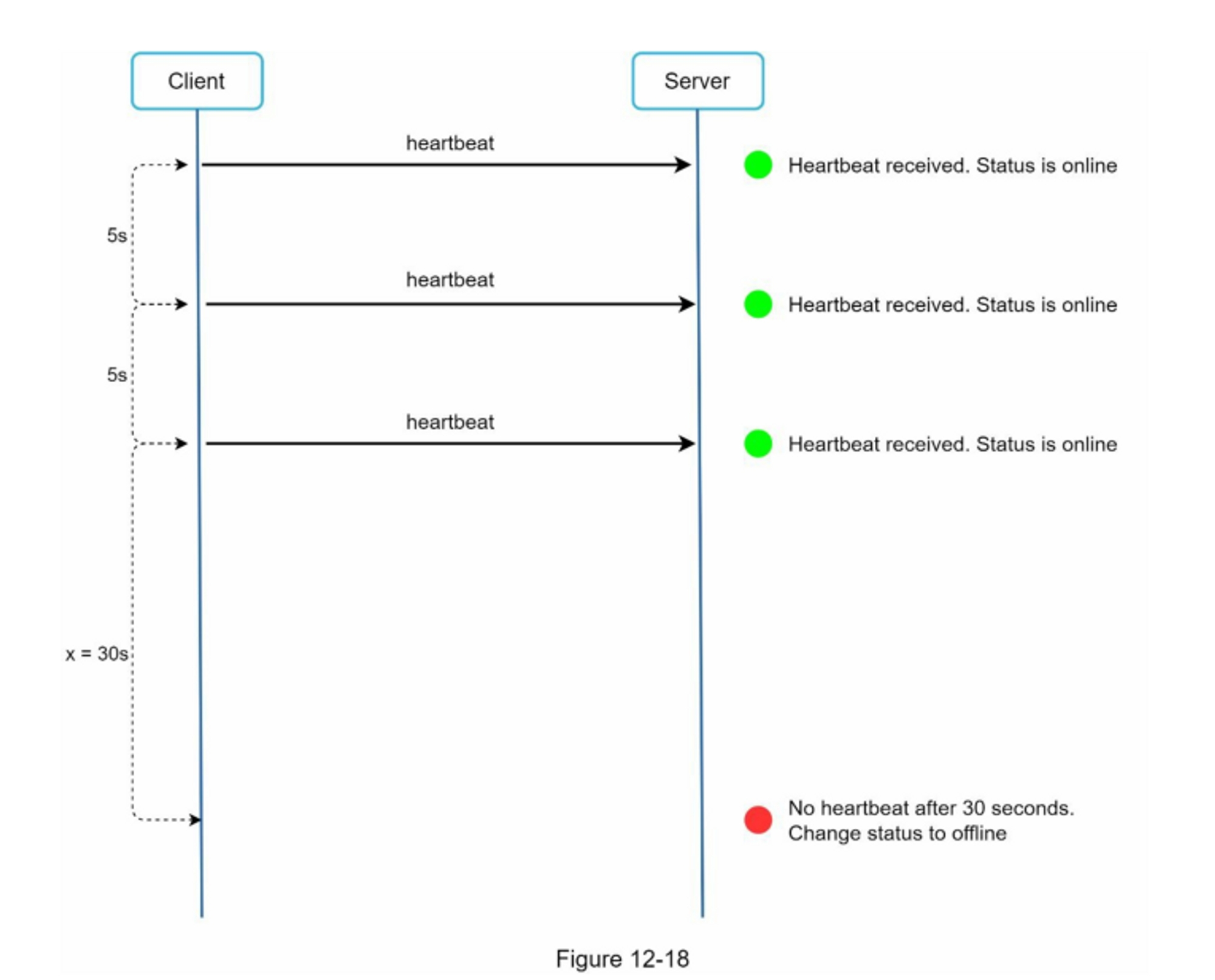

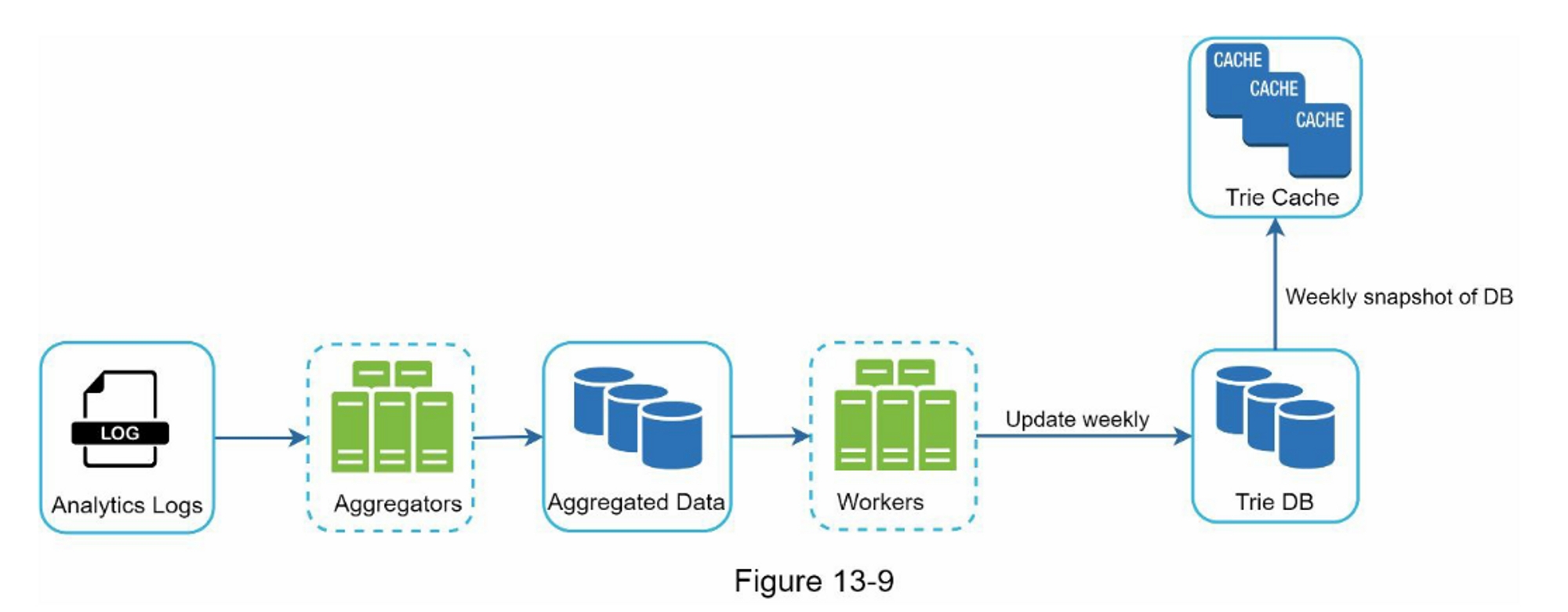

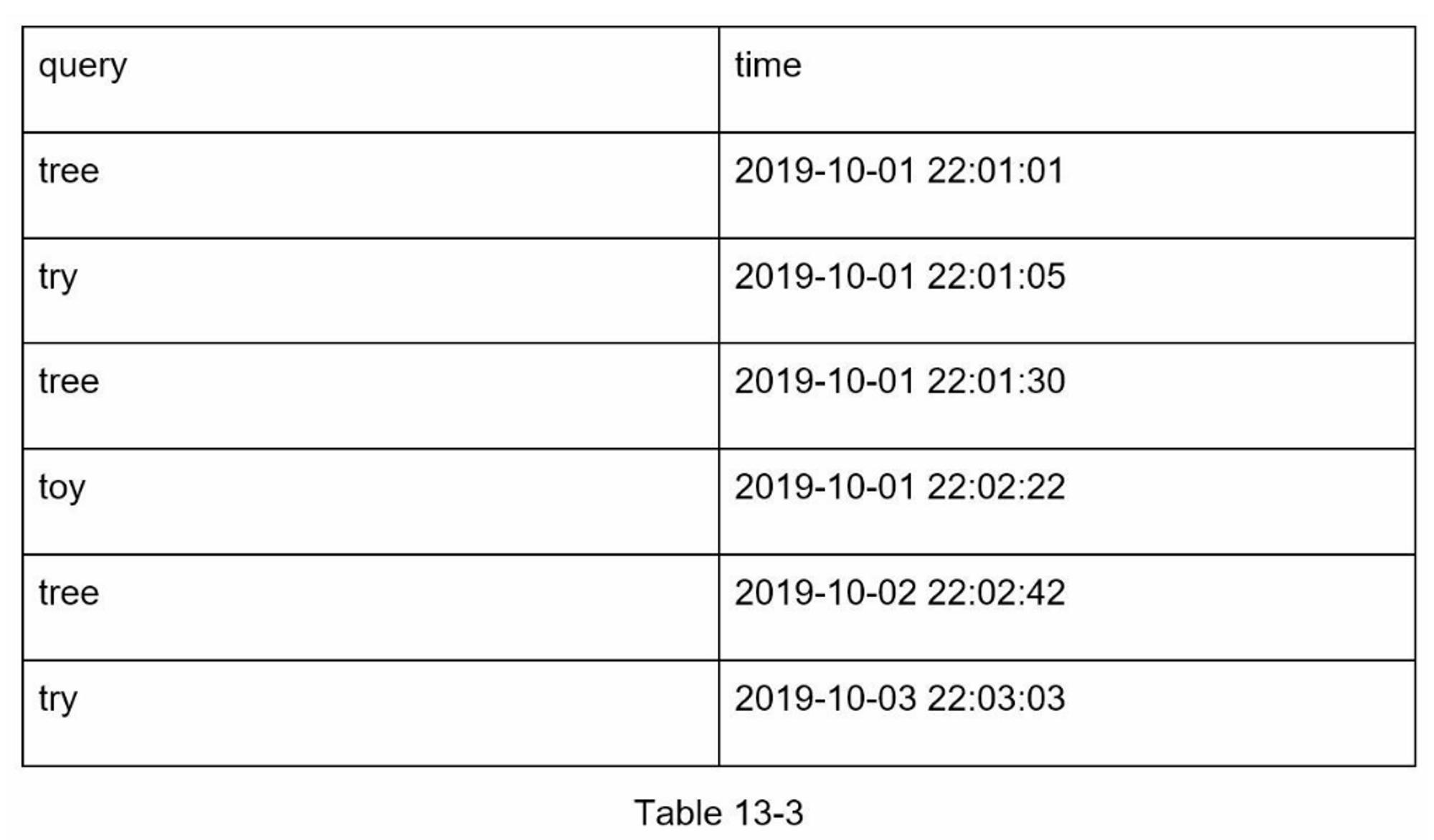

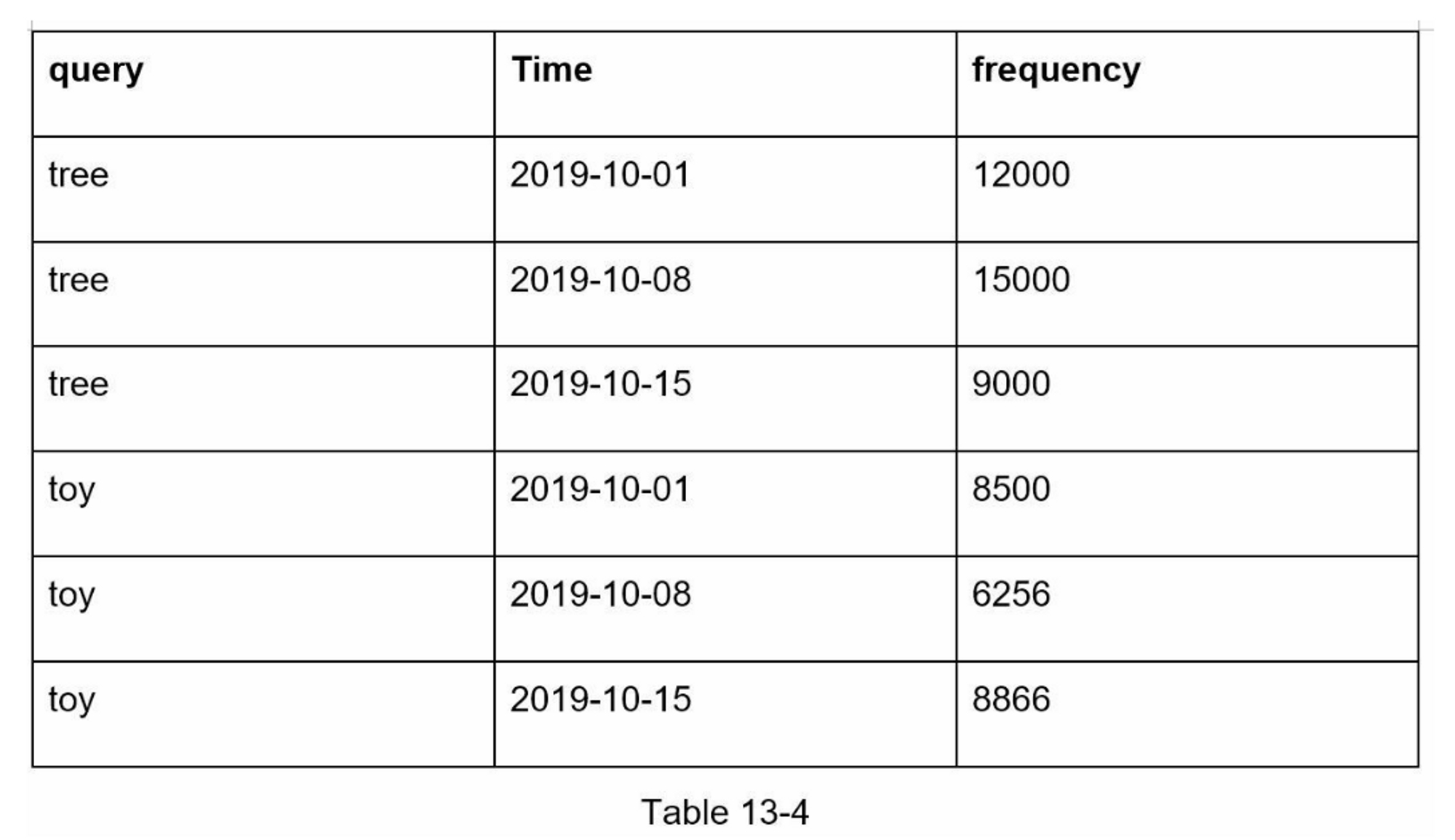

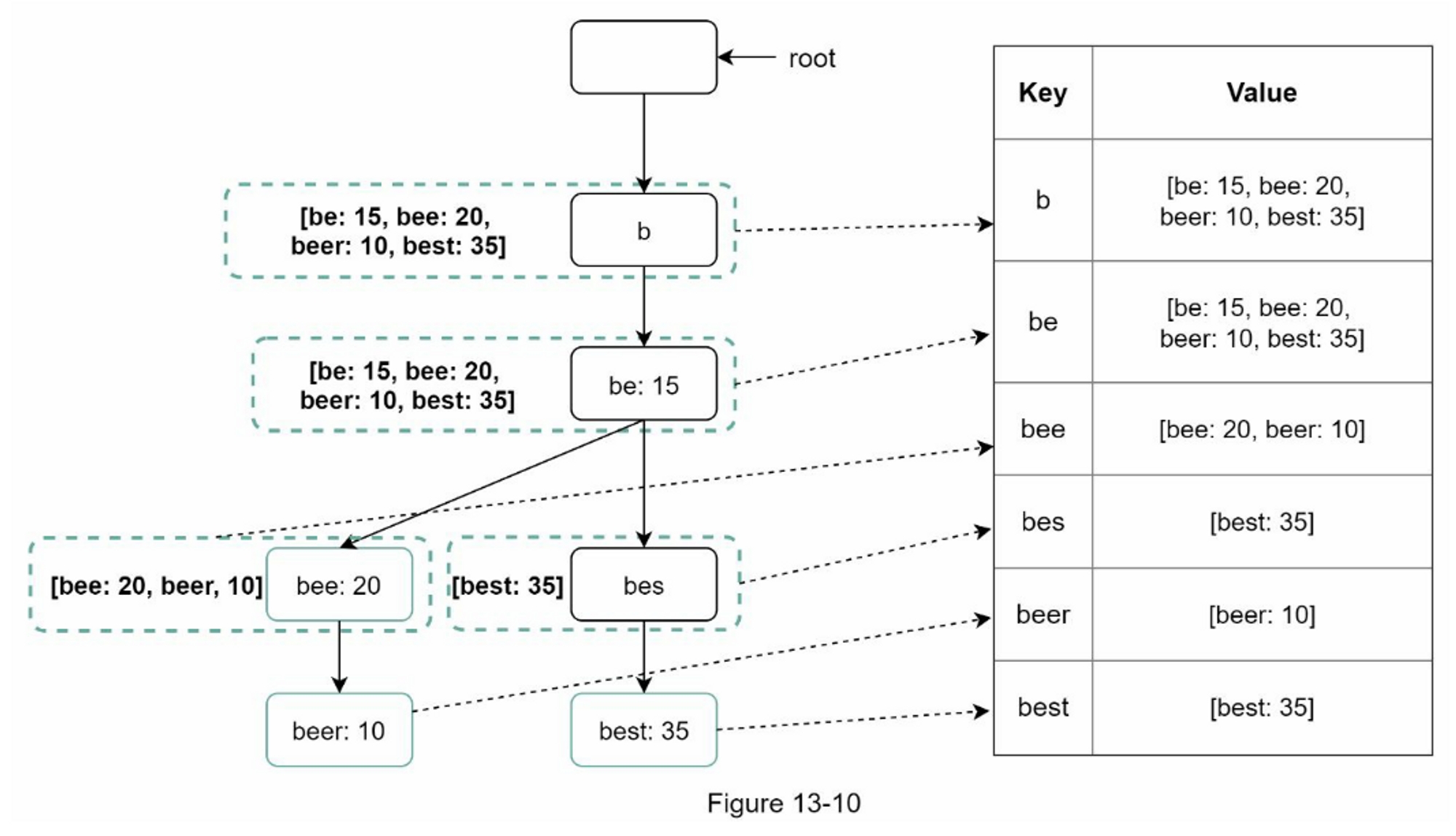

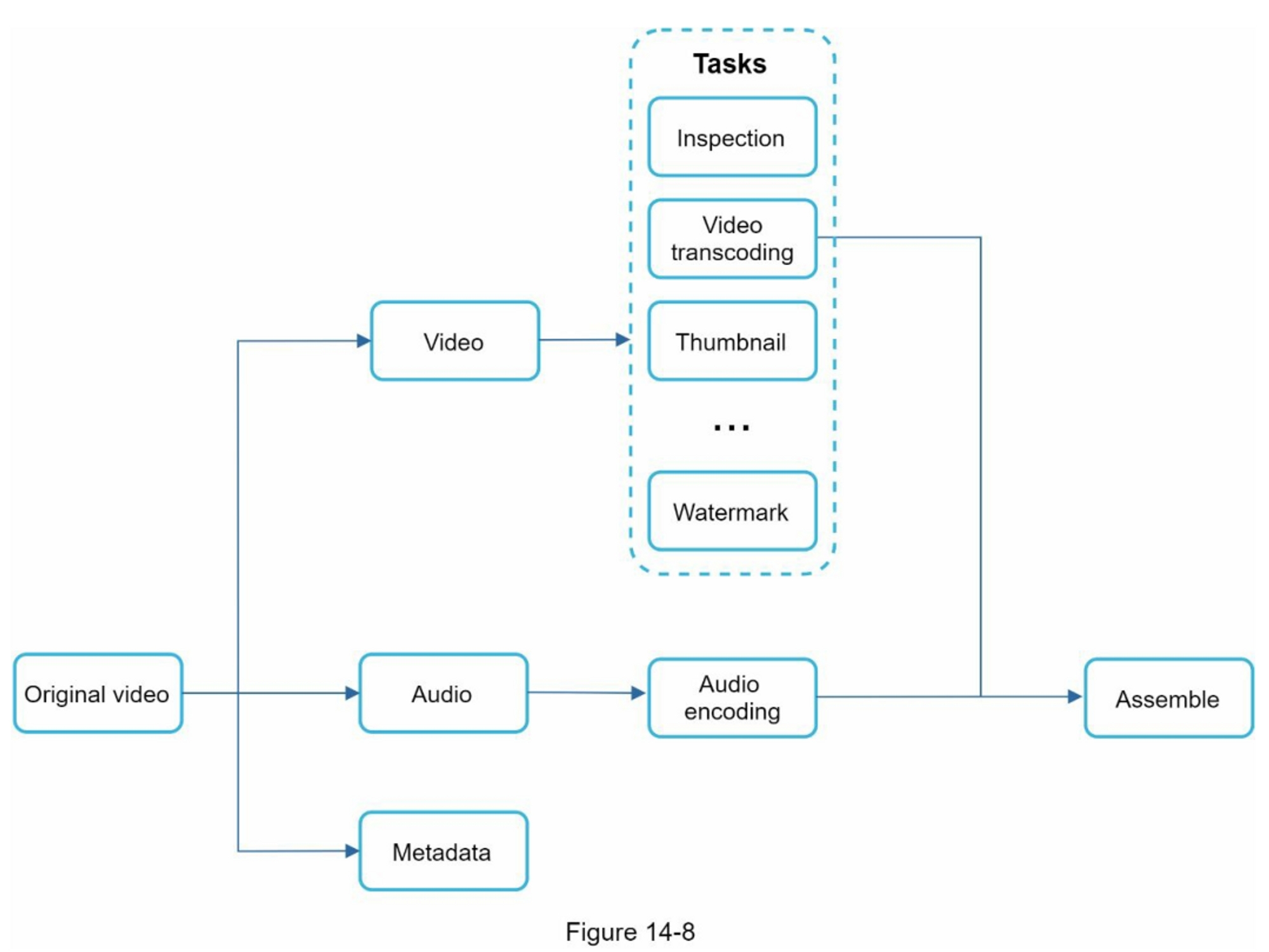

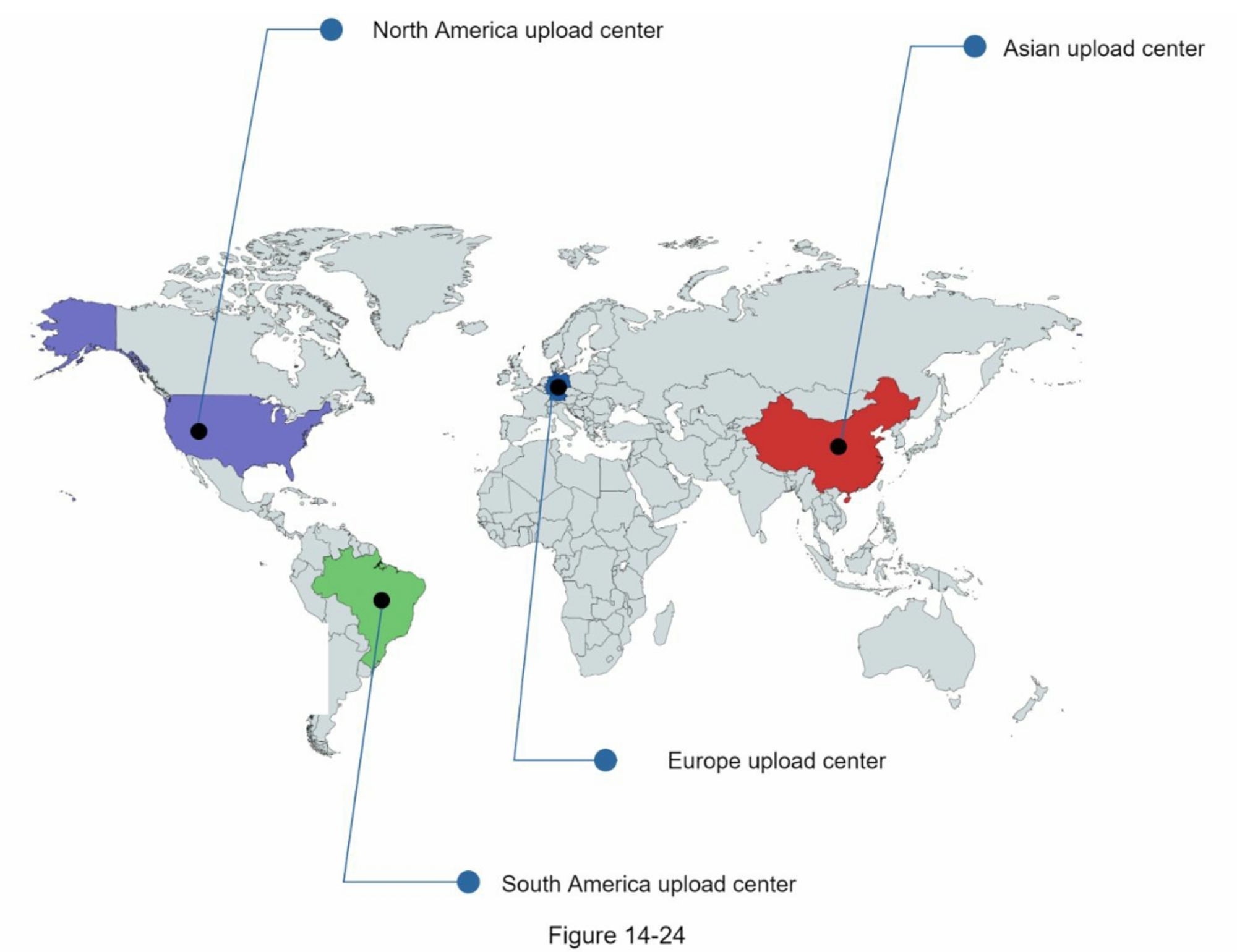

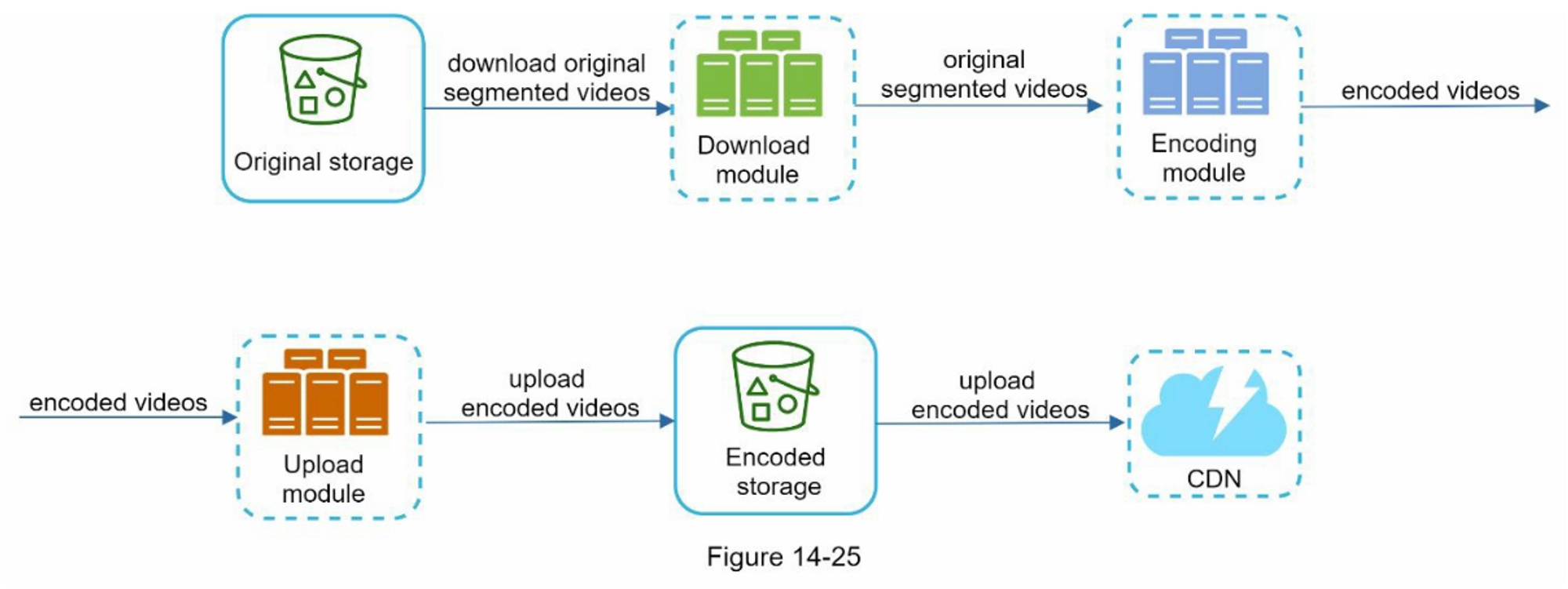

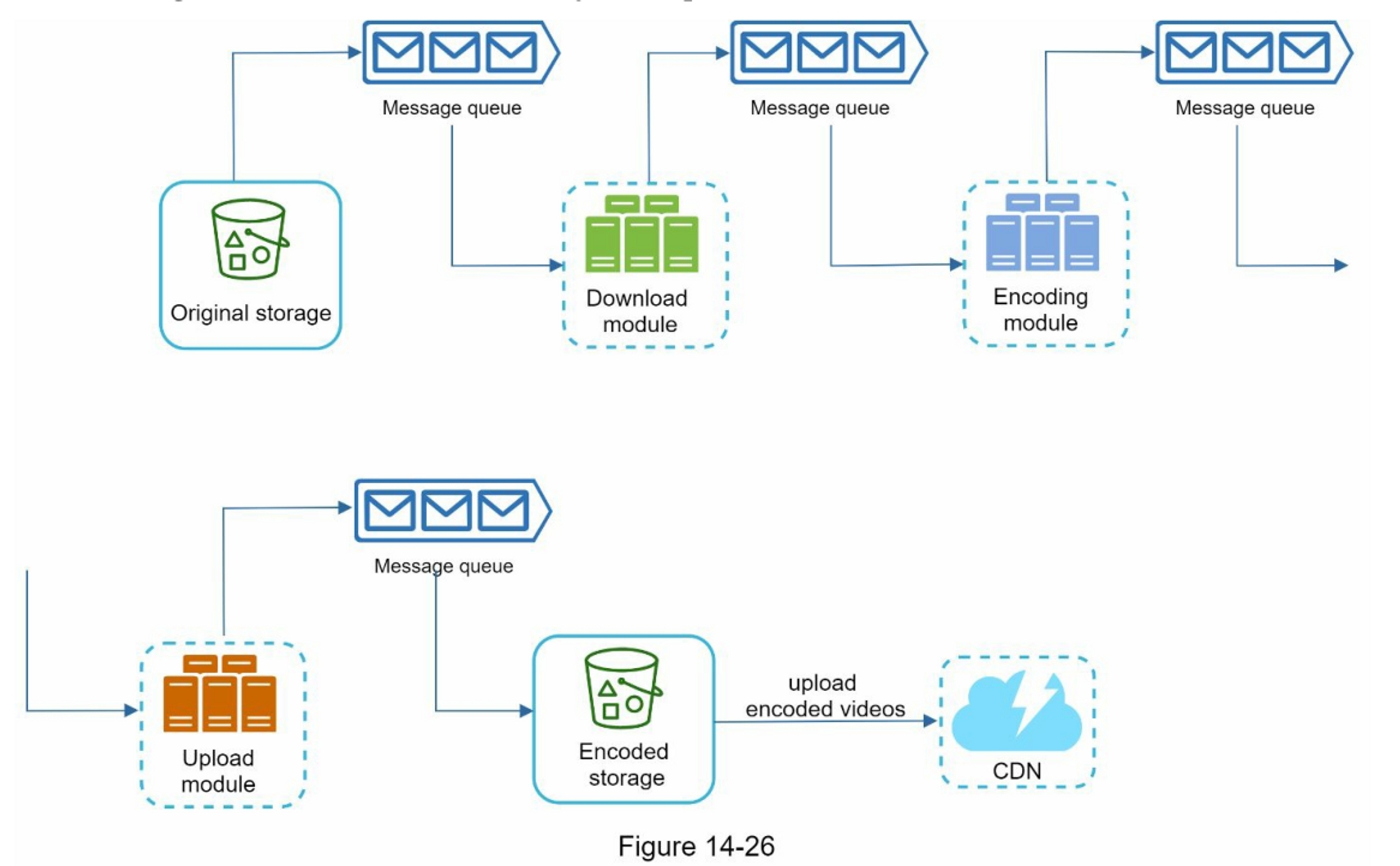

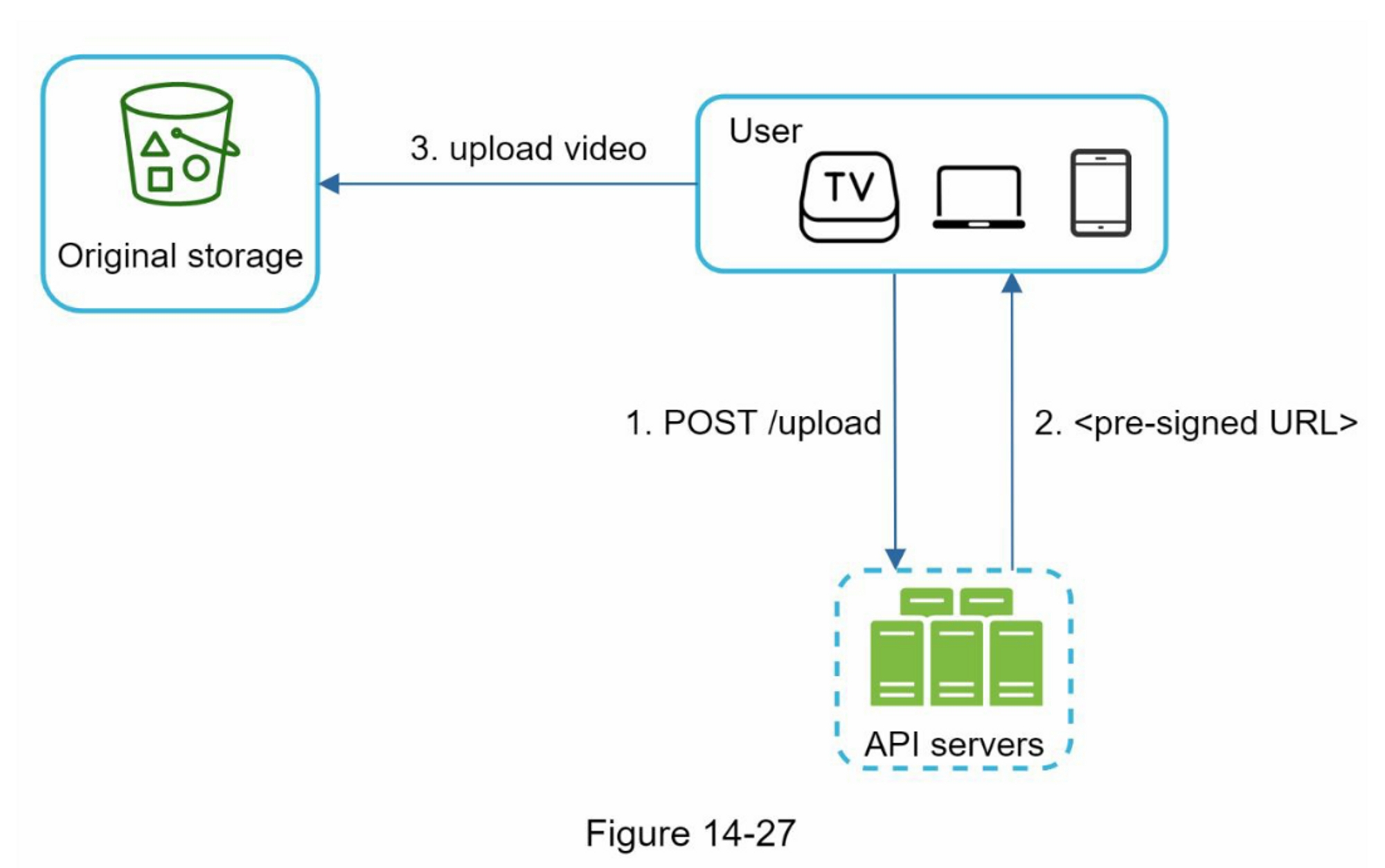

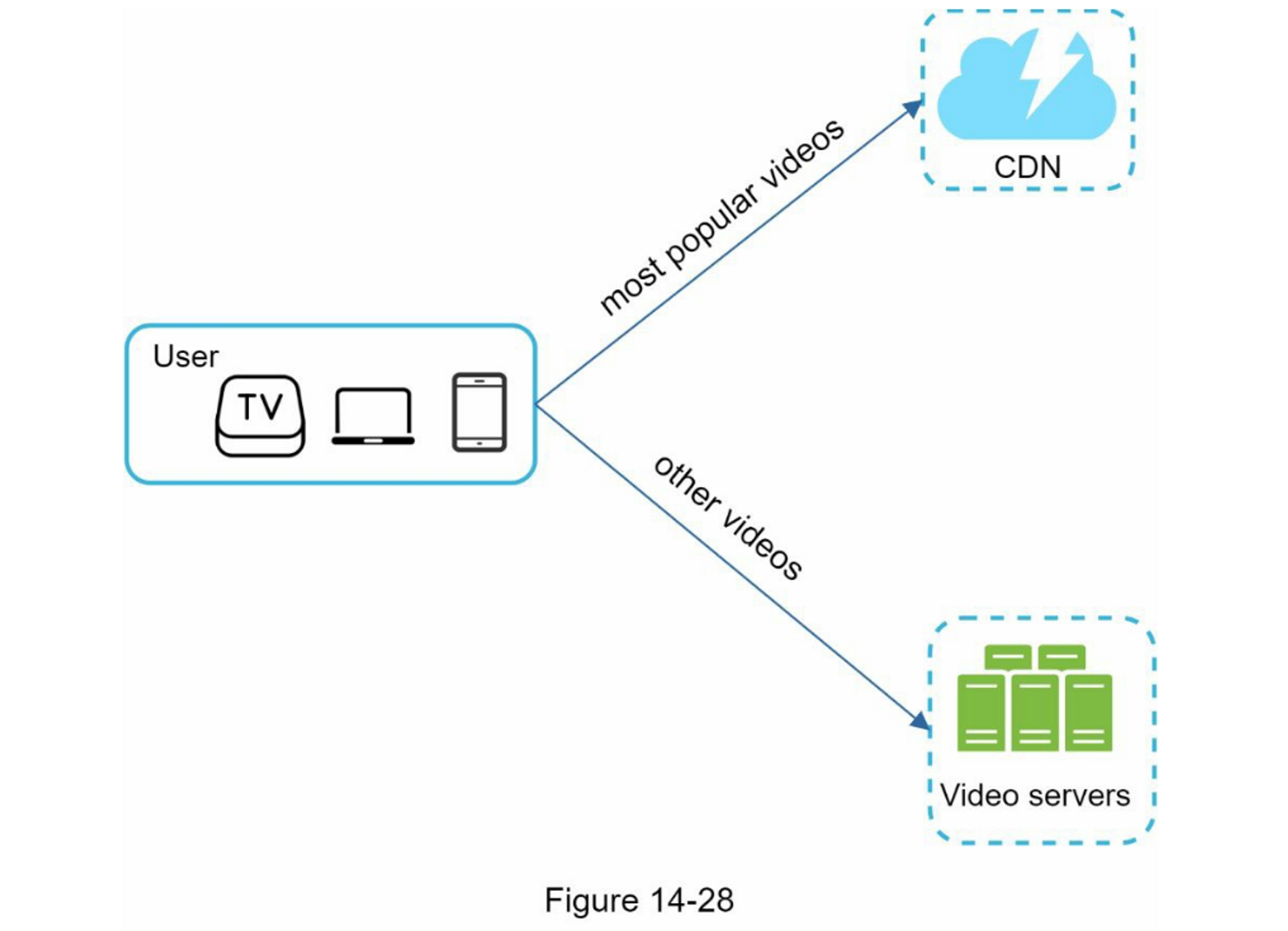

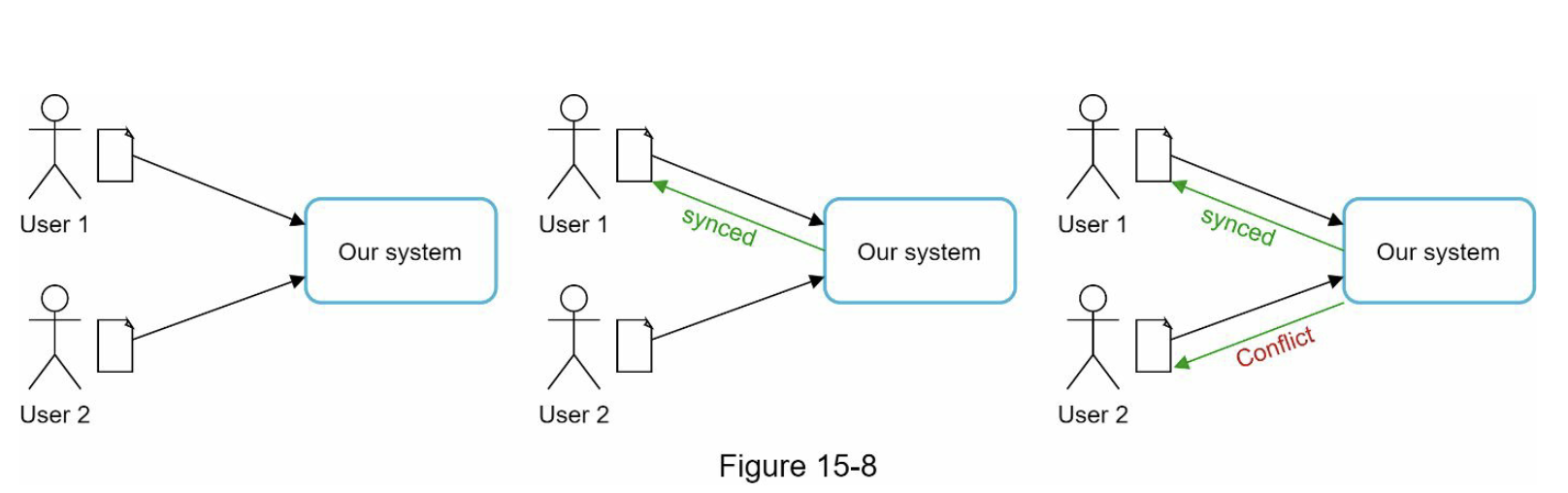

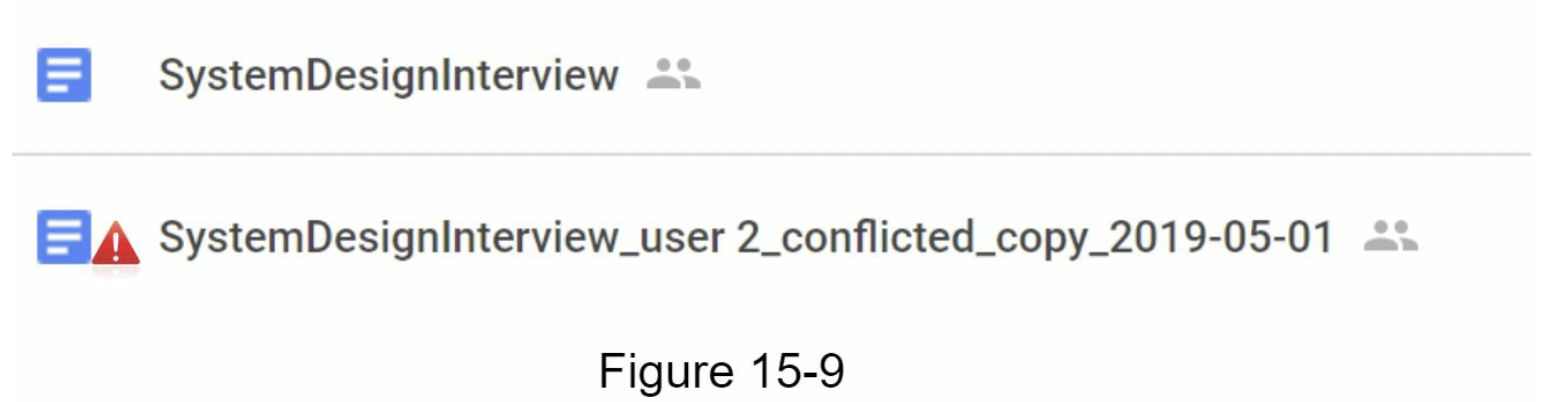

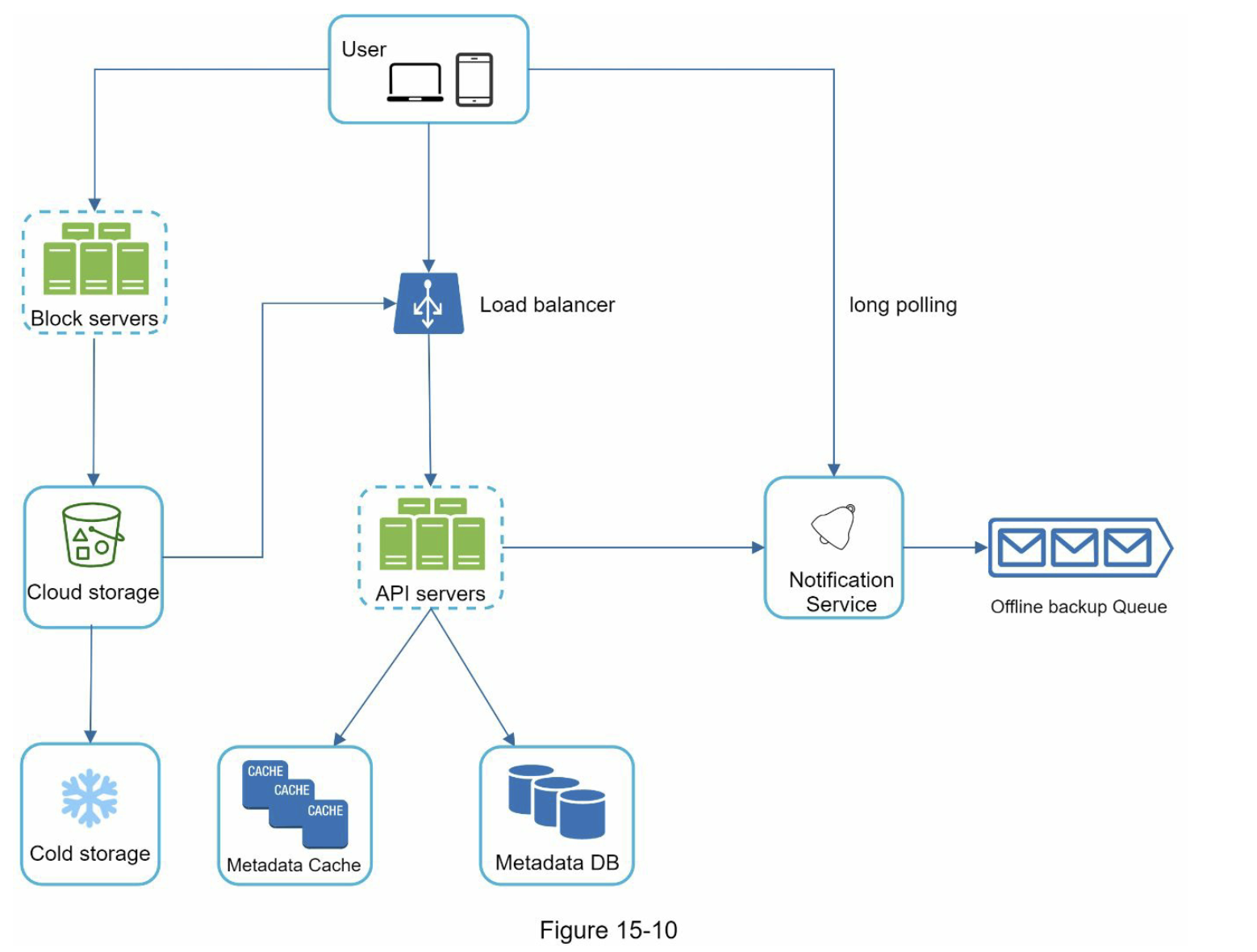

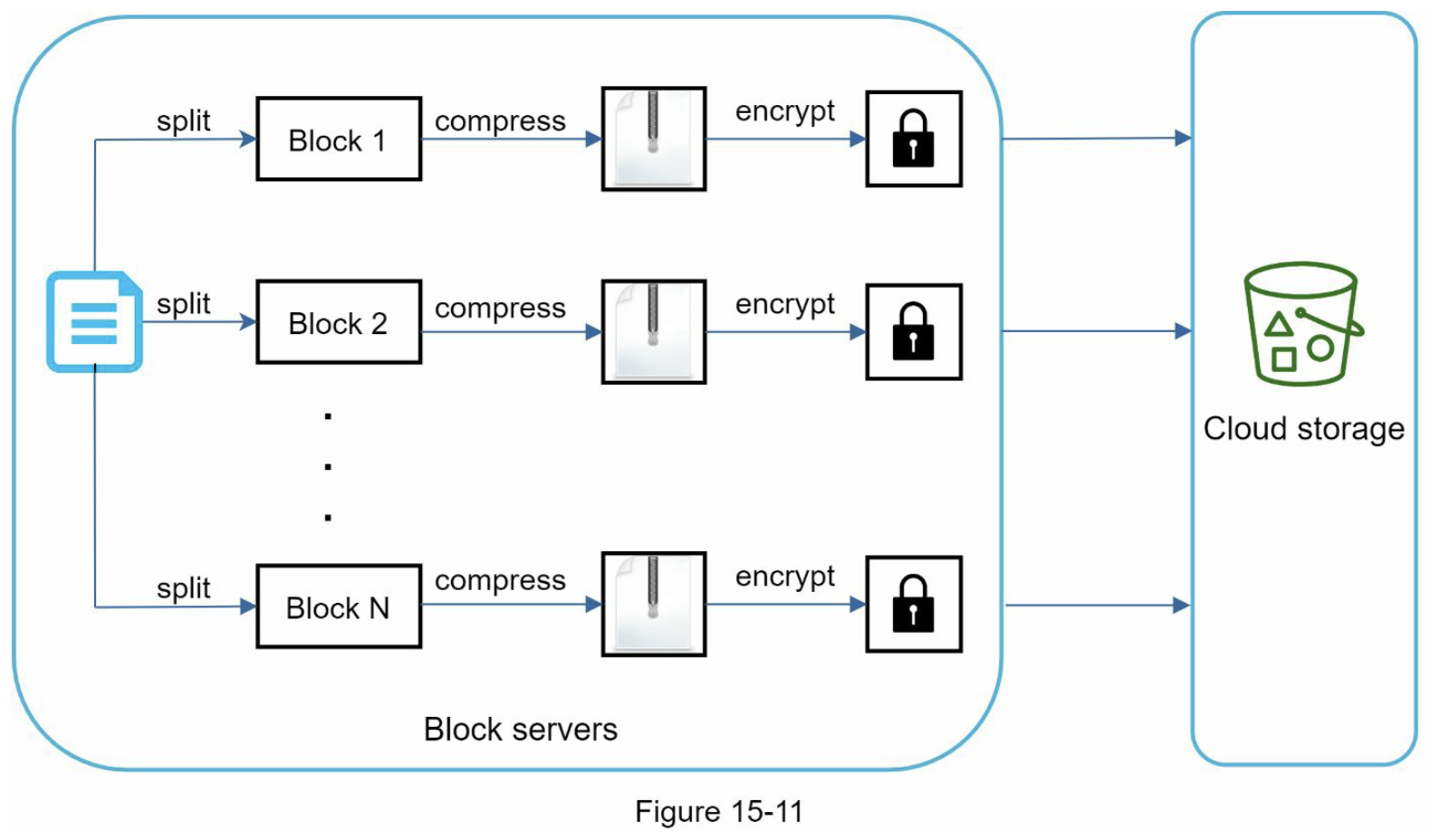

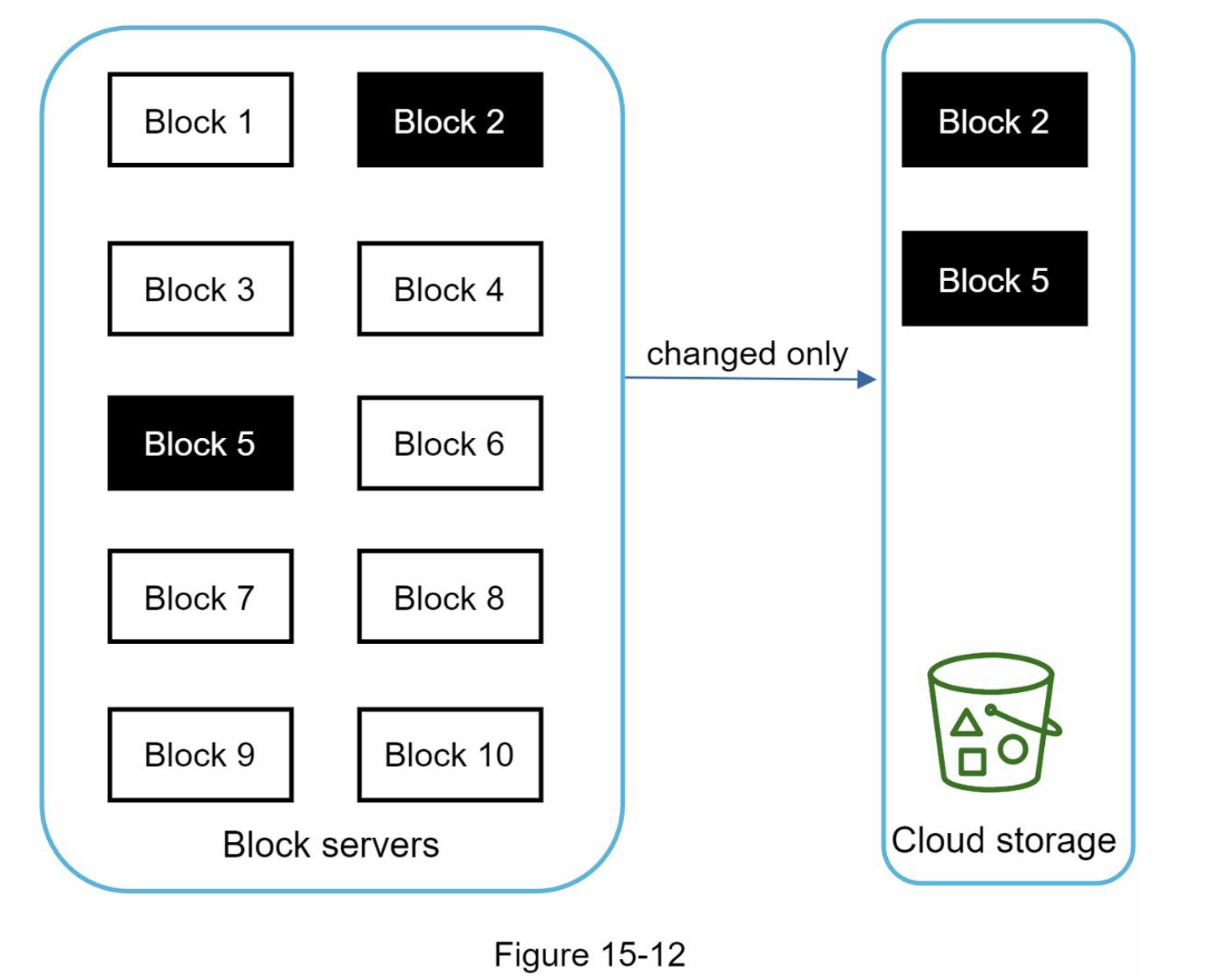

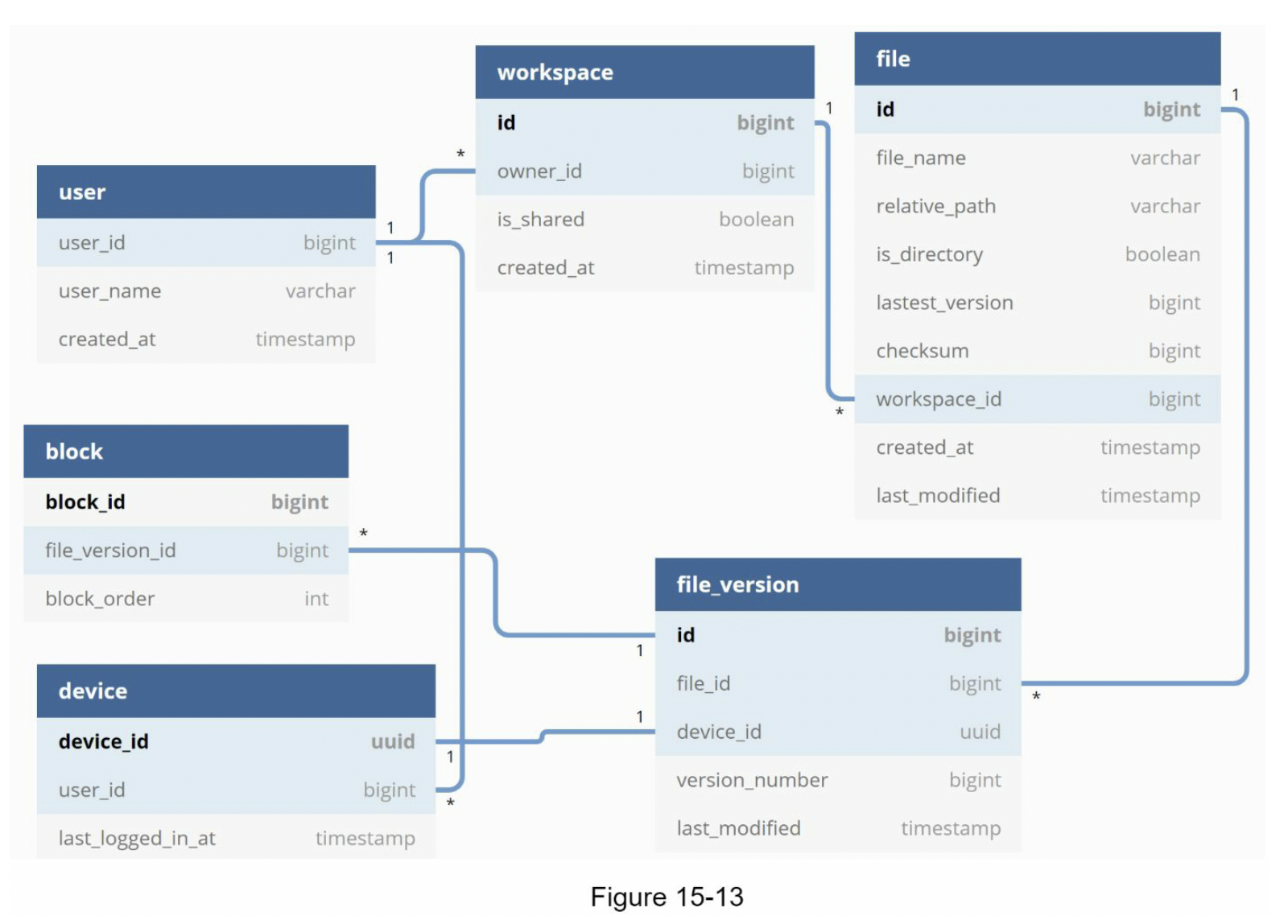

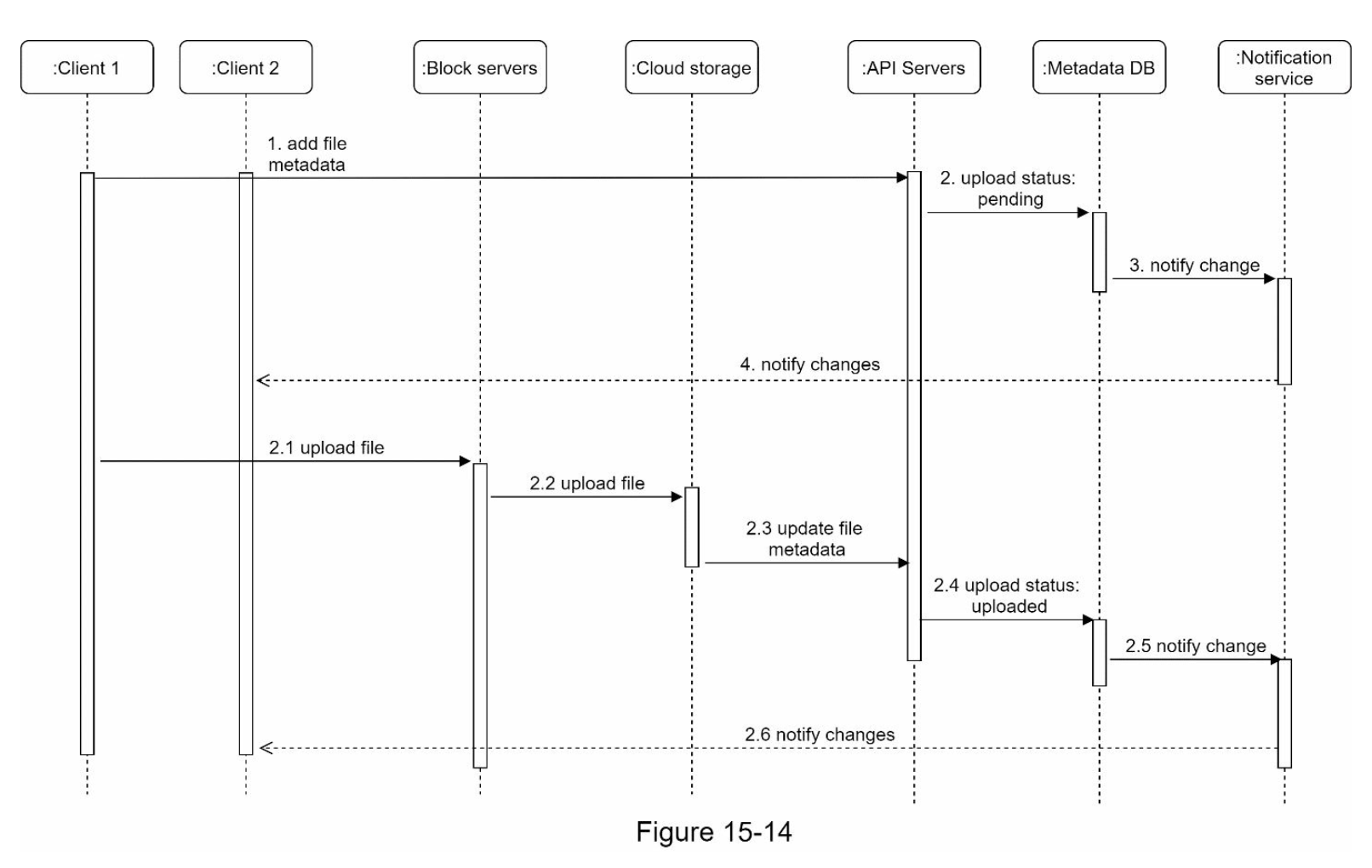

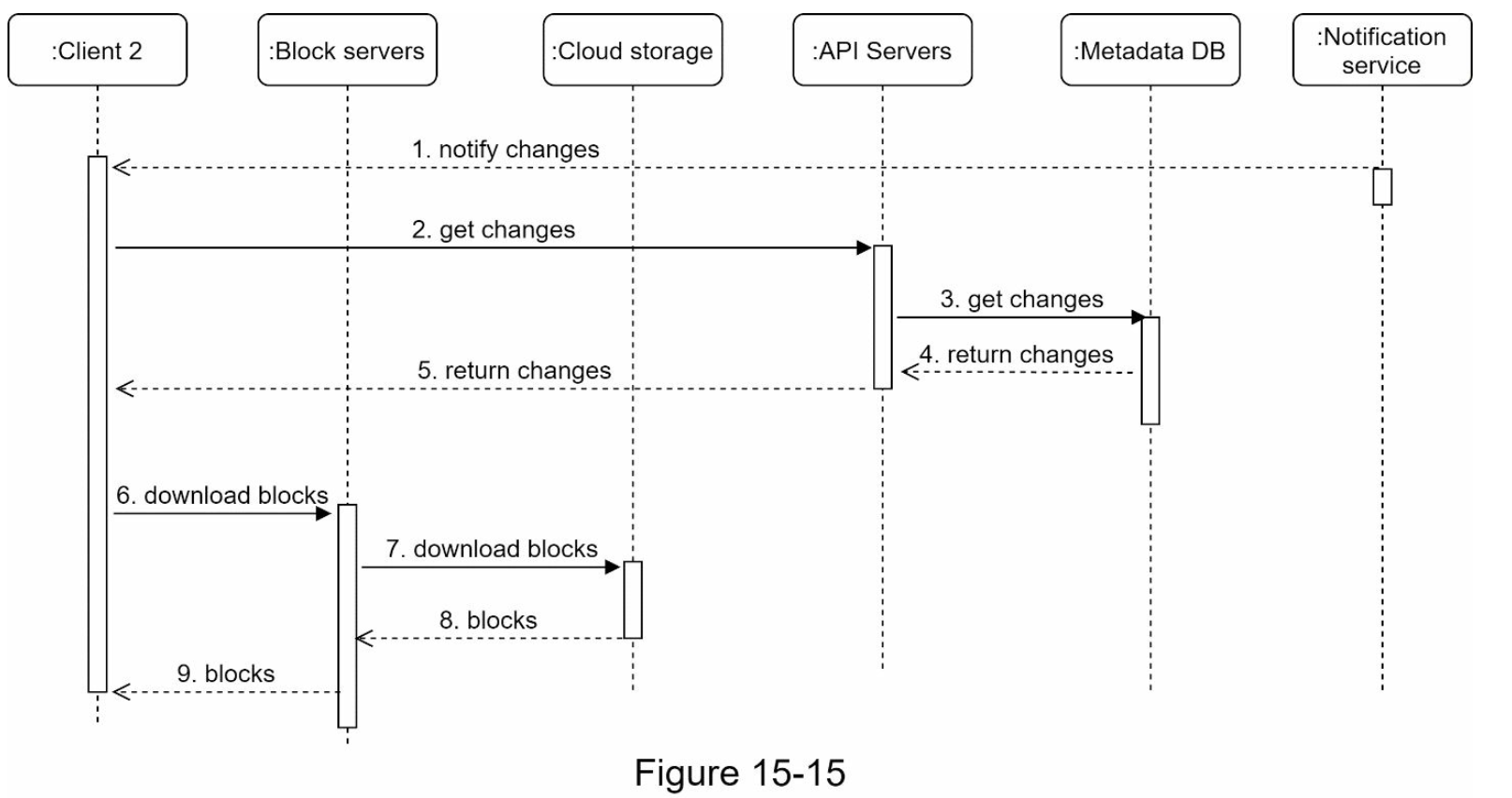

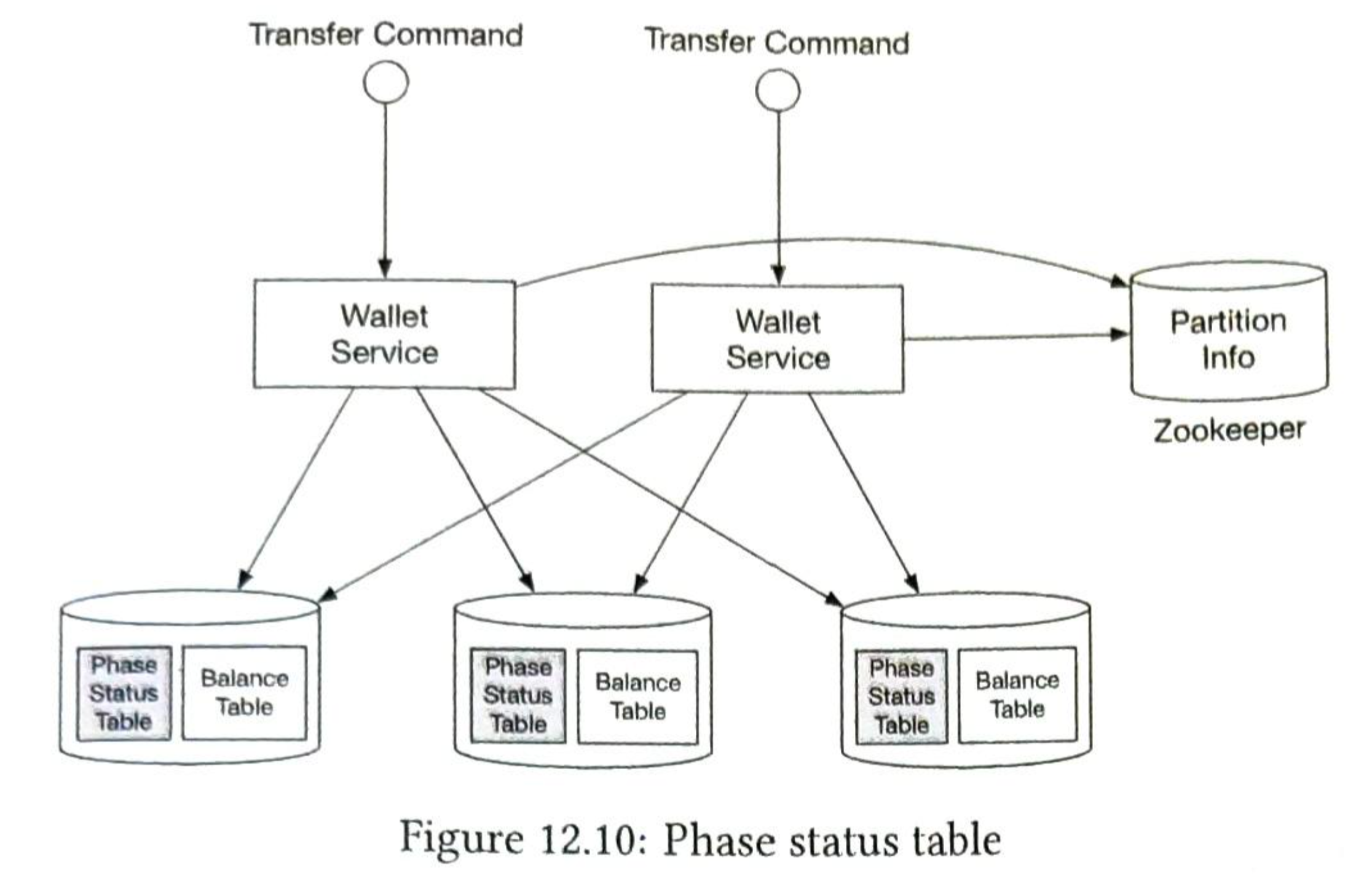

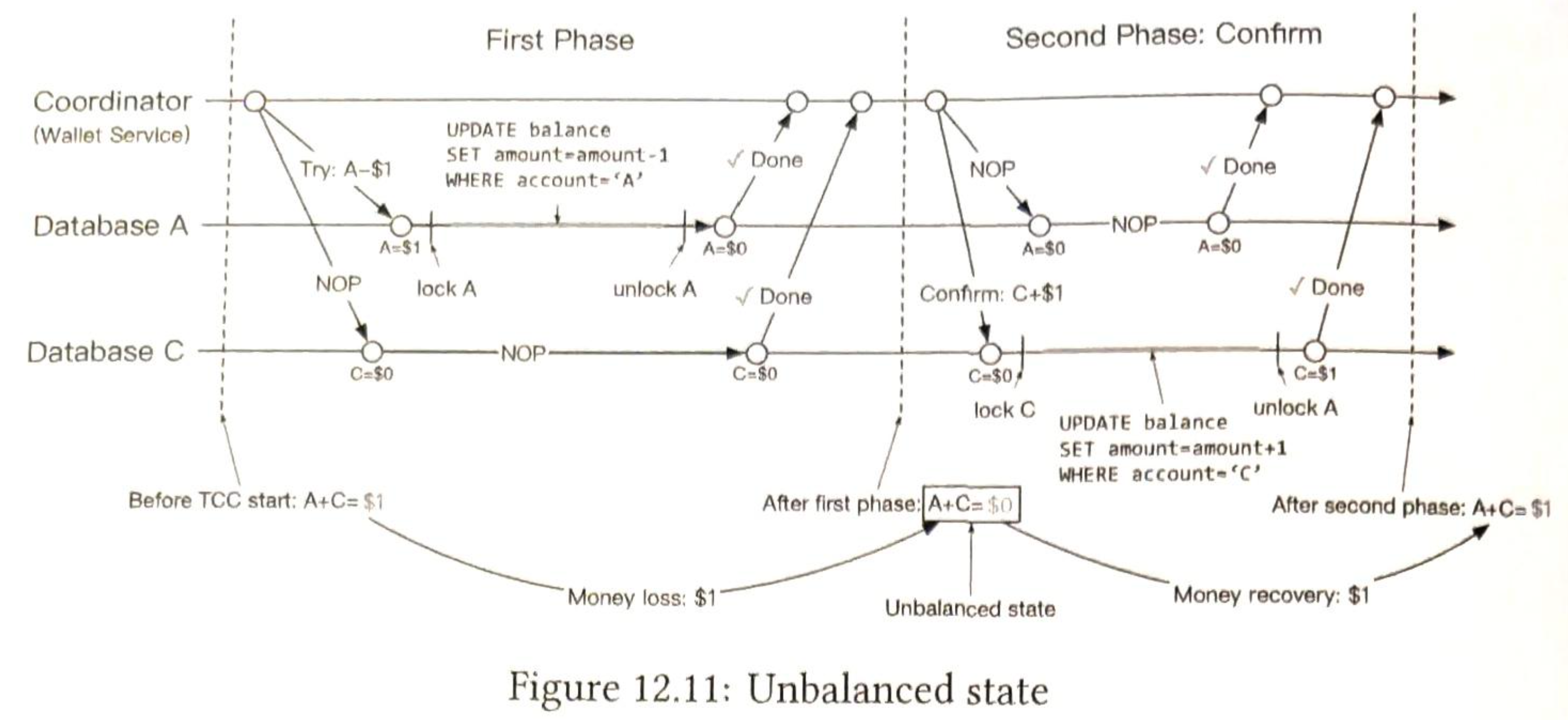

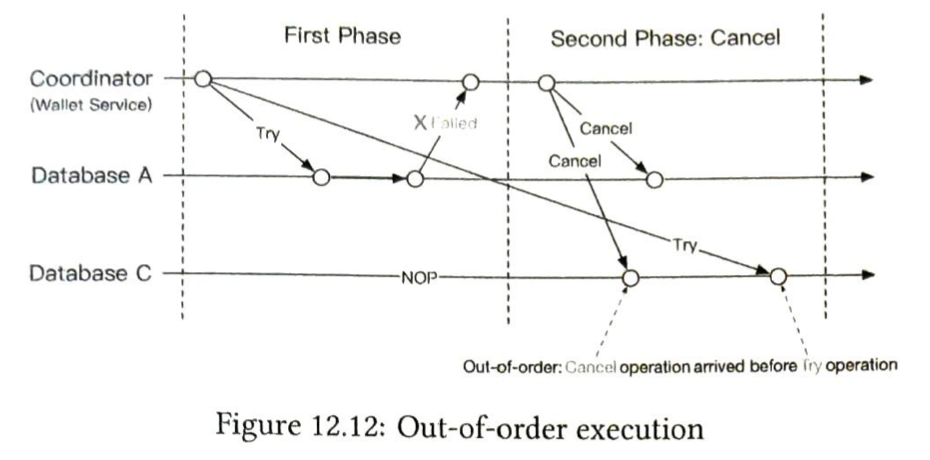

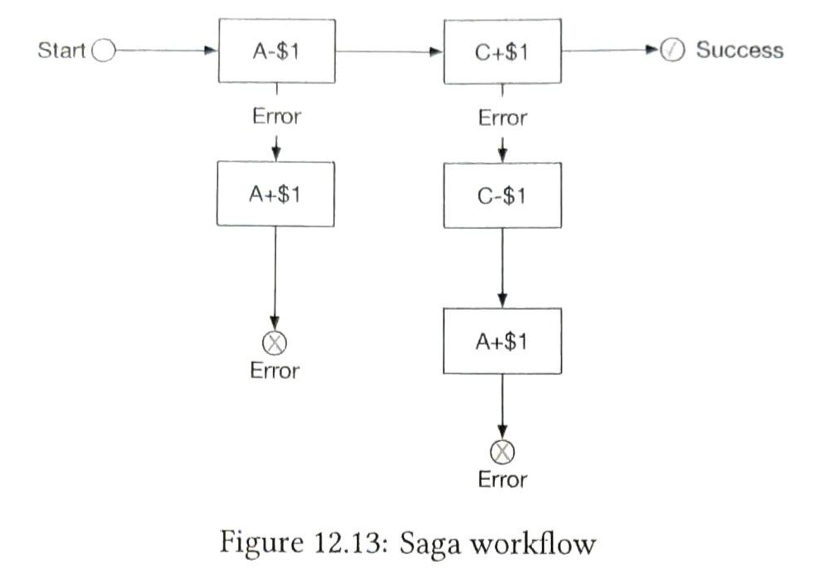

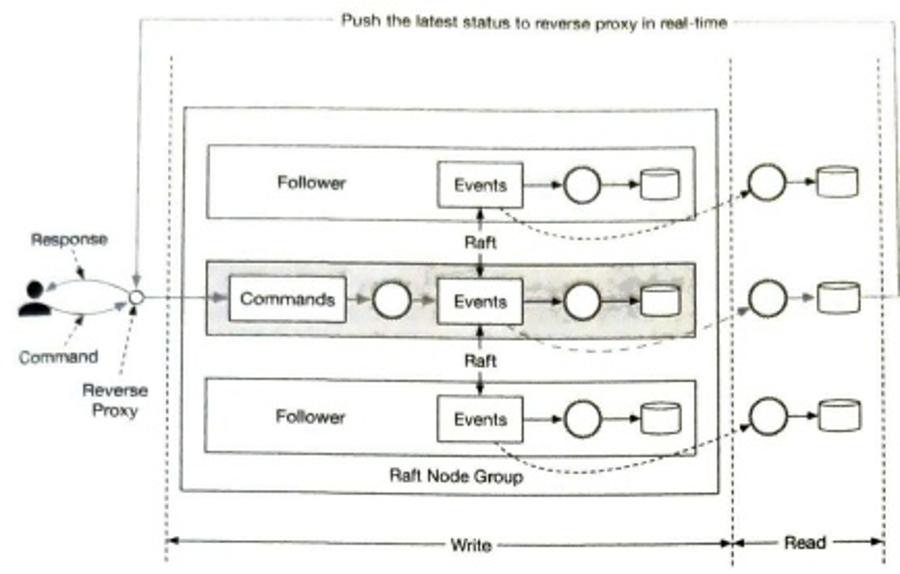

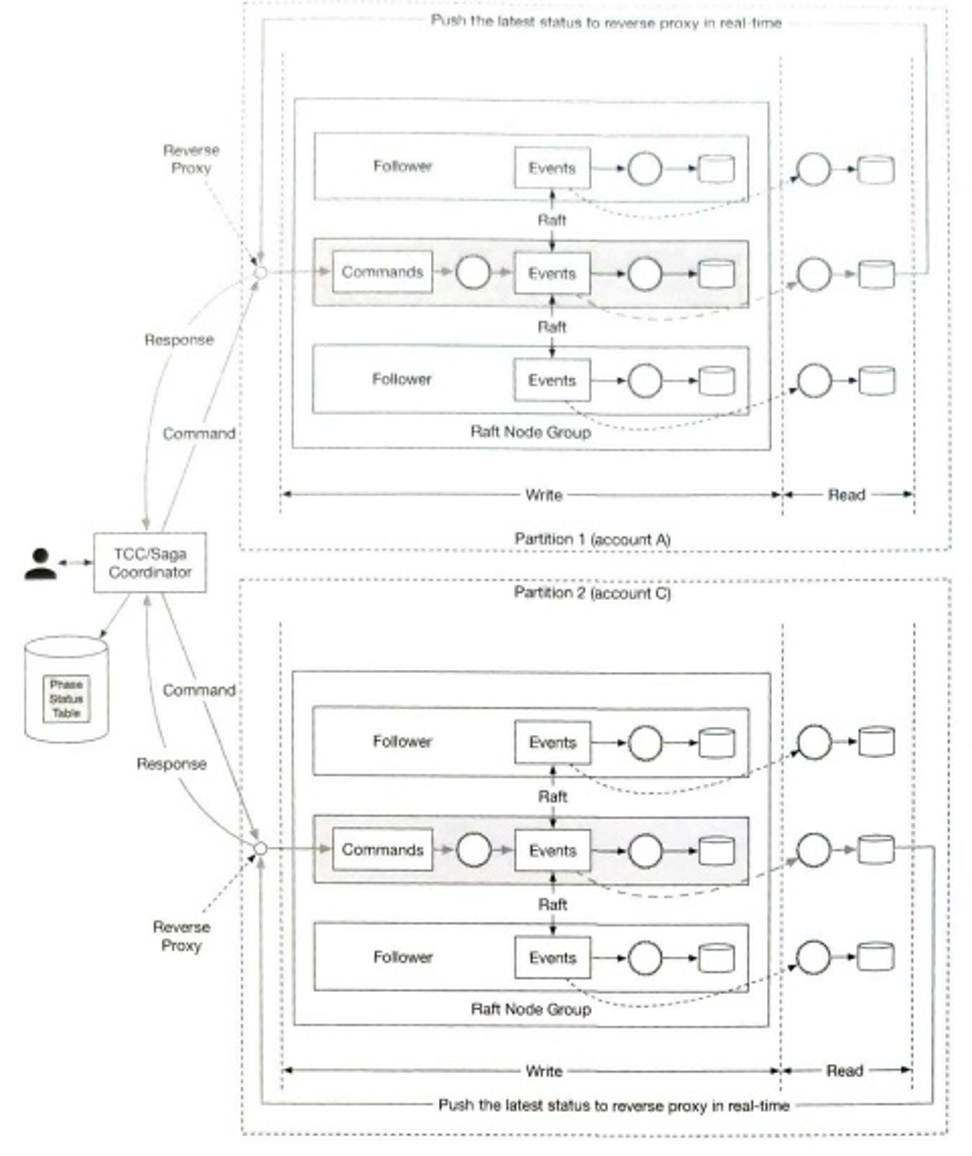

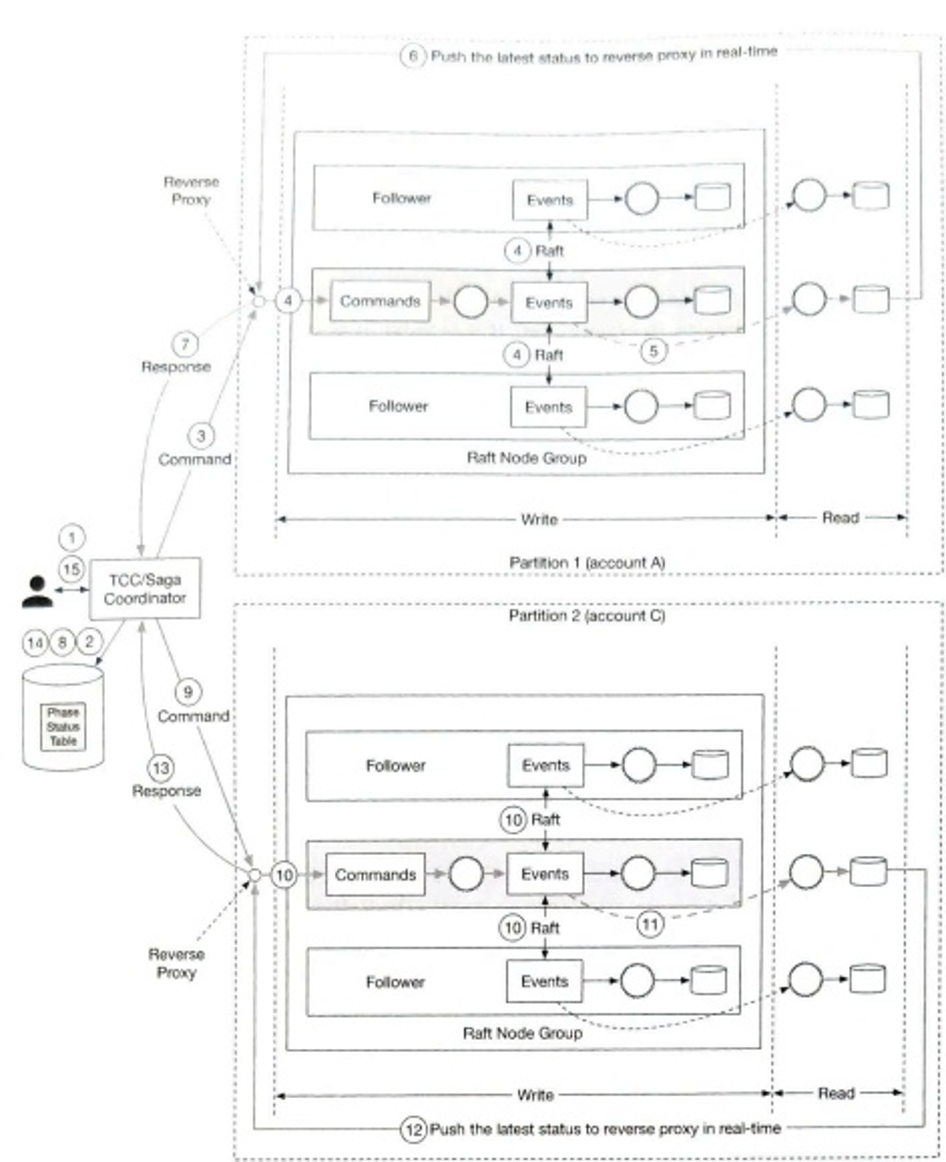

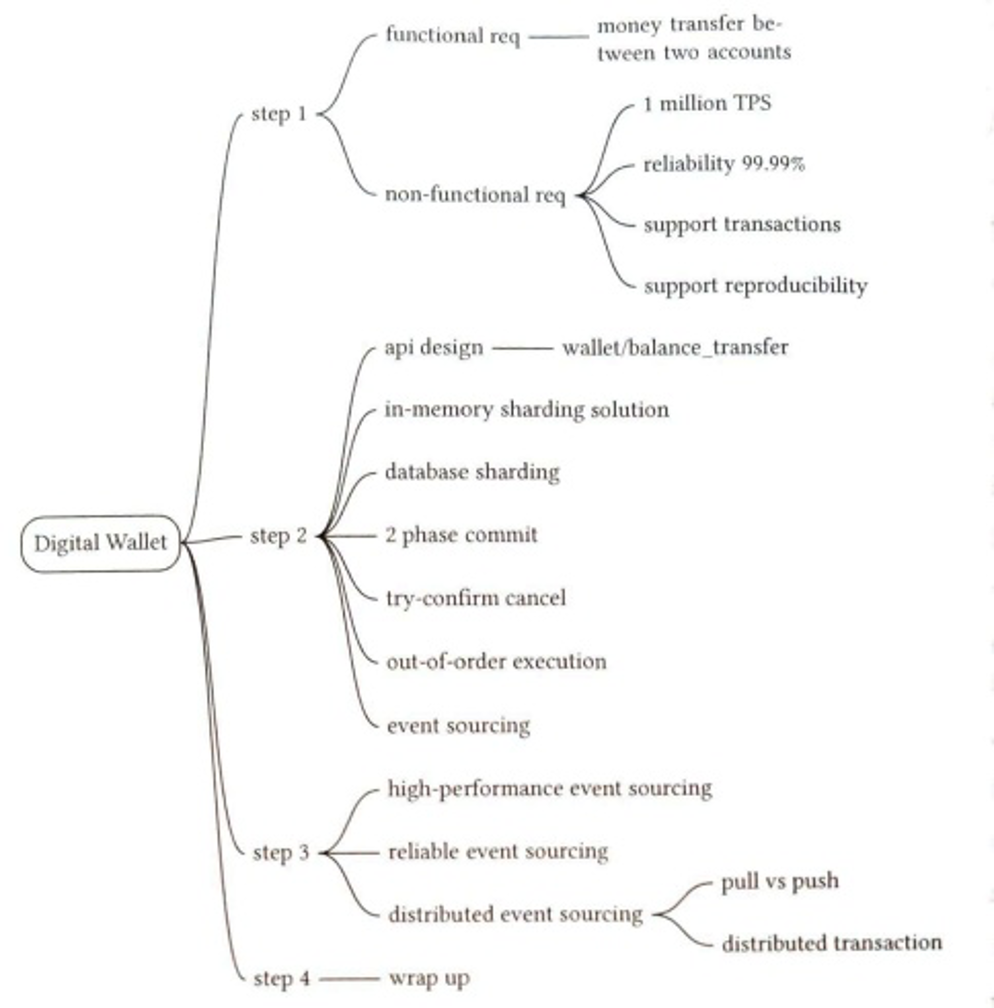

信息源检索深入研究